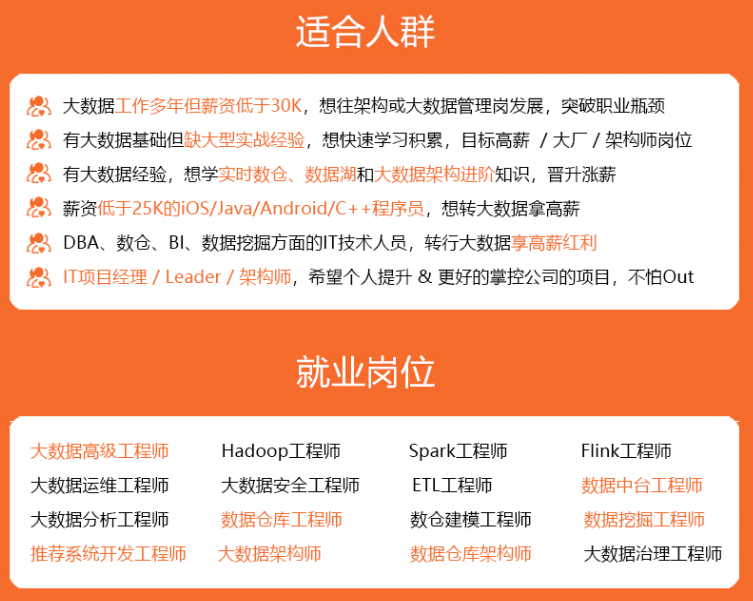

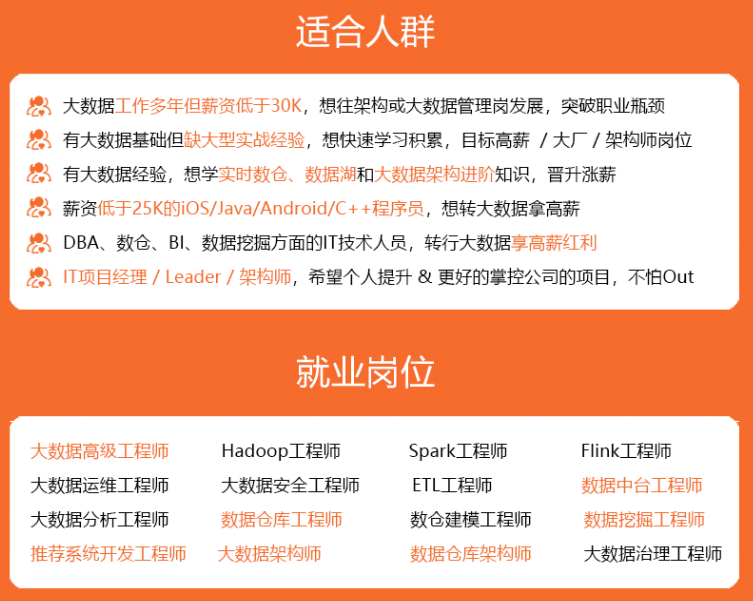

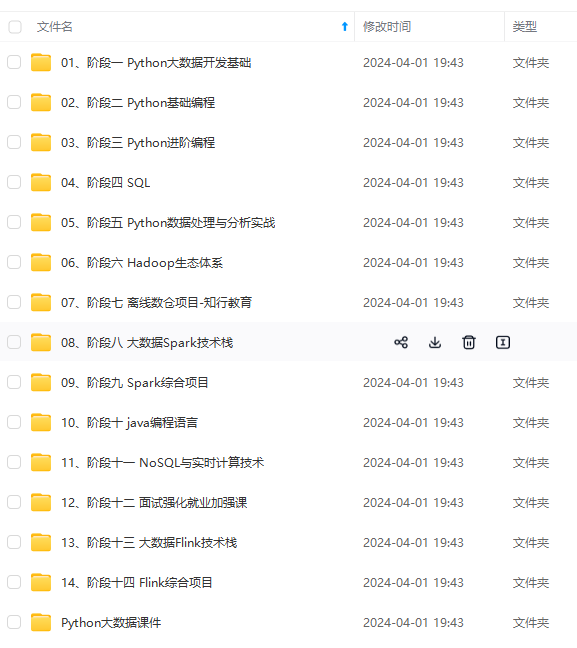

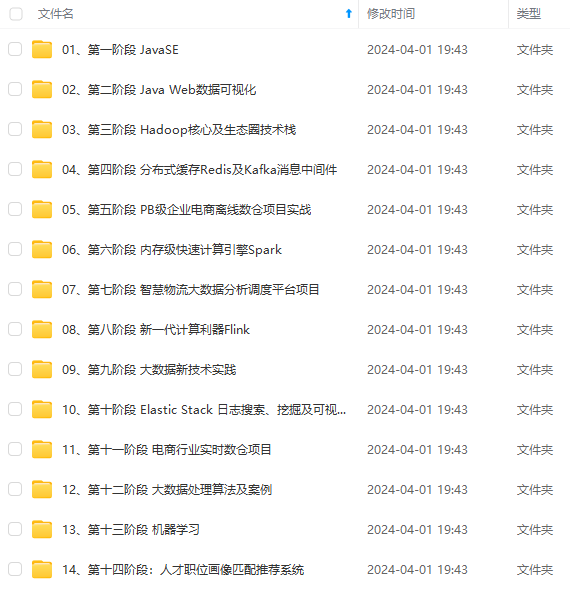

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

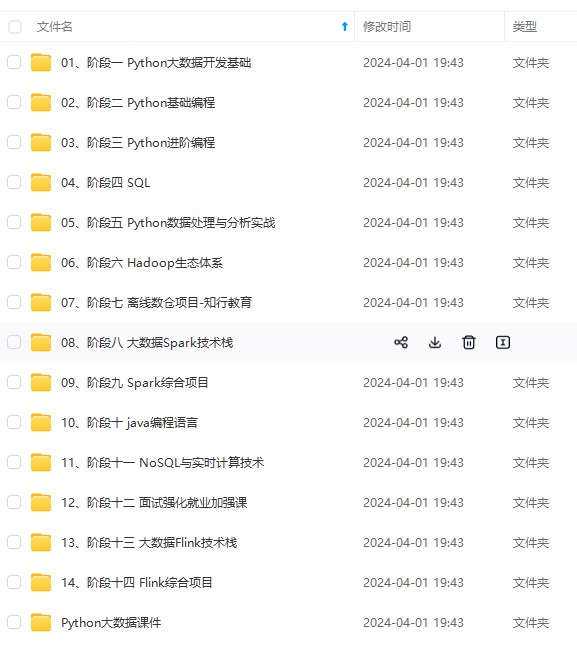

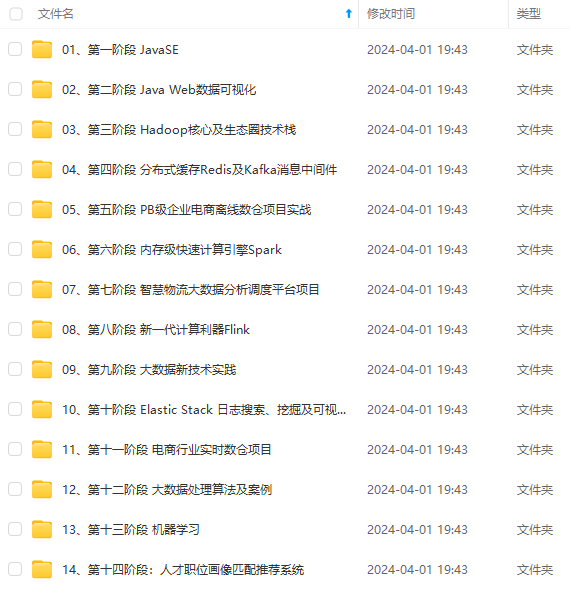

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

+ 4. LangChain 行为不一致并且隐藏细节问题

+ 5. LangChain 缺乏标准的可互操作数据类型问题

+ **大模型(LLMs)langchain 面**

+ **基于LLM+向量库的文档对话 经验面**

- 大模型(LLMs)参数高效微调(PEFT) 面

-

- 一、LoRA篇

- 二、QLoRA篇

- 三、AdaLoRA篇

- 四、LoRA权重是否可以合入原模型?

- 五、ChatGLM-6B LoRA后的权重多大?

- 六、LoRA 微调优点是什么?

- 七、LoRA微调方法为啥能加速训练?

- 八、如何在已有LoRA模型上继续训练?

- 1.1 什么是 LoRA?

- 1.2 LoRA 的思路是什么?

- 1.3 LoRA 的特点是什么?

- 2.1 QLoRA 的思路是怎么样的?

- 2.2 QLoRA 的特点是什么?

- 3.1 AdaLoRA 的思路是怎么样的?

- 一、为什么需要 提示学习(Prompting)?

- 二、什么是 提示学习(Prompting)?

- 三、提示学习(Prompting) 有什么优点?

- 四、提示学习(Prompting)有哪些方法,能不能稍微介绍一下它们间?

- 4.4.1 为什么需要 P-tuning v2?

- 4.4.2 P-tuning v2 思路是什么?

- 4.4.3 P-tuning v2 优点是什么?

- 4.4.4 P-tuning v2 缺点是什么?

- 4.3.1 为什么需要 P-tuning?

- 4.3.2 P-tuning 思路是什么?

- 4.3.3 P-tuning 优点是什么?

- 4.3.4 P-tuning 缺点是什么?

- 4.2.1 为什么需要 指示微调(Prompt-tuning)?

- 4.2.2 指示微调(Prompt-tuning)思路是什么?

- 4.2.3 指示微调(Prompt-tuning)优点是什么?

- 4.2.4 指示微调(Prompt-tuning)缺点是什么?

- 4.2.5 指示微调(Prompt-tuning)与 Prefix-tuning 区别 是什么?

- 4.2.6 指示微调(Prompt-tuning)与 fine-tuning 区别 是什么?

- 4.1.1 为什么需要 前缀微调(Prefix-tuning)?

- 4.1.2 前缀微调(Prefix-tuning)思路是什么?

- 4.1.3 前缀微调(Prefix-tuning)的优点是什么?

- 4.1.4 前缀微调(Prefix-tuning)的缺点是什么?

- 4.1 前缀微调(Prefix-tuning)篇

- 4.2 指示微调(Prompt-tuning)篇

- 4.3 P-tuning 篇

- 4.4 P-tuning v2 篇

- 一、为什么 需要 适配器微调(Adapter-tuning)?

- 二、适配器微调(Adapter-tuning)思路?

- 三、 适配器微调(Adapter-tuning)特点是什么?

- 四、AdapterFusion 思路 是什么?

- 五、AdapterDrop 思路 是什么?

- 六、AdapterDrop 特点 是什么?

- 七、MAM Adapter 思路 是什么?

- 八、MAM Adapter 特点 是什么?

- 微调方法是啥?如何微调?

- 为什么需要 PEFT?

- 介绍一下 PEFT?

- PEFT 有什么优点?

- 微调方法批处理大小模式GPU显存速度?

- Peft 和 全量微调区别?

- 多种不同的高效微调方法对比

- 当前高效微调技术存在的一些问题

- 高效微调技术最佳实践

- PEFT 存在问题?

- 能不能总结一下各种参数高效微调方法?

- 大模型(LLMs)参数高效微调(PEFT) 面

- 适配器微调(Adapter-tuning)篇

- 提示学习(Prompting)

- LoRA 系列篇

- 一、LoRA篇

- 大模型(LLMs)推理面

-

-

- 为什么大模型推理时显存涨的那么多还一直占着?

-

- 大模型在gpu和cpu上推理速度如何?

-

- 推理速度上,int8和fp16比起来怎么样?

-

- 大模型有推理能力吗?

-

- 大模型生成时的参数怎么设置?

-

- 有哪些省内存的大语言模型训练/微调/推理方法?

-

- 如何让大模型输出合规化

-

- 应用模式变更

-

- 大模型(LLMs)评测面

-

- 大模型怎么评测?

- 大模型的honest原则是如何实现的?

- 模型如何判断回答的知识是训练过的已知的知识,怎么训练这种能力?

- 大模型怎么评测?

- 大模型(LLMs)强化学习面

-

- 奖励模型需要和基础模型一致吗?

- RLHF 在实践过程中存在哪些不足?

- 如何解决 人工产生的偏好数据集成本较高,很难量产问题?

- 如何解决三个阶段的训练(SFT->RM->PPO)过程较长,更新迭代较慢问题?

- 如何解决 PPO 的训练过程同时存在4个模型(2训练,2推理),对计算资源的要求较高 问题?

- 奖励模型需要和基础模型一致吗?

- 大模型(LLMs)软硬件配置面

- 大模型(LLMs)训练集面

-

- SFT(有监督微调)的数据集格式?

- RM(奖励模型)的数据格式?

- PPO(强化学习)的数据格式?

- 找数据集哪里找?

- 微调需要多少条数据?

- 有哪些大模型的训练集?

- 进行领域大模型预训练应用哪些数据集比较好?

- SFT(有监督微调)的数据集格式?

- 大模型(LLMs)显存问题面

- 大模型(LLMs)分布式训练面

- 大模型(LLMs)agent 面

-

- 如何给LLM注入领域知识?

- 如果想要快速体验各种模型,该怎么办?

- 如何给LLM注入领域知识?

- Token及模型参数准备篇

-

- 预训练数据 Token 重复 是否影响 模型性能?

- SFT需要训练Token数?

- 预训练数据 Token 重复 是否影响 模型性能?

- LLMs 位置编码篇

-

- 6.1 ALiBi (Attention with Linear Biases) 思路是什么?

- 6.2 ALiBi (Attention with Linear Biases) 的偏置矩阵是什么?有什么作用?

- 6.3 ALiBi (Attention with Linear Biases) 有什么优点?

- 6.4 ALiBi (Attention with Linear Biases) 被哪些 LLMs 应用?

- 5.1 什么是 长度外推问题?

- 5.2 长度外推问题 的 解决方法 有哪些?

- 4.1 旋转位置编码 RoPE 思路是什么?

- 4.2 推导一下 旋转位置编码 RoPE ?

- 4.3 旋转位置编码 RoPE 有什么优点?

- 4.4 旋转位置编码 RoPE 被哪些 LLMs 应用?

- 1 什么是位置编码?

- 2 什么是绝对位置编码?

- 3 什么是相对位置编码?

- 4 旋转位置编码 RoPE篇

- 5 长度外推问题篇

- 6 ALiBi (Attention with Linear Biases)篇

- 6.1 ALiBi (Attention with Linear Biases) 思路是什么?

- LLMs Tokenizer 篇

-

- Byte-Pair Encoding(BPE)篇

- WordPiece 篇

- SentencePiece 篇

- 对比篇

- 1 Byte-Pair Encoding(BPE) 如何构建词典?

- 1 WordPiece 与 BPE 异同点是什么?

- 简单介绍一下 SentencePiece 思路?

- 1 举例 介绍一下 不同 大模型LLMs 的分词方式?

- 2 介绍一下 不同 大模型LLMs 的分词方式 的区别?

- LLMs Tokenizer 篇

- Byte-Pair Encoding(BPE)篇

- Layer Normalization 篇

-

- LLMs 各模型分别用了 哪种 Layer normalization?

- 1 LN 在 LLMs 中的不同位置 有什么区别么?如果有,能介绍一下区别么?

- Layer Norm 篇

- RMS Norm 篇 (均方根 Norm)

- Deep Norm 篇

- Deep Norm 有什么优点?

- Layer Norm 的计算公式写一下?

- RMS Norm 的计算公式写一下?

- RMS Norm 相比于 Layer Norm 有什么特点?

- Deep Norm 思路?

- 写一下 Deep Norm 代码实现?

- LLMs 各模型分别用了 哪种 Layer normalization?

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新