网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

mapreduce.jobhistory.webapp.address node1:19888 yarn.app.mapreduce.am.env HADOOP_MAPRED_HOME=${HADOOP_HOME} mapreduce.map.env HADOOP_MAPRED_HOME=${HADOOP_HOME} mapreduce.reduce.env HADOOP_MAPRED_HOME=${HADOOP_HOME}

#### 5.yarn-site.xml

#### 6.workers

vi workers

node1

node2

node3

### 二、分发安装包并启动

cd /export/server

scp -r hadoop-3.3.0 root@node2: P W D s c p − r h a d o o p − 3.3.0 r o o t @ n o d e 3 : PWD scp -r hadoop-3.3.0 root@node3: PWDscp−rhadoop−3.3.0root@node3:PWD

添加环境变量

vim /etc/proflie

Hadoop3

export HADOOP_HOME=/export/server/hadoop-3.3.0

export PATH=

P

A

T

H

:

PATH:

PATH:HADOOP_HOME/bin:

H

A

D

O

O

P

_

H

O

M

E

/

s

b

i

n

e

x

p

o

r

t

H

A

D

O

O

P

_

C

O

M

M

O

N

_

L

I

B

_

N

A

T

I

V

E

_

D

I

R

=

HADOOP\_HOME/sbin export HADOOP\_COMMON\_LIB\_NATIVE\_DIR=

HADOOP_HOME/sbinexportHADOOP_COMMON_LIB_NATIVE_DIR=HADOOP_HOME/lib/native

export HADOOP_OPTS=“-Djava.library.path=

H

A

D

O

O

P

_

H

O

M

E

/

l

i

b

/

n

a

t

i

v

e

:

HADOOP\_HOME/lib/native:

HADOOP_HOME/lib/native:HADOOP_COMMON_LIB_NATIVE_DIR”

export YARN_HOME=

H

A

D

O

O

P

_

H

O

M

E

e

x

p

o

r

t

H

A

D

O

O

P

_

C

O

N

F

_

D

I

R

=

HADOOP\_HOME export HADOOP\_CONF\_DIR=

HADOOP_HOMEexportHADOOP_CONF_DIR=HADOOP_HOME/etc/hadoop

#有个警告信息就是处理不了,解决了踢我谢谢

#WARNING: YARN_CONF_DIR has been replaced by HADOOP_CONF_DIR. Using value of YARN_CONF_DIR.Stopping nodemanagers

#export YARN_CONF_DIR=$YARN_HOME/etc/hadoop

export HADOOP_LOG_DIR=

H

A

D

O

O

P

_

H

O

M

E

/

l

o

g

s

e

x

p

o

r

t

H

D

F

S

_

C

O

N

F

_

D

I

R

=

HADOOP\_HOME/logs export HDFS\_CONF\_DIR=

HADOOP_HOME/logsexportHDFS_CONF_DIR=HADOOP_HOME/etc/hadoop

export PATH=.:

J

A

V

A

_

H

O

M

E

/

l

i

b

:

JAVA\_HOME/lib:

JAVA_HOME/lib:HADOOP_HOME/sbin:

H

A

D

O

O

P

_

H

O

M

E

/

b

i

n

:

HADOOP\_HOME/bin:

HADOOP_HOME/bin:PATH

source /etc/profile

首次启动 格式化namenode

hdfs namenode -format

一键启动

start-dfs.sh

start-yarn.sh

Web UI页面

* HDFS集群:<http://node1:9870/>

* YARN集群:<http://node1:8088/>

#### 所需要的文件

[jdk-8u65-linux-x64.tar.gz]( )

[hadoop-3.3.0-src.tar.gz]( )

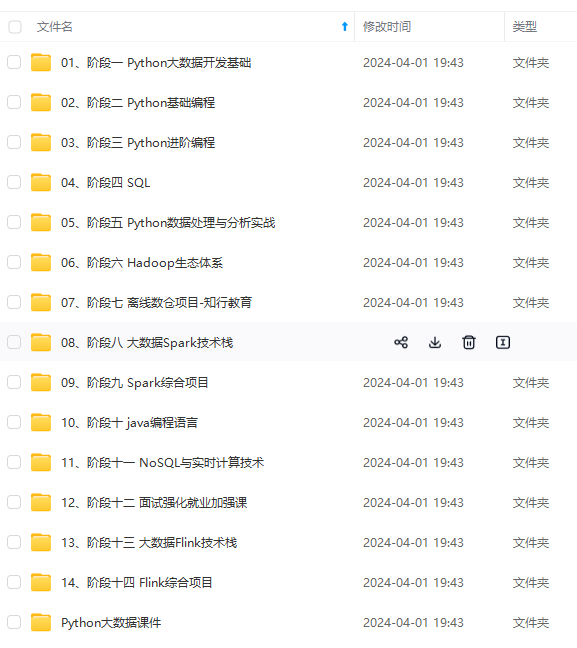

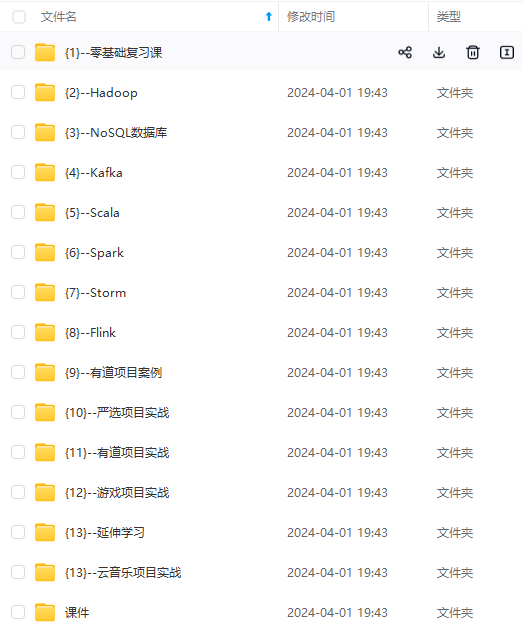

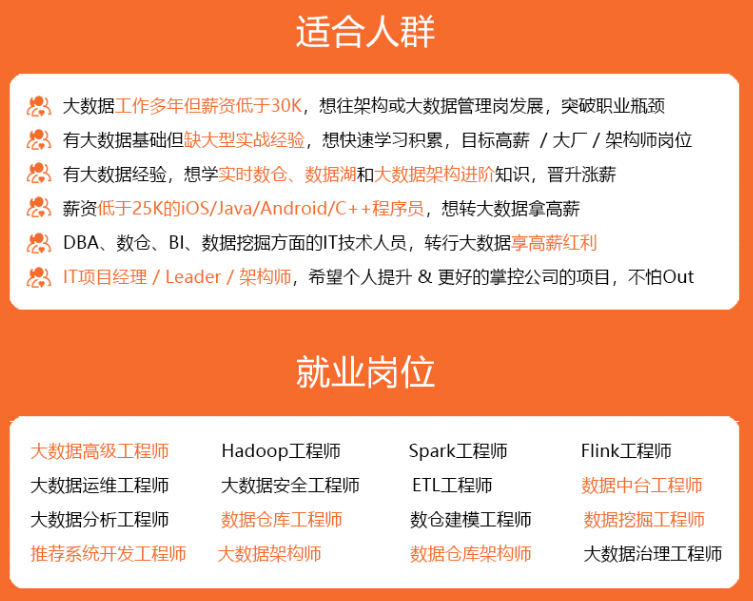

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

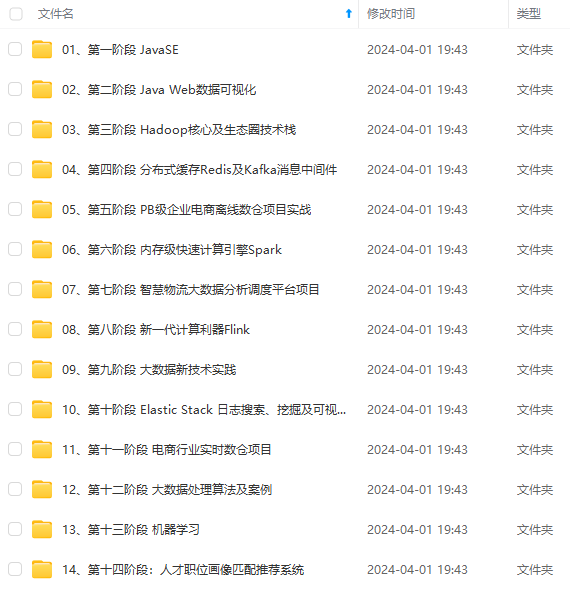

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

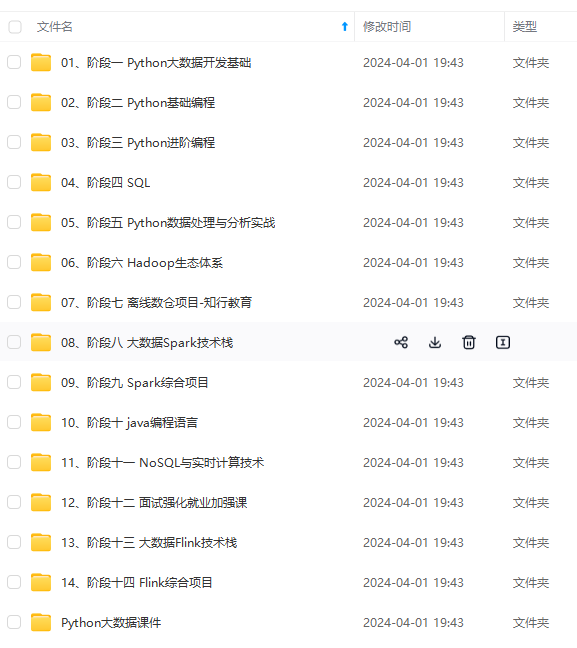

阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**