目录

引言

胶质瘤是原发性脑肿瘤中最常见的一种,其浸润性特征通常会导致预后不良和重大的治疗挑战。根据世界卫生组织(WHO)对中枢神经系统肿瘤的最新分类,胶质瘤包括各种亚型,每种亚型都由组织病理学和分子特征定义,这些特征直接影响其侵袭性、管理和预后。

胶质瘤的手术治疗尤其具有挑战性,因为它们通常位于邻近重要脑区的位置,在那里,保留关键神经功能可能会限制切除的范围。最大限度地切除肿瘤是公认与患者生存期延长相关的因素,这突出了在肿瘤切除和功能保留之间实现最佳平衡的重要性。因此,当前的标准护理是达到所谓的最大安全切除。为了实现这一目标,外科医生可以利用几种辅助术中工具,包括荧光剂(例如,5-氨基乙酰丙酸、荧光素钠)、神经导航、直接电刺激和术中成像技术。在成像模式中,术中磁共振成像(ioMR)和术中超声(ioUS)尤为突出。尽管ioMR被认为是金标准,但其高昂的成本和对后勤的要求限制了其在许多中心的可用性。相比之下,ioUS具有几个优势,包括多功能性、低成本以及与手术流程的无缝集成。然而,ioUS的有效使用涉及陡峭的学习曲线,并且高度依赖于操作者。此外,ioUS图像的解释受到伪影、采集平面的变化、某些肿瘤中健康组织和病理组织之间对比度低、信噪比差以及视野有限的影响。尽管过去几十年ioUS图像质量取得了重大进展,并且许多研究证实其使用有助于实现最大安全切除,但其局限性仍然阻碍了其在神经外科实践中的广泛应用。增强ioUS图像的可解释性可以促进培训中的外科医生的使用,并提高肿瘤边缘的精确识别。反过来,这有可能优化图像引导手术并增加切除范围,这是有效管理胶质瘤的关键因素。

医学影像长期以来一直推动着高级分类、检测和分割系统的发展。例如,实例分割在脑肿瘤中得到了广泛的研究,尤其是在磁共振成像(MRI)中,这在科学文献中占主导地位。相比之下,ioUS中的分割受到的关注要少得多,而专注于将这些方法应用于实时术中环境的研究则更少。基于深度学习的技术的发展彻底改变了医学图像的解释,使自动检测异常变得容易,而无需在像素级别上精确。目标检测已被确立为动态环境(如农业、交通、教育和医疗保健)中实时分析的关键解决方案。在这些算法中,YOLO由Redmon等人引入,它通过将区域建议和分类集成到一个神经网络中,彻底改变了实时检测。

在这项工作中,作者提出了通过实时肿瘤检测来增强ioUS的可解释性。分割被视为次要目标,因为在手术中不需要像素级别的精度来勾画肿瘤边缘。相反,外科医生根据术前计划以及肿瘤位置、邻近eloquent区域、疑似肿瘤类型和患者特异性特征等因素来确定切除的范围。因此,作者优先考虑检测作为主要目标,使用边界框来定位肿瘤,从而提高图像解释能力并使其与相邻的脑结构相关联,而不会干扰可视化或手术流程。此外,残余肿瘤的准确检测有可能促进图像引导手术并改善切除结果。该方法基于使用来自多中心数据集的ioUS图像训练YOLO11模型,并通过前瞻性病例评估其实时实现。

这项工作介绍了几个创新贡献:

-

高质量的多中心数据集:来自脑肿瘤术中超声数据库(BraTioUS)的图像,该数据库由来自不同制造商和采集协议的六个中心组成。

-

胶质瘤亚型:该模型将使用低级别和高级别胶质瘤进行训练,以解决识别边界不清晰的肿瘤,即使对于专家来说也具有挑战性。

-

专家细化的伪标签:伪标签是通过初步模型生成的,并由专家观察者手动纠正。

-

仅使用ioUS:该模型不依赖于其他模态的图像,例如MRI,也不依赖于生成的或配准的分割,从而促进其临床应用。

-

实时实现:该模型将专门开发用于目标检测,并通过低成本系统在真实的手术环境中进行评估。

-

YOLO11变体的比较分析:评估所有可用的变体,以在精度和计算效率方面建立基准。

一、论文信息

论文题目:Real-Time Brain Tumor Detection in Intraoperative Ultrasound Using YOLO11: From Model Training to Deployment in the Operating Room

论文链接:https://arxiv.org/pdf/2501.15994

二、摘要

术中超声(ioUS)是一种在脑肿瘤手术中很有价值的工具,因为它具有多功能性、成本低廉,并且可以无缝地集成到手术流程中。然而,其采用仍然有限,主要由于与图像解释相关的挑战以及有效使用所需的陡峭学习曲线。这项研究旨在通过开发一个可部署在手术室的实时脑肿瘤检测系统来增强ioUS图像的可解释性。我们从脑肿瘤术中超声数据库(BraTioUS)和公开的ReMIND数据集中收集了二维ioUS图像,并由专家进行了精炼的肿瘤标注。使用YOLO11架构及其变体,我们训练了目标检测模型来识别脑肿瘤。数据集包括192名患者的1,732张图像,分为训练集、验证集和测试集。数据增强技术将训练集扩展到11,570张图像。在测试数据集中,YOLO11s实现了精度和计算效率的最佳平衡,mAP@50为0.95,mAP@50-95为0.65,处理速度为34.16帧/秒。该解决方案在一个由15名连续接受脑肿瘤手术的患者组成的前瞻性队列中得到了验证。神经外科医生证实了其与手术流程的无缝集成,实时预测准确地勾画了肿瘤区域。这些发现突出了实时目标检测算法在增强ioUS引导的脑肿瘤手术方面的潜力,解决了图像解释的关键挑战,并为未来开发基于计算机视觉的神经外科手术工具奠定了基础。

三、数据集

-

研究人群

本研究的主要数据集来自BraTioUS联盟,该数据集由2018年至2023年进行脑肿瘤手术的患者获得的ioUS图像组成。在本研究中,仅包括根据2021年WHO中枢神经系统肿瘤分类诊断为胶质瘤的患者。

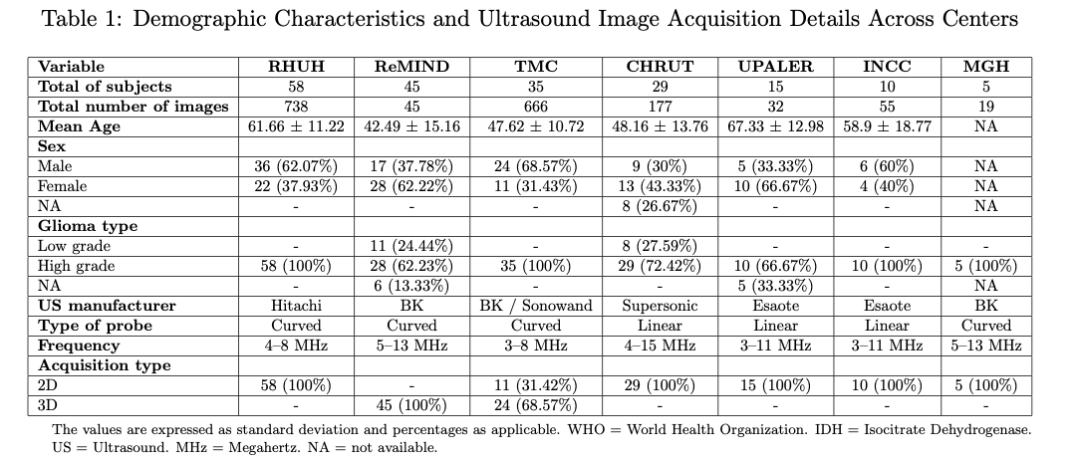

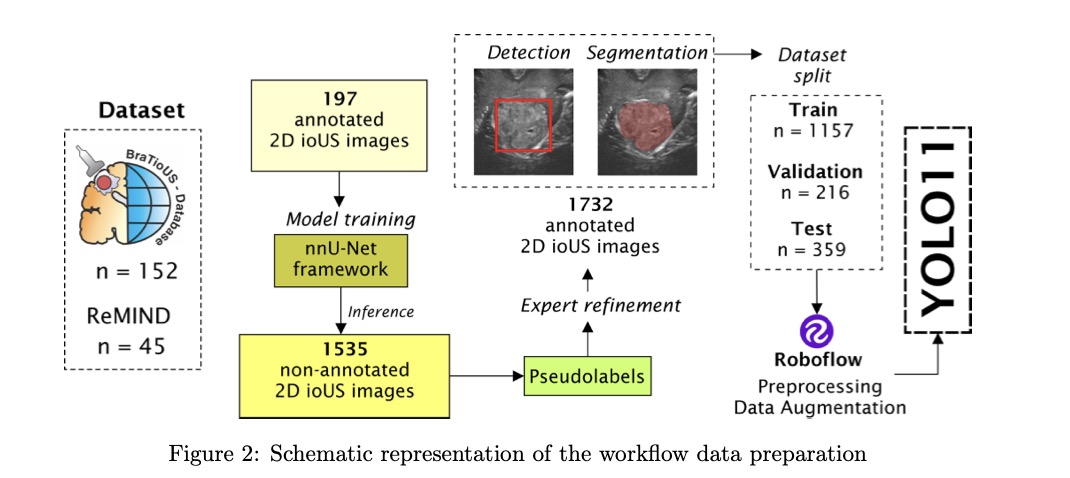

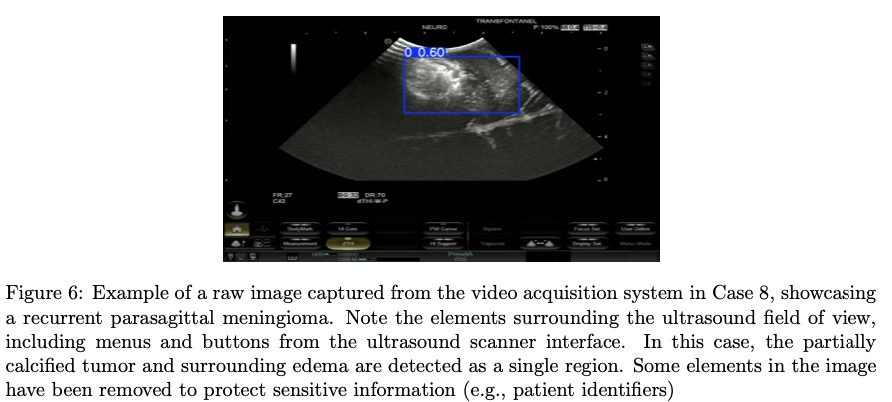

此外,还纳入了来自公开的ReMIND数据集的图像,并应用了相同的筛选标准。BraTioUS数据集包括154名患者,其中152名符合筛选标准。从ReMIND数据集中,从114名初始组中选择了45名患者。总共,数据集包括197名受试者,其中128名具有原始2D ioUS图像,69名具有3D图像。3D体素通过沿轴向平面提取切片进行处理,这些切片对应于数据数组的三维。每个切片都进行了调整,以保持空间方向和解剖一致性,从而生成一系列2D图像供进一步分析。最终数据集由1732张术中超声(ioUS)图像组成,因为每位贡献者从其2D ioUS研究中提供了多张图像。为了评估模型在手术室中的实时实现,在2024年11月至2025年1月期间,在Rio Hortega大学医院神经外科进行了一项前瞻性研究。将15名连续接受开颅手术进行脑肿瘤切除的患者纳入该研究阶段。在这些程序中对该系统进行了定性评估。表1总结了完整的数据集,而表2提供了前瞻性患者队列的详细信息。西班牙布尔戈斯Rio Hortega大学医院研究伦理委员会(CEIm)批准了匿名数据的使用。此外,前瞻性研究中包括的所有患者都签署了知情同意书。

-

真实标签分割

为了进行初始分割过程,为每位患者选择了代表2D轴向切片,总共197张图像。这些切片用于训练基于nnU-Net框架的初步分割模型,该模型由我们的小组先前开发和发表。使用ITK-SNAP软件(版本4.0.1,http://itksnap.org)手动分割了这些切片中的肿瘤,排除了广泛坏死或囊性区域。关于该初步模型的开发和验证的详细信息可以在相应的出版物中找到。使用训练好的模型,我们为数据集中剩余的1,535张图像生成了伪标签,这些图像缺乏手动分割。这种方法克服了手动标注所需的大量时间,并利用了初步模型的鲁棒性能。随后,由两名在ioUS成像和神经肿瘤学方面具有专业知识的神经外科医生审查和精炼了这些伪标签。任何分歧都通过协商解决。与初始模型不同,这些分割包括肿瘤的坏死和囊性区域,确保了肿瘤整个范围的表示。图像和标注都从NIfTI格式(神经影像信息学技术倡议)转换为JPG格式(联合摄影专家组)和TXT格式。这些转换对于满足YOLO11模型的格式要求是必要的。此外,还以实例分割和边界框格式生成了标签,以确保检测和分割过程的兼容性和灵活性。

四、YOLO11架构

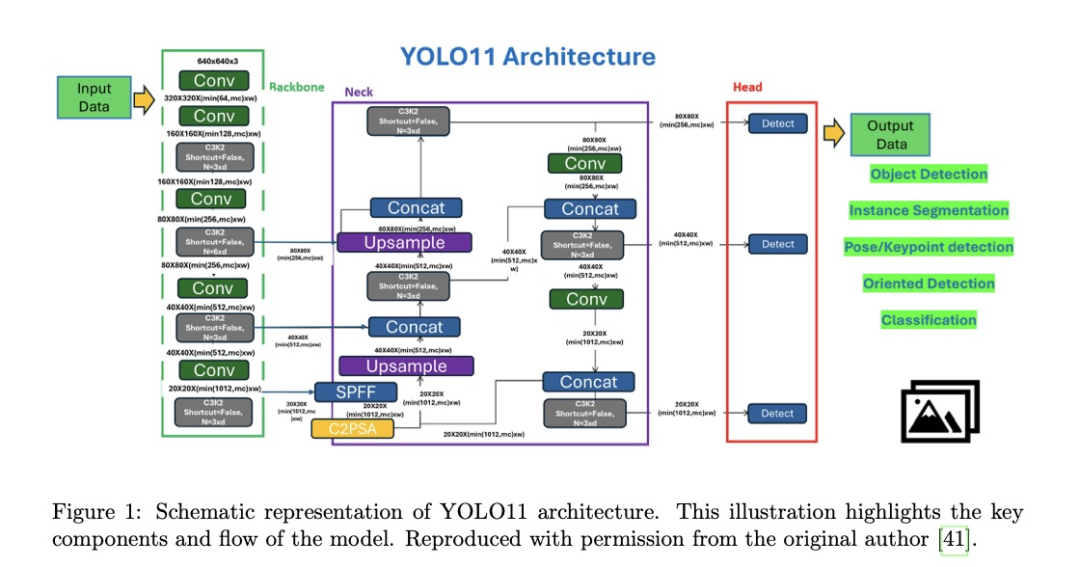

YOLO架构将图像划分为网格,预测每个单元的边界框和类概率,并实现端到端学习。YOLO架构由三个主要部分组成:骨干网络、颈部和头部。骨干网络作为主要特征提取器,使用卷积神经网络将原始图像转换为多个尺度的特征图,捕捉关键结构信息。颈部是中间处理阶段,添加并细化骨干网络提取的特征,使多个尺度为检测不同大小的物体做出贡献。最后,头部是预测组件,生成最终输出,包括边界框坐标、物体类别及其相关概率。图1展示了YOLO11架构的示意图。

-

YOLO11增强

YOLO11架构由Ultralytics开发,并在其前身的基础上进行了多项重要改进。

C3k2块: 替代了YOLOv8中的C2f块,使用两个较小的卷积核(kernel)代替一个大卷积核,在不牺牲性能的情况下提高了计算效率。

SPPF组件: 保留了YOLOv8中的SPPF(空间金字塔池化-快速)组件,该组件允许高效地聚合不同尺度的信息,优化了捕获与各种大小和位置的物体相关的特征的能力。

C2PSA模块: 新增了C2PSA(卷积块与并行空间注意力)模块,引入了并行空间注意力机制,使模型能够有效地关注图像的特定区域,提高了具有不同位置和大小的物体的精度。

CBS层: 包含卷积层、批量归一化层和SiLU(Sigmoid 线性单元)激活函数,这些层通过提取相关信息、归一化数据流并使用 SiLU 激活函数来细化特征图,SiLU 激活函数以结合精度和数值稳定性而闻名。

Conv2D层: 最后的Conv2D层将细化的特征减少到所需的输出数量,生成边界框坐标和类预测。

五、Coovally AI模型训练与应用平台

如果你也想要进行模型改进或模型训练,Coovally平台满足你的要求!

Coovally平台整合了国内外开源社区1000+模型算法和各类公开识别数据集,无论是YOLO系列模型还是MMDetection框架下的模型算法,平台全部包含,均可一键下载助力实验研究与产业应用。

而且在该平台上,无需配置环境、修改配置文件等繁琐操作,一键上传数据集,使用模型进行训练与结果预测,全程高速零代码!

具体操作步骤可参考:从YOLOv5到训练实战:易用性和扩展性的加强

平台链接:https://www.coovally.com

如果你想要另外的模型算法和数据集,欢迎后台或评论区留言,我们找到后会第一时间与您分享!

六、评估指标和实验环境

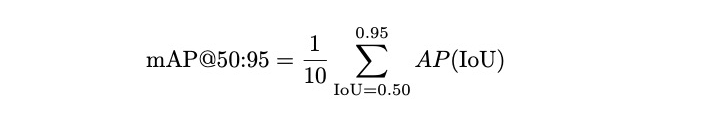

本节介绍了用于评估模型和衡量消耗的计算资源的指标。为了评估模型,我们使用了标准的指标,包括精确度、F1分数、召回率、mAP@50和 mAP@50-95,这些指标在检测任务中通常使用。这些指标能够评估模型在精确度和一致性方面检测物体的能力。在实例分割任务中,我们还添加了Dice相似系数(DSC)和Jaccard指数或交并比(IoU)等特定指标,这些指标对于测量预测与真实值之间的重叠程度至关重要。在计算资源方面,我们分析了模型大小、内存消耗、参数数量、每秒浮点运算次数(FLOPS)、乘加运算次数(MADD)、每秒帧数(FPS)和延迟等关键参数,以评估模型在实时应用中的可行性。

此外,我们还详细描述了实验环境的特征,包括所使用的硬件、操作系统、训练过程中模型的配置和超参数。最后,我们描述了数据预处理步骤;数据集的训练、验证和测试集划分;以及用于提高模型泛化能力的数据增强技术。

-

模型性能评估指标

为了全面评估模型的能力,我们使用了各种指标。在主要的目标检测任务中,我们使用了精确度,定义为模型做出的正确正类预测数量占总正类预测数量的比例。该指标对于确定模型最小化误报的能力至关重要,确保检测的相关性和准确性。

TP:正确识别的正类案例数量。FP:错误识别为正类的负类案例数量。

AP在IoU=0.50、0.55、0.60、…、0.95时进行计算,结果是平均值。对于本工作的第二个任务,实例分割,我们添加了重叠指标:Jaccard指数衡量两个集合交集面积与并集面积之比,用于评估目标检测或分割。

交集(Intersection):预测区域和真实值区域之间的公共区域。

并集(Union):预测区域和真实值区域面积之和减去交集面积。

DSC衡量两个集合之间的相似度,通常用于评估分割区域 (预测) 和真实区域之间的重叠程度。

-

计算效率指标

为了评估开发的检测模型的计算效率,我们分析了各种指标,以表征其在存储、资源消耗和处理能力方面的性能。模型大小(size)指的是模型存储在磁盘上所需的空间,通常以兆字节(MB)表示,这对于具有存储限制的系统是一个关键因素。内存(memory)衡量推理过程中消耗的RAM或VRAM量,这对于资源有限的设备尤为重要。参数数量(parameters)反映模型中可训练权重的数量,是模型复杂性和学习详细表示能力的直接指标。为了衡量计算负载,我们使用了每秒浮点运算次数(FLOPS)和乘加运算次数(MADD)等指标,这些指标允许根据数学处理效率评估模型。此外,我们还分析了与实时性能相关的指标,例如每秒帧数(FPS)和延迟(latency)。FPS测量每秒处理的图像数量,而延迟是指处理单个图像所需的时间,以毫秒(ms)表示。这些指标对于确定模型在响应时间至关重要的应用中的可行性至关重要,例如在手术环境中。

-

实验环境

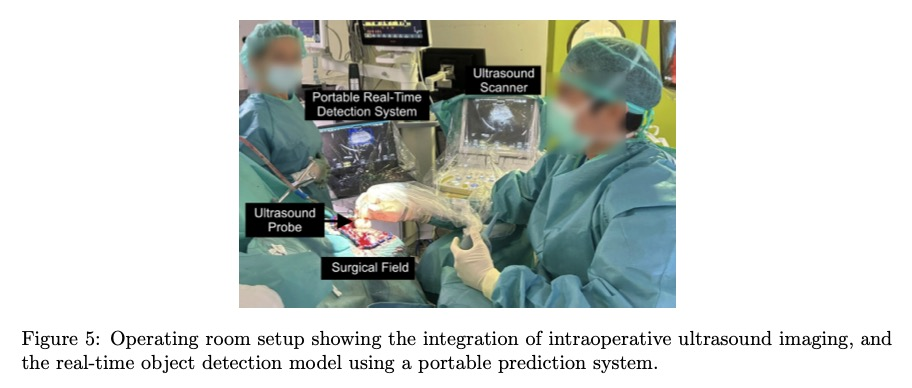

模型在Linux Ubuntu 24.04.1 LTS操作系统上进行训练,使用Python 3.10作为编程语言。为了实现和训练模型,我们使用了深度学习框架 PyTorch 2.5.1,并结合CUDA 12.4和CuDNN 9.5.1,利用GPU加速。所使用的硬件包括AMD Ryzen 9处理器和具有16 GB内存和32 GB RAM的RTX 4080 GPU,确保了进行密集训练任务的高性能环境。对于测试数据集的评估、前瞻性评估以及在手术室中的实时实现,我们使用了运行Windows 10操作系统的笔记本电脑,并具有以下软件配置:Python 3.10、PyTorch 2.5.1、CUDA 12.1和CuDNN 9.1.0。在这种情况下,硬件由Intel Core i7处理器、具有8 GB内存和32 GB RAM的RTX 3070 GPU组成,为在临床条件和实时应用中进行测试提供了合适的环境。

七、实验结果

这项工作的主要目的是通过术中超声成像开发脑肿瘤物体检测模型,并通过训练有素的模型评估其在真实手术环境中的实时实施情况。作为次要目标,还开发了一个实例分割模型来补充分析。此外,还对所有YOLO11变体与预训练模型的权重一起使用时获得的结果进行了详尽的比较,以确定精度与计算资源消耗之间的最佳平衡,这是保证其在临床环境中适用性的基本方面。

-

目标检测任务

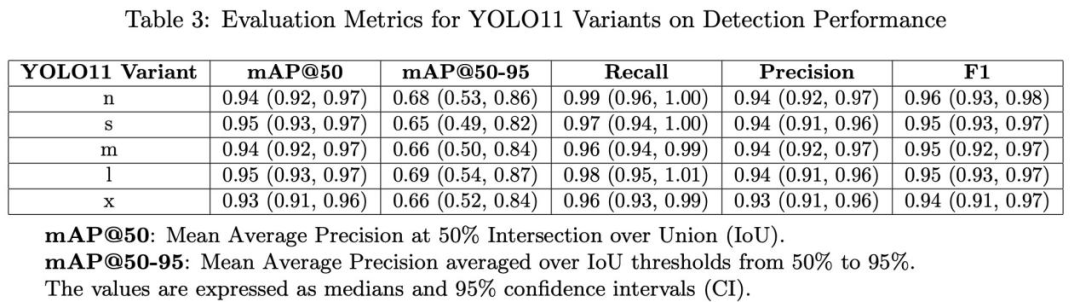

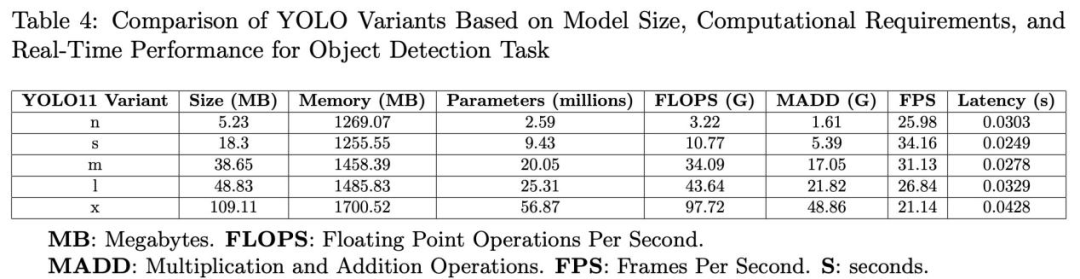

表3和表4总结了YOLO11不同变体的检测指标和计算要求。YOLO11的变体在目标检测任务中在大小、效率和精度之间取得了平衡。

n版本是最轻的,具有5.23MB的大小和259万个参数,达到了mAP@50为0.94和mAP@50-95为0.68,延迟为30.3ms,速度为25.98FPS。

s版本增加了参数数量到943万个,并减少了延迟到24.9ms,同时保持了mAP@50为0.95和mAP@50-95为0.65。

m和l版本逐步增加大小和复杂性,分别具有2005万和2531万个参数,保持了mAP@50为0.94和0.95,mAP@50-95为0.66和0.69,延迟为27.8ms和32.9ms。

x版本最强大,具有56.87百万个参数,mAP@50为0.93,mAP@50-95为0.66,延迟为42.8ms,速度为21.14FPS。

在精度方面,所有变体都保持了高水平,召回率和精度值都高于0.93,F1分数接近0.95。这些结果表明,尽管更高级的版本在某些方面有所改进,但较轻的版本提供了令人瞩目的性能,且计算要求较低,可以根据应用程序的具体需求进行适当选择。

-

实例分割任务

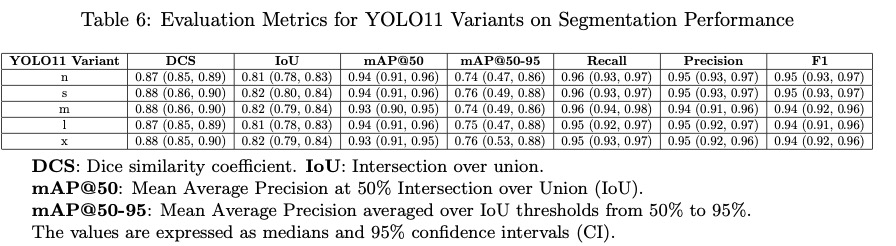

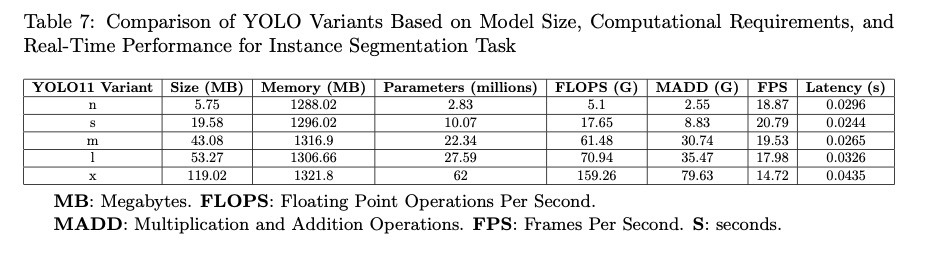

表6和表7总结了YOLO11不同变体的分割指标和计算要求。在性能和计算效率之间取得了平衡。

较轻的变体,如YOLO11n,具有较小的尺寸(5.75 MB)、较少的内存使用(1288.02 MB)和283万个参数,在Dice(0.87)和IoU(0.81)等指标上表现出色。该版本的平均精度(mAP@50和mAP@50-95)达到0.94和0.74,延迟时间为29.6ms,速度为18.87FPS。

更强大的版本,如YOLO11x,显示出更高的计算要求,具有6200万个参数和1321.8MB的内存消耗,但在关键指标上具有相似的性能:Dice(0.88),IoU(0.82),mAP@50(0.93)和mAP@50-95(0.76),尽管延迟时间更高(43.5ms)和速度更低(14.72FPS)。

中间版本,如YOLO11s和YOLO11m,在精度和效率之间提供了最佳平衡,具有一致的指标(mAP@50 0.94,mAP@50-95 0.75)和适中的延迟(~26ms)。

这些结果表明,尽管更高级的变体提供了更高的能力,但较轻的变体保持了具有竞争力的性能,且硬件要求较低,允许它们适应不同的场景和应用。

-

手术室模型实施

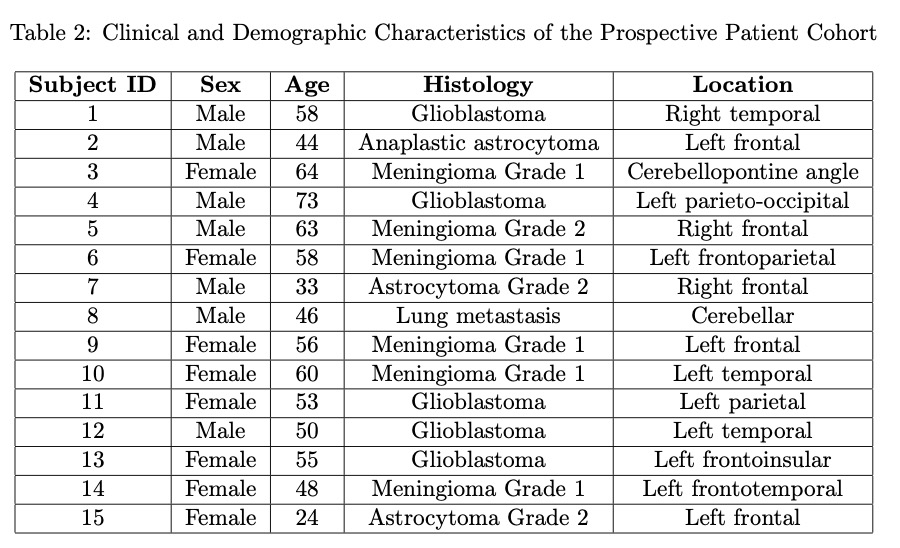

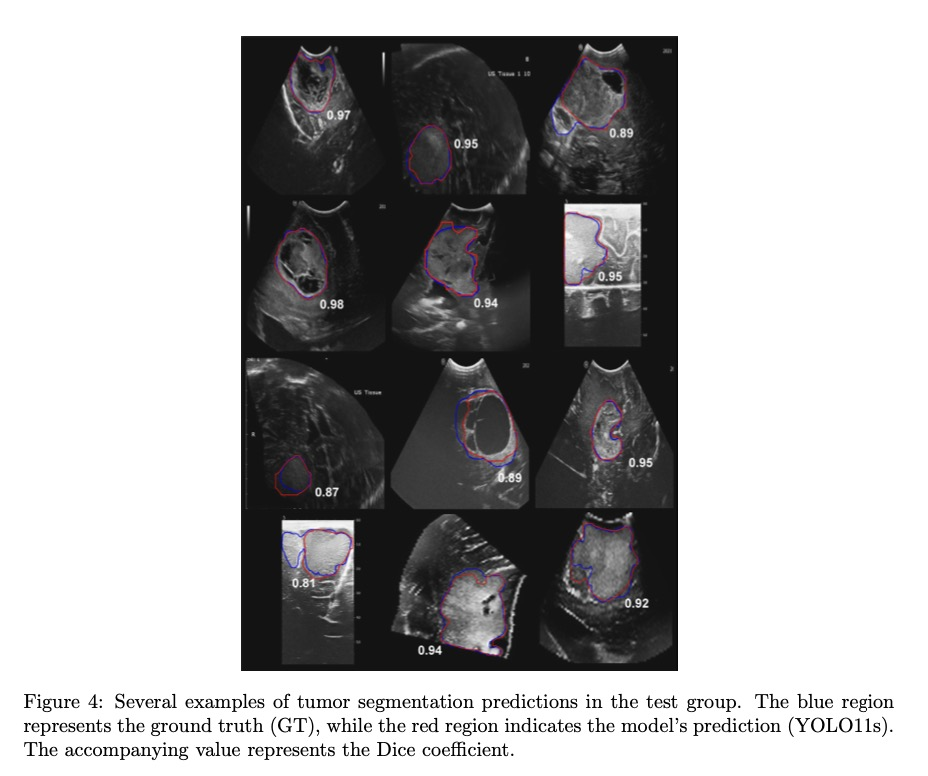

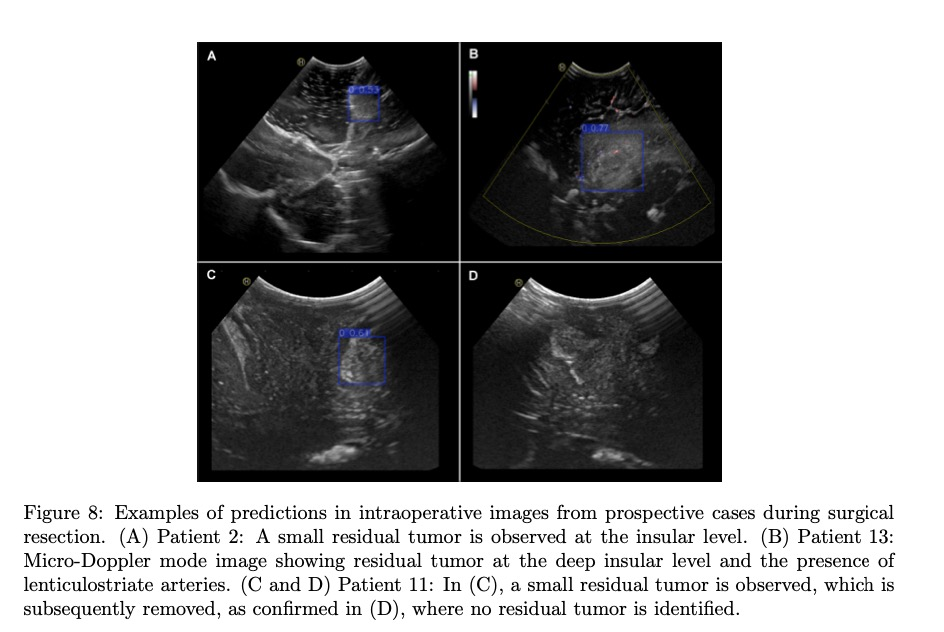

表2总结了15名接受手术的患者特征。由于其在精度、速度和计算效率之间的最佳平衡,YOLO11s模型被选为手术室实施。该模型具有18.3 MB的大小和943万个参数,延迟为24.9 ms,速度为34.16 FPS,保证了手术过程中的连续流动,没有中断。此外,它保持了高水平的精度(mAP@50为0.95,mAP@50-95为0.65),与更复杂的模型相当,但硬件要求较低。这些属性使其成为系统配置的理想选择。参与手术的神经外科医生(RS、SC、OE-S)对模型的结果进行了定性评估。在所有情况下,模型都能成功执行,生成的预测都被观察者认为是正确的。在低级别胶质瘤的情况下,模型生成的边界框正确地覆盖了整个肿瘤区域,反映了这些肿瘤的超声特征。在高级别胶质瘤的情况下,边界框准确地划定了肿瘤核心,排除了周围具有回声改变的病变区域,例如水肿或非增强组织。值得注意的是,尽管训练数据集中没有其他组织学类型的图像,但模型成功地检测到诊断为脑膜瘤的患者中的肿瘤。

然而,在患者9和10中,边界框包含了肿瘤和周围的水肿,突出了这种特定肿瘤类型在区分这些区域方面的局限性。在患者2、11和13中,使用手术切除期间获得的图像评估了模型检测残留肿瘤的能力。在患者2中,模型识别出岛叶的一个小残留肿瘤(图8A)。对于患者13,尽管使用了微多普勒模式,该模式未被包含在训练数据集中,但模型成功地检测到深部岛叶区域的残留肿瘤,该区域邻近豆纹动脉(图8B)。尽管这些类型的图像通常包含手术相关的伪影,例如血液、止血剂和空气,但模型即使在手术腔存在的情况下也能准确地识别肿瘤区域。在患者11中,在完成切除后进行了一次超声图像采集,此时外科医生观察到没有可见的宏观肿瘤。然而,模型在手术腔的一个角落检测到一个小的残留肿瘤区域(图8C)。经进一步检查,外科医生确认这确实是一个不慎残留的肿瘤。切除残余肿瘤后进行的另一次超声图像采集证实了没有残余组织,因为外科医生进行了验证,模型也没有检测到任何肿瘤(图8D)。这些发现强调了该模型在改善术中检测和最大程度切除肿瘤方面的潜在作用。

八、讨论

本研究的主要目标是训练和评估一个实时脑肿瘤检测模型,并验证其在手术室中的直接应用。据我们所知,这是第一个将术中目标检测模型应用于脑肿瘤手术的研究。我们方法的优势和创新性主要体现在以下几个方面:

-

强调目标检测而非分割:这与先前的研究不同,并与特定的临床需求相符,其中像素级精度不那么关键,而快速、直接的目标检测更为重要。

-

高质量的原始2D图像数据集:与先前研究中常用的3D体积或从公共数据集中转换的2D图像相比,这是一个显著的优势。数据集通过数据增强技术扩展到 11,570张图像,代表了脑肿瘤和术中超声领域前所未有的样本量,显著提高了模型对真实临床场景的泛化能力。

-

YOLO11架构:首次使用专门针对实时手术应用进行优化的YOLO11架构,该架构在精度和计算效率方面取得了平衡。

-

仅依赖2D超声图像:两种模型都仅依赖2D超声图像,无需与术前磁共振图像、预定义分割或人工干预进行配准或融合。这种自主和简化的方法简化了临床实施,并突出了模型在动态手术环境中通过提供精度和效率来变革术中脑肿瘤管理的潜力。

-

未来方向

尽管我们的工作具有创新性,但仍有可能进行改进和扩展。尽管YOLO11 在此和其他领域表现出非凡的效率,但探索其他可能提供更高性能或更好地适应术中超声图像特定特征的架构或修改仍然很重要。一个可能的改进方向是不仅注释肿瘤区域,还注释周围区域(水肿)和其他脑解剖结构,例如脑室和大脑镰。这可以进一步提高图像的可解释性,并提供更丰富的解剖学背景,从而促进模型在手术实践中的整合。另一个有前景的方向是在训练中包括在肿瘤切除过程中获得的图像,特别强调小型肿瘤残留物。这可以显着提高模型作为辅助工具的实用性,以实现更好的切除程度,尤其是在可能被肉眼忽视残余肿瘤的情况下。最后,在其他中心实施并前瞻性地验证模型,涉及来自不同机构的神经外科团队和来自不同制造商的超声波设备,这对于评估其在各种临床环境中的泛化性和鲁棒性至关重要。这些改进和验证可以扩大我们工作的范围和应用,将其巩固为术中超声辅助手术的一个多才多艺且有效的工具。

九、结论

术中超声波作为一种成像方式在脑肿瘤手术中发挥着至关重要的作用,通过整合计算机视觉技术可以显著改善超声波的优化效果。这些工具有可能有助于在手术过程中更好地解读图像和精确定位肿瘤。在这项研究中,我们使用YOLO11架构训练了一个脑肿瘤检测模型。结果表明,该模型在准确性和计算效率方面表现出色,这是其实时应用的基本方面。该模型在手术室的成功应用证实了它作为一种实用而强大的工具的可行性,在优化这类肿瘤的手术方面具有巨大的潜力。这项工作为开发先进的手术支持系统奠定了基础,该系统可改善临床效果并促进神经外科团队的工作。