ollama

Ollama 是一款本地大模型运行框架,旨在帮助用户在无需云服务的情况下,利用个人设备部署并运行各种大模型。相比于依赖云计算资源,Ollama 能够直接在本地实现大模型推理,适合那些对数据隐私要求较高的场景,如医疗、金融或企业内部数据处理。

点击download后

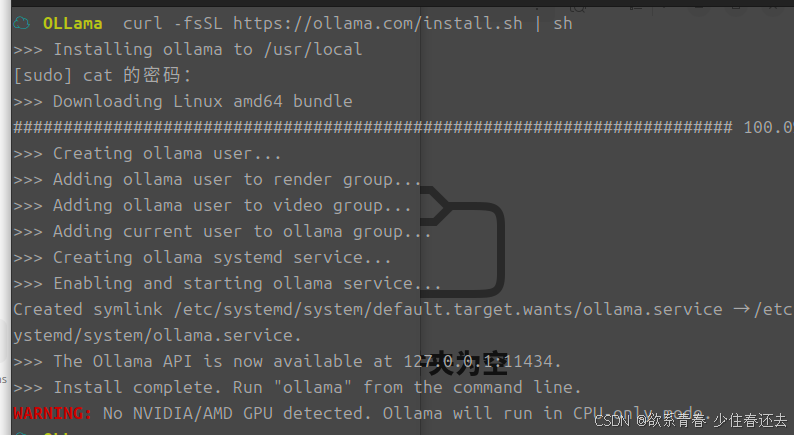

复制下面命令 终端执行即可

安装完成后我们访问127.0.0.1:11434

此时他已经运行

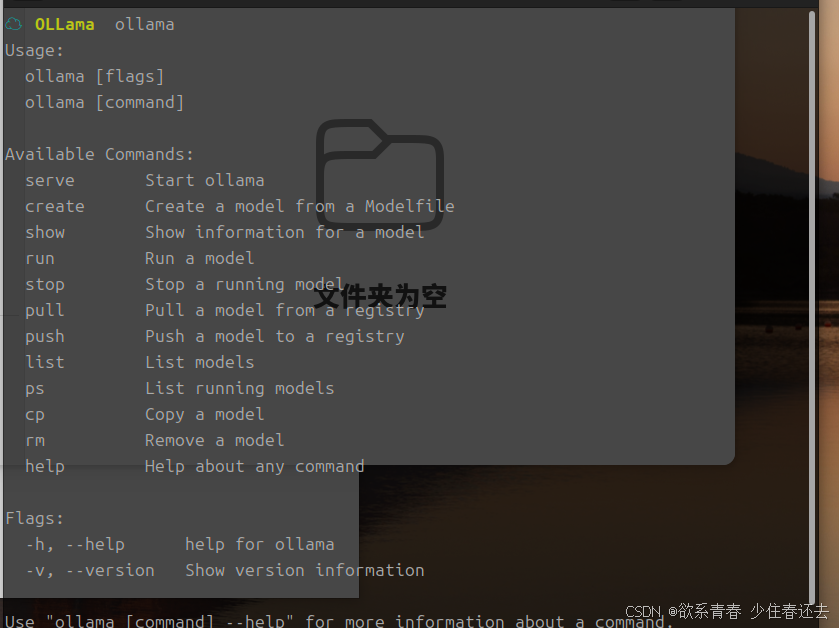

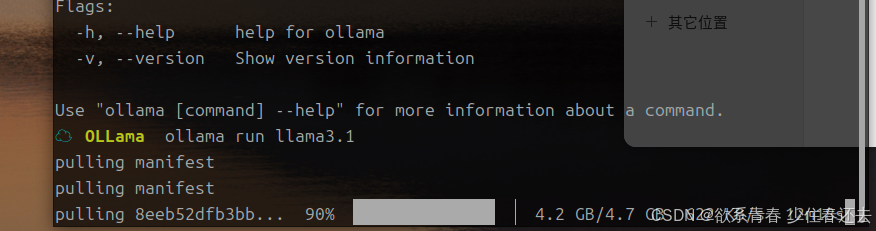

命令行输入ollama 会看到参数和用法

ollama list 查看本地安装的大模型

现在需要选择模型了我这里选择的是

直接复制蓝色的代码

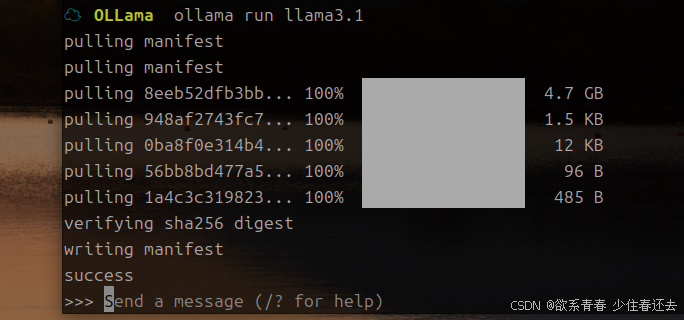

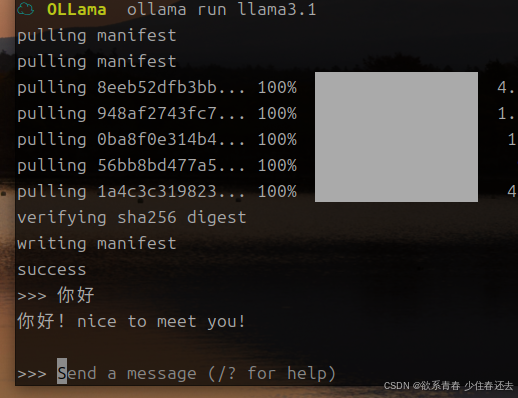

完成

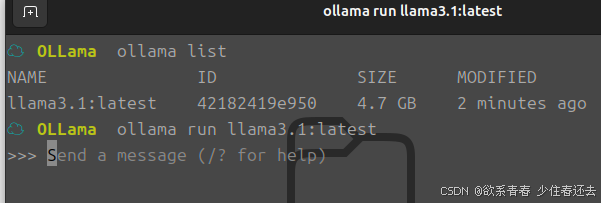

ollama list 查看模型

ollama run 模型名字

ollama rm 删除模型

docker

安装

开机自启动 和启动docker

创建docker组 并将当前用户加入docker组

重启一下

MaxKB

MaxKB - 基于大语言模型和 RAG 的知识库问答系统 - 官网

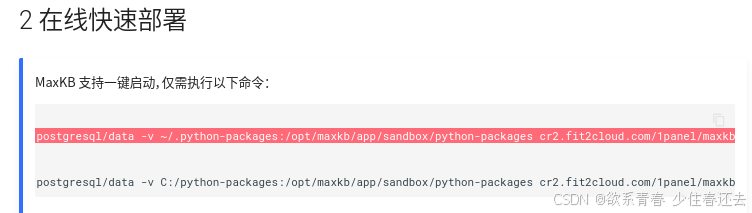

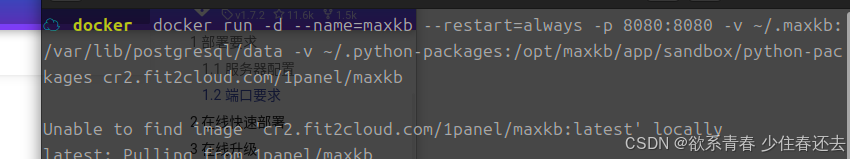

运行在线部署

完成后就访问8080端口

账号密码admin MaxKB@123..

进去后需要修改密码

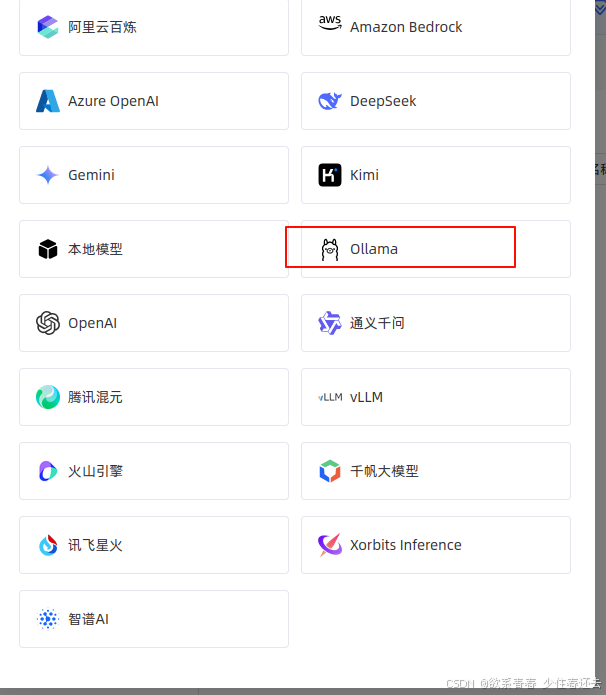

首先需要

可以直接复制ollama list中name字段