模型简介

Video-Retalking 模型是一种基于深度学习的视频再谈话技术,它通过分析视频中的音频和图像信息,实现视频角色口型、表情乃至肢体动作的精准控制与合成。这一技术的实现依赖于强大的技术架构和核心算法,特别是生成对抗网络(GAN)等先进算法的应用。

一、在算家云搭建

1.选择模型实例

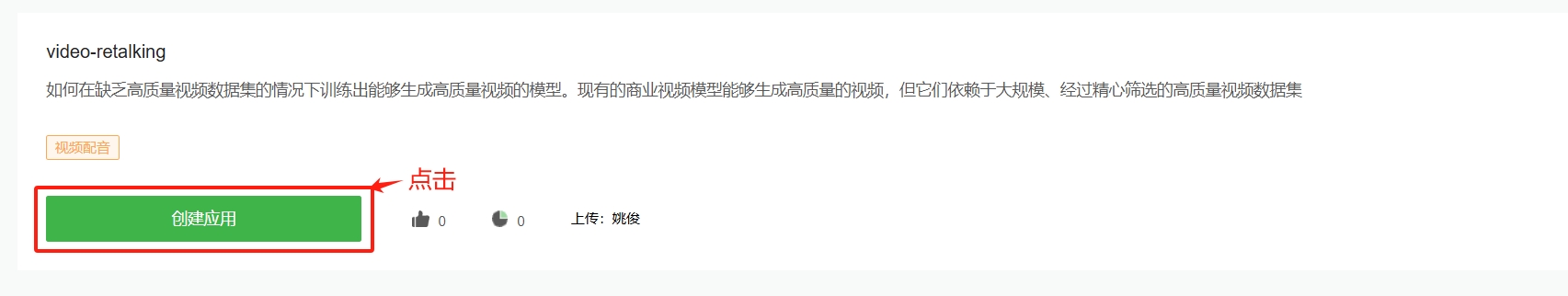

在应用社区中搜索或找到“video-retalking”模型

或者在“视频生成”选项功能中单击选择“视频配音”

2.创建模型实例

在video-retalking模型界面页面中单击“创建应用”

选择GPU资源项选择RTX 3090后单击”立即创建“

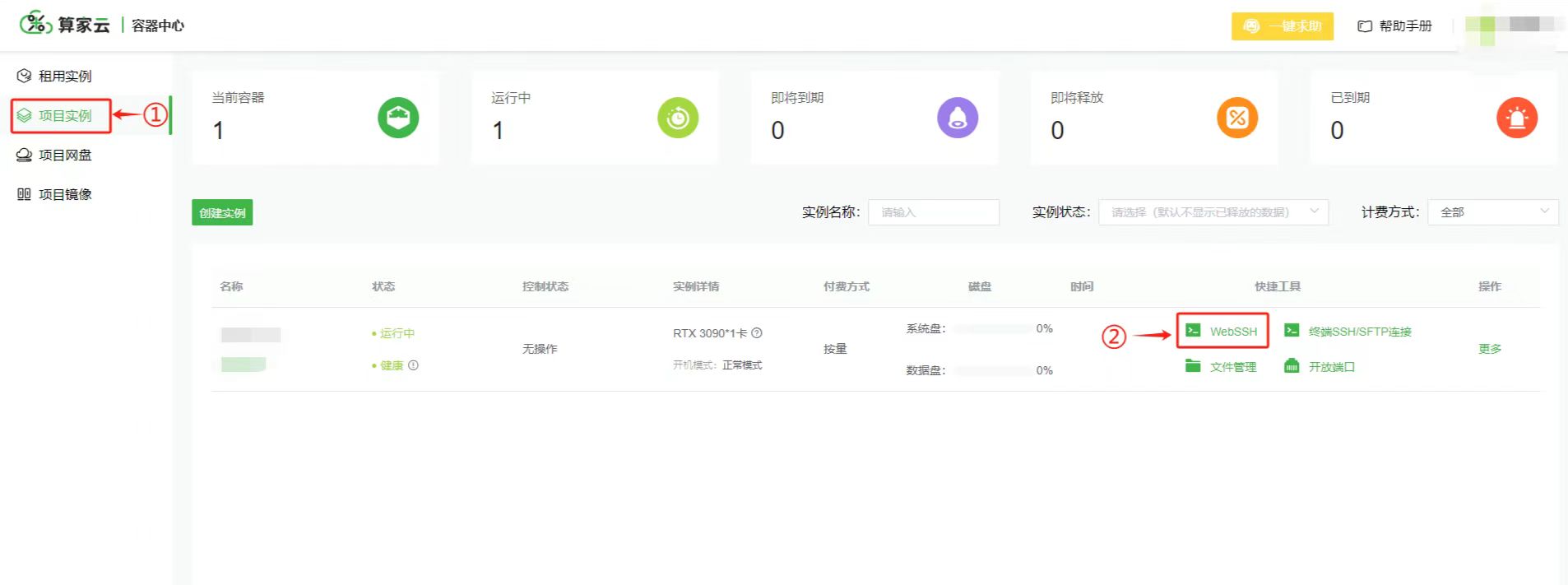

3.使用模型

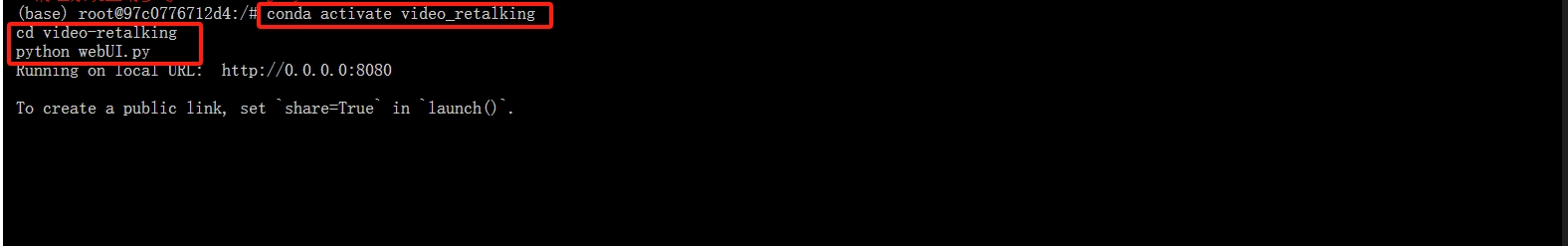

单击webSSH进入终端:

使用下列命令运行项目

conda activate video_retalking

cd video-retalking

python webUI.py

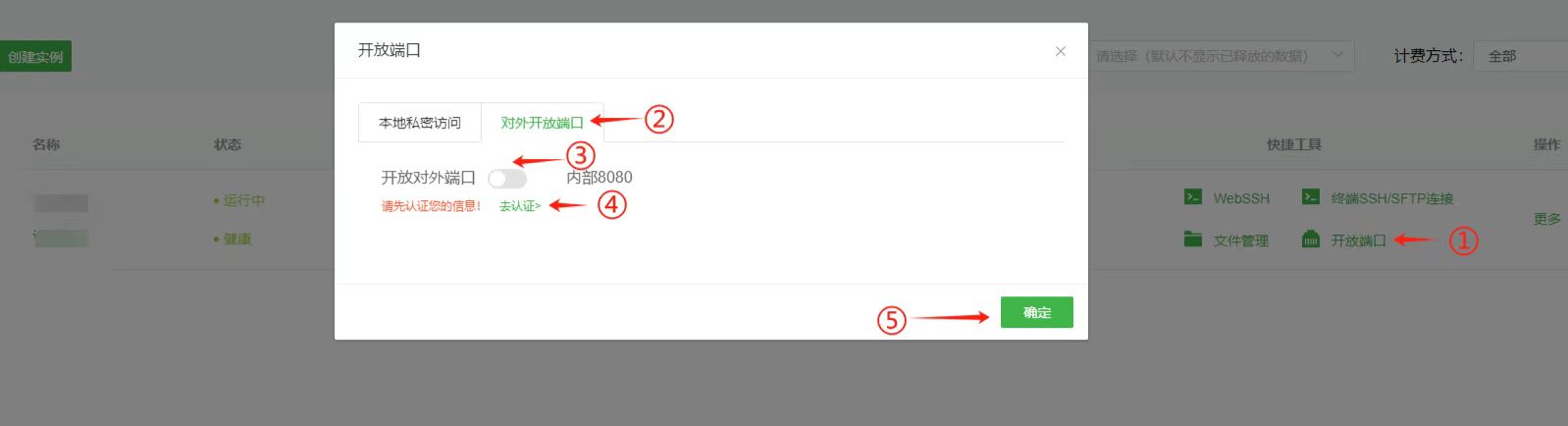

返回项目实例页面点击video-retalking项目开放端口

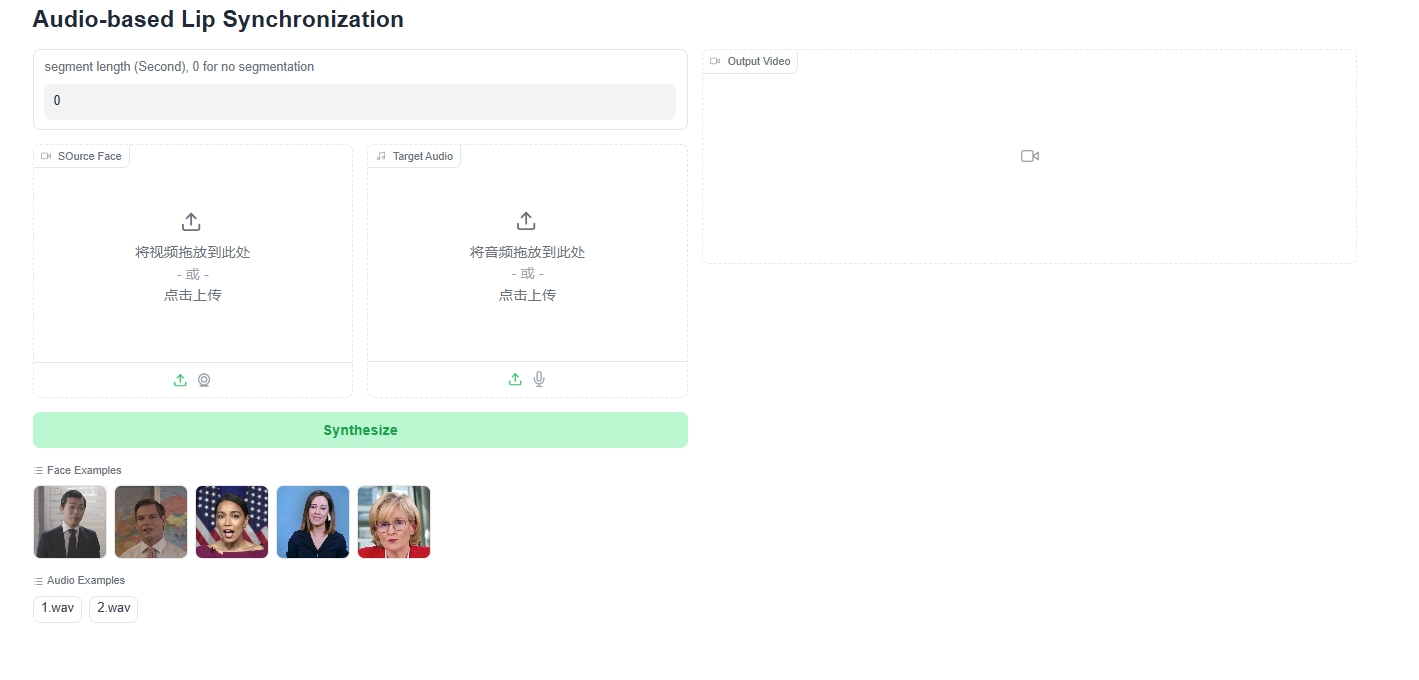

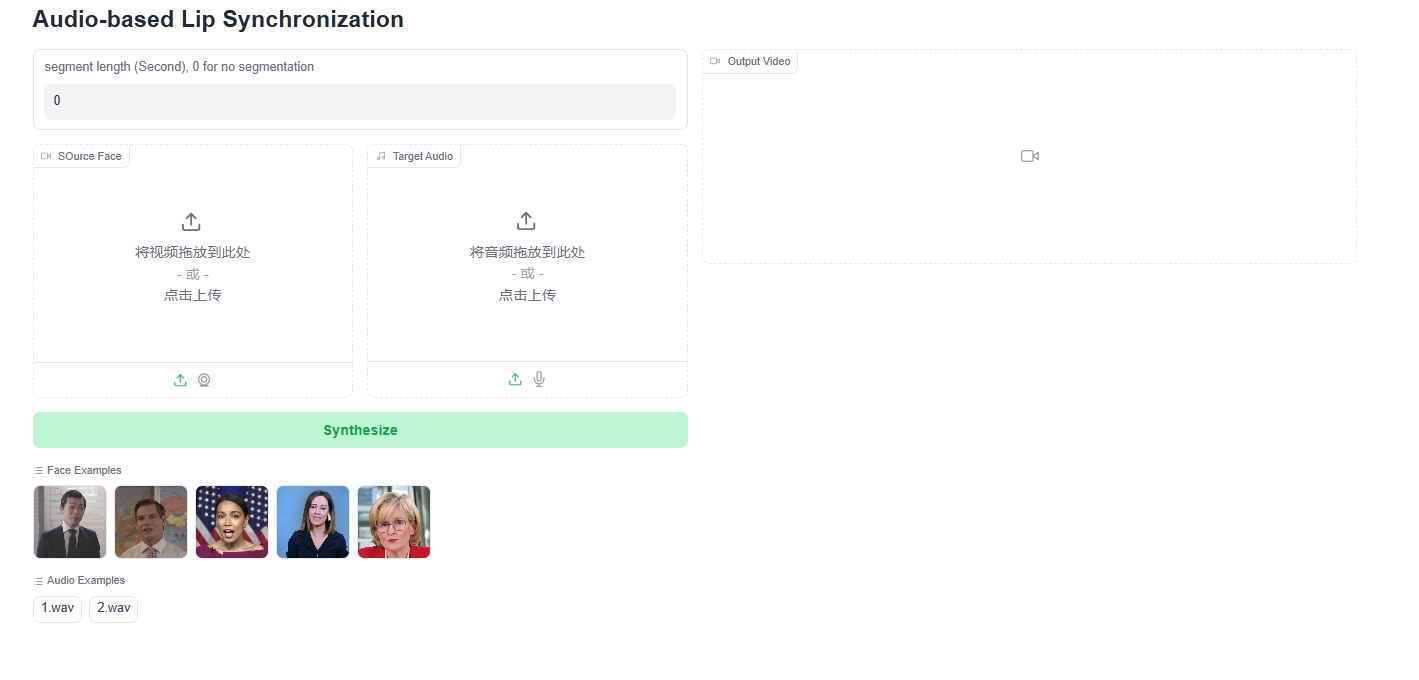

打开一个新的网页,将得到网址进行粘贴,模型界面成功打开:

二、本地部署教程

系统:Ubuntu22.04 系统,显卡:3090,显存:24G

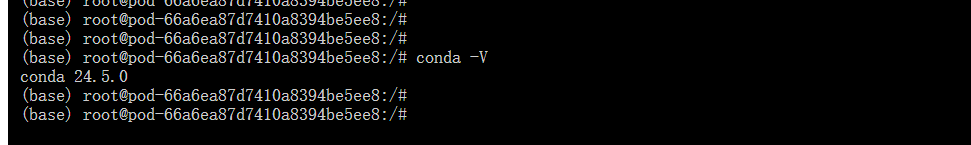

1.查看系统是否有 Miniconda3 的虚拟环境

conda -V

如果输入命令没有显示 Conda 版本号,则需要安装。

安装教程可查看:

2.更新系统命令

输入下列命令将系统更新及系统缺失命令下载

apt-get update

apt-get upgrade

apt-get install -y vim wget unzip lsof net-tools openssh-server git git-lfs gcc cmake build-essential

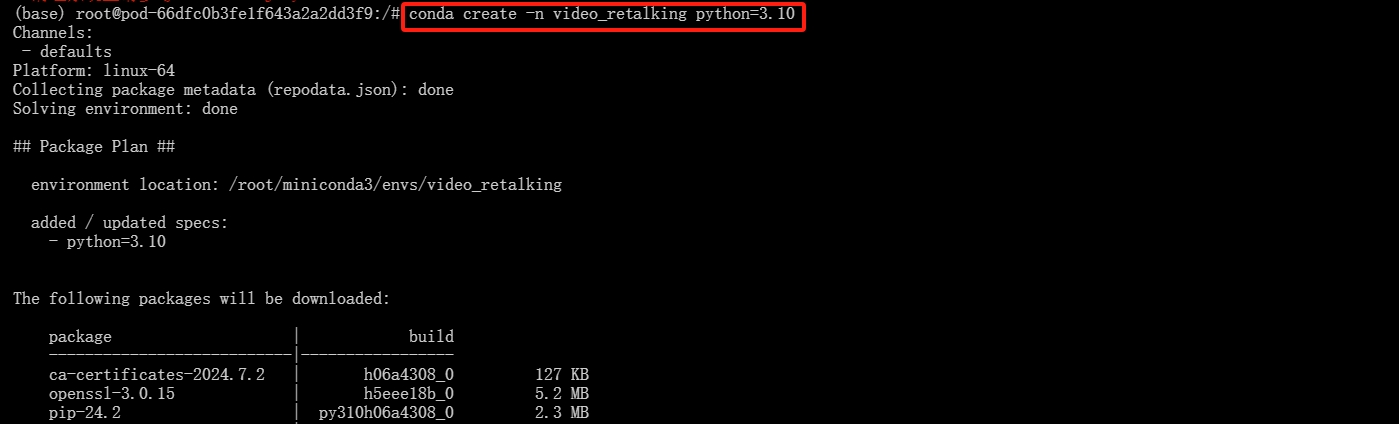

3.创建虚拟 Python 环境

- 创建一个名为"Video-Retalking"的虚拟镜像,python 版本为 3.10

conda create -n video_retalking python=3.10

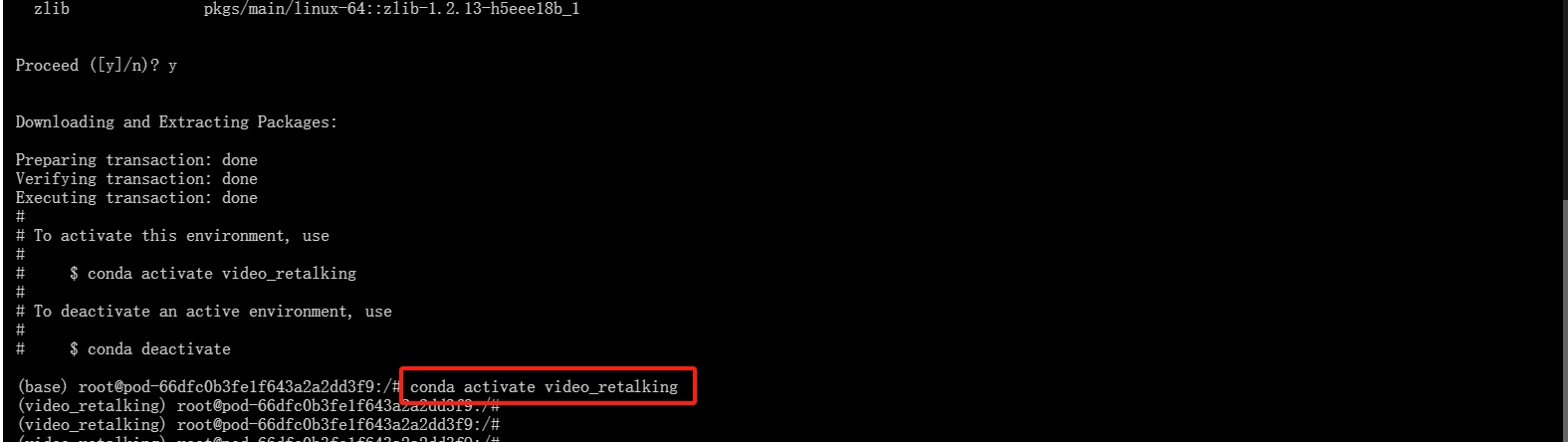

- 进入"video_retalking"虚拟环境

conda activate video_retalking

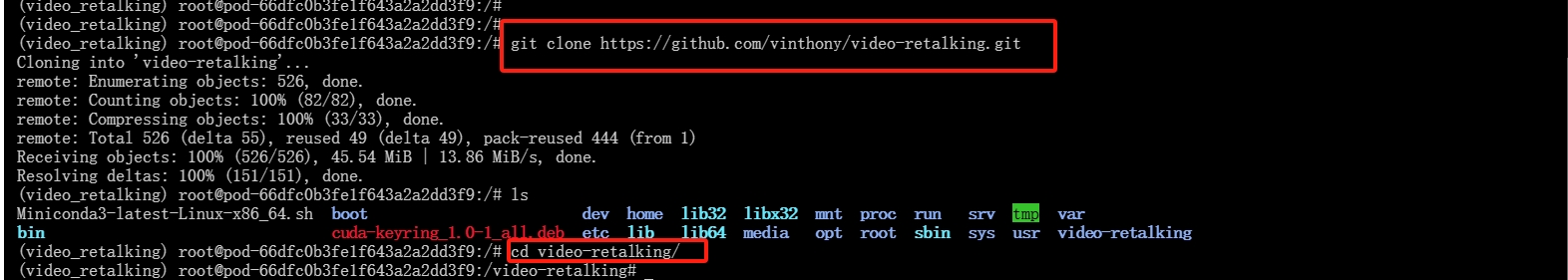

4.下载模型

输入下列命令对 video_retalking 模型进行下载

git clone https://gitclone.com/github.com/AILab-CVC/VideoCrafter.gitls

cd VideoCrafter

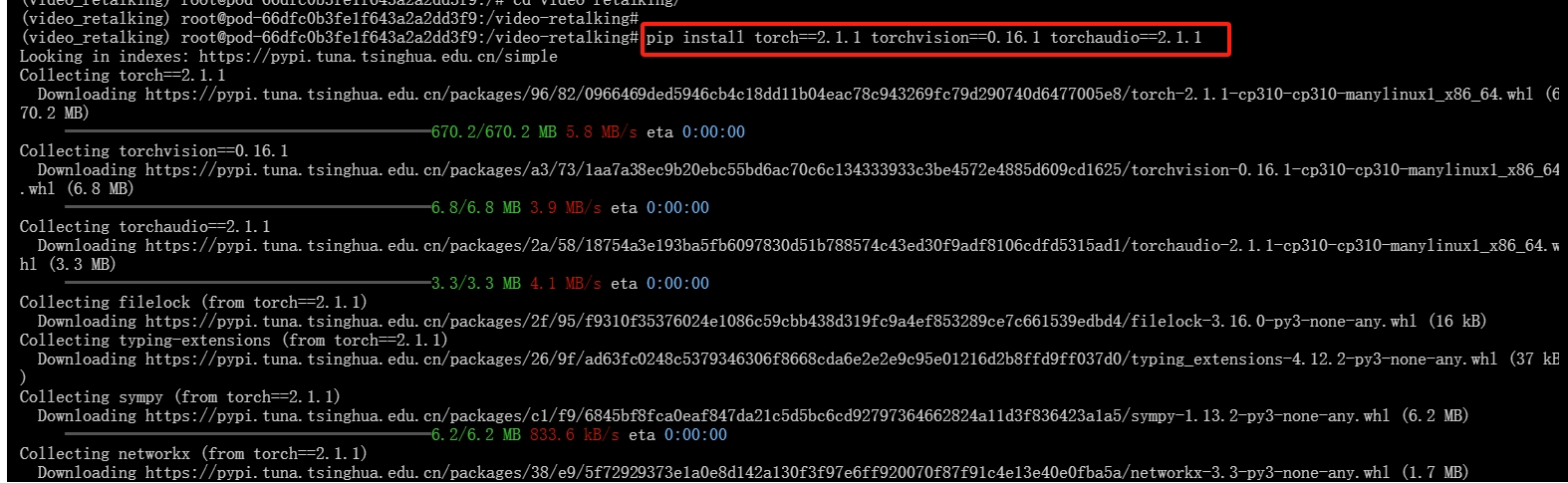

5.下载 pytorch

输入下列命令:

pip install torch==2.1.1 torchvision==0.16.1 torchaudio==2.1.1

耐心等待直到”Successfully“出现:

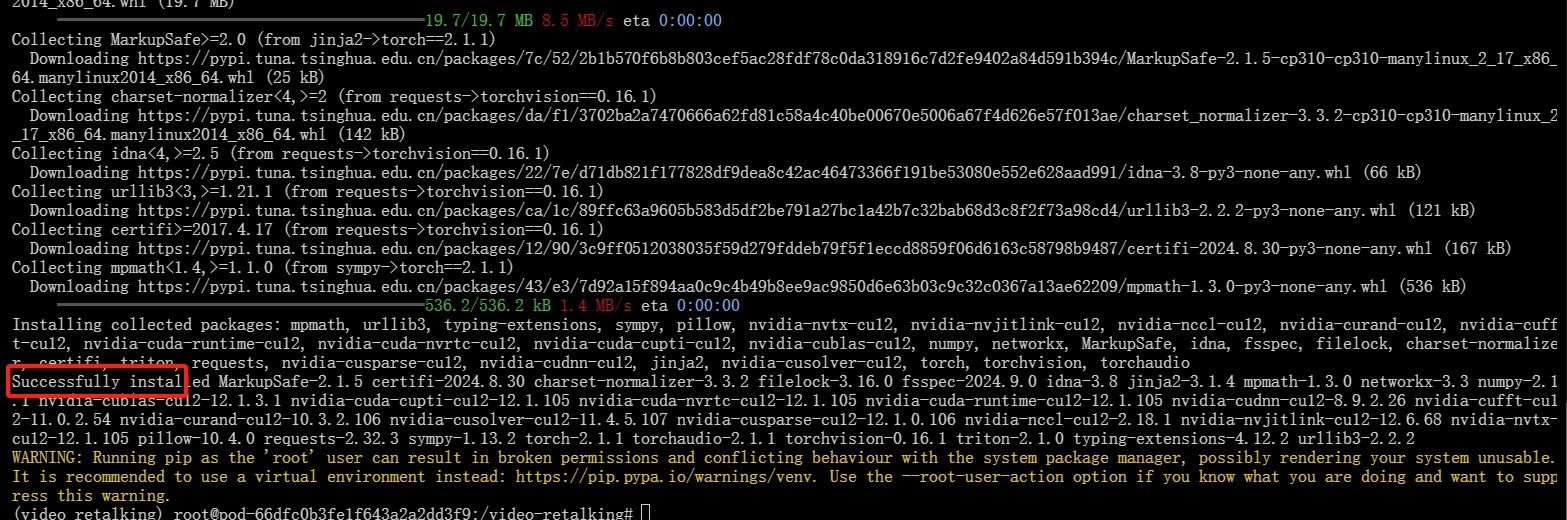

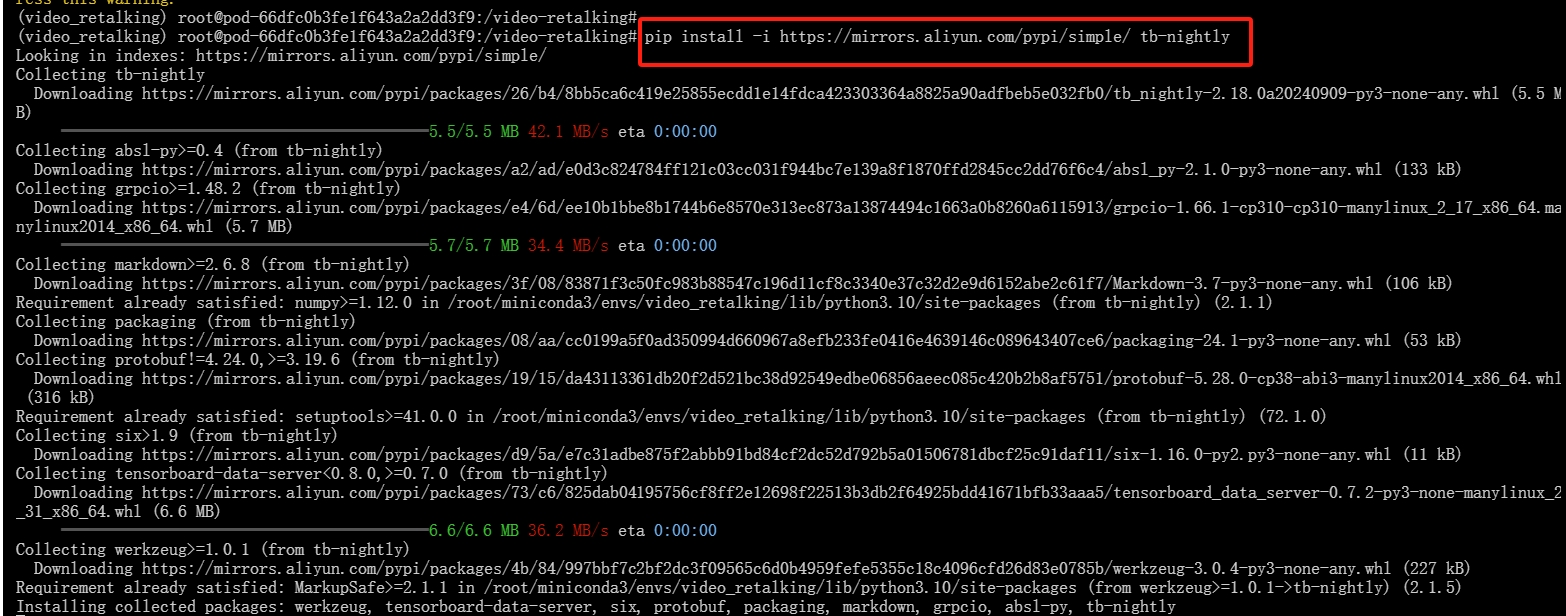

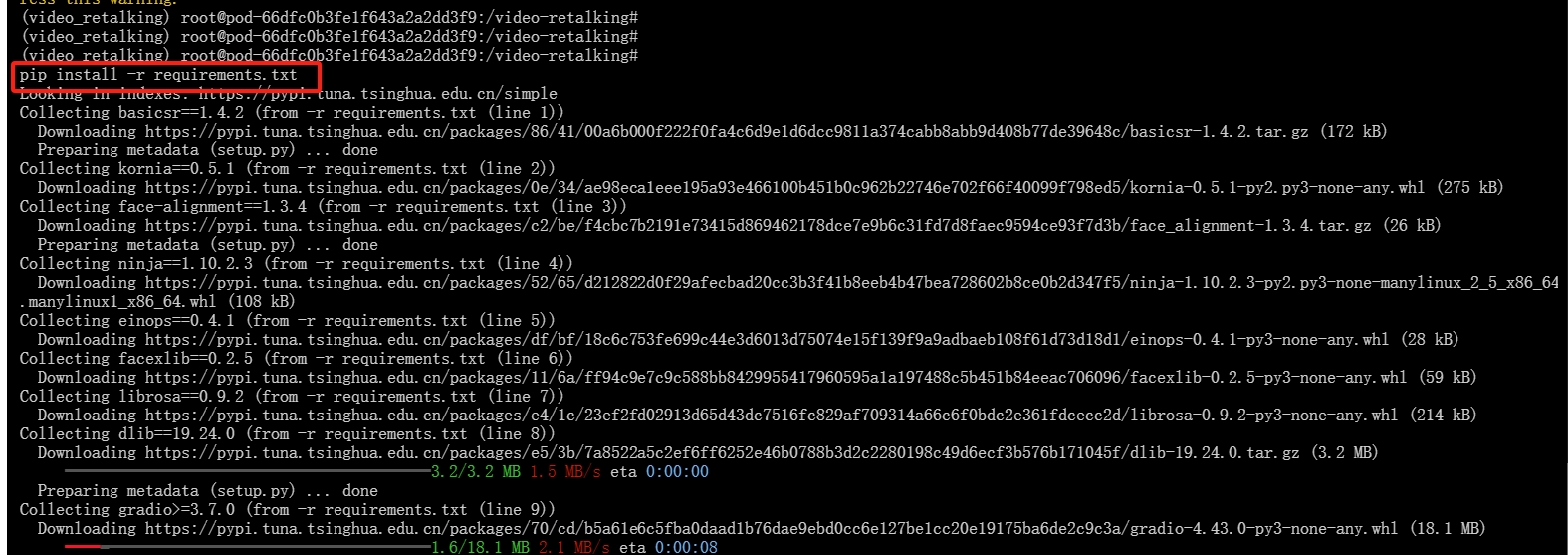

6.下载模型依赖包

先输入下载 tb-nightly 包避免下载其他依赖包报错:

pip install tb-nightly -i https://mirrors.aliyun.com/pypi/simple

再输入下列命令:

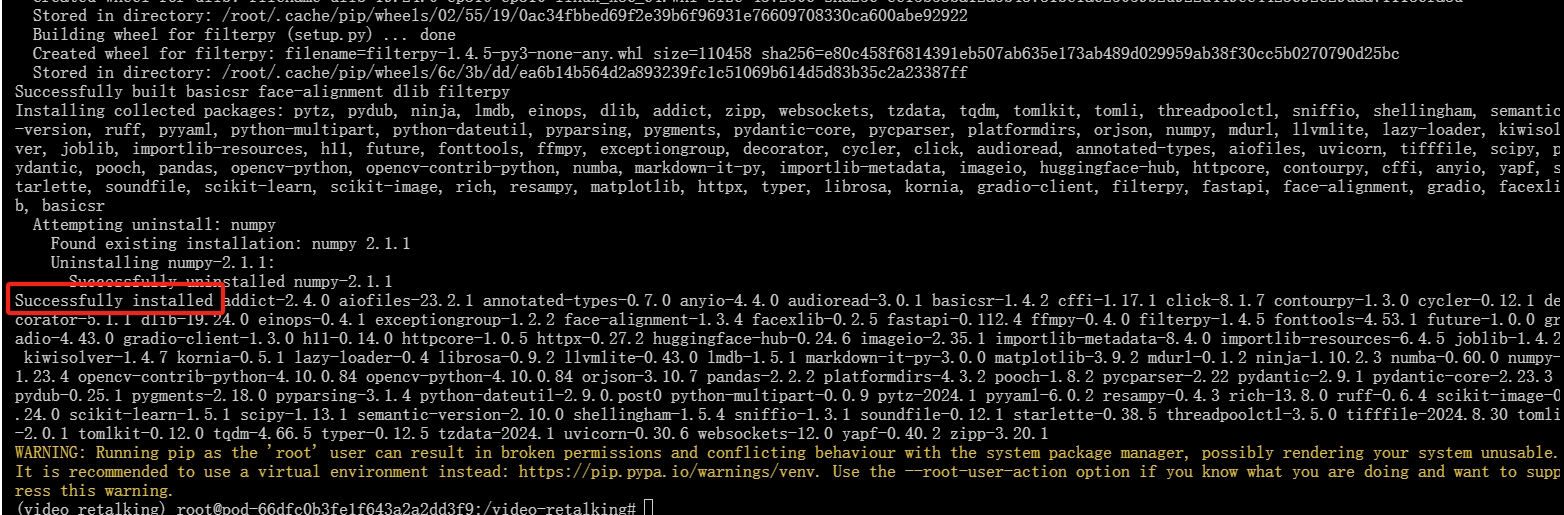

pip install -r requirements.txt

耐心等待直到”Successfully“出现

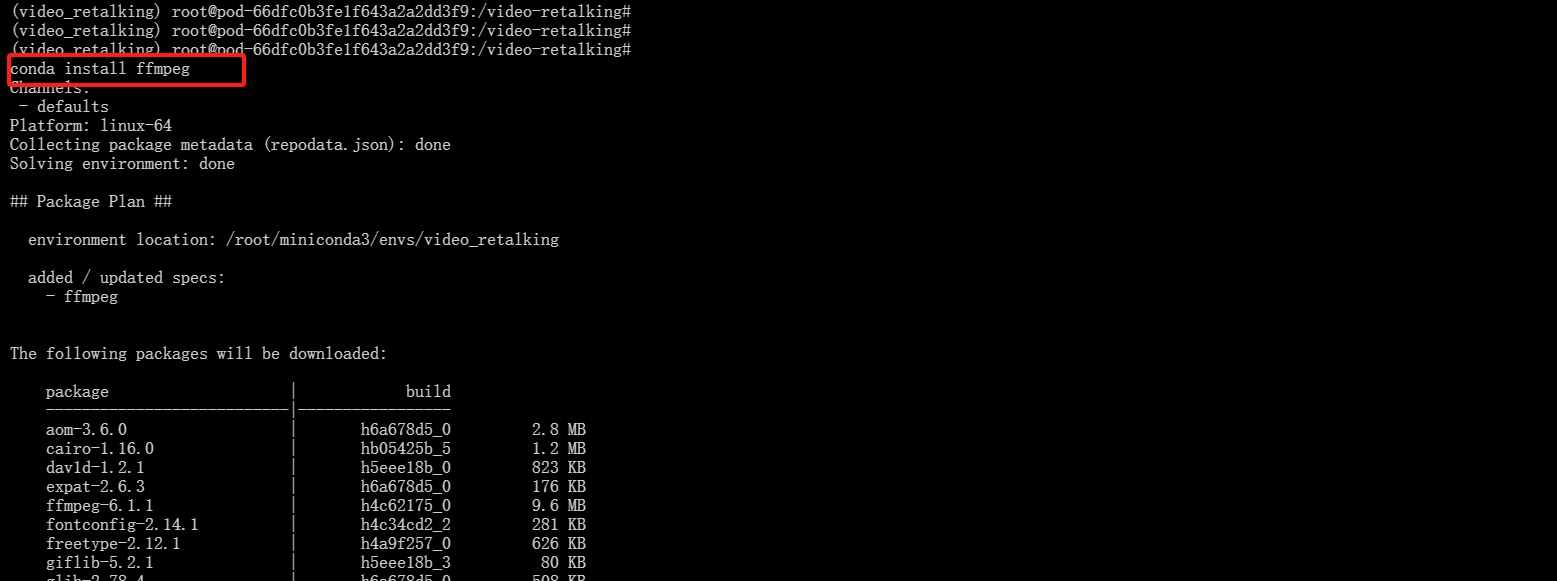

最后安装 ffmpeg:

conda install ffmpeg

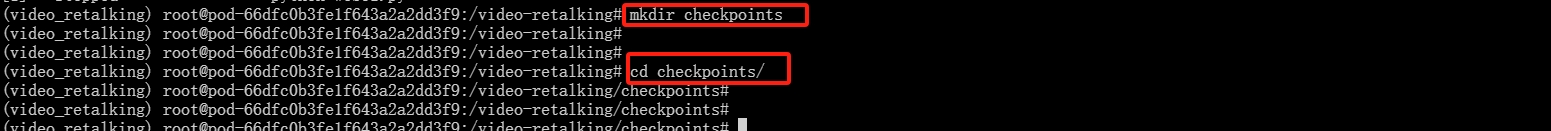

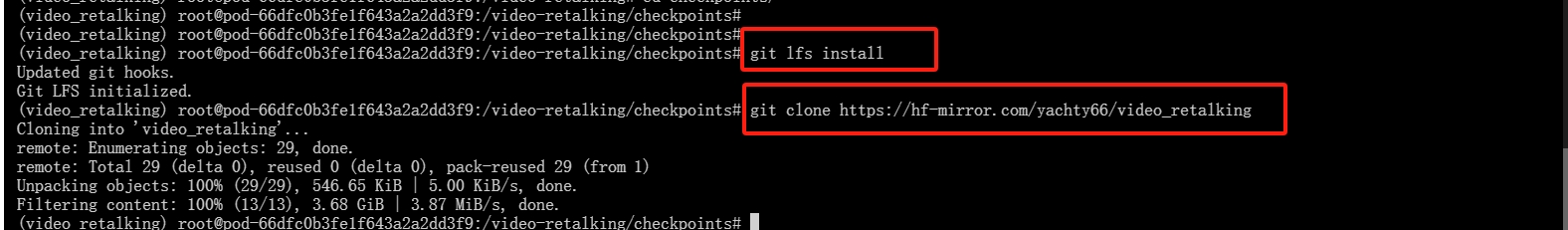

7.添加模型文件

先创建一个名为 checkpoints

mkdir checkpoints

cd checkpoints

下载权重文件:

git lfs install

git clone https://hf-mirror.com/yachty66/video_retalking

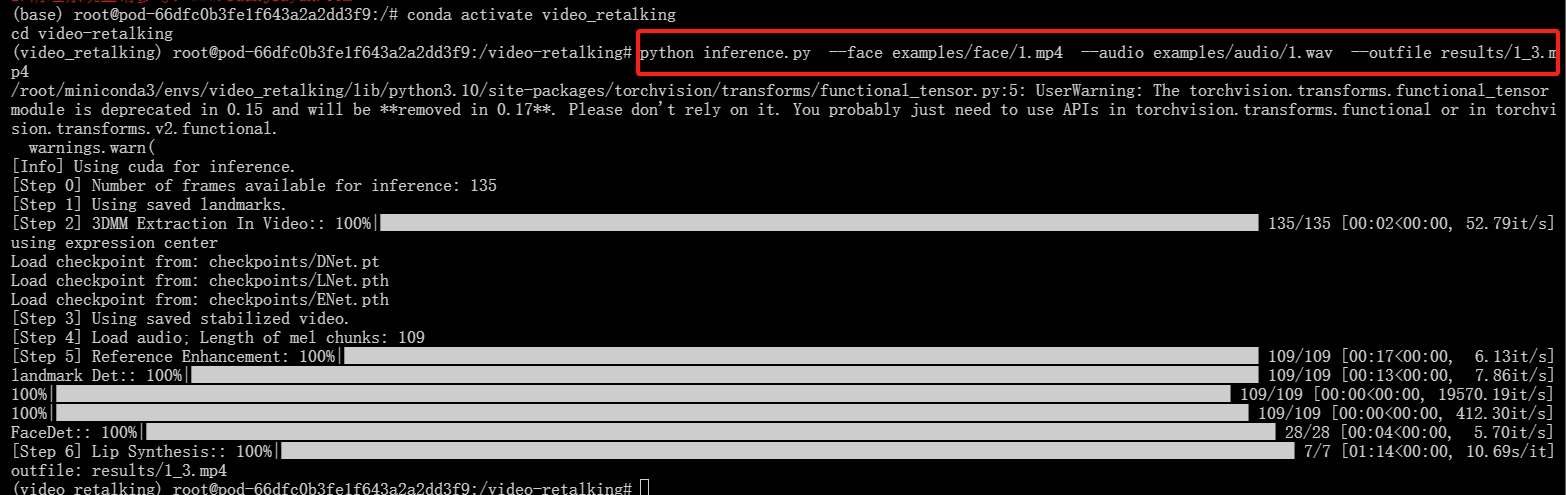

8.推理

输入下列命令:

python3 inference.py

--face examples/face/1.mp4

--audio examples/audio/1.wav

--outfile results/1_3.mp4

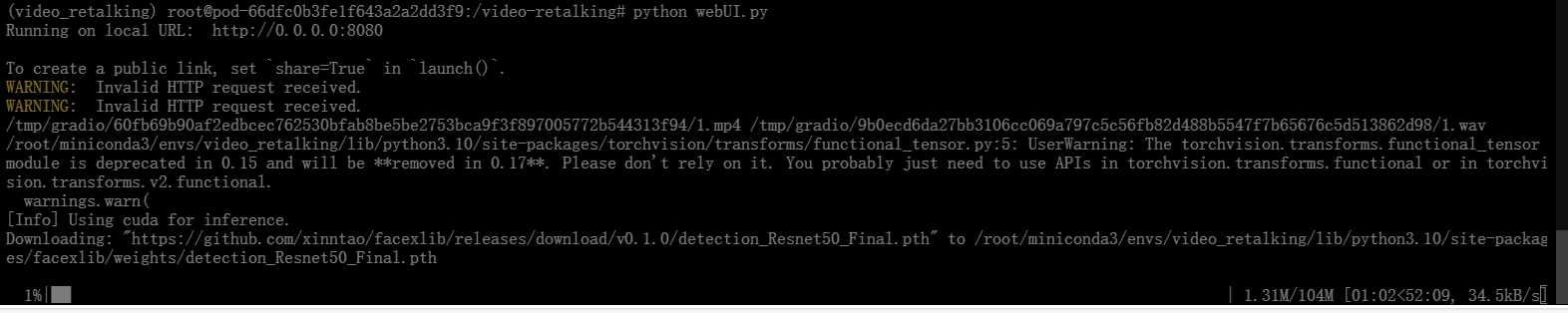

9.web 界面展示

输入下列命令启动界面:

python webUI.py

此时系统会自动下载缺失权重文件

复制网址打开页面:

以上就是在算家云搭建以及本地部署的详细教程。进入算家云-AI-应用社区|模型社区|镜像社区一键使用,快来体验吧~