本文来源公众号“THUSIGSICLAB”,仅用于学术分享,侵权删,干货满满。

原文链接:Low-Level视觉中的扩散模型:综述

摘要 |ABSTRACT

本综述对扩散模型在low-level视觉中的应用全面调研,总结了三种通用的扩散模型框架,并从多个角度对应用于底层视觉的扩散模型进行了分类,从200余篇文献中总结了涵盖超分辨率、去模糊、去雾、去雨、补全、暗光增强、医学图像重建、遥感、视频等任务在内的现有的基于扩散模型的底层视觉工作,并对相关的数据集、评价指标进行了整理。本文对综述中关键图表及部分内容进行描述总结,欢迎从以下链接中获取综述完整内容,或从我们整理的Awesome仓库中获取更多信息。

论文链接:

https://arxiv.org/abs/2406.11138

Awesome

仓库链接:

https://github.com/ChunmingHe/awesome-diffusion-models-in-low-level-vision

Part.01 引言

深度生成模型凭借其强大的生成能力,在low-level视觉任务领域引起了广泛关注。其中,以正向扩散过程和反向去噪过程为特征的基于扩散模型的解决方案,因其产生优质和多样性样本的能力而广受赞誉。这确保了生成具有复杂纹理信息的视觉上引人注目的结果。本文提出了对基于扩散模型的技术的全面综述,涵盖了该领域的理论和实践贡献。我们介绍了三种通用的扩散建模框架,并探讨了它们与其他常用深度生成模型的关联,从而为后续分析奠定了理论基础。随后,我们从多个角度对应用于底层视觉任务的扩散模型进行了分类,既考虑了基础框架也考虑了目标任务。此外,除了自然图像处理方法外,我们还总结了扩展到其他底层视觉任务(如医学、遥感和视频场景)中的扩散模型。此外,我们概述了底层视觉任务中常用的基准和评估指标。我们对基于扩散模型技术在三个主要任务中的性能和效率进行了全面评估。最后,我们阐明了当前扩散模型的局限性,并提出了七个未来研究的有趣方向。本文的全面审查旨在促进对去噪扩散模型在底层视觉任务背景下的理解。

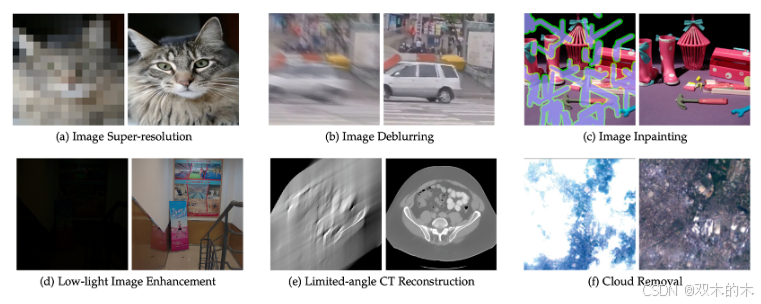

以上是各种底层视觉任务的示例,其中左侧为低质量图像,右侧为增强后的高质量图像。请注意,所有增强后的结果均由基于扩散模型的算法生成,具体包括:(a) 中的 IDM,(b) 中的 MSGD,(c) 中的 Repaint,(d) 中的 Reti-Diff,(e) 中的 DOLCE,以及 (f) 中的 DDPM-CR

Part.02 三种通用的扩散模型框架

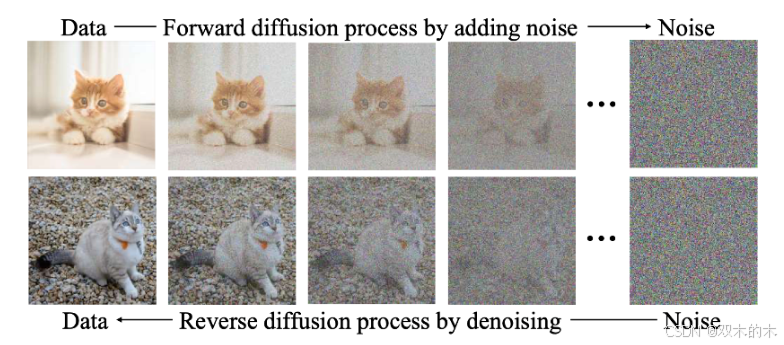

扩散模型是一类基于似然的模型。它们的特点是通过一种称为“扩散”的随机噪声过程逐步扰动数据,然后去除噪声以生成样本。这些模型通常分为三个子类别:去噪扩散概率模型(DDPMs)、噪声条件评分网络(NCSNs)和随机微分方程(SDEs)。

扩散模型示意图

DDPMs及其变体由于其简单的算法流程和易于整合条件控制,受到了广泛关注。相比之下,NCSNs和SDEs通常受到详细的数学分析,因为它们在更高效的采样和任务泛化增强方面具有潜力。文章中,我们深入探讨了这三种形式,阐明噪声引入和逆转过程,并概述推理过程中新样本的生成。

Part.03 扩散模型在Low-level视觉中的相关工作总结

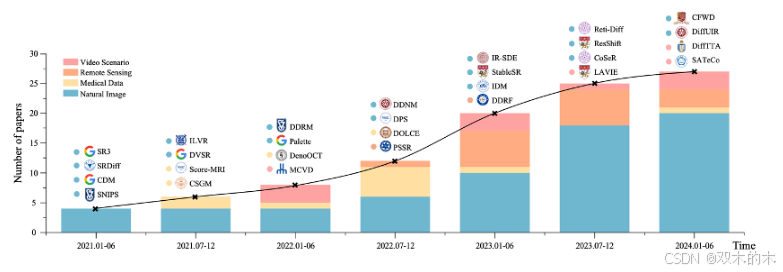

基于扩散模型的四种主要底层视觉场景的分布。在每个维恩图中,圆圈之间的重叠区域表示这些模型能够处理多个应用任务或输入模式

柱状图展示了基于扩散模型的方法在四个不同场景中的底层视觉任务的持续增长。代表性工作的时间段被分类,并在折线图上用与图例中每个场景相对应的颜色标记。图中突出的方法代表了每个时期的开创性工作,例如,StableSR获得了1.9k个GitHub星标,SR3则拥有1.2k次引用

本综述重点讨论了Diffusion Model在自然图像的底层视觉处理中的应用,我们以不同的训练方式以及不同的应用目标两个导向进行了分类并逐个进行了分析。

除此之外,我们在文中也讨论了扩散模型在其他底层视觉任务中的应用,包括医学图像处理、遥感数据处理和视频场景。扩散模型不仅在自然图像处理中取得了显著进展,还在医学、遥感和视频等领域显示出巨大的潜力。

Part.04 实验

4.1 数据集 Datasets

大规模数据集用于模型预训练:从头开始构建DMs需要严格的训练过程,需要极大的计算能力和高内存硬件,这超出了许多研究实验室的承受范围。因此,在生成建模任务中使用预训练模型是一种常见做法,尽管存在潜在数据泄漏的风险。几种常用的大规模预训练数据集包括:

—ImageNet 是一个大规模数据集,包含超过1400万张自然图像,覆盖超过21,000个类别,被称为ImageNet21K。ImageNet1K是ImageNet21K的一个子集,包含1,000个类别,每个类别大约有1,000张图像。

—CelebA 包含20万张面部图像,每张图像标注有40个属性,CelebA-HQ是其子集,包含3万张高分辨率面部图像。

—LSUN 包括10个场景类别和20个物体类别,每个类别大约有100万张标注图像,通常压缩JPEG图像质量为75%。

—FFHQ 包含7万张高分辨率面部图像,具有多样化的分布。基于预训练DM的方法通常在FFHQ上进行训练,并在CelebA-HQ上进行评估,以展示其泛化能力。

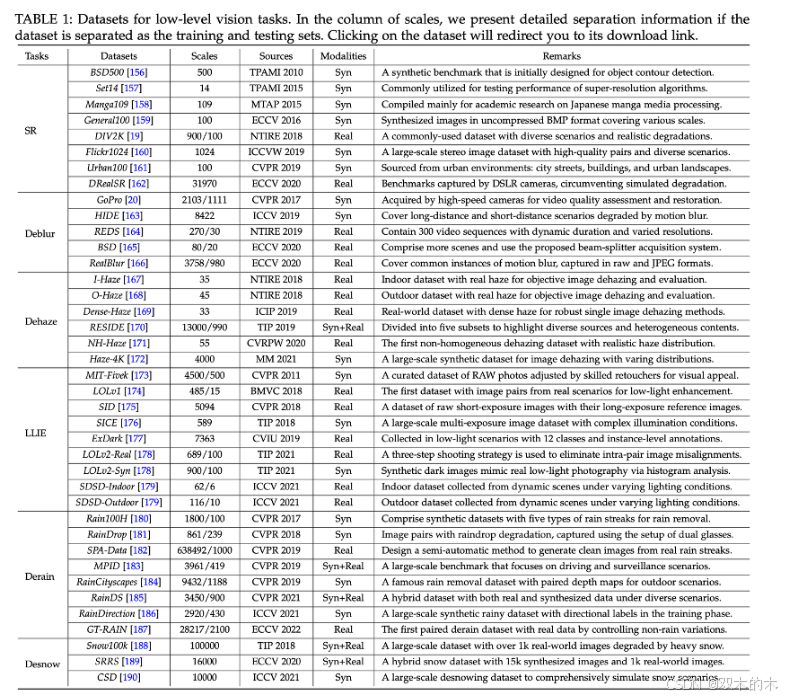

底层视觉模型训练数据集:各种数据集被设计用于处理不同的底层视觉任务,以适应各种退化模式。由于篇幅限制,我们在表1中总结了几种常见的用于经典自然底层视觉任务的数据集,包括它们的规模、来源、模态和备注。关于不同场景下的数据集的更多信息,请参考我们的仓库。实际上,基于DM的模型通常在大规模数据集上进行预训练,以学习一般特征和结构,然后在特定的底层视觉数据集上进行微调,以解决特定的退化问题。

4.2 实验结果 Results

我们对基于扩散模型(DM)的方法在三个常见任务上的定量比较进行了研究。

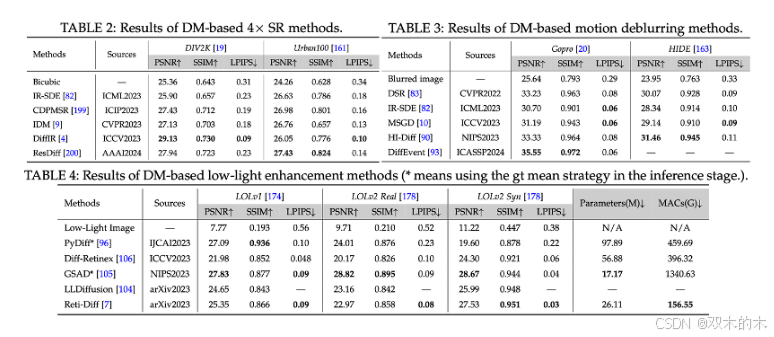

超分辨率结果:在DIV2k和Urban100数据集上测试的4倍图像超分辨率任务中,基于DM的模型结果列于表2中。我们发现IDM和DiffIR在LPIPS指标上表现良好。它们利用预处理图像或特征作为条件输入,这被证明可以提升感知质量。相比之下,Resdiff在PSNR和SSIM指标上表现出色。这是因为Resdiff使用DM来估计残差信息,确保还原图像与高分辨率图像在显著性上一致。

去模糊结果:我们在Gopro和HIDE数据集上评估了五种基于DM的方法在运动去模糊任务中的表现,并在表3中报告了结果。我们发现DiffEvent和HI-Diff在PSNR和SSIM指标上表现出色。DiffEvent通过引入可学习的分解器,实现了低光恢复和图像去模糊的双重功能。HI-Diff通过使用LDM生成高压缩先验,在复杂模糊场景中表现出良好的泛化能力。此外,MSGD引入了多尺度结构自举方法,更好地从目标条件分布中采样,从而在感知指标上表现最佳。

低光照图像增强结果:我们使用LOLv1、LOLv2 Real和LOLv2 Syn数据集验证了五种基于DM的方法在低光照图像增强任务中的性能。结果如表4所示,GSAD在PSNR指标上表现优异。Pydiff在LOLv1数据集上的表现尤为出色,在SSIM指标上相比其他扩散模型有大约6%的提升。Reti-Diff在LPIPS指标上表现具有竞争力。在模型参数和计算复杂度方面,GSAD在参数数量上显著优于其他方法,但引入了巨大的计算复杂度。受益于在低维紧凑空间内使用LDM,Reti-Diff的参数数量为第二少,并且拥有最低的MACs。需要注意的是,GSAD和PyDiff采用了“gt mean”策略,该策略通过使用真实值微调生成结果的亮度,从而在PSNR和SSIM上产生了比其他方法更为出色的结果。

Part.05 未来方向

与其他生成模型相比,扩散模型(DMs)展示了生成复杂细节高保真图像的能力,使得扩散模型在底层视觉任务中得到了广泛应用。然而,扩散模型和底层视觉任务在改进方面仍有很大的提升空间。

在本节中,我们主要关注三个增强扩散模型在底层视觉任务中影响的途径:(1) 缓解扩散模型的局限性,(2) 将扩散模型的优势与底层视觉的特点相结合,(3) 解决底层视觉的固有挑战。

5.1 缓解扩散模型的局限性

由于高计算开销,扩散模型(DMs)在应用于底层视觉任务时面临障碍。为缓解这一挑战,有两种可行的解决方案。在这里列出并讨论如下:

减少采样步骤。为了提高扩散模型的采样效率,进行了多种尝试,不仅限于底层视觉任务:(1) 使用非马尔可夫链来建模扩散过程,例如DDIM。(2) 设计高效的ODE求解器。(3) 使用知识蒸馏来减少采样步骤。(4) 在压缩潜在空间上执行扩散模型。(5) 引入具有条件机制的跨模态先验。

通过这些努力,采样步骤显著减少至10-20步,从而确保了更快的重建速度。例如,DDRM通过采用DDIM的采样策略,将单个224×224图像的推理时间减少到8秒。此外,一些研究通过从低质量图像或基线网络的一步重建结果中进行采样来初始化网络,从而简化学习目标。

然而,尽管取得了显著进展,总体计算成本仍然很高,尤其是对于高分辨率图像,这与实时应用之间存在显著差距。解决这一挑战仍然是加速扩散模型的一个长期且关键的方向。

压缩模型消耗。由于参数规模庞大和计算复杂度高,基于扩散模型(DMs)的模型在低资源环境(如边缘设备)中的部署面临挑战。除了采用较少步数的推理外,研究人员还可以探索架构优化来解决这一问题,包括模型量化、剪枝和知识蒸馏。Zhang等人结合自动化层剪枝和归一化特征蒸馏来压缩模型。Castells等人提出了EdgeFusion,一种用于在神经处理单元上部署SDMs的优化模型,它利用了先进的蒸馏技术和模型级切片来促进快速推理。然而,目前的方法主要集中在生成任务上。未来,这些技术有望扩展到底层视觉任务,利用每个任务的特定属性来实现模型压缩。

5.2 将扩散模型的优势与底层视觉的特点相结合

底层视觉的最大特点在于评估标准的多样性,包括视觉逼真度、内容不变性和基于下游任务的评估。基于扩散模型(DM)的方法在生成具有视觉逼真性的结果时,还应确保原始图像和生成结果的内容一致性,并促进下游任务的执行。

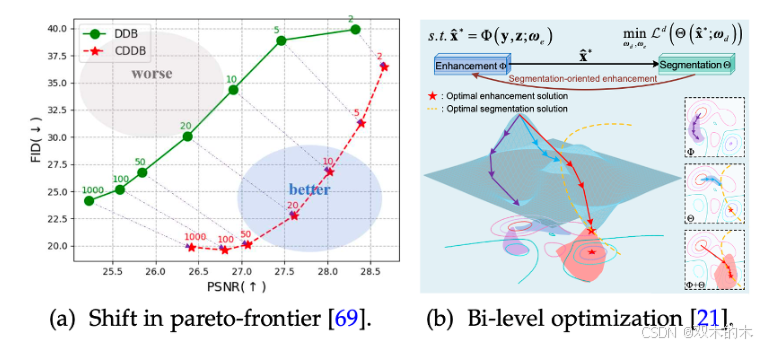

将扩散模型(DM)的优势与底层视觉的特性结合的两种策略

感知-失真权衡。基于DM的方法生成视觉上吸引人的结果,并在基于感知的度量标准(如LPIPS和FID)中表现出色。然而,它们的高多样性常常导致在保持内容一致性方面面临挑战,从而在基于失真的度量标准(如PSNR和SSIM)上表现不佳。

一种潜在的解决方案是设计将DM与基于CNN或Transformer的框架结合的混合模型。这些混合模型显示出了改善失真度量标准的有希望的结果。一些综合指标的引入改善了现有的评估方法难以同时度量感知和失真基准的问题。然而,改领域目前尚未取得突破性进展,关于新的混合结构和新指标的进一步探索仍然值得期待。

下游任务友好设计。使重建图像更好地服务于下游任务是底层视觉研究中的一个持续的努力方向。在基于扩散模型的底层视觉任务中,主要体现为三种主要方法。

一些策略采用双层优化方法,联合优化底层视觉任务和下游任务(如图像分割和目标检测)的网络。通过联合优化增强网络,既考虑自身的约束又考虑下游任务的约束,这些方法旨在生成视觉上吸引人的结果,同时增强下游任务的性能。此外,Ju等人提出了在底层视觉任务和下游任务之间进行特征级信息聚合的方法,而不是之前的图像级方法,通过深层约束提高性能。受对抗攻击的启发,这些攻击通过引入轻微扰动使原始方法失效,Sun等人提出向去雾图像添加轻微噪声。这一策略在不改变视觉效果的情况下,提高了下游检测的性能。然而,这些方法通常针对特定的下游任务。仍然需要一种统一的策略,特别是基于扩散模型的解决方案,以优化生成的图像,使其适用于广泛的下游任务,这需要进一步探索。

5.3 应对底层视觉的固有挑战

底层视觉任务存在几个固有的挑战,包括泛化性、数据量和可控性。

真实世界的图像修复。有两种方式可以帮助基于扩散模型(DM)的方法来应对现实世界场景,即失真不变学习(DIL)和失真估计(DE)。

失真不变学习DIL以其退化不变表示和结构信息保持而闻名,可以通过整合失真不变的噪声预测器和条件来增强基于DM的方法。这使得这些方法能够有效地泛化到多样化甚至未知的退化中。开创性的工作集中在重新设计条件模块以实现失真不变条件,如在Dif-Face和DR2等工作中所展示的。值得注意的是,这种条件的有效性也依赖于DIL,这需要进一步的研究。

此外,提取退化过程的先验知识的DE技术也是将零样本扩散模型扩展到现实世界应用中迫切需要的。尽管无法获得显式的结果,但可以利用DM强大的图像合成能力将合成数据集转化为现实世界的成对数据集,这将在以下小节中详细讨论。

数据生成以应对数据匮乏领域。数据匮乏是底层任务中的一个普遍挑战,通常源于成像设备和场景的固有限制。

尽管无监督训练是一个途径,但许多现有方法转向数据生成策略,以创建伪图像对进行成对训练。这些对通常由生成的低质量退化图像与其对应的原始高质量图像组成。对于基于DM的方法来说,由于其强大的生成能力,尽管探索有限,但这仍是一个有前景的方法。另外,由于数据获取的难度或成本高昂,某些极端任务数据的可用性极其有限,如光声数据和冷冻电子显微镜数据。He等人建议利用现有数据通过生成对抗网络(GAN)生成更多的训练数据,从而增强方法的泛化能力。这一策略与基于DM的方法非常契合,提供了稳定的训练条件。此外,通过用户交互促进的可控数据生成,为筛选可能影响稳定性能的负面数据提供了一种有前景的方法。

可控和交互式底层视觉。提升底层视觉方法的可控性,使其能够识别用户希望恢复的内容和位置是十分重要的。这个问题长期以来一直存在,需要考虑到包括整合人类感知相关的损失函数和交互指导先验。最近,通过视觉-语言模型提供的视觉提示,为现有的底层视觉方法提供了一种明确地将提示纳入并与其网络内部交互的手段,从而实现了改进的控制和恢复效果。鉴于这些视觉提示可以作为交互式先验来抑制基于扩散模型(DM)方法固有的过度多样性,利用视觉-语言模型开发可控和交互式的基于DM的方法显示出巨大的潜力。

此外,未来的努力方向应尝试解决涉及多重退化的真实世界场景。Zheng等人引入了一种名为DiffUIR的基于DM的新方法,采用选择性沙漏映射技术来解决这种问题。DiffUIR提出不依赖提示学习的方法,而是结合共享分布映射和基于残差去噪扩散模型(Residual Denoising Diffusion Models, RDDM)的鲁棒条件引导来提高图像修复性能。改进深度学习的内部机制,以更好地学习多任务退化的分布,是未来基于DM探索的一个有前景的方向。

Part.06 总结

在这项综述中,我们对应用于底层视觉任务的去噪扩散模型进行了广泛的研究,填补了以往综述中未曾涉及的空白。我们的综述涵盖了该领域的进展和实际应用。首先,我们识别并讨论了各种通用的扩散建模框架。接着,我们从多个角度提出了一个全面的底层视觉任务中使用的扩散模型分类方法。最后,我们强调了现有扩散模型的局限性,并提出了未来研究和探索的有趣方向。使用这些模型在底层视觉任务中的进展正在向更复杂和更高维的媒介发展,包括3D物体、运动和4D场景,这些都需要在未来的研究中持续关注。

THE END !

文章结束,感谢阅读。您的点赞,收藏,评论是我继续更新的动力。大家有推荐的公众号可以评论区留言,共同学习,一起进步。