一. RNN循环神经网络从零实现

1. 加载数据集

根据上篇博客介绍李沐动手学深度学习V2-RNN循环神经网络原理, 来从头开始基于循环神经网络实现字符级语言模型,模型将在H.G.Wells的时光机器数据集上训练,首先读取数据集。

import math

import torch

import d2l.torch

from torch import nn

from torch.nn import functional as F

batch_size,num_steps = 32,35

#train_iter为数据迭代器,vocab是Vocab类实例,包含把词元id转换成对应的词元,以及把词元转换成对应id等功能

train_iter,vocab = d2l.torch.load_data_time_machine(batch_size,num_steps)

2. 独热编码(one-hot encoding)

在train_iter中,每个词元都表示为一个数字索引, 将这些索引直接输入神经网络可能会使学习变得困难,我们通常将每个词元表示为更具表现力的特征向量,最简单的表示称为独热编码(one-hot encoding)。

简言之,将每个索引映射为相互不同的单位向量: 假设词表中不同词元的数目为 𝑁 (即len(vocab)), 词元索引的范围为 0 到 𝑁−1 。 如果词元的索引是整数 𝑖 , 那么将创建一个长度为 𝑁 的全 0 向量, 并将第 𝑖 处的元素设置为 1 ,此向量是原始词元的一个独热向量。索引为 0 和 2 的独热向量如下所示:

F.one_hot(torch.tensor([0,2]),len(vocab)) #len(vocab)调用的是vocab类内置函数__len()__:表示创建的词元个数

输出结果如下:

tensor([[1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0,

0, 0, 0, 0],

[0, 0, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0,

0, 0, 0, 0]])

每次采样的小批量数据形状是二维张量:(批量大小,时间步数)。 one_hot()函数将这样一个小批量数据转换成三维张量, 张量的最后一个维度等于词表大小 len(vocab),通常需要转换输入的维度,以便获得形状为 (时间步数,批量大小,词表大小)的输出, 这将使我们能够更方便地通过最外层的维度, 一步一步地更新小批量数据的隐状态。

X = torch.arange(10).reshape(2,5)

F.one_hot(X.T,28)

3. 初始化模型参数

接下来初始化循环神经网络模型的模型参数,隐藏单元数num_hiddens是一个可调的超参数,当训练语言模型时输入和输出来自相同的词表,因此它们具有相同的维度即词表的大小。

def get_params(vocab_size,num_hiddens,device):

input_size = output_size = vocab_size

def normal(shape):

return torch.randn(size=shape,device=device)*0.01 #randn()范围是0-1

# 隐藏层参数

W_xh = normal(shape=(input_size,num_hiddens))

W_hh = normal(shape=(num_hiddens,num_hiddens))

b_h = torch.zeros(num_hiddens,device=device)

# 输出层参数

W_hq = normal(shape=(num_hiddens,output_size))

b_q = torch.zeros(output_size,device=device)

#设置参数梯度

params = [W_xh,W_hh,b_h,W_hq,b_q]

for param in params :

param.requires_grad_(True) #requires_grad是参数的梯度属性,requires_grad_()函数是设置参数是否需要梯度

return params

4. 循环神经网络

为了定义循环神经网络模型, 首先需要一个init_rnn_state()函数在初始化时返回隐状态,这个函数的返回是一个张量,张量全用0填充, 形状为(批量大小,隐藏单元数)。

def init_rnn_state(batch_size,num_hiddens,device):

return (torch.zeros(size=(batch_size,num_hiddens),device=device),)#因为LSTM返回的隐状态有两个,为了更适配更多网络,因此采用了元组形式返回隐状态变量

下面的rnn函数定义了如何在一个时间步内计算隐状态和输出, 循环神经网络模型通过每个批量的时间步数实现循环, 以便逐时间步更新小批量数据的隐状态H。 此外使用 tanh 函数作为激活函数, 当元素在实数上满足均匀分布时, tanh 函数的平均值为0。

def rnn(inputs,state,params):

# inputs的形状:(时间步数量,批量大小,词表大小)

W_xh,W_hh,b_h,W_hq,b_q = params

H, = state

outputs = []

for X in inputs:

# X的形状:(批量大小,词表大小),表示每一个时间步下数据形状是(批量大小,词表大小)

H = torch.tanh(torch.mm(X,W_xh)+torch.mm(H,W_hh)+b_h)

Y = torch.mm(H,W_hq)+b_q

outputs.append(Y)

return torch.cat(outputs,dim=0),(H,)

定义了所有需要的函数之后,接下来创建一个类来包装这些函数, 并存储从零开始实现的循环神经网络模型的参数。

"""从零开始实现的循环神经网络模型"""

class RNNModelScratch:

def __init__(self,vocab_size,num_hiddens,device,get_params,init_state,forward_fn):

self.vocab_size,self.num_hiddens = vocab_size,num_hiddens

#初始化模型参数

self.params = get_params(vocab_size,num_hiddens,device)

self.init_state,self.forward_fn = init_state,forward_fn

def __call__(self,X,state):

# X.T表示转置,将X形状从(批量大小,时间步数)转换成(时间步数,批量大小)

X = F.one_hot(X.T,self.vocab_size).type(torch.float32)

return self.forward_fn(X,state,self.params)

def begin_state(self,batch_size,device):

return self.init_state(batch_size,self.num_hiddens,device)

检查输出是否具有正确的形状, 例如隐状态的维数是否保持不变,可以看到输出形状是(时间步数 × 批量大小,词表大小), 而隐状态形状保持不变,即(批量大小,隐藏单元数)。

num_hiddens = 512

net = RNNModelScratch(len(vocab),num_hiddens,d2l.torch.try_gpu(),get_params,init_rnn_state,rnn)

begin_state = net.begin_state(X.shape[0],d2l.torch.try_gpu())

Y,new_state = net(X.to(d2l.torch.try_gpu()),begin_state) # net()调用了net类内置函数__call__()函数

Y.shape,len(new_state),new_state[0].shape

'''

输出结果如下:

(torch.Size([10, 28]), 1, torch.Size([2, 512]))

'''

5.预测

定义预测函数来生成prefix之后的新字符, 其中的prefix是一个用户提供的包含多个字符的字符串。 在循环遍历prefix中的开始字符时,不断地将隐状态传递到下一个时间步,但是不生成任何输出,这被称为预热(warm-up)期, 因为在此期间模型会自我更新(例如更新隐状态), 但不会进行预测。 预热期结束后,隐状态的值通常比刚开始的初始值更适合预测从而预测字符并输出它们。注意模型训练的是模型的参数,而不是模型的隐状态(近似可以认为(但不准确)是隐藏层的输出),在任意一个序列开始训练或预热时,模型的隐状态始终为0,经过一些时间步数后,经过训练好的模型参数后隐状态会进行更新自己的状态,并且此时的隐状态的数值表示存储看过到目前为止的序列的信息。

"""在prefix后面生成新字符"""

def predict_ch8(prefix,num_preds,net,vocab,device):

#state表示对看过的序列用一个状态量表示,刚开始没有看过任何序列,状态量初始化为0,然后逐渐按顺序看序列,然后更新状态量,使用状态量进行对看过的序列进行表示

state = net.begin_state(batch_size=1,device=device)

outputs = [vocab[prefix[0]]]

get_input = lambda:torch.tensor([outputs[-1]],device=device).reshape((1,1))

# 预热期

for i in prefix[1:]:

_,state = net(get_input(),state)

outputs.append(vocab[i])

# 预测num_preds步

for _ in range(num_preds):

y,state = net(get_input(),state)

outputs.append(int(y.argmax(dim=1).reshape(1)))

return ''.join([vocab.idx_to_token[i] for i in outputs])

测试predict_ch8()函数,将前缀指定为time traveller, 并基于这个前缀生成10个后续字符,由于还没有训练网络,它会生成不好的预测结果。

predict_ch8('time traveller ',8,net,vocab,d2l.torch.try_gpu())

'''

输出结果如下:

'time traveller dnwpjabt'

'''

6. 梯度裁剪

对于长度为

T

T

T的序列,在迭代中计算这

T

T

T个时间步上的梯度,将会在反向传播过程中产生长度为

O

(

T

)

\mathcal{O}(T)

O(T)的矩阵乘法链。当

T

T

T较大时,它可能导致数值不稳定,例如可能导致梯度爆炸或梯度消失。因此循环神经网络模型往往需要额外的方式来支持稳定训练。

一般来说当解决优化问题时,我们对模型参数采用更新步骤。假定在向量形式的

x

\mathbf{x}

x中,或者在小批量数据的负梯度

g

\mathbf{g}

g方向上。例如使用

η

>

0

\eta > 0

η>0作为学习率时,在一次迭代中将

x

\mathbf{x}

x更新为

x

−

η

g

\mathbf{x} - \eta \mathbf{g}

x−ηg。如果进一步假设目标函数

f

f

f表现良好,即函数

f

f

f在常数

L

L

L下是利普希茨连续的(Lipschitz continuous)。也就是说,对于任意

x

\mathbf{x}

x和

y

\mathbf{y}

y有:

∣

f

(

x

)

−

f

(

y

)

∣

≤

L

∥

x

−

y

∥

.

|f(\mathbf{x}) - f(\mathbf{y})| \leq L \|\mathbf{x} - \mathbf{y}\|.

∣f(x)−f(y)∣≤L∥x−y∥.

在这种情况下,假设:如果通过

η

g

\eta \mathbf{g}

ηg更新参数向量,则

∣

f

(

x

)

−

f

(

x

−

η

g

)

∣

≤

L

η

∥

g

∥

,

|f(\mathbf{x}) - f(\mathbf{x} - \eta\mathbf{g})| \leq L \eta\|\mathbf{g}\|,

∣f(x)−f(x−ηg)∣≤Lη∥g∥,

这意味着我们不会观察到超过

L

η

∥

g

∥

L \eta \|\mathbf{g}\|

Lη∥g∥的变化,这既是坏事也是好事。坏的方面,它限制了取得进展的速度;好的方面,它限制了事情变糟的程度,尤其当我们朝着错误的方向前进时。

有时梯度可能很大,从而优化算法可能无法收敛,我们可以通过降低

η

\eta

η的学习率来解决这个问题,但是如果我们很少得到大的梯度呢?在这种情况下,这种做法似乎毫无道理。一个流行的替代方案是通过将梯度

g

\mathbf{g}

g投影回给定半径(例如

θ

\theta

θ)的球来裁剪梯度

g

\mathbf{g}

g。

如下式:

(

g

←

min

(

1

,

θ

∥

g

∥

)

g

.

\mathbf{g} \leftarrow \min\left(1, \frac{\theta}{\|\mathbf{g}\|}\right) \mathbf{g}.

g←min(1,∥g∥θ)g.)

通过这样做知道梯度范数永远不会超过

θ

\theta

θ,并且更新后的梯度完全与

g

\mathbf{g}

g的原始方向对齐。它还有一个值得拥有的副作用,即限制任何给定的小批量数据(以及其中任何给定的样本)对参数向量的影响,这赋予了模型一定程度的稳定性。梯度裁剪提供了一个快速修复梯度爆炸的方法,

虽然它并不能完全解决问题,但它是众多有效的技术之一。

下面定义一个函数来裁剪模型的梯度,模型是从零开始实现的模型或由高级API构建的模型,在此计算了所有模型参数的梯度的范数。

"""裁剪梯度"""

def grad_clipping(net,theta):

if isinstance(net,nn.Module):

params = [ p for p in net.parameters() if p.requires_grad]

else:

params = net.params

# 模型所有参数梯度范数(参数梯度平方求和再开平方根)

norm = torch.sqrt(sum(torch.sum((p.grad**2)) for p in params))

if norm>theta:

for param in params:

param.grad[:] *= theta/norm

7. 训练

在训练模型之前,首先定义一个函数在一个迭代周期内训练模型,需要注意下面三点:

- 序列数据的不同采样方法(随机采样和顺序分区)将导致隐状态初始化的差异。

- 在更新模型参数之前裁剪梯度,目的是:即使训练过程中某个点上发生了梯度爆炸,也能保证模型不会发散。

- 用困惑度来评价模型,确保了不同长度的序列具有可比性。

具体来说,当使用顺序分区(划分)时,只需要在每个迭代周期的开始位置初始化隐状态。由于下一个小批量数据中的第

i

i

i个子序列样本与当前第

i

i

i个子序列样本相邻,因此当前小批量数据最后一个时间步的隐状态,将用于初始化下一个小批量数据第一个时间步的隐状态。这样存储在隐状态中的序列的历史信息可以在一个迭代周期内流经相邻的子序列。然而在任何一点隐状态的计算,都依赖于同一迭代周期中前面所有的小批量数据,这使得梯度计算变得复杂。为了降低计算量,在处理任何一个小批量数据之前,我们先分离梯度,使得隐状态的梯度计算总是限制在一个小批量数据的时间步内。

当使用随机抽样时,因为每个样本都是在一个随机位置抽样的,因此需要在处理任何一个小批量数据之前(也即是每次小批量数据迭代时)重新初始化隐状态。

optim()是更新模型参数的常用函数,它既可以是从头开始实现的d2l.torch.sgd()函数,也可以是深度学习框架中内置的优化函数,循环神经网络模型的训练一个周期的函数如下:

"""训练网络一个迭代周期"""

def train_epoch_ch8(net,train_iter,loss,optim,device,use_random_iter):

state,timer = None,d2l.torch.Timer()

# 训练损失之和,词元数量

accumulator = d2l.torch.Accumulator(2)

for X,Y in train_iter:

X,Y = X.to(device),Y.to(device)

if state is None or use_random_iter:

# 在第一次迭代或使用随机抽样时在处理任何一个小批量数据之前都需要初始化state,因为随机抽样样本数据前一个批量与后一个批量同一个位置的样本是随机的,不是连续的

state = net.begin_state(batch_size=X.shape[0],device=device)

else:

if isinstance(net,nn.Module) and not isinstance(state,tuple):

# state对于nn.GRU是个张量

#在顺序划分数据中在任何一点隐状态的计算, 都依赖于同一迭代周期中前面所有的小批量数据, 这使得梯度计算变得复杂。 为了降低计算量,在处理任何一个小批量数据之前, 我们先分离梯度,使得隐状态的梯度计算总是限制在一个小批量数据的时间步内。

state.detach_()

else:

# state对于nn.LSTM或对于我们从零开始实现的模型是一个tuple

for s in state:

s.detach_()

y = Y.T.reshape(-1)

y_hat,state = net(X,state)

l = loss(y_hat,y.long()).mean()

if isinstance(optim,torch.optim.Optimizer):

#Pytorch框架实现的优化函数optim()

optim.zero_grad()

#计算梯度

l.backward()

#梯度裁剪

grad_clipping(net,theta=1)

#通过学习率和计算出的梯度(经过梯度剪裁过的梯度)更新参数

optim.step()

else:

#手动实现的优化函数optim()

#计算梯度

l.backward()

#梯度裁剪

grad_clipping(net,theta=1)

#通过学习率和计算出的梯度(经过梯度剪裁过的梯度)更新参数

optim(batch_size=1)

# 因为前面l已经调用了mean函数,这里是对所有预测数据与label数据的loss求和

accumulator.add(l*y.numel(),y.numel())

return math.exp(accumulator[0]/accumulator[1]),accumulator[1]/timer.stop()

循环神经网络模型的训练整个周期的函数如下:

"""训练模型"""

def train_ch8(net,train_iter,vocab,lr,num_epoches,device,use_random_iter=False):

loss = nn.CrossEntropyLoss()

animator = d2l.torch.Animator(xlabel='epoch',ylabel='perplexity',xlim=[10,num_epoches],legend=['train'])

# 初始化

if isinstance(net,nn.Module):

optim = torch.optim.SGD(net.parameters(),lr)

else:

optim = lambda batch_size:d2l.torch.sgd(net.params,lr,batch_size)

predict = lambda prefix:predict_ch8(prefix,50,net,vocab,device)

# 训练和预测

for epoch in range(num_epoches):

ppl,speed = train_epoch_ch8(net,train_iter,loss,optim,device,use_random_iter)

if (epoch+1)%10 == 0:

print(predict('time travller'))

animator.add(epoch+1,[ppl])

print('ppl = ',ppl,' speed = ',speed)

print(predict('time travller'))

print(predict('time '))

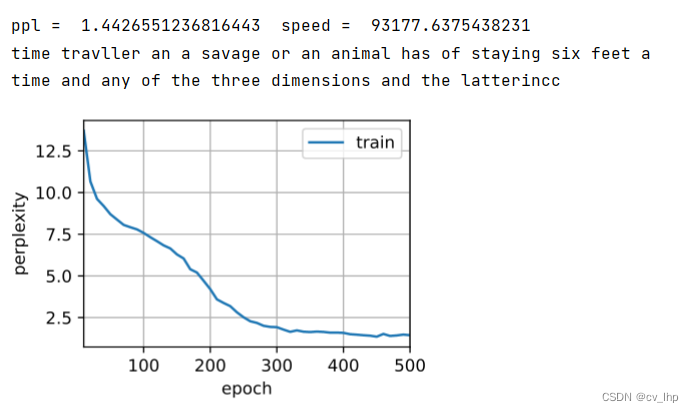

训练循环神经网络模型, 因为在数据集中只使用了10000个词元, 所以模型需要更多的迭代周期来更好地收敛,训练结果如下图所示。

num_epoches,lr = 500,1

train_ch8(net,train_iter,vocab,lr,num_epoches,d2l.torch.try_gpu(),False)

上面数据集是采用顺序分区(划分)的方式,下面对数据集采用另外一种随机抽样方法,如下图所示:

net = RNNModelScratch(len(vocab),num_hiddens,d2l.torch.try_gpu(),get_params,init_rnn_state,rnn)

train_ch8(net,train_iter,vocab,lr,num_epoches,d2l.torch.try_gpu(),use_random_iter=True)

8. 小结

- 我们可以训练一个基于循环神经网络的字符级语言模型,根据用户提供的文本的前缀生成后续文本。

- 一个简单的循环神经网络语言模型包括输入编码、循环神经网络模型和输出生成以及隐状态初始化和更新。

- 循环神经网络模型在训练以前需要初始化状态,不过随机抽样和顺序划分使用初始化方法不同。

- 当使用顺序划分时,需要分离梯度以减少计算量。

- 在进行任何预测之前,模型通过预热期进行自我更新(例如,获得比初始值更好的隐状态)。

- 梯度裁剪可以防止梯度爆炸,但不能应对梯度消失。

- 注意模型训练的是模型的参数,而不是模型的隐状态(近似可以认为(但不准确)是隐藏层的输出),在任意一个序列开始训练或预热时,模型的隐状态始终为0,经过一些时间步数后,经过训练好的模型参数后隐状态会进行更新自己的状态,并且此时的隐状态的数值表示存储看过到目前为止的序列的信息。

9.全部代码

import math

import torch

import d2l.torch

from torch import nn

from torch.nn import functional as F

batch_size, num_steps = 32, 35

#train_iter为数据迭代器,vocab是Vocab类实例,包含把词元id转换成对应的词元,以及把词元转换成对应id等功能

train_iter, vocab = d2l.torch.load_data_time_machine(batch_size, num_steps)

F.one_hot(torch.tensor([0, 2]), len(vocab)) #len(vocab)调用的是vocab类内置函数__len()__:表示创建的词元个数

X = torch.arange(10).reshape(2, 5)

F.one_hot(X.T, 28)

def get_params(vocab_size, num_hiddens, device):

input_size = output_size = vocab_size

def normal(shape):

return torch.randn(size=shape, device=device) * 0.01 #randn()范围是0-1

# 隐藏层参数

W_xh = normal(shape=(input_size, num_hiddens))

W_hh = normal(shape=(num_hiddens, num_hiddens))

b_h = torch.zeros(num_hiddens, device=device)

# 输出层参数

W_hq = normal(shape=(num_hiddens, output_size))

b_q = torch.zeros(output_size, device=device)

#设置参数梯度

params = [W_xh, W_hh, b_h, W_hq, b_q]

for param in params:

param.requires_grad_(True) #requires_grad是参数的梯度属性,requires_grad_()函数是设置参数是否需要梯度

return params

get_params(28, 40, d2l.torch.try_gpu())

def init_rnn_state(batch_size, num_hiddens, device):

return (torch.zeros(size=(batch_size, num_hiddens), device=device),)

def rnn(inputs, state, params):

# inputs的形状:(时间步数量,批量大小,词表大小)

W_xh, W_hh, b_h, W_hq, b_q = params

H, = state

outputs = []

for X in inputs:

# X的形状:(批量大小,词表大小),表示每一个时间步下数据形状是(批量大小,词表大小)

H = torch.tanh(torch.mm(X, W_xh) + torch.mm(H, W_hh) + b_h)

Y = torch.mm(H, W_hq) + b_q

outputs.append(Y)

return torch.cat(outputs, dim=0), (H,)

"""从零开始实现的循环神经网络模型"""

class RNNModelScratch:

def __init__(self, vocab_size, num_hiddens, device, get_params, init_state, forward_fn):

self.vocab_size, self.num_hiddens = vocab_size, num_hiddens

#初始化模型参数

self.params = get_params(vocab_size, num_hiddens, device)

self.init_state, self.forward_fn = init_state, forward_fn

def __call__(self, X, state):

# X.T表示转置,将X形状从(批量大小,时间步数)转换成(时间步数,批量大小)

X = F.one_hot(X.T, self.vocab_size).type(torch.float32)

return self.forward_fn(X, state, self.params)

def begin_state(self, batch_size, device):

return self.init_state(batch_size, self.num_hiddens, device)

num_hiddens = 512

net = RNNModelScratch(len(vocab), num_hiddens, d2l.torch.try_gpu(), get_params, init_rnn_state, rnn)

begin_state = net.begin_state(X.shape[0], d2l.torch.try_gpu())

Y, new_state = net(X.to(d2l.torch.try_gpu()), begin_state) # net()调用了net类内置函数__call__()函数

Y.shape, len(new_state), new_state[0].shape

"""在prefix后面生成新字符"""

def predict_ch8(prefix, num_preds, net, vocab, device):

#state表示对看过的序列用一个状态量表示,刚开始没有看过任何序列,状态量初始化为0,然后逐渐按顺序看序列,然后更新状态量,使用状态量进行对看过的序列进行表示

state = net.begin_state(batch_size=1, device=device)

outputs = [vocab[prefix[0]]]

get_input = lambda: torch.tensor([outputs[-1]], device=device).reshape((1, 1))

# 预热期

for i in prefix[1:]:

_, state = net(get_input(), state)

outputs.append(vocab[i])

# 预测num_preds步

for _ in range(num_preds):

y, state = net(get_input(), state)

outputs.append(int(y.argmax(dim=1).reshape(1)))

return ''.join([vocab.idx_to_token[i] for i in outputs])

predict_ch8('time traveller ', 8, net, vocab, d2l.torch.try_gpu())

"""裁剪梯度"""

def grad_clipping(net, theta):

if isinstance(net, nn.Module):

params = [p for p in net.parameters() if p.requires_grad]

else:

params = net.params

# 模型所有参数梯度范数(参数梯度平方求和再开平方根)

norm = torch.sqrt(sum(torch.sum((p.grad ** 2)) for p in params))

if norm > theta:

for param in params:

param.grad[:] *= theta / norm

"""训练网络一个迭代周期"""

def train_epoch_ch8(net, train_iter, loss, optim, device, use_random_iter):

state, timer = None, d2l.torch.Timer()

# 训练损失之和,词元数量

accumulator = d2l.torch.Accumulator(2)

for X, Y in train_iter:

X, Y = X.to(device), Y.to(device)

if state is None or use_random_iter:

# 在第一次迭代或使用随机抽样时在处理任何一个小批量数据之前都需要初始化state,因为随机抽样样本数据前一个批量与后一个批量同一个位置的样本是随机的,不是连续的

state = net.begin_state(batch_size=X.shape[0], device=device)

else:

if isinstance(net, nn.Module) and not isinstance(state, tuple):

# state对于nn.GRU是个张量

#在顺序划分数据中在任何一点隐状态的计算, 都依赖于同一迭代周期中前面所有的小批量数据, 这使得梯度计算变得复杂。 为了降低计算量,在处理任何一个小批量数据之前, 我们先分离梯度,使得隐状态的梯度计算总是限制在一个小批量数据的时间步内。

state.detach_()

else:

# state对于nn.LSTM或对于我们从零开始实现的模型是一个tuple

for s in state:

s.detach_()

y = Y.T.reshape(-1)

y_hat, state = net(X, state)

l = loss(y_hat, y.long()).mean()

if isinstance(optim, torch.optim.Optimizer):

#Pytorch框架实现的优化函数optim()

optim.zero_grad()

#计算梯度

l.backward()

#梯度裁剪

grad_clipping(net, theta=1)

#通过学习率和计算出的梯度(经过梯度剪裁过的梯度)更新参数

optim.step()

else:

#手动实现的优化函数optim()

#计算梯度

l.backward()

#梯度裁剪

grad_clipping(net, theta=1)

#通过学习率和计算出的梯度(经过梯度剪裁过的梯度)更新参数

optim(batch_size=1)

# 因为前面l已经调用了mean函数,这里是对所有预测数据与label数据的loss求和

accumulator.add(l * y.numel(), y.numel())

return math.exp(accumulator[0] / accumulator[1]), accumulator[1] / timer.stop()

"""训练模型"""

def train_ch8(net, train_iter, vocab, lr, num_epoches, device, use_random_iter=False):

loss = nn.CrossEntropyLoss()

animator = d2l.torch.Animator(xlabel='epoch', ylabel='perplexity', xlim=[10, num_epoches], legend=['train'])

# 初始化

if isinstance(net, nn.Module):

optim = torch.optim.SGD(net.parameters(), lr)

else:

optim = lambda batch_size: d2l.torch.sgd(net.params, lr, batch_size)

predict = lambda prefix: predict_ch8(prefix, 50, net, vocab, device)

# 训练和预测

for epoch in range(num_epoches):

ppl, speed = train_epoch_ch8(net, train_iter, loss, optim, device, use_random_iter)

if (epoch + 1) % 10 == 0:

print(predict('time travller'))

animator.add(epoch + 1, [ppl])

print('ppl = ', ppl, ' speed = ', speed)

print(predict('time travller'))

print(predict('time '))

num_epoches, lr = 500, 1

train_ch8(net, train_iter, vocab, lr, num_epoches, d2l.torch.try_gpu(), False)

net = RNNModelScratch(len(vocab), num_hiddens, d2l.torch.try_gpu(), get_params, init_rnn_state, rnn)

train_ch8(net, train_iter, vocab, lr, num_epoches, d2l.torch.try_gpu(), use_random_iter=True)

10. 补充

李宏毅机器学习对RNN讲解:为什么RNN会出现梯度消失以及梯度爆炸?

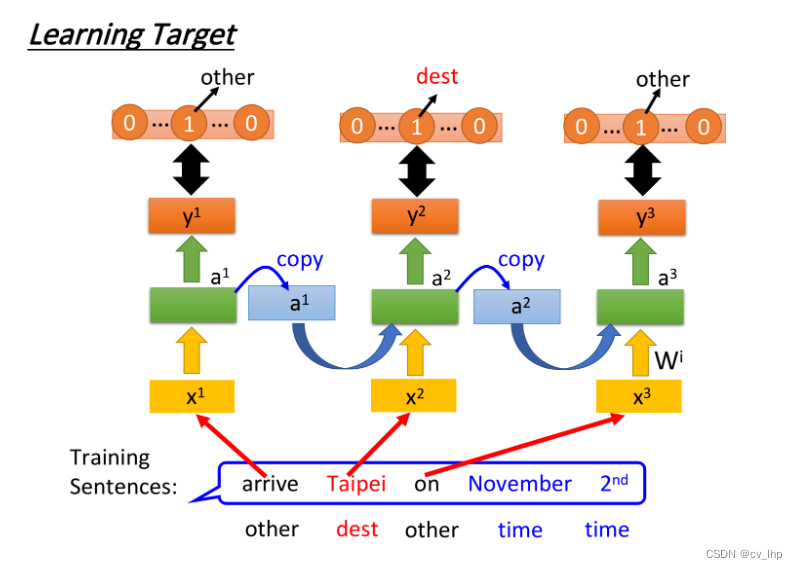

Learning Target

Loss Function

依旧是Slot Filling的例子,我们需要把model的输出 y i y^i yi与映射到slot的reference vector求交叉熵,比如“Taipei”对应到的是“dest”这个slot,则reference vector在“dest”位置上值为1,其余维度值为0

RNN的output和reference vector的cross entropy之和就是损失函数,也是要minimize的对象

需要注意的是,word要依次输入model,比如“arrive”必须要在“Taipei”前输入,不能打乱语序

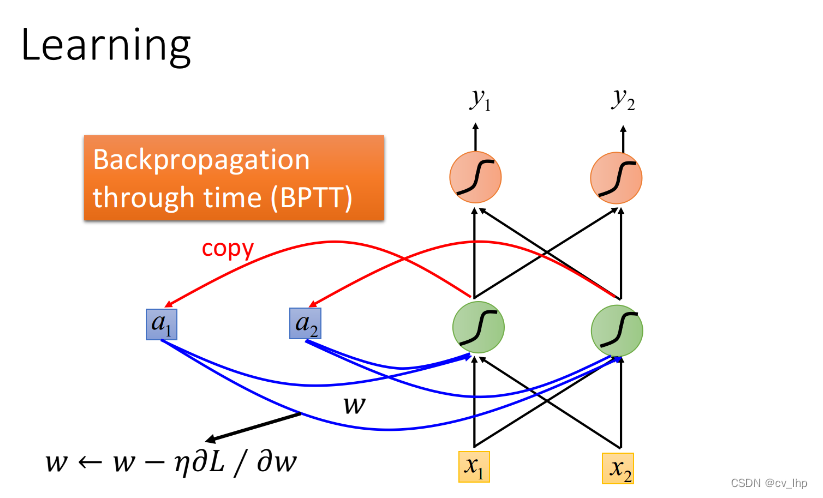

Training

有了损失函数后,训练其实也是用梯度下降法,为了计算方便,这里采取了反向传播(Backpropagation)的进阶版,Backpropagation through time,简称BPTT算法

BPTT算法与BP算法非常类似,只是多了一些时间维度上的信息,这里不做详细介绍

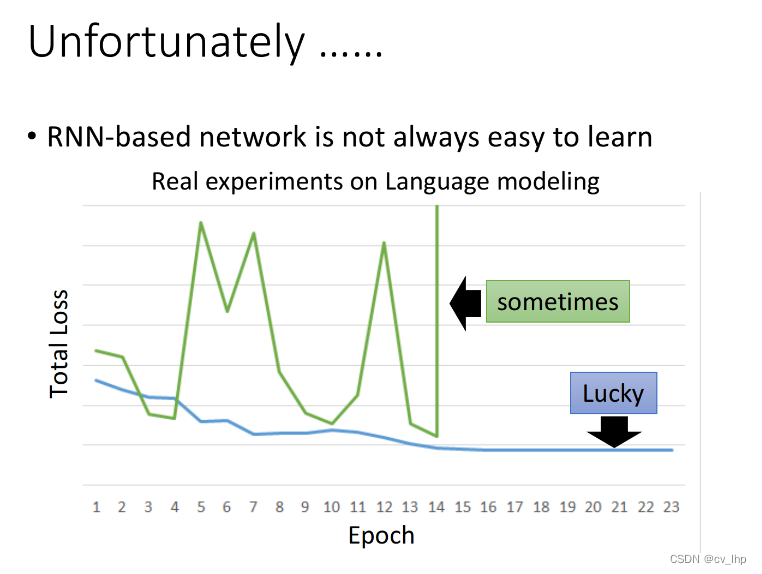

不幸的是,RNN的训练并没有那么容易

我们希望随着epoch的增加,参数的更新,loss应该要像下图的蓝色曲线一样慢慢下降,但在训练RNN的时候,你可能会遇到类似绿色曲线一样的学习曲线,loss剧烈抖动,并且会在某个时刻跳到无穷大,导致程序运行失败

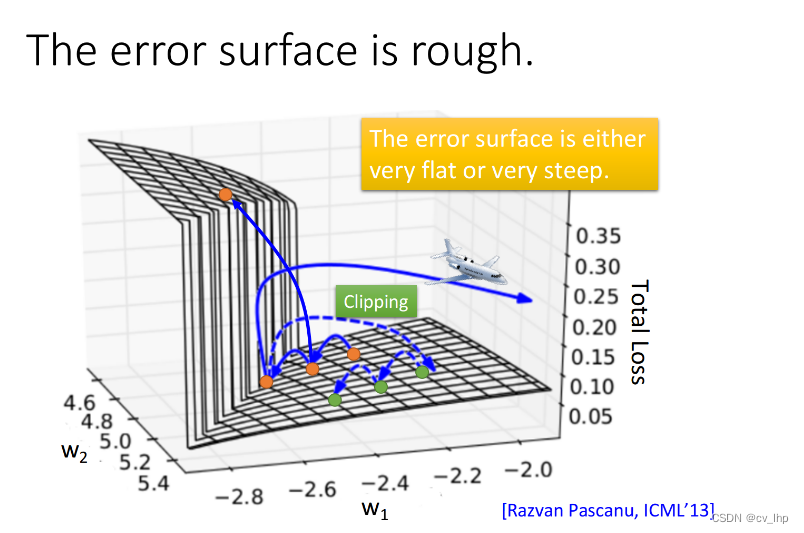

Error Surface

分析可知,RNN的error surface,即loss由于参数产生的变化,是非常陡峭崎岖的

下图中, z z z轴代表loss, x x x轴和 y y y轴代表两个参数 w 1 w_1 w1和 w 2 w_2 w2,可以看到loss在某些地方非常平坦,在某些地方又非常的陡峭

如果此时你的训练过程类似下图中从下往上的橙色的点,它先经过一块平坦的区域,又由于参数的细微变化跳上了悬崖,这就会导致loss上下抖动得非常剧烈

如果你的运气特别不好,一脚踩在悬崖上,由于之前一直处于平坦区域,gradient很小,你会把参数更新的步长(learning rate)调的比较大,而踩到悬崖上导致gradient突然变得很大,这会导致参数一下子被更新了一个大步伐,导致整个就飞出去了,这就是学习曲线突然跳到无穷大的原因

想要解决这个问题,就要采用Clipping方法,当gradient即将大于某个threshold的时候,就让它停止增长,比如当gradient大于15的时候就直接让它等于15

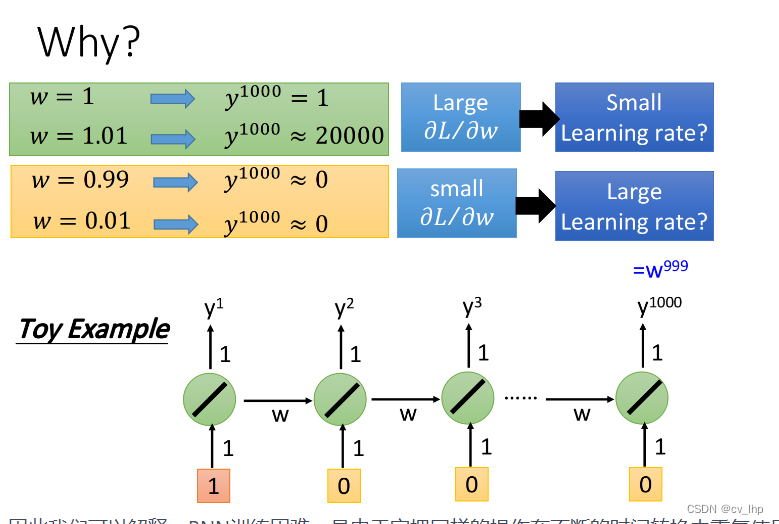

为什么RNN会有这种奇特的特性呢?下图给出了一个直观的解释:

假设RNN只含1个neuron,它是linear的,input和output的weight都是1,没有bias,从当前时刻的memory值接到下一时刻的input的weight是 w w w,按照时间点顺序输入[1, 0, 0, 0, …, 0]

当第1个时间点输入1的时候,在第1000个时间点,RNN输出的 y 1000 = w 999 y^{1000}=w^{999} y1000=w999,想要知道参数 w w w的梯度,只需要改变 w w w的值,观察对RNN的输出有多大的影响即可:

- 当 w w w从1->1.01,得到的 y 1000 y^{1000} y1000就从1变到了20000,这表示 w w w的梯度很大,需要调低学习率

- 当 w w w从0.99->0.01,则 y 1000 y^{1000} y1000几乎没有变化,这表示 w w w的梯度很小,需要调高学习率

- 从中可以看出gradient时大时小,error surface很崎岖,尤其是在

w

=

1

w=1

w=1的周围,gradient几乎是突变的,这让我们很难去调整learning rate

因此我们可以解释,RNN训练困难,是由于它把同样的操作在不断的时间转换中重复使用

从memory接到neuron输入的参数 w w w(此处W指与隐状态矩阵相乘的权重参数W),在不同的时间点被反复使用, w w w的变化有时候可能对RNN的输出没有影响,而一旦产生影响,经过长时间的不断累积,该影响就会被放得无限大,因此RNN经常会遇到这两个问题:

- 梯度消失(gradient vanishing),一直在梯度平缓的地方停滞不前

- 梯度爆炸(gradient explode),梯度的更新步伐迈得太大导致直接飞出有效区间,需要使用梯度裁剪进行解决。

Help Techniques

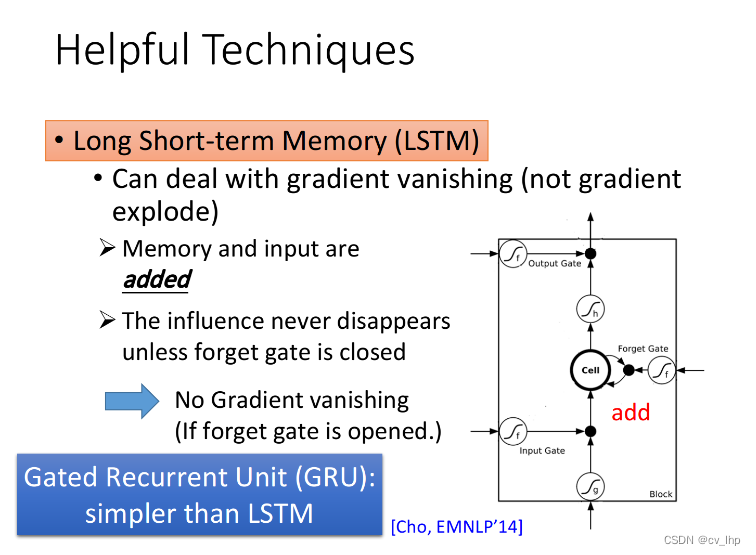

有什么技巧可以帮我们解决这个问题呢?LSTM就是最广泛使用的技巧,它会把error surface上那些比较平坦的地方拿掉,从而解决梯度消失(gradient vanishing)的问题,但它无法处理梯度崎岖的部分,因而也就无法解决梯度爆炸的问题(gradient explode)

但由于做LSTM的时候,大部分地方的梯度变化都很剧烈,因此训练时可以放心地把learning rate设的小一些

Q:为什么要把RNN换成LSTM?A:LSTM可以解决梯度消失的问题

Q:为什么LSTM能够解决梯度消失的问题?

A:RNN和LSTM对memory的处理其实是不一样的:

- 在RNN中,每个新的时间点,memory里的旧值都会被新值所覆盖

- 在LSTM中,每个新的时间点,memory里的值会乘上 f ( g f ) f(g_f) f(gf)与新值相加

对RNN来说, w w w对memory的影响每次都会被清除,而对LSTM来说,除非forget gate被打开,否则 w w w对memory的影响就不会被清除,而是一直累加保留,因此它不会有梯度消失的问题

另一个版本GRU (Gated Recurrent Unit),只有两个gate,需要的参数量比LSTM少,鲁棒性比LSTM好,不容易过拟合,它的基本精神是旧的不去,新的不来,GRU会把input gate和forget gate连起来,当forget gate把memory里的值清空时,input gate才会打开,再放入新的值

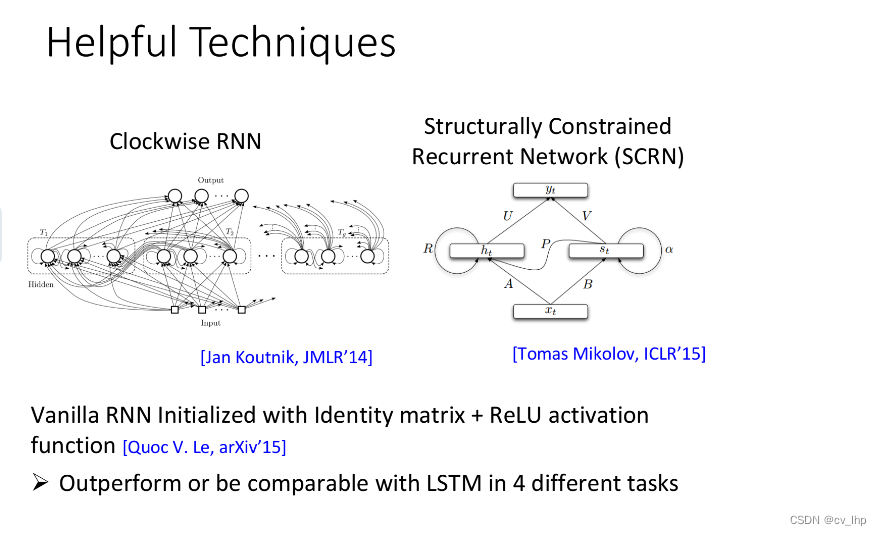

此外,还有很多技术可以用来处理梯度消失的问题,比如Clockwise RNN、SCRN等

11. 链接

循环神经网络RNN第一篇:李沐动手学深度学习V2-NLP序列模型和代码实现

循环神经网络RNN第二篇:李沐动手学深度学习V2-NLP文本预处理和代码实现

循环神经网络RNN第三篇:李沐动手学深度学习V2-NLP语言模型、数据集加载和数据迭代器实现以及代码实现

循环神经网络RNN第四篇:李沐动手学深度学习V2-RNN原理

循环神经网络RNN第五篇:李沐动手学深度学习V2-RNN循环神经网络从零实现

循环神经网络RNN第六篇:李沐动手学深度学习V2-使用Pytorch框架实现RNN循环神经网络

循环神经网络GRU第七篇:李沐动手学深度学习V2-GRU门控循环单元以及代码实现

循环神经网络LSTM第八篇:李沐动手学深度学习V2-LSTM长短期记忆网络以及代码实现

深度循环神经网络第九篇:李沐动手学深度学习V2-深度循环神经网络和代码实现

双向循环神经网络第十篇:李沐动手学深度学习V2-双向循环神经网络Bidirectional RNN和代码实现