前提说明:

相信大家最近也被Deepseek本地部署刷屏或者或多或少听过,因为现在Deepseek官网的压力有点大,很容易服务器繁忙,让想体验的人望而却步。对,我也是因为这样所以才去本地部署,先说结论:硬件条件不是很优越的不太推荐本地部署,效果并没有想象中的好,可以当做一个享受过程来本地部署。

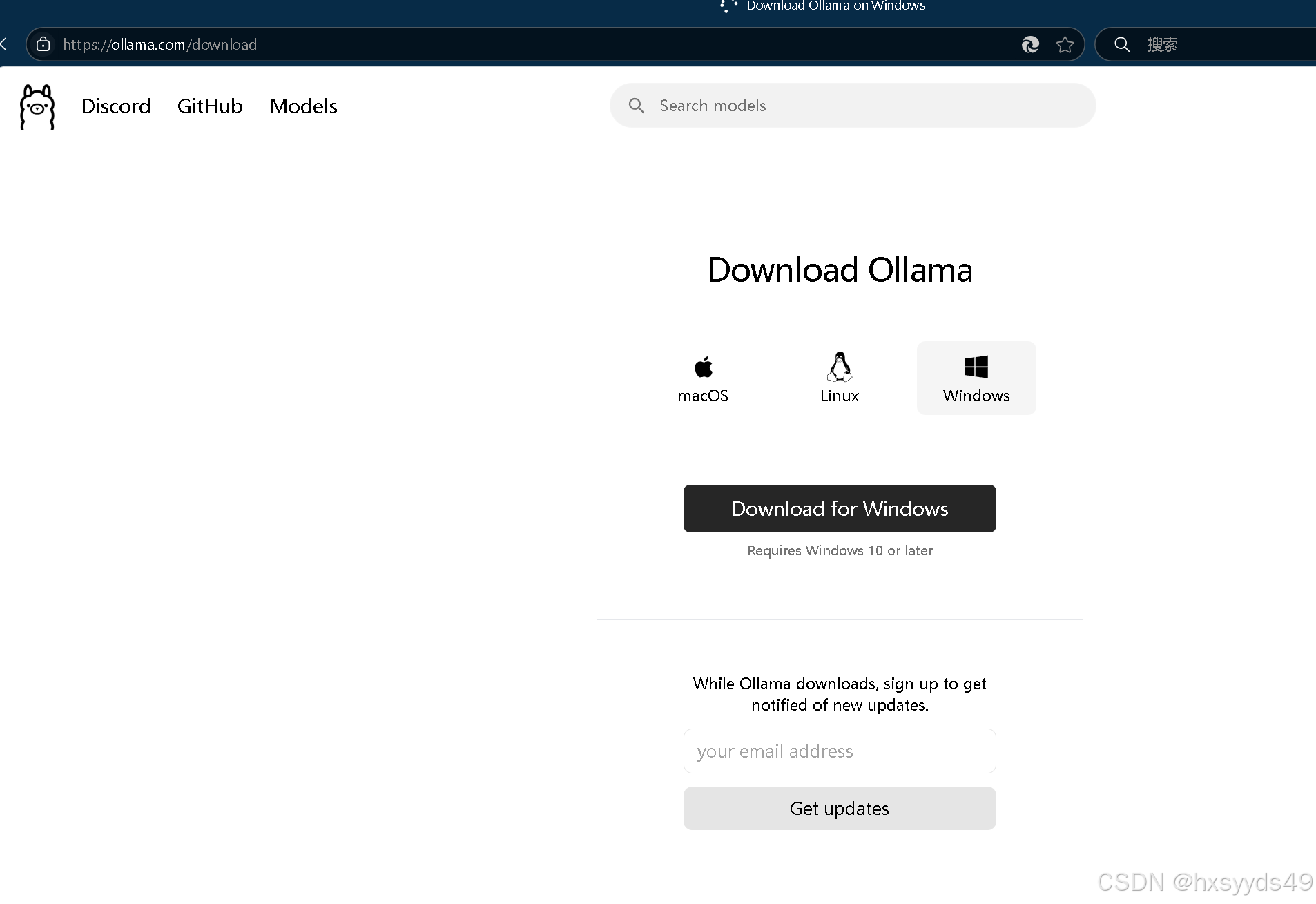

安装ollama

官网下载网址:Download Ollama on Windows。

大家可能会碰见一直网址转圈圈的情况:

当初我也很困惑很迷茫,尝试用过很多方法:用网盘下别人的资源,但不是最新的。用魔法,但也比较慢。我也是偶然的机会碰见别人评论区有人说可以用迅雷:先右键在Download for Windows上获取下载链接,然后在迅雷打开,下载速度嘎嘎快,由于ollma安装默认为c盘且在页面不能调节下载位置,所以大家可以提前看一下ollama变更安装位置的博文,这里就不多赘述了。

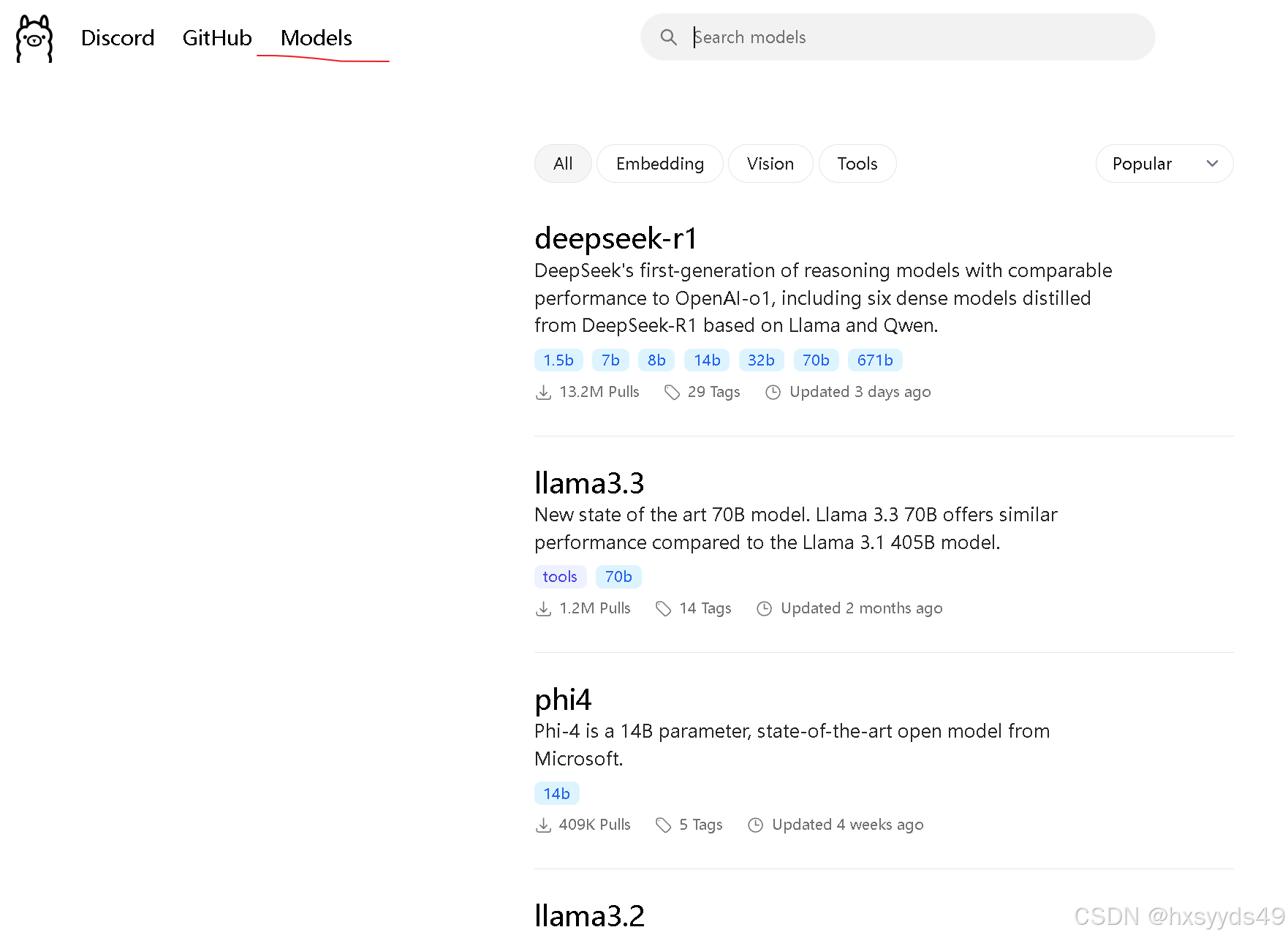

下载模型:

点击官网的models就可以看见各种各样的大模型:

第一个就是我们实操的deepseek 。

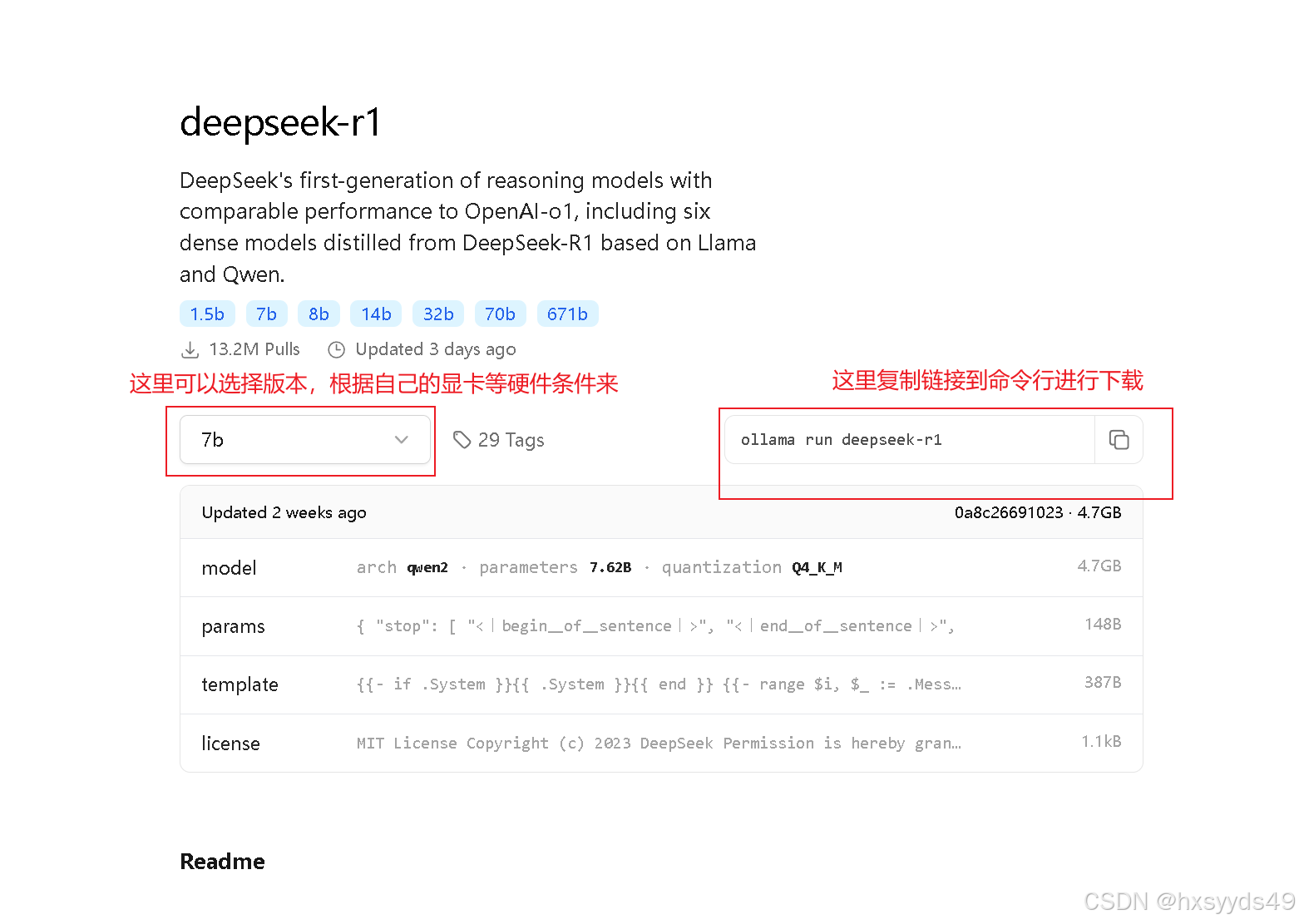

安装模型:

查看自己显卡的详细情况可以win+r,输入cmd调出命令行输入wmic path win32_VideoController get name,adapterram,DriverVersion查看显卡信息,name是名字,adapterram是显存大小(注意是字节形式的,如果想转换成gb形式则需要除以1073741824即1024*1024*1024),DriverVersion是显卡驱动程序的版本号。记住一定要适当根据显卡硬件条件来选择合适的模型大小,选择好后复制下载链接然后在命令行中输入ollama run deepseek-r1(举例),然后等待下载即可。

运行模型:

打开命令行后输入ollama list查看已经下载好后的模型列表,然后输入ollama run (这里填输入列表模型名字也就是Name)即可运行模型开始对话。

ui界面

大家可能觉得命令行操作起来不好看也不方便,这里可以用可视化ui界面操作。

先要下载docker 容器

https://www.docker.com 下载,这里依然选择Windows版

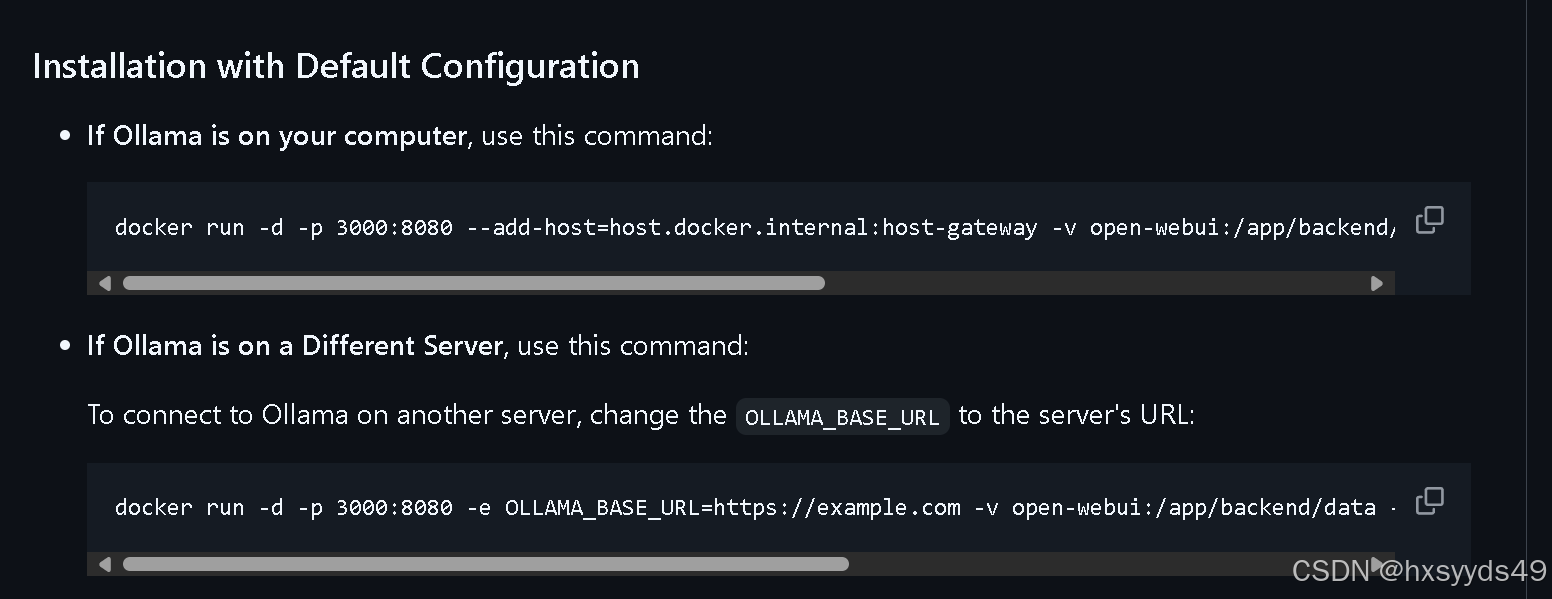

这是open-webui的下载地址:https://github.com/open-webui/open-webui

找到“If Ollama is on your computer, use this command”这一项,点击右边的按钮复制这个指令:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

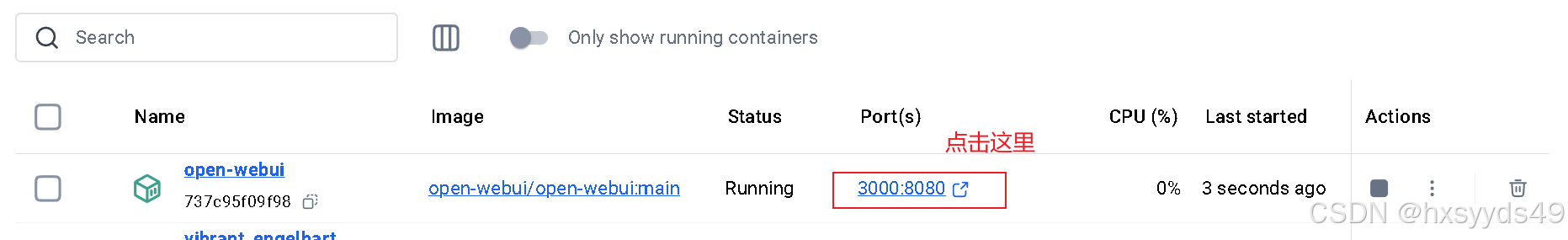

放在命令行中下载。下载完成进入docker-desktop。如下:

点击后会进入一个可视化网站界面,注册登录后即可与大模型沟通。

到此就完成啦,有什么问题可以在评论区讨论,能撑到这里你太棒了!!!