统计出每一个省份每个广告被点击数量排行的Top3

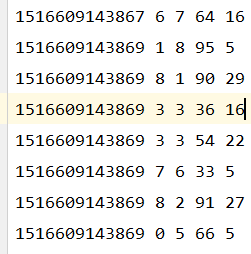

数据:时间戳,省份,城市,用户,广告(中间字段用空格分隔)

agent.log

object Spark_rdd_01 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setAppName("RDD").setMaster("local[*]")

val sc = new SparkContext(conf)

//TODO 案例实操

//1.获取原始数据:时间戳,省份,城市,用户,广告

val dataRDD: RDD[String] = sc.textFile("datas\\agent.log")

//2.将原始数据进行结构的转换,方便统计

// 时间戳,省份,城市,用户,广告

// => ((省份,广告),1)

val mapRDD: RDD[((String, String), Int)] = dataRDD.map(line => {

val value: Array[String] = line.split(" ")

((value(1), value(4)), 1)

}

)

//3.将转换结构后的数据,进行分组聚合

//((省份,广告),1)=> ((省份,广告),sum)

val reduceRDD: RDD[((String, String), Int)] = mapRDD.reduceByKey(_+_)

//4.将聚合的结果进行结构的转换

// ((省份,广告),sum)=>(省份,(广告,sum))

val newRDD: RDD[(String, (String, Int))] = reduceRDD.map {

case ((pro, adv), sum) =>{ (pro, (adv, sum))}

}

//5.将转换结构后的数据根据省份进行分组

// (省份,((广告A,sumA),(广告B,sumB)))

val groupRDD: RDD[(String, Iterable[(String, Int)])] = newRDD.groupByKey()

//6.将分组后的数据组内排序(降序),取前3名

val rdd: RDD[(String, List[(String, Int)])] = groupRDD.mapValues(

iter=>{iter.toList.sortBy(_._2)(Ordering.Int.reverse).take(3)})

//7.采集数据打印在控制台

rdd.collect().foreach(println)

sc.stop()

}

}(8,List((29,1), (27,1)))

(6,List((16,1), (21,1)))

(0,List((5,1)))

(7,List((5,1)))

(3,List((22,1), (16,1)))

(1,List((6,1), (5,1)))