一、概述

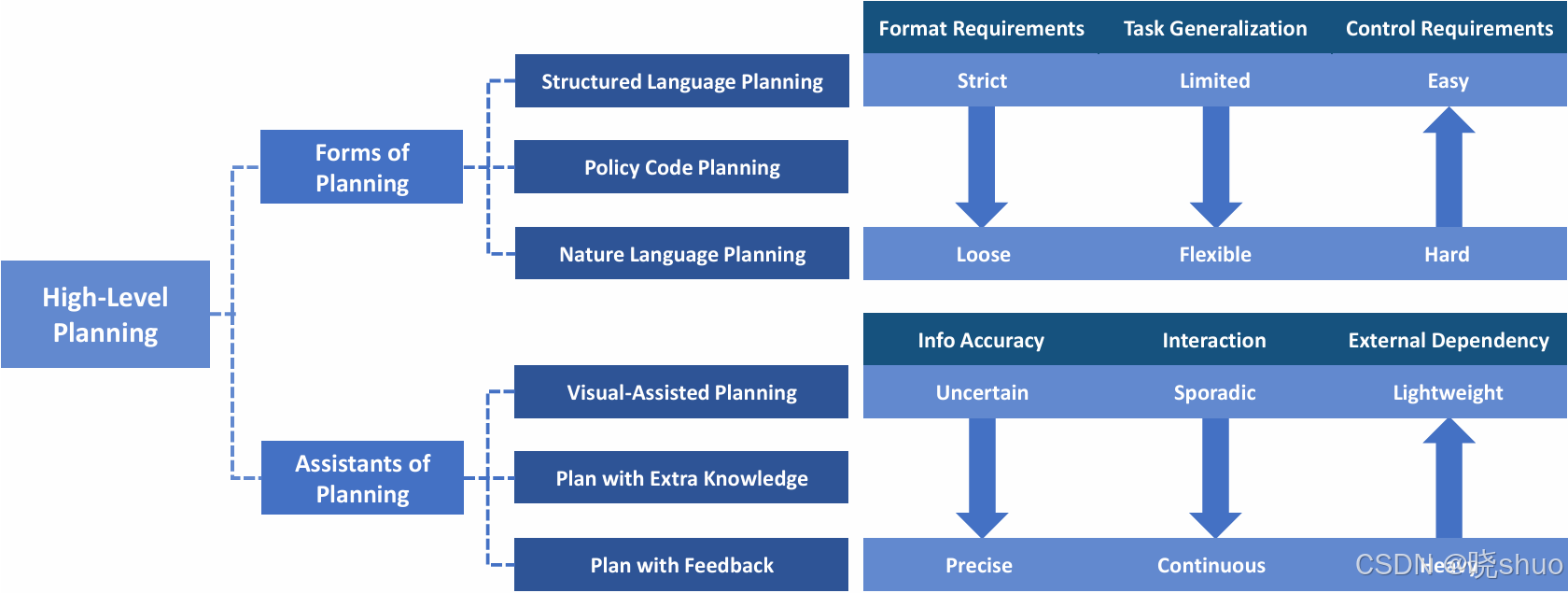

高层任务规划(High-level Task Planning)是机器人技术中的关键环节,它涉及将用户的自然语言指令解析并分解为多个可执行的子任务,进而逐步生成可执行的行动序列。这一过程不仅要求机器人具备理解复杂任务指令的能力,还需要它能够推理出完成任务所需的步骤和顺序。

二、标准化规划

2.1 结构语言规划

PDDL(Planning Domain Definition Language)是用于定义机器人规划问题的标准化语言系列。其标准化特性使得研究成果易于复用和比较,是自动化规划领域的重要工具。然而,PDDL在面对复杂、高维的任务时表达能力有限,无法完全捕捉动态和未定义的情境。

Foundation Models(如GPT-4)通过将自然语言指令转化为PDDL描述,再结合标准PDDL规划器解析,可以实现任务的自动化分解和执行。解析结果可以进一步转化为有限状态自动机、可执行的代码或自然语言反馈,提升了规划的可解释性和执行效率。例如,某项任务如“在桌面上整理物品”,LLMs可以将其映射到PDDL的多个操作步骤,结合任务解析器生成清晰的规划路径。

2.2 策略代码规划

策略代码规划(Policy Code Planning)将自然语言指令分解为代码形式的有序步骤。这种方法具备高度的结构化和顺序敏感性,特别适用于复杂、多步骤任务。代码规划的优势在于:

-

准确描述对象的空间位置和唯一参考,解决模糊表达问题。

-

具备表达函数、反馈循环及参数化控制的能力,适配高精度任务场景。

例如,Code as Policies (CaP) 通过复杂的提示工程,利用LLMs生成可执行程序,并递归定义新的函数,从而实现任务的泛化能力。ProgPrompt进一步创新,将世界状态编码成自然语言后嵌入提示词,使LLMs能够自动生成逻辑清晰的策略代码。例如,在“将书本放置在书架上”的任务中,代码规划会描述具体的抓取、移动和放置操作,确保任务执行的准确性。

2.3 自然语言规划

自然语言规划(Natural Language Planning)是Foundation Models固有的能力,直接利用自然语言生成规划步骤,具备极强的可解释性和与人类交互的友好性。然而,自然语言表达可能存在:

-

歧义性:同一指令可能存在多种解释;

-

缺乏精确性:难以提供细粒度的操作指令。

为了解决这些问题,CAPEAM通过子目标规划器从任务指令中提取出明确的子目标和具体对象,减少歧义。同时,外部模型会对提取的子目标进行验证,确保其可行性、正确性和清晰度。例如,在“摆放桌上的物品”任务中,系统会先分解出子目标:“找到物品”、“抓取物品”、“放置到目标位置”,逐步完成整个任务。

三、辅助规划

3.1 视觉辅助规划

视觉辅助规划(Visual-Assisted Planning)通过将视觉模型与LLMs结合,提供环境感知和目标识别功能,弥补语言指令中对空间和视觉信息的缺失。

-

Inner Monologue 将视觉模型(如目标检测、物体识别)的输出结果直接融入到LLMs的提示中,动态规划或重新规划任务步骤。

-

SayCan 通过视觉模型预测技能执行的成功概率,与LLMs生成的技能概率相结合,动态选择最优操作步骤。

此外,视觉语言模型(VLMs)如GPT-4V能够直接结合视觉和语言信息,生成更准确的任务规划方案。例如,机器人在“拾取红色杯子”任务中,视觉辅助可以提供物体定位,结合LLMs完成抓取动作的动态规划。

3.2 先验知识规划

先验知识规划(Plan with Extra Knowledge)将外部的常识知识或领域知识与Foundation Models结合,以解决任务规划中的知识缺失问题。例如:

-

CAPEAM 使用环境感知内存系统记录物体位置等信息,增强任务互动能力。

-

PLAN 从外部常识知识库提取相关信息,并嵌入LLMs提示词中,提升任务推理的合理性。

例如,在“使用咖啡机制作咖啡”任务中,系统会结合先验知识(如咖啡机的使用步骤和常见故障),提高规划任务的成功率。

3.3 反馈规划

反馈规划(Plan with Feedback)通过实时反馈调整规划步骤,适应动态变化的任务环境。这种方法包括:

-

环境反馈:从执行结果中获取成功或失败的信号,动态更新计划。

-

Inner Monologue 使用执行信号作为反馈,闭环调整任务规划。

-

人类反馈:通过人机交互的方式提供实时指导。

-

IRAP 通过问答交互获取关键信息(如目标位置),优化任务执行路径。

例如,在“整理桌面”任务中,机器人可以根据实时反馈(如检测到桌面仍有未整理物品)重新规划未完成的步骤,确保任务的完成。

参考文献

[1] Xu Z, Wu K, Wen J, et al. A survey on robotics with foundation models: toward embodied ai[J]. arXiv preprint arXiv:2402.02385, 2024.