1. Roberta Prompt Turning的概念

在了解预训练语言模型的基础,以及预训练语言模型在Pre-training和Fine-tuning之后,我们已经可以预想到 Prompt的目的是将Fine-tuning的下游任务目标转换为Pre-training的任务 。

Prompt-Tuning起源于GPT-3的提出《Language Models are Few-Shot Learners》(NIPS2020),其认为超大规模的模型只要配合好合适的模板就可以极大化地发挥其推理和理解能力。

2 实践

2.1 配置环境

安装mindnlp 套件

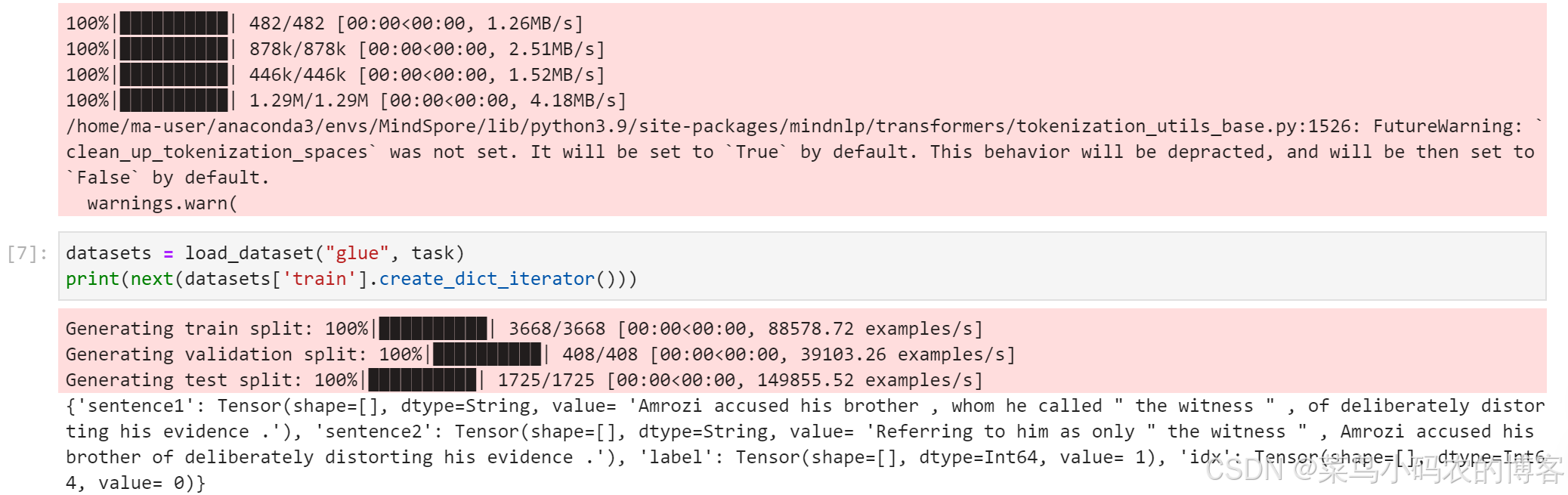

2.2 模型与数据集加载

本案例对roberta-large模型基于GLUE基准数据集进行prompt tuning。

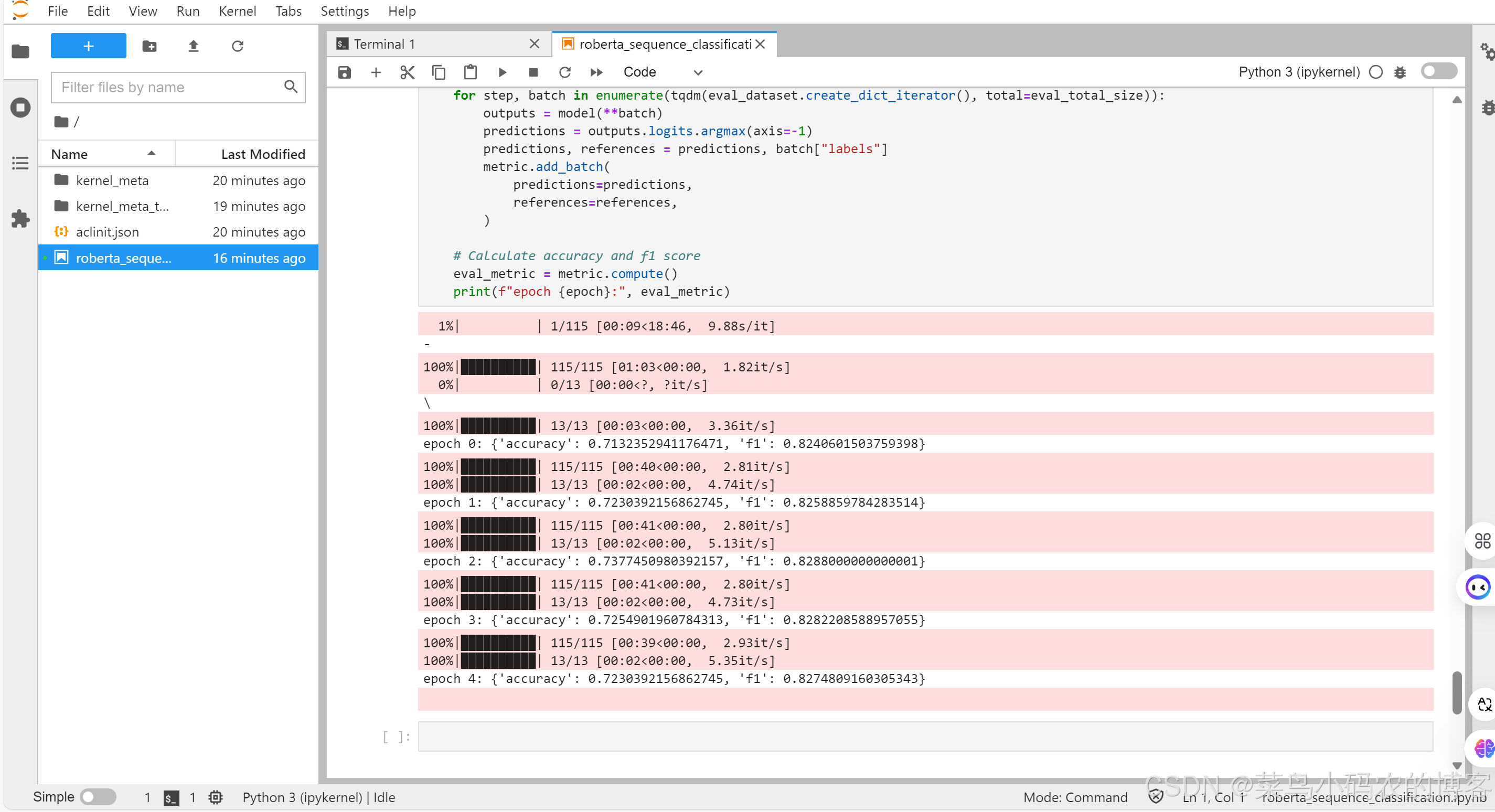

2.3 模型微调(prompt tuning)

按照如下步骤定义训练逻辑:

- 构建正向计算函数

- 函数变换,获取微分函数

- 定义训练一个step的逻辑

- 遍历训练数据集进行模型训练,同时每一个epoch后,遍历验证数据集获取当前的评价指标(accuracy、f1 score)

3. 感悟

每节课的深度在不断增加,对于初学者确实有些难度,很多概念也是云里雾里,但是对于模型的架构还是有一个比较清晰的概念。对于模型与数据的加载以及模型的训练也更加熟悉。对于模型的微调也有了一个更清楚的认识。也了解了大模型通过提供“提示”来鼓励预先训练的模型做出特定的预测,指定要完成的任务。这对于大模型是一个非常重要的概念,也让我们更理解大模型运行的原理。