U2-Net(U-square Net)是一个针对图像分割任务,特别是 显著性目标检测(salient object detection) 的深度学习模型。该模型提出了一种创新的 U-Net 架构的变种,目标是通过高效且精确地从复杂背景中分离出显著目标(即图像中最重要或最引人注意的部分)。U2-Net 在分割任务中表现出色,尤其在显著性检测、边缘检测、图像分割等应用领域中,已被广泛采用。

1. U2-Net 的设计背景与目标

U2-Net 的设计灵感源于 U-Net,这是一种经典的卷积神经网络架构,通常用于医学图像分割任务。U-Net 通过使用 编码器-解码器结构(encoder-decoder)来实现图像的高效分割,它通过下采样(编码器)和上采样(解码器)过程,在不同的尺度上提取和恢复图像特征。

然而,U-Net 在处理 复杂背景与显著目标分离 任务时,仍然面临着一些挑战。例如,背景信息与显著目标可能在空间上非常接近,而传统的 U-Net 结构可能不够灵活,无法处理背景噪声对目标提取的影响。U2-Net 通过在原始 U-Net 架构基础上进行了创新,增加了多个 多尺度的特征融合 机制,以提高模型在复杂场景中的鲁棒性和精确度。

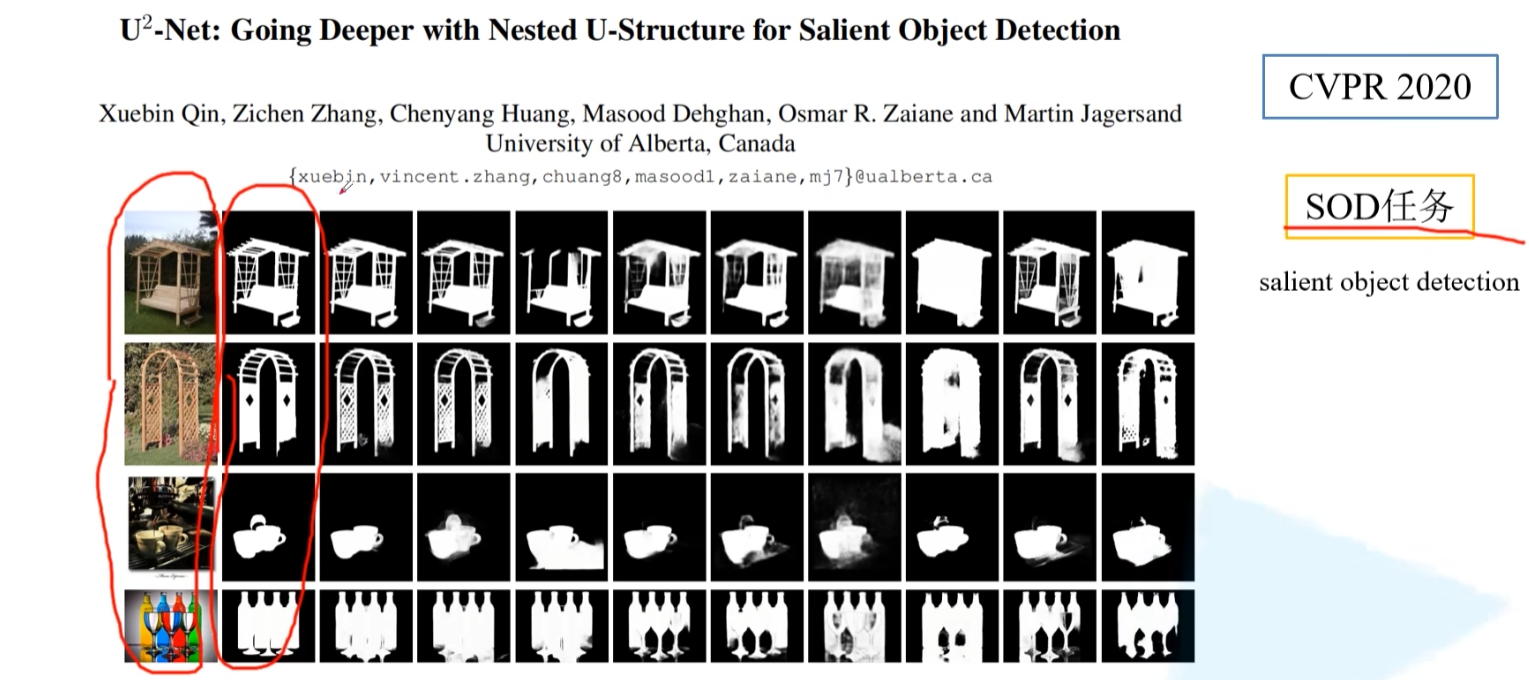

下图中第一列是原图,第二列是ground truth,第三列是网络分割的结果,第四列是轻量版的U2-NET分割的结果,第四列以后的都是当时主流的网络分割结果。

2. U2-Net 的架构

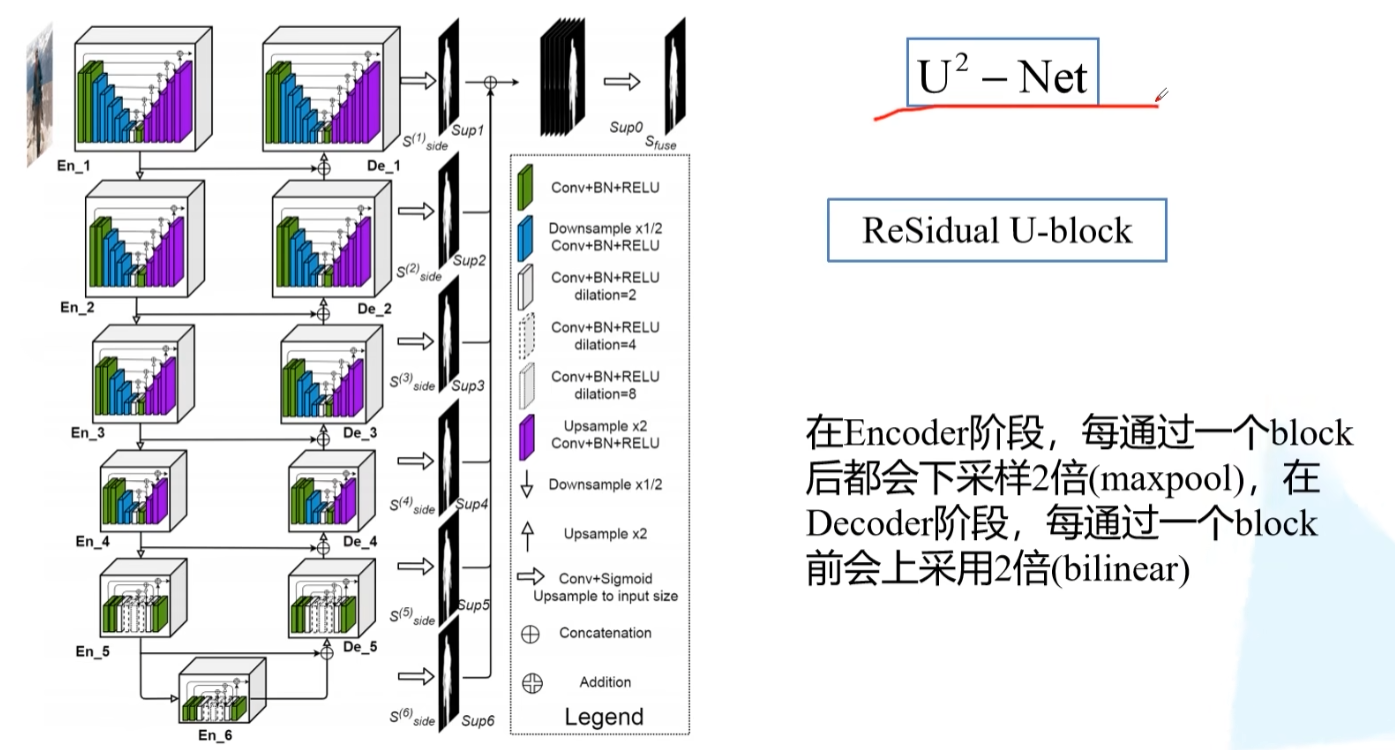

U2-Net 是基于 U-Net 的架构,但引入了两大创新特性:双重 U-Net 结构 和 高效的特征融合。具体来说,U2-Net 包含以下主要组件:

-

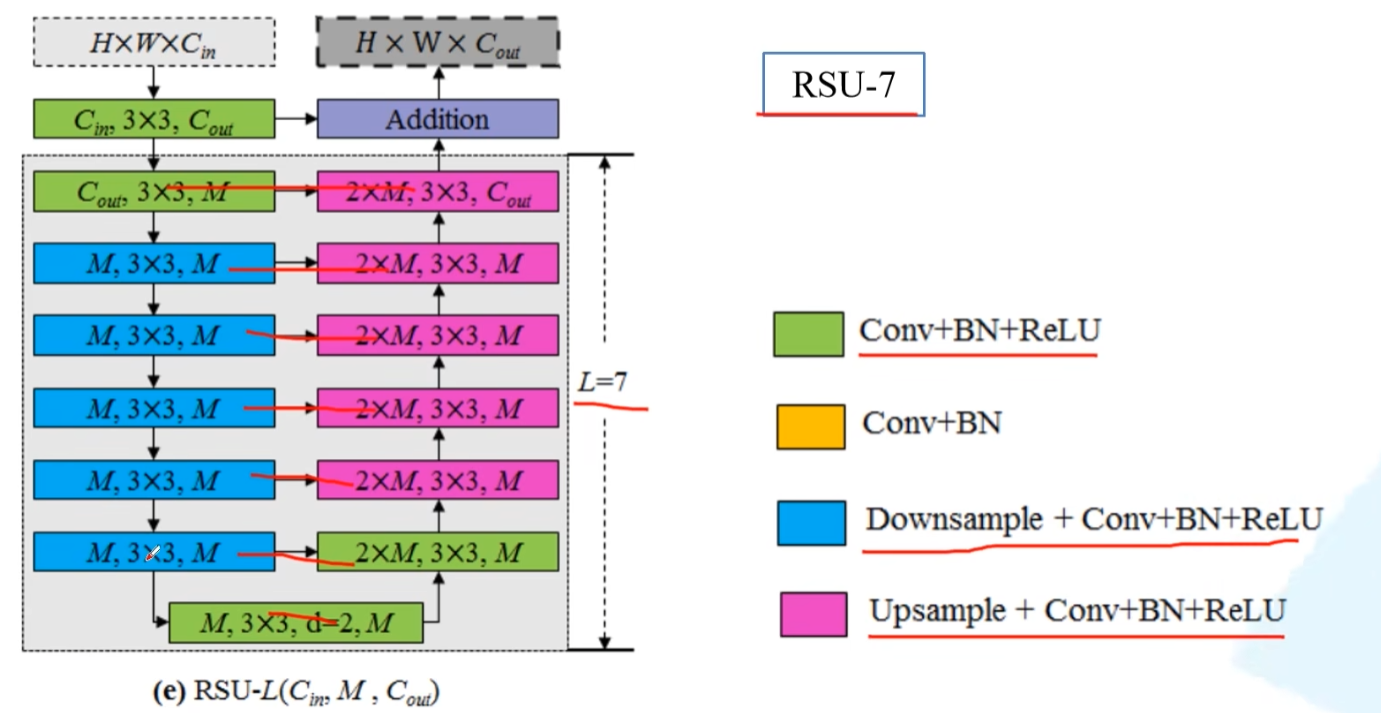

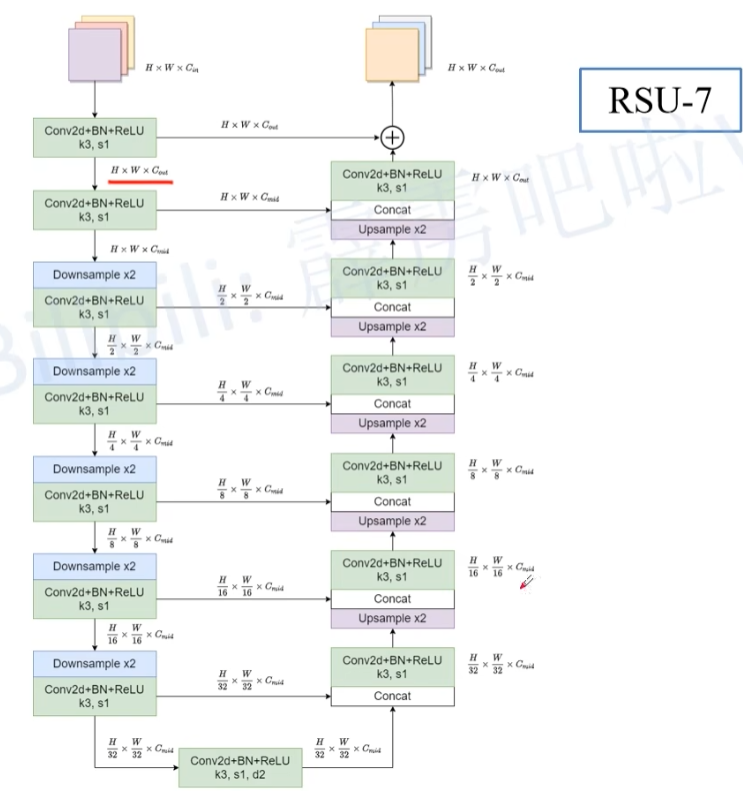

双重 U-Net 结构(U²-Net):U2-Net 的核心思想是利用多个 U-Net 子网络 来捕捉不同尺度上的特征,并通过融合不同尺度的信息来提高分割精度。相比于传统的 U-Net 模型,U2-Net 引入了额外的分支结构,使得网络能够同时从多个层次进行信息融合,从而获得更精确的显著目标分割。每个子网络都可以看作是一个 U-Net,该网络通过 下采样 和 上采样 两个阶段来提取并恢复图像的多层特征。然后这些特征会通过融合层进行合并,以提取更多的空间信息。

-

U-Net 中心对称的设计:U2-Net 在 U-Net 的基础上优化了结构,尤其是在解码器部分。传统的 U-Net 通常在解码阶段通过跳跃连接将编码器中的特征图与解码器中的特征图进行结合。而 U2-Net 进一步加强了这种结构,通过 中心对称结构 实现多尺度特征的融合与重构。

-

多尺度特征融合:U2-Net 的创新之一是将多尺度信息进行融合,通过多个并行的网络分支提取不同层次的特征,并通过注意力机制或其他融合方法将这些特征有效组合。这样一来,U2-Net 能够在不同尺度上精确地定位目标,并减少背景噪声的干扰。

-

U2-Net 输出的特征图:该模型的输出包括 显著性图(saliency map),该图呈现了图像中最显著部分的位置。通过对比显著性图与原始图像,模型能够分割出最引人注目的目标。

-

深度监督(Deep Supervision):U2-Net 采用了深度监督的技术,即在网络的不同层次上都进行损失函数计算,帮助网络在训练过程中更好地学习不同层次的特征。这有助于增强模型的学习能力,特别是在深层网络中的特征训练。

-

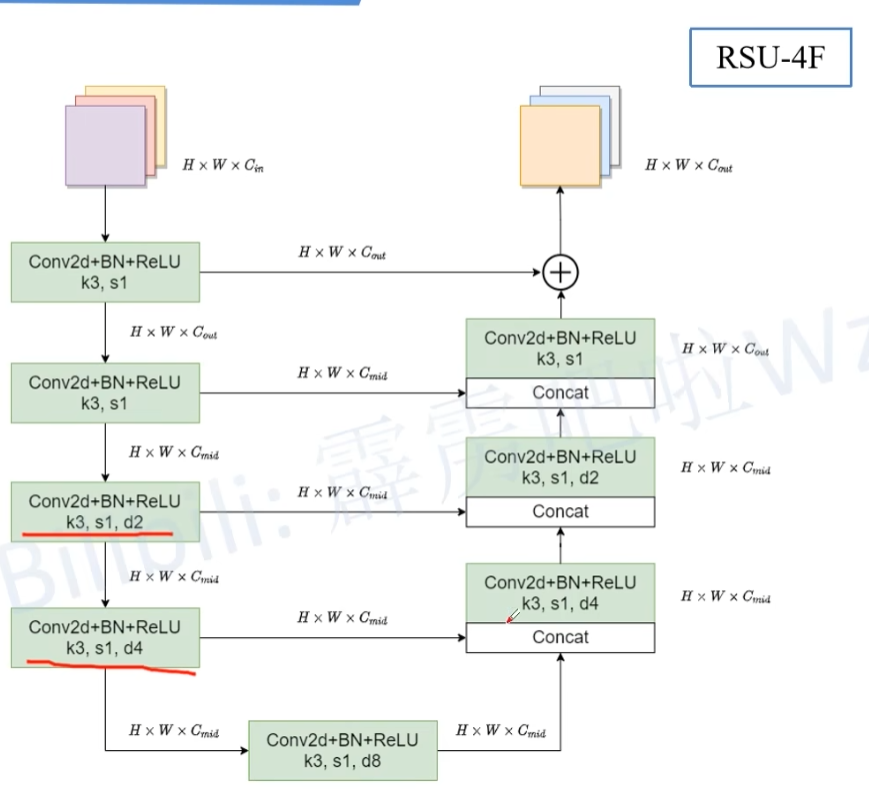

- 注意看下图的RSU-4F网络结构中,左和右下侧有五个膨胀卷积,膨胀系数分别是2,4,8,4,2.

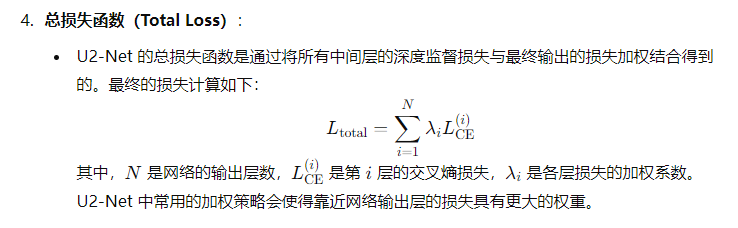

3. 损失函数与评价指标

3. U2-Net 的特点与优势

-

高效的显著性目标检测:U2-Net 专注于 显著性目标检测,它能够在复杂背景中高效地分割出最引人注目的目标。通过多尺度特征的融合,U2-Net 能够更好地捕捉目标的细节,特别是在复杂的场景中,如人脸分割、物体检测等任务中表现突出。

-

出色的精度和鲁棒性:与传统的 U-Net 模型相比,U2-Net 具有更高的精度和更强的鲁棒性,尤其在处理复杂背景和细粒度目标时,能够提供更高质量的分割结果。

-

小巧且高效的模型:尽管 U2-Net 结构较为复杂,但它依然能在不需要过多计算资源的情况下取得优异的表现。这使得 U2-Net 在实际应用中非常高效,尤其适用于对计算资源有限制的场景。

-

广泛的应用场景:U2-Net 可以应用于 图像分割、目标检测、显著性检测、医学图像分析、人脸分割、视频分析 等多种任务。它能够在复杂环境中精准地从背景中分离出目标,在许多计算机视觉应用中具有较大的潜力。

4. U2-Net 的应用场景

-

显著性目标检测:在传统的显著性目标检测任务中,U2-Net 可以从图像中精确地分割出最为显著的目标,无论是静态图片还是动态视频。这对于自动化标注、内容分析等任务非常有用。

-

医学图像分割:在医学图像分析中,U2-Net 可以用于分割 肿瘤、器官、病变区域 等。通过高效地分割显著区域,U2-Net 可以辅助医生进行诊断、规划治疗方案等。

-

人脸分割与分析:在人脸识别、面部表情分析等应用中,U2-Net 可以准确地分割出人脸区域,尤其在复杂背景下,能够有效区分出人脸与背景。

-

图像增强和修复:在图像修复任务中,U2-Net 可以帮助恢复图像中的缺失部分,特别是当缺失区域属于显著目标时,模型的准确性非常高。

-

视频分析:对于视频分析任务,U2-Net 可以通过对每帧的显著性目标检测,帮助实现目标追踪、运动分析等功能。

5. 训练与性能

U2-Net 的训练过程相对标准,使用了 交叉熵损失函数 来优化模型的显著性图输出。训练过程中,U2-Net 采用了 深度监督(deep supervision)来帮助网络更好地学习中间层的特征,提高训练稳定性和最终模型的精度。

在性能上,U2-Net 在多个显著性检测的标准数据集上,如 DUTS, ECSSD, DUT-OMRON 等,均表现出了非常高的 精度 和 鲁棒性,且训练速度和推理速度也都保持较为高效。

附:什么是SOD任务

SOD(Salient Object Detection,显著性目标检测)**任务是计算机视觉中的一个重要任务,旨在自动识别和分割图像中的显著目标或最引人注目的部分。显著目标通常是图像中最为重要或最突出的人物、物体或区域。该任务的目标是从复杂的背景中提取出这些显著目标,以便进行后续的分析或处理。

SOD任务的核心目标

SOD任务的核心目标是根据图像的内容,通过算法自动检测出图像中最具显著性(即最能吸引视觉注意力)的区域。这些显著区域通常是图像的主体部分,可能是人、动物、物体或其他重要区域。显著性目标检测不仅是图像分割的一个特殊应用,它与其他任务(如目标检测、图像理解等)密切相关。

SOD任务的具体流程

-

输入图像:输入的是一幅自然图像,通常是带有复杂背景和不同尺度、形状、颜色等多样化对象的场景。

-

目标检测:SOD模型通过神经网络或者传统算法,基于图像的视觉特征(如颜色、纹理、边缘、亮度等)来判断图像中哪些部分是最显著的。这些显著区域可能是物体、人物、重要细节等。

-

输出显著图(Saliency Map):SOD模型的输出通常是一个二值化的显著图(saliency map),或者是一个与输入图像相同大小的概率图,表示图像每个像素在图像中的显著性程度。显著性图中的高值区域对应着图像中的显著目标,低值区域通常表示背景或无关区域。

-

分割显著目标:在某些应用中,SOD不仅仅输出显著性图,还需要进行 图像分割,即精确分割出显著目标区域。这个任务也可以通过图像阈值化或语义分割等方法来实现。

SOD任务的应用

显著性目标检测在多个领域有广泛应用,尤其是与视觉理解相关的任务。常见的应用包括:

-

图像分割:

- 在许多计算机视觉任务中,图像分割需要将图像中的重要区域与背景分离。SOD任务可以帮助准确提取图像中的显著目标,进而进行精确分割,应用于 医学图像分割(如肿瘤检测)、人脸检测、图像编辑 等任务。

-

目标检测与识别:

- SOD模型有助于在复杂背景中定位和识别目标。在自动驾驶、视频监控等任务中,通过显著性检测可以帮助系统更好地识别重要目标,如行人、交通标志、车辆等。

-

图像检索:

- 在图像检索系统中,SOD任务可以帮助从大量图像中提取出最具显著性的区域,提高图像检索的准确性和效率。

-

视频分析:

- 在视频分析中,SOD任务用于动态检测视频帧中的显著目标,可以应用于 视频摘要、目标追踪、行为识别 等。

-

图像修复与编辑:

- 在图像修复或编辑任务中,显著性目标检测有助于识别图像中需要修复或处理的重要区域,从而实现更高效的修复、去除不需要的物体或替换背景等操作。

-

自动化标注:

- SOD可以用于自动标注图像中的重要区域,为图像数据集的标注工作提供帮助。

SOD任务的挑战

显著性目标检测在实际应用中面临着许多挑战,包括:

-

复杂背景:

- 在一些场景中,背景可能与显著目标非常相似,或者背景本身也包含有意义的信息。如何在复杂背景中区分显著目标与干扰信息是SOD任务的一大难点。

-

目标尺度变化:

- 图像中的显著目标可能具有不同的尺度、形状和位置,这要求模型能够处理尺度不变性和形态多样性。

-

光照变化:

- 图像的光照条件可能发生变化,这可能导致显著目标的颜色、亮度等特征发生变化,从而影响模型的准确性。

-

目标遮挡:

- 目标可能部分遮挡,导致显著目标的一部分信息丢失。如何从部分信息中准确恢复目标形态是SOD任务中的另一个挑战。

-

数据稀缺性:

- 显著目标检测通常需要大量标注数据用于训练,而高质量的标注数据集相对较少,且人工标注显著性目标是一项复杂且主观的任务。

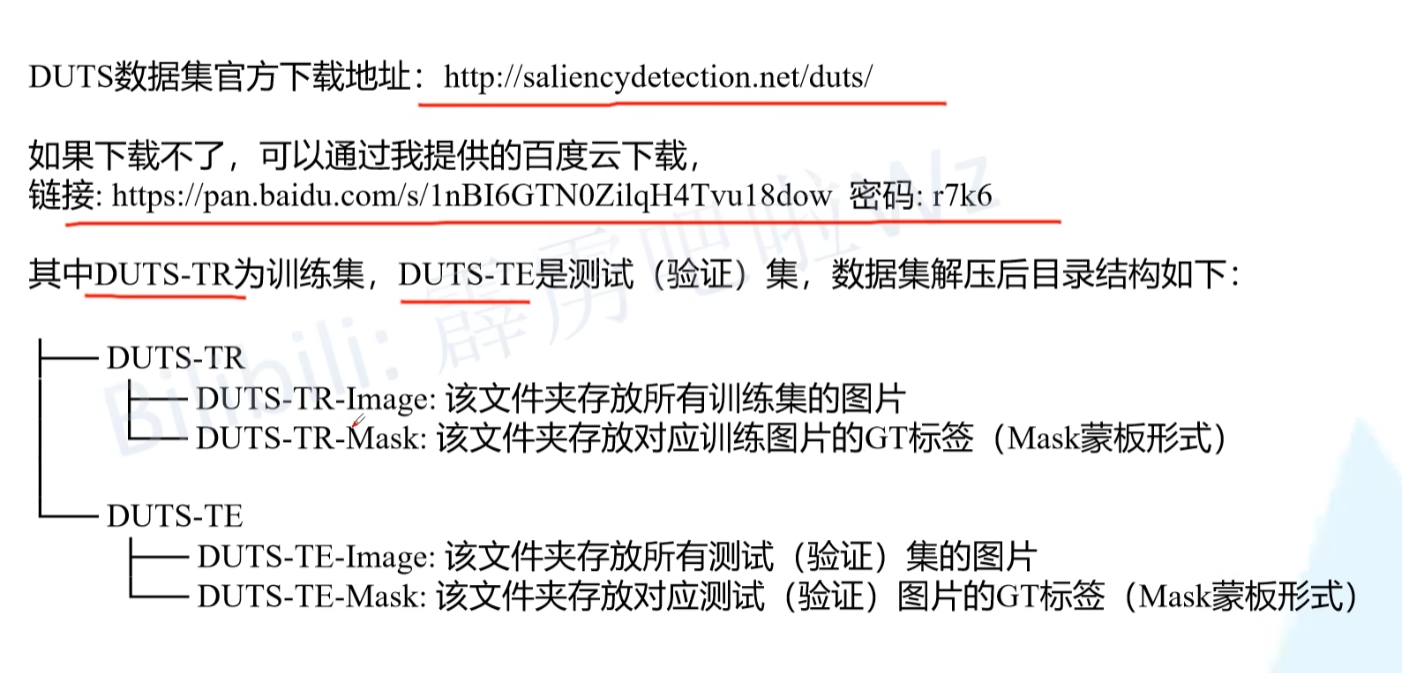

DUTS数据集

DUTS(The DUTS Dataset) 是一个广泛用于显著性目标检测(Salient Object Detection,SOD)任务的图像数据集。它包含了大量的自然图像,旨在为显著性目标检测算法提供标准化的评估基准,帮助推动该领域的研究和技术发展。

DUTS 数据集由中国的 Dalian University of Technology(大连理工大学)提出,并由其计算机视觉研究小组在2017年发布。该数据集包含了多样化的图像内容,覆盖了多种场景和显著性目标,主要用于评估显著性目标检测算法的性能,尤其是在自然图像环境下的应用。

DUTS 数据集的基本情况

-

数据集大小:

- DUTS 数据集 共包含 10,553 张训练图像和 5,019 张测试图像。总计约有 15,572 张图像。

-

图像内容:

- DUTS 数据集中的图像涵盖了丰富的场景,包括 室内外环境、城市街道、自然景观、人脸、动物、物体 等多种类别。图像中的显著目标通常是图像的主要对象,可能是 人、动物、交通标志、建筑物 等。

-

标注信息:

- 对每张图像都有相应的 显著性图(Saliency Map) 作为标签,显著性图是二值图,其中每个像素点的值表示该像素是否属于显著目标(1表示显著目标,0表示背景)。

- 这些显著性图是通过人工标注得到的,标注人员根据图像内容手动标出显著目标区域。显著性目标通常是图像中的主要物体或区域。

-

图像特点:

- 图像内容丰富多样,涵盖了复杂背景和各种尺度、形状、颜色的显著目标。这使得该数据集非常适合用于评估显著性目标检测算法在不同条件下的鲁棒性。

- 许多图像中的显著目标存在 遮挡、模糊 或 光照变化,这些因素增加了模型训练和评估的难度。

DUTS 数据集的构成

DUTS 数据集分为两个主要部分:

- DUTS-TR(Training Set)训练集包含 10,553 张图像,用于训练显著性目标检测模型。训练集的图像涵盖了不同场景、对象和复杂背景,旨在帮助模型学习到泛化能力强的特征。

- DUTS-TE(Test Set)测试集包含 5,019 张图像,用于评估模型在真实世界场景中的性能。测试集同样涵盖了各种不同类型的图像和背景,要求模型能够从复杂的环境中分离出显著目标。

DUTS 数据集的特点

-

复杂背景:DUTS 数据集中的图像大多数来自日常生活中的复杂场景,背景通常包含较多噪声或干扰信息。这使得显著性目标的检测不仅要识别目标本身,还需要有效地忽略不相关的背景区域。

-

显著目标的多样性:显著目标在图像中的位置、形状、大小、颜色都具有很大的变化。例如,一些目标可能非常小或部分被遮挡,而其他目标则可能占据图像的大部分区域。

-

多尺度与多样本:DUTS 数据集中的图像含有多种尺度和不同层次的显著目标。这些显著目标的尺寸变化很大,从极小的物体到占据大部分图像的对象都可以见到。

-

高质量标注:DUTS 数据集的显著性图是由人工标注的,每个图像的显著性目标都经过精细标定。标注遵循严格的标准,保证了数据集的高质量和准确性。

-

广泛应用:由于其标注的精确性和图像的多样性,DUTS 数据集广泛应用于显著性目标检测、图像分割和目标识别等任务的研究。