开放式界面助手

核心原理

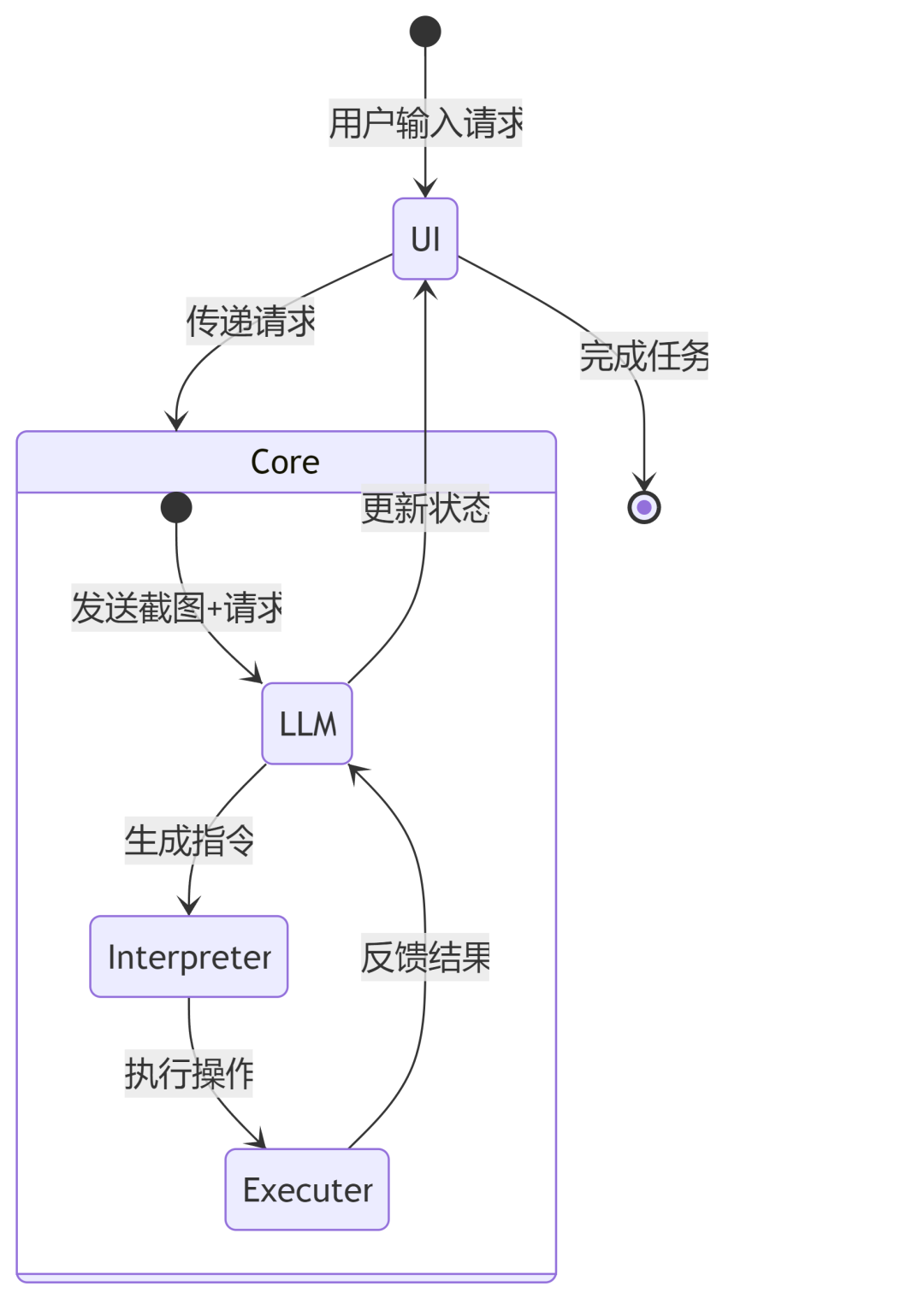

这是一个基于大语言模型(LLM)的自动化界面操作系统。它通过截取屏幕画面,将用户需求转化为具体的鼠标键盘操作指令,并能实时监控执行效果进行修正。整个系统采用模块化设计,实现了从用户输入到界面操作的完整闭环。

模块详解

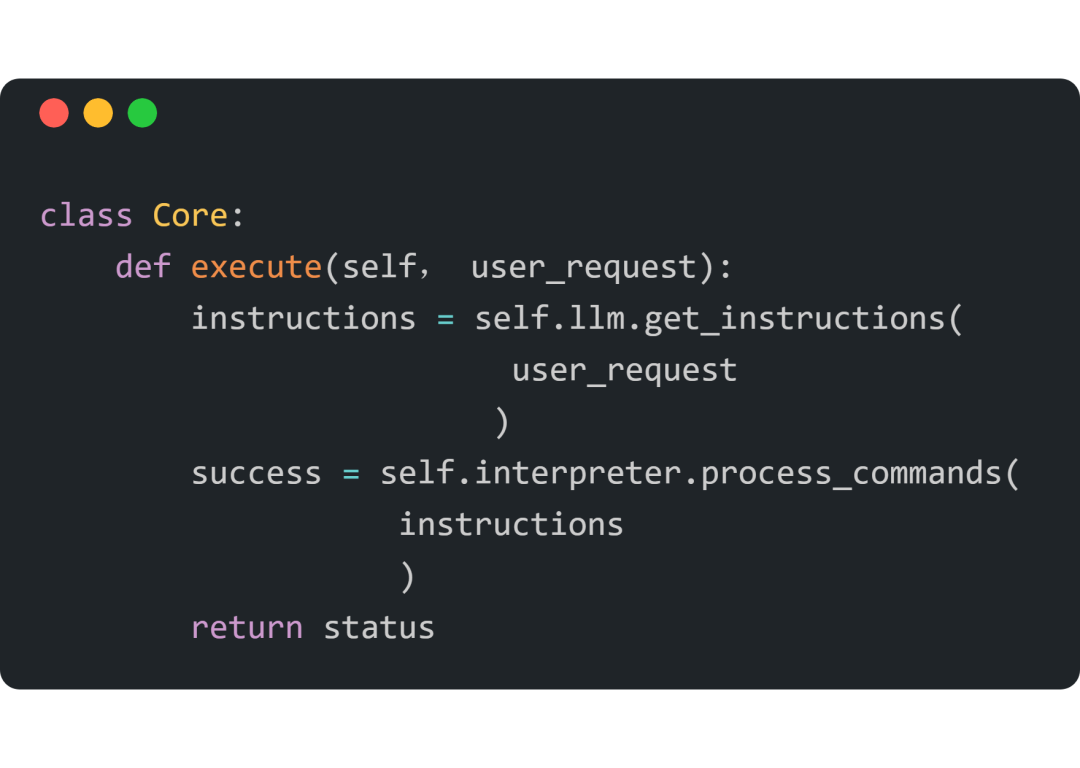

1. 核心控制模块 (Core)

输入: 用户请求文本

输出: 执行状态反馈

实现原理: 协调 LLM、解释器和执行器三个关键组件的工作流

2. LLM 模块

输入: 屏幕截图和用户请求

输出: JSON格式的操作指令

实现原理: 调用OpenAI API,将视觉和文本信息结合分析,生成具体操作步骤

3. 解释器模块 (Interpreter)

输入: JSON格式指令

输出: 具体的鼠标键盘操作

实现原理: 将高级指令转换为底层的界面操作命令

系统流程图

补充说明

采用多线程设计,UI和Core分别运行在独立线程中,通过队列通信

支持中断机制,用户可随时停止正在执行的操作

提供可扩展的模型工厂,支持接入不同的LLM后端

开源项目:

https://github.com/AmberSahdev/Open-Interface

近期推荐: