为大模型提供webui界面的利器:Open WebUI

Open WebUI的官网:🏡 Home | Open WebUI

开源代码:WeTab 新标签页

Open WebUI是一个可扩展、功能丰富、用户友好的自托管AI平台,旨在完全离线运行。它支持各种LLM运行程序,如Ollama和OpenAI兼容的API,内置RAG推理引擎,使其成为一个强大的AI部署解决方案。

安装

使用pip进行安装:

pip install open-webui依赖软件较多,需要安装一段时间。

启动服务

使用如下命令启动open-webui服务:

open-webui serve启动后运行的东西不少,需要一些时间:

(py311) E:\github> open-webui serve

Loading WEBUI_SECRET_KEY from file, not provided as an environment variable.

Generating a new secret key and saving it to E:\github\.webui_secret_key

Loading WEBUI_SECRET_KEY from E:\github\.webui_secret_key

E:\py311\Lib\site-packages\open_webui

E:\py311\Lib\site-packages

E:\py311\Lib

Running migrations

INFO [alembic.runtime.migration] Context impl SQLiteImpl.

ARNI [sentence_transformers.SentenceTransformer] No sentence-transformers model found with name sentence-transformers/all-MiniLM-L6-v2. Creating a new one with mean pooling.

INFO: Started server process [21984]

INFO: Waiting for application startup.

INFO: Application startup complete.

INFO: Uvicorn running on http://0.0.0.0:8080 (Press CTRL+C to quit)配置

使用浏览器登录服务:

http://127.0.0.1:8080/第一次使用需要注册用户名、邮件以及密码,这都是存在本地的,可以放心填写。

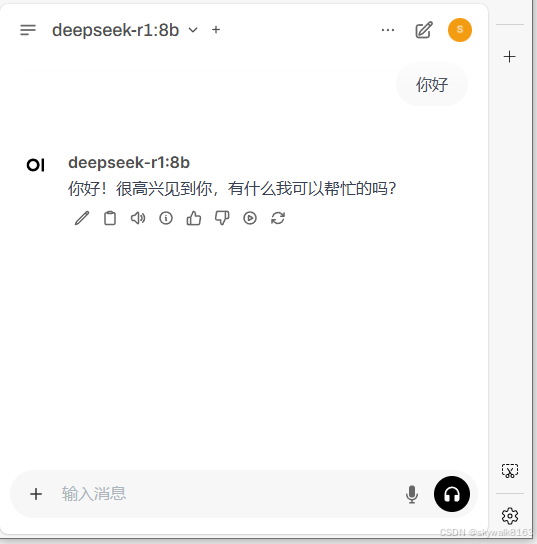

注册完毕后,它自动认出了本地安装的deepseek r1大模型,真是太智能了!

这样就可以开始我们的大模型之旅啦!

deepseek大模型的安装参考:在Windows下安装Ollama并体验DeepSeek r1大模型-CSDN博客

使用Ollama 在Ubuntu运行deepseek大模型:以deepseek-r1为例-CSDN博客

附加

本来以为这么简单就过了,后来才知道,自己在安装open webui之前,已经启动了Ollama,所以直接一把过!

所以不能缺少Ollama的安装,具体deepseek大模型的安装参考:在FreeBSD下安装Ollama并体验DeepSeek r1大模型-CSDN博客

在Windows下安装Ollama并体验DeepSeek r1大模型-CSDN博客

使用Ollama 在Ubuntu运行deepseek大模型:以deepseek-r1为例-CSDN博客

调试

启动open-webui报错

Traceback (most recent call last):

File "E:\py311\Lib\site-packages\open_webui\retrieval\utils.py", line 417, in get_model_path

model_repo_path = snapshot_download(**snapshot_kwargs)

^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

File "E:\py311\Lib\site-packages\huggingface_hub\utils\_validators.py", line 114, in _inner_fn

return fn(*args, **kwargs)

^^^^^^^^^^^^^^^^^^^

File "E:\py311\Lib\site-packages\huggingface_hub\_snapshot_download.py", line 235, in snapshot_download

raise LocalEntryNotFoundError(

huggingface_hub.errors.LocalEntryNotFoundError: An error happened while trying to locate the files on the Hub and we cannot find the appropriate snapshot folder for the specified revision on the local disk. Please check your internet connection and try again.

WARNI [sentence_transformers.SentenceTransformer] No sentence-transformers model found with name sentence-transformers/all-MiniLM-L6-v2. Creating a new one with mean pooling.

不过尽管有报错,最后还是执行下去了。

报错Cannot connect to host localhost:11434

ERROR [open_webui.routers.ollama] Connection error: Cannot connect to host localhost:11434 ssl:default [远程计算机拒绝 网络连接。]

INFO: 127.0.0.1:59333 - "GET /ollama/api/version HTTP/1.1" 500 Internal Server Error

ERROR [open_webui.routers.ollama] Connection error: Cannot connect to host localhost:11434 ssl:default [远程计算机拒绝 网络连接。]

INFO: 127.0.0.1:59529 - "GET /ollama/api/version HTTP/1.1" 500 Internal Server Error

原来是没有启动ollama服务,启动即可:

ollama serve或者直接启动一个模型:

ollama run deepseek-r1:1.5b