deepseek云部署极简指南

写在前面

前面几期,针对的是deepseek本地部署相关的内容,这期我们来介绍以下云部署,本期分为两部分,1.为体验向,用于让用户在10分钟内拥有一个自己的可以通过互联网访问的deepseek网页版!;2.通用的云部署方案。欢迎大家点赞收藏。

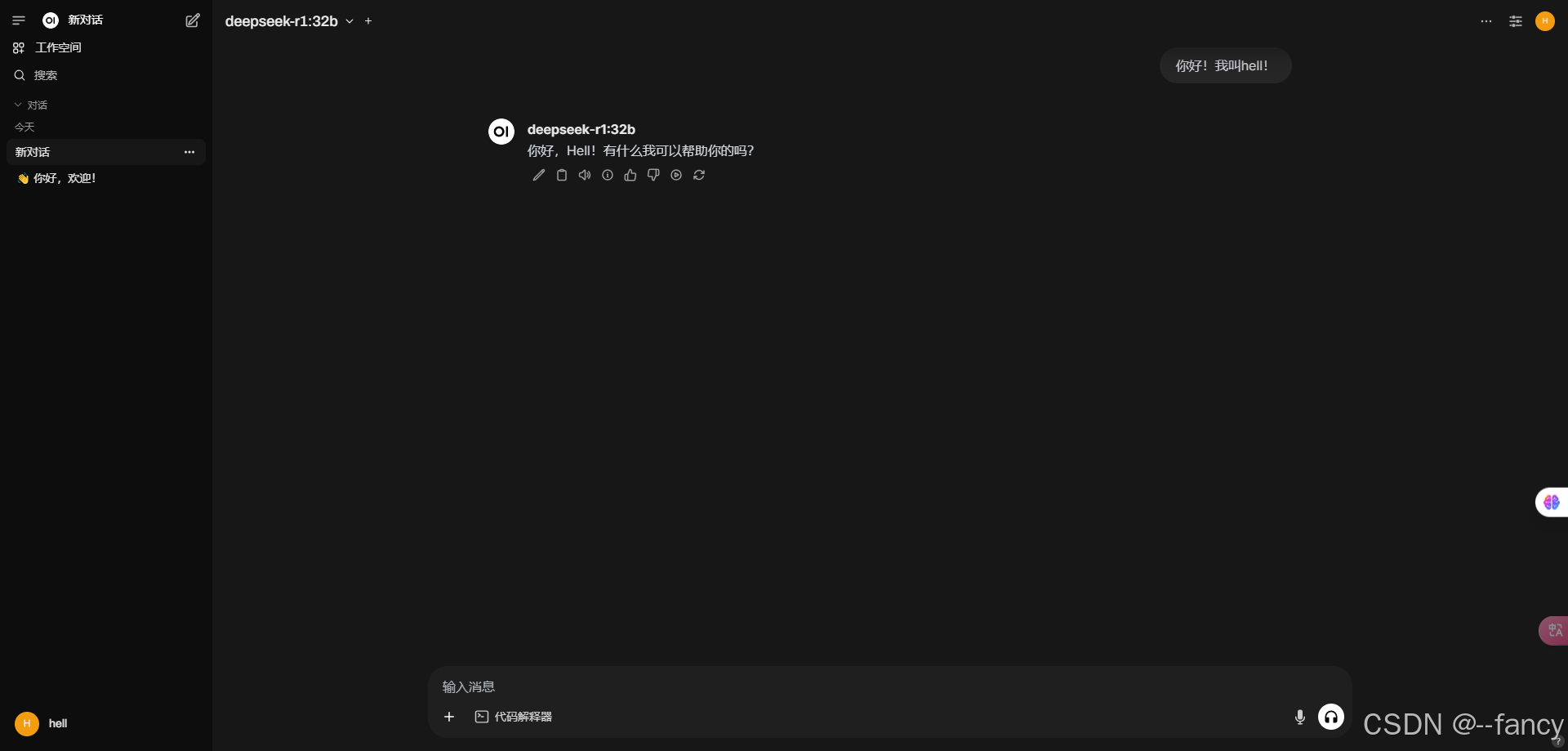

效果展示

1.体验向,使用镜像进行云部署

推荐优云智算,读者也可以使用其他平台,本文以优云智算为例,读者可以自行注册 优云智算注册传送门。(📎用户注册有40算力金,约有20h的4090的使用时长,足够读者入门)

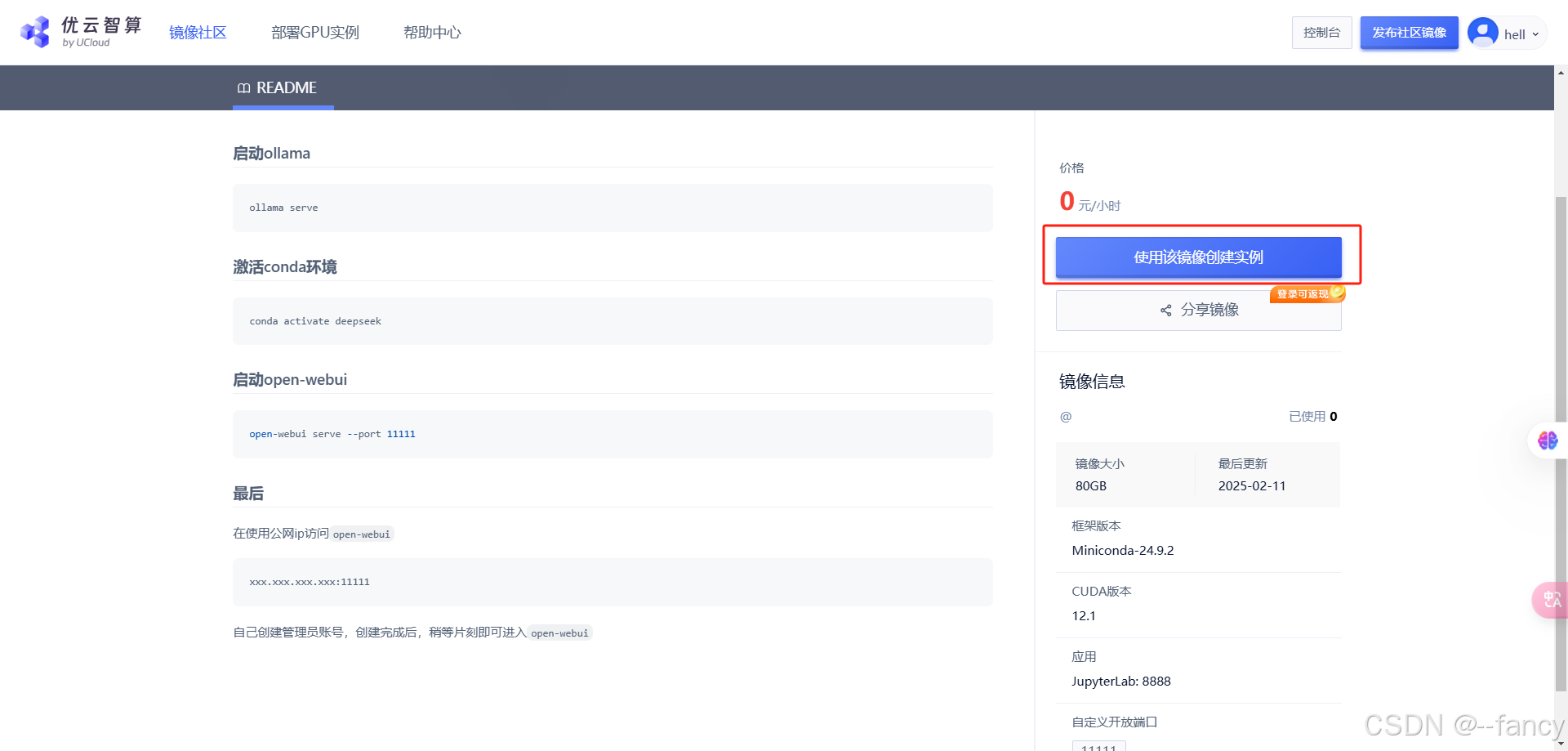

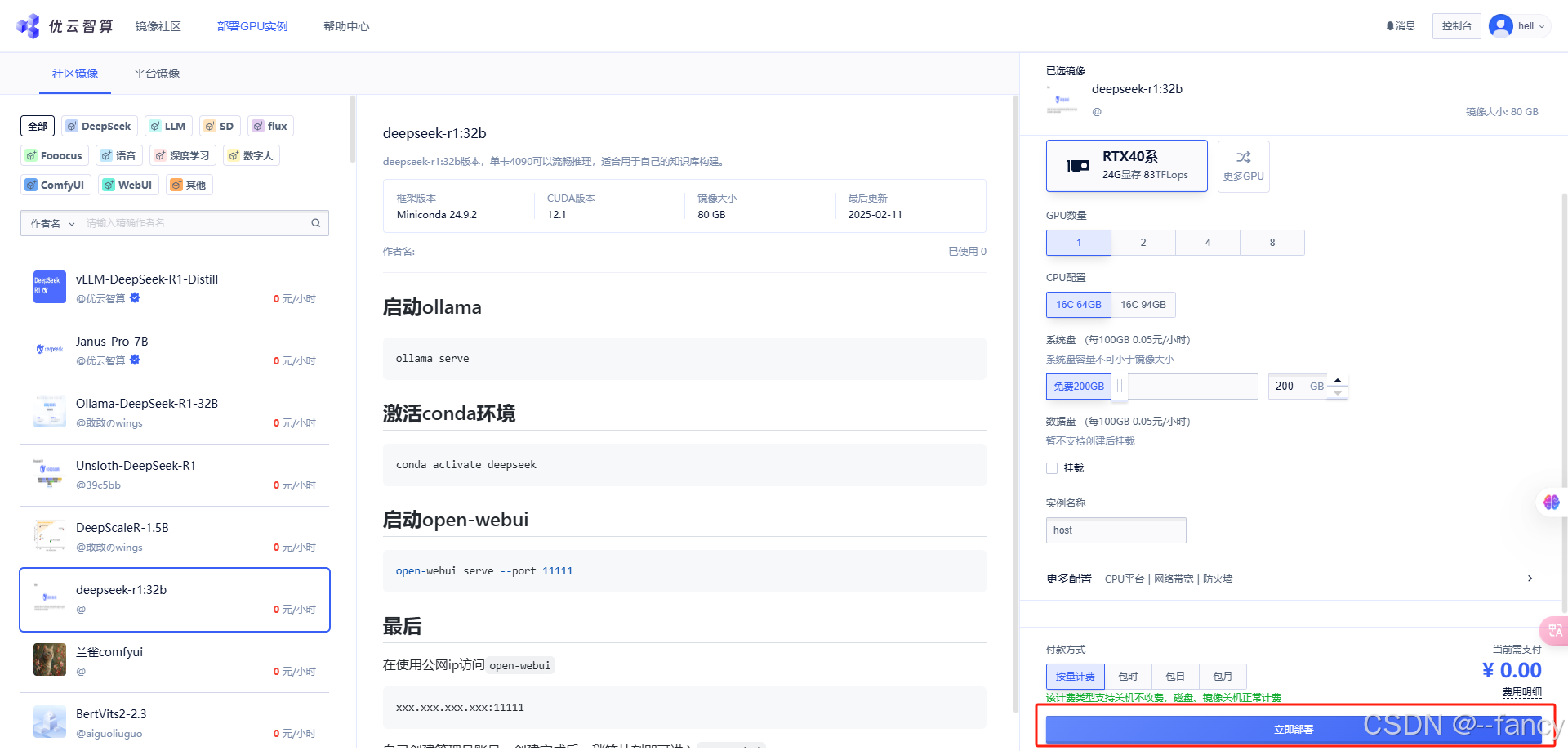

选择我自己配置的镜像 deepseek-r1:32b镜像传送门,创建实例

部署,然后稍等2-3分钟

进入JupyterLab

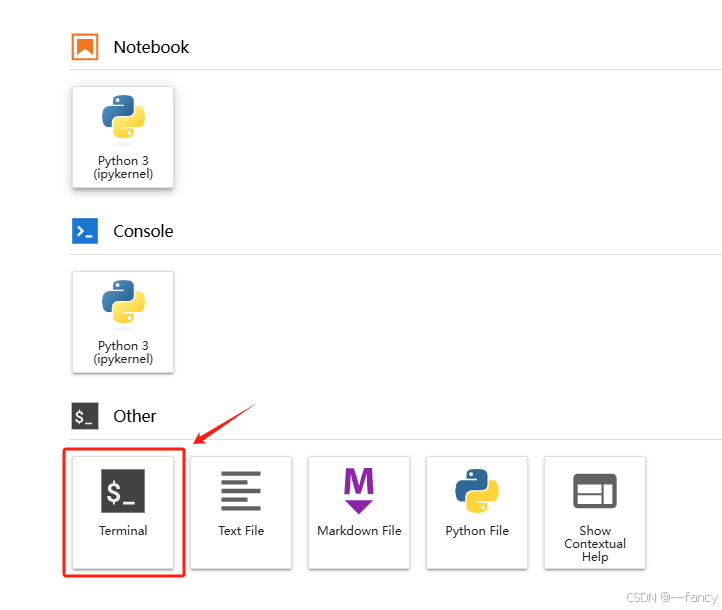

创建一个终端Terminal

输入 ollama serve

ollama serve

然后再添加一个终端Terminal,输入conda activate deepseek进入conda环境

conda activate deepseek

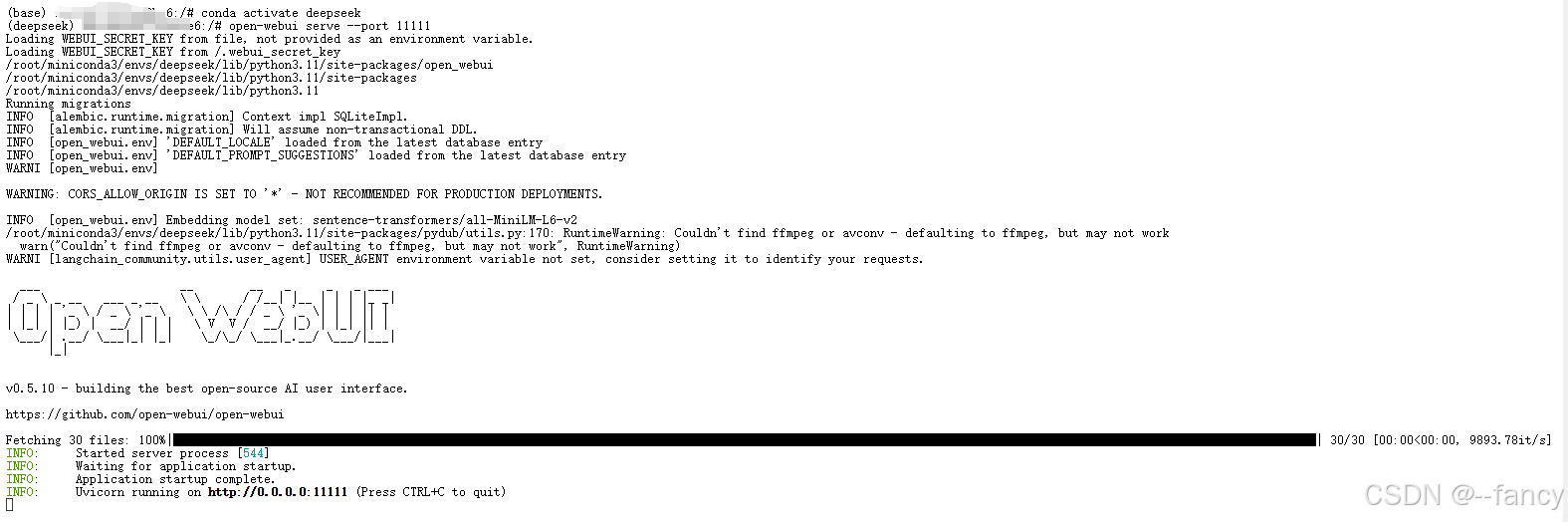

然后启动open-webui,open-webui serve --port 11111

open-webui serve --port 11111

然后在实例页面找到公网ip,在网页输入xxx.xxx.xxx.xxx:11111,xxx.xxx.xxx.xxx为你的公网ip,

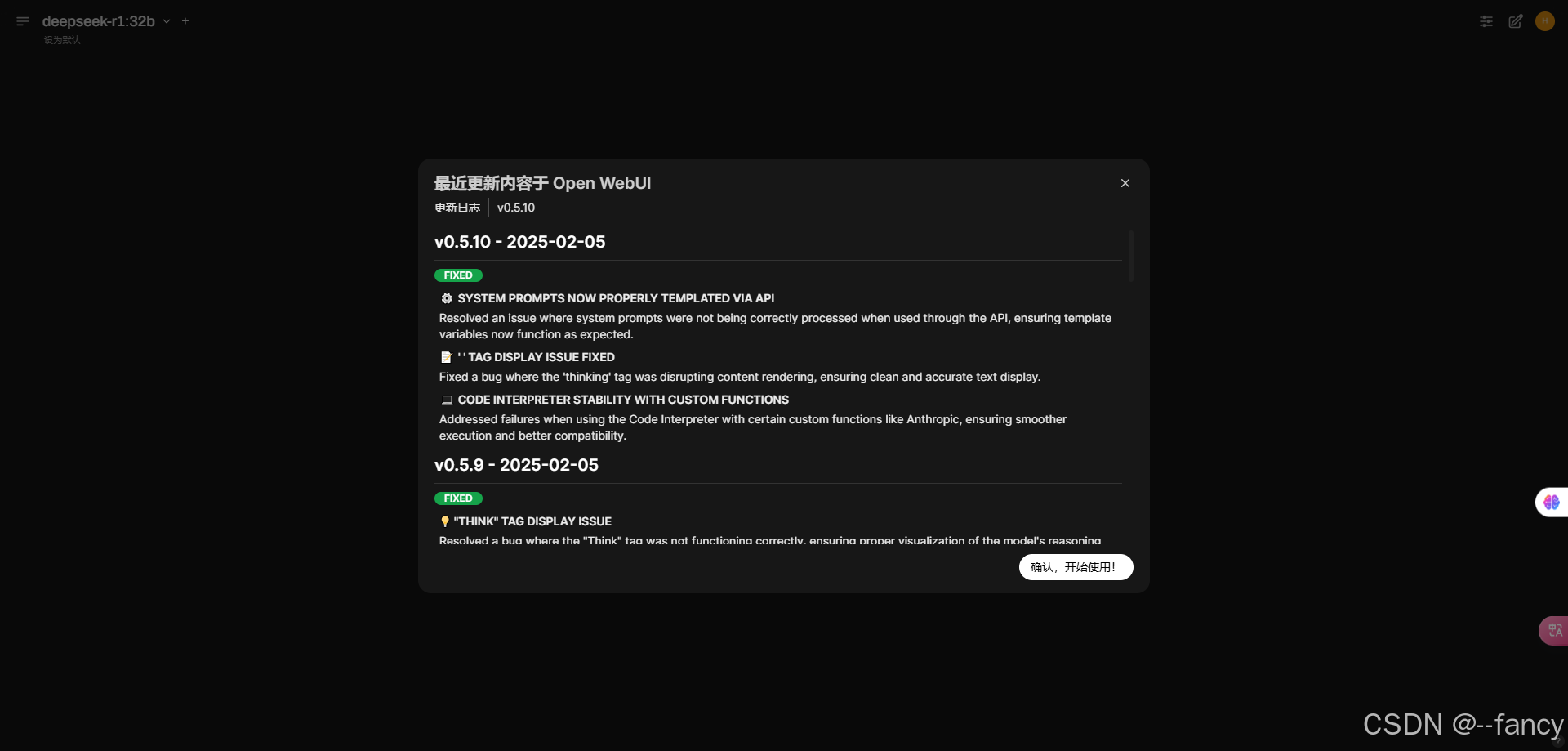

即可进入我们的open-webui,我们点击开始使用

随后我们设置用户名和邮箱密码,创建管理员。

然后右上角会提示“已登陆”,我们稍等一下

点击确认,即可开始使用!

特殊设置

1.导出用户对话,在左下角点击头像 -> 设置 -> 数据库 -> 导出用户对话

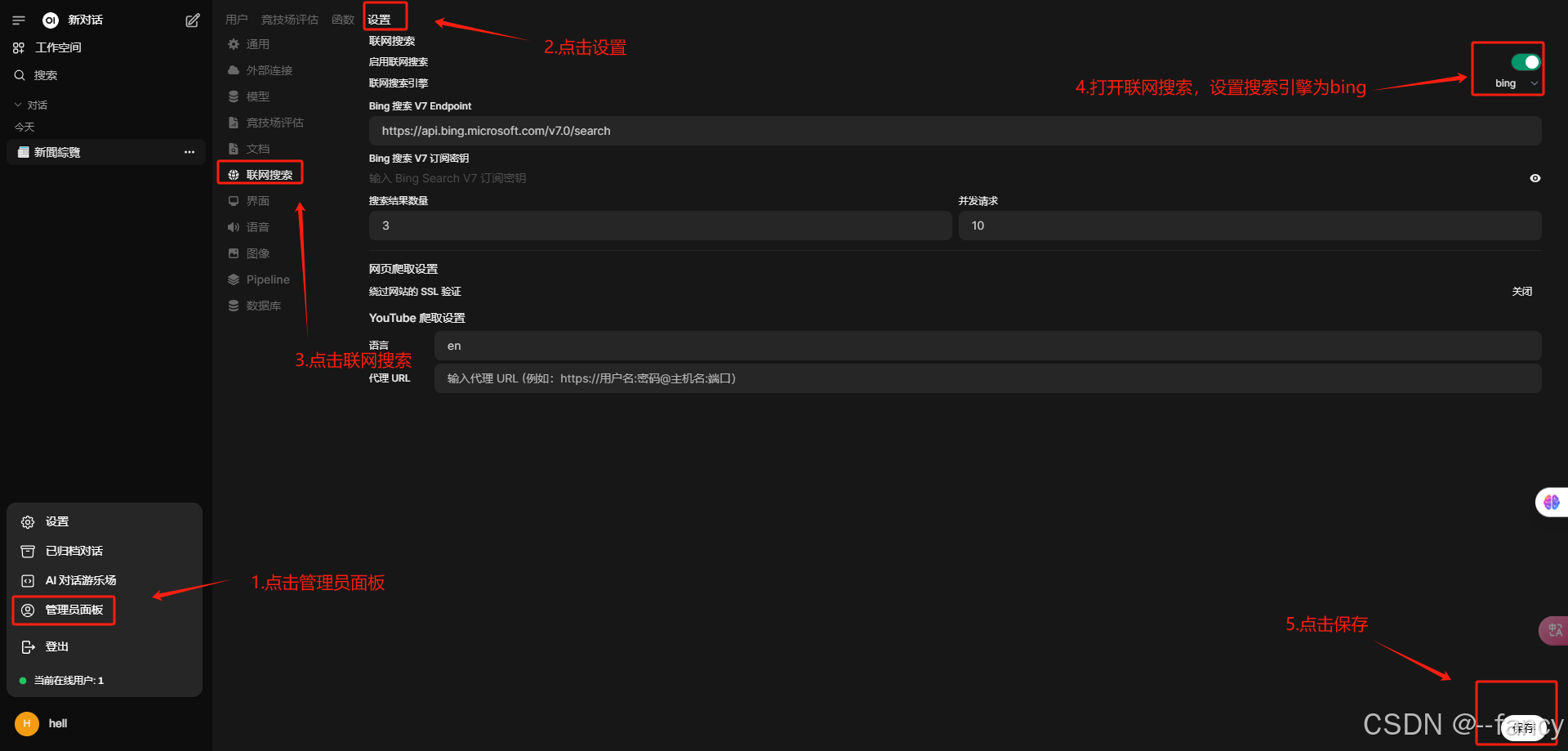

2.联网搜索

最近大家都提到了联网搜索,这里给出一个解决方案。

配置api密钥参考博客 申请自己的免费必应搜索API

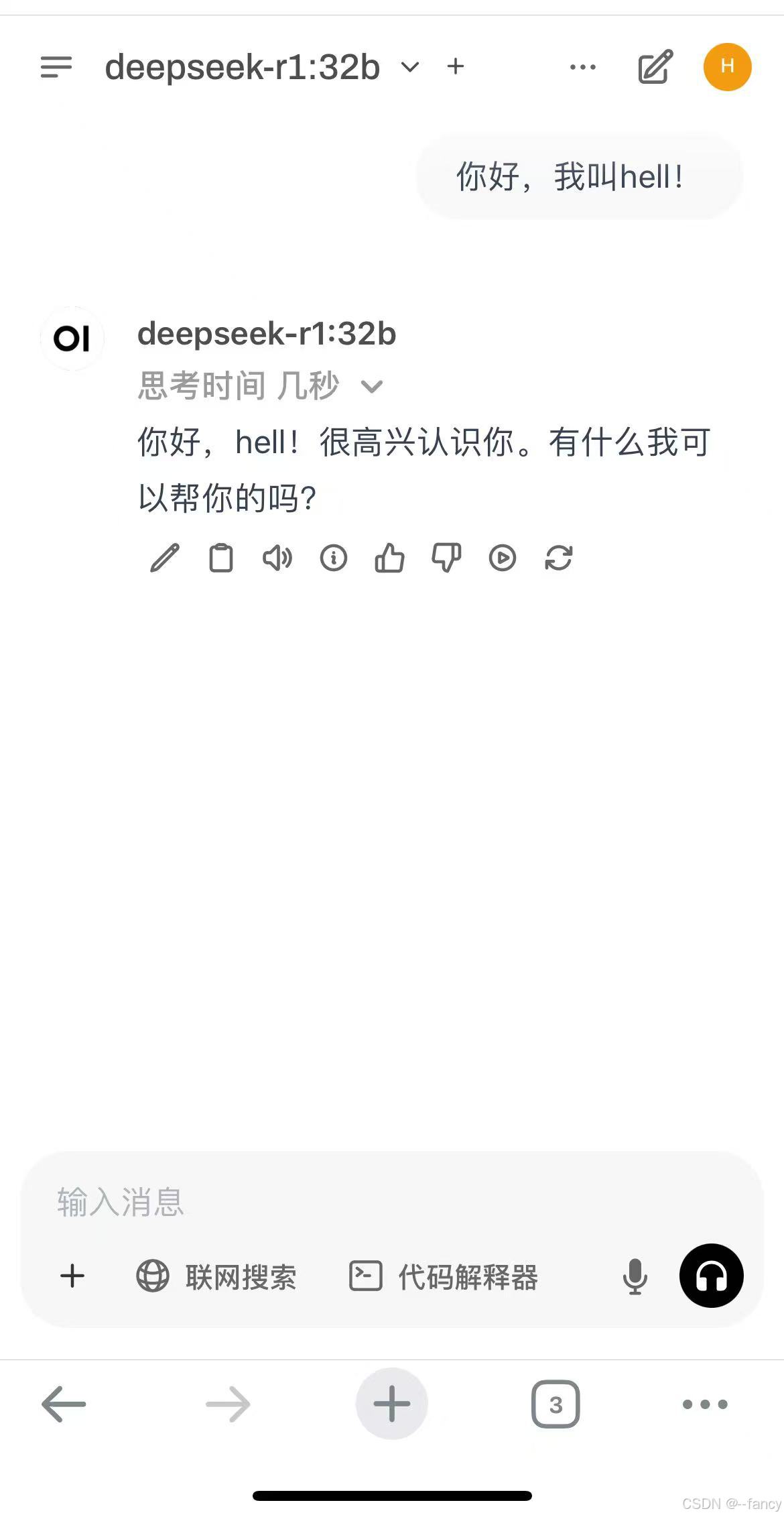

这样就设置完成拉,可以在手机端看看效果

2.通用的云部署方案

注意:此方案比较花时间,会有浪费算力的可能。

我们还是以优云智算为例,创建一个平台镜像,最好使用cuda,因为最难配置的就是cuda环境,其他配置可以参考我的,然后就点击立即部署。

下载ollama

然后我们打开JupyterLib,打开Terminal,安装ollama。

curl -fsSL https://ollama.com/install.sh | sh

然后稍等,安装完成.

注意如果出现下面情况

WARNING: WARNING: Unable to detect NVIDIA/AMD GPU. Install lspci or lshw to automatically detect and install GPU dependencies

解决办法参考博客 sh xxx.sh文件报错

sudo apt install pciutils

sudo apt install lshw

若sudo报错可以不用sudo,即

apt install pciutils

apt install lshw

测试启动 ollama

ollama serve

下载deepseek-r1模型

此处下载需要的模型,4090单卡推理deepseek-r1:32b十分流畅,推荐使用!读者也可以使用其他模型!

ollama run deepseek-r1:32b

然后等待下载完成!

下载open-webui

然后我们打开新的Terminal,准备下载open-webui. 首先新建conda环境,deepseek为环境名称,这里可以随意设置,要求python版本>=3.11

conda create -n deepseek python=3.11

然后进入conda环境

conda activate deepseek

然后下载open-webui

pip install open-webui

下载完成之后,启动open-webui,设置端口为11111,这里端口可以自行设置

open-webui serve --port 11111

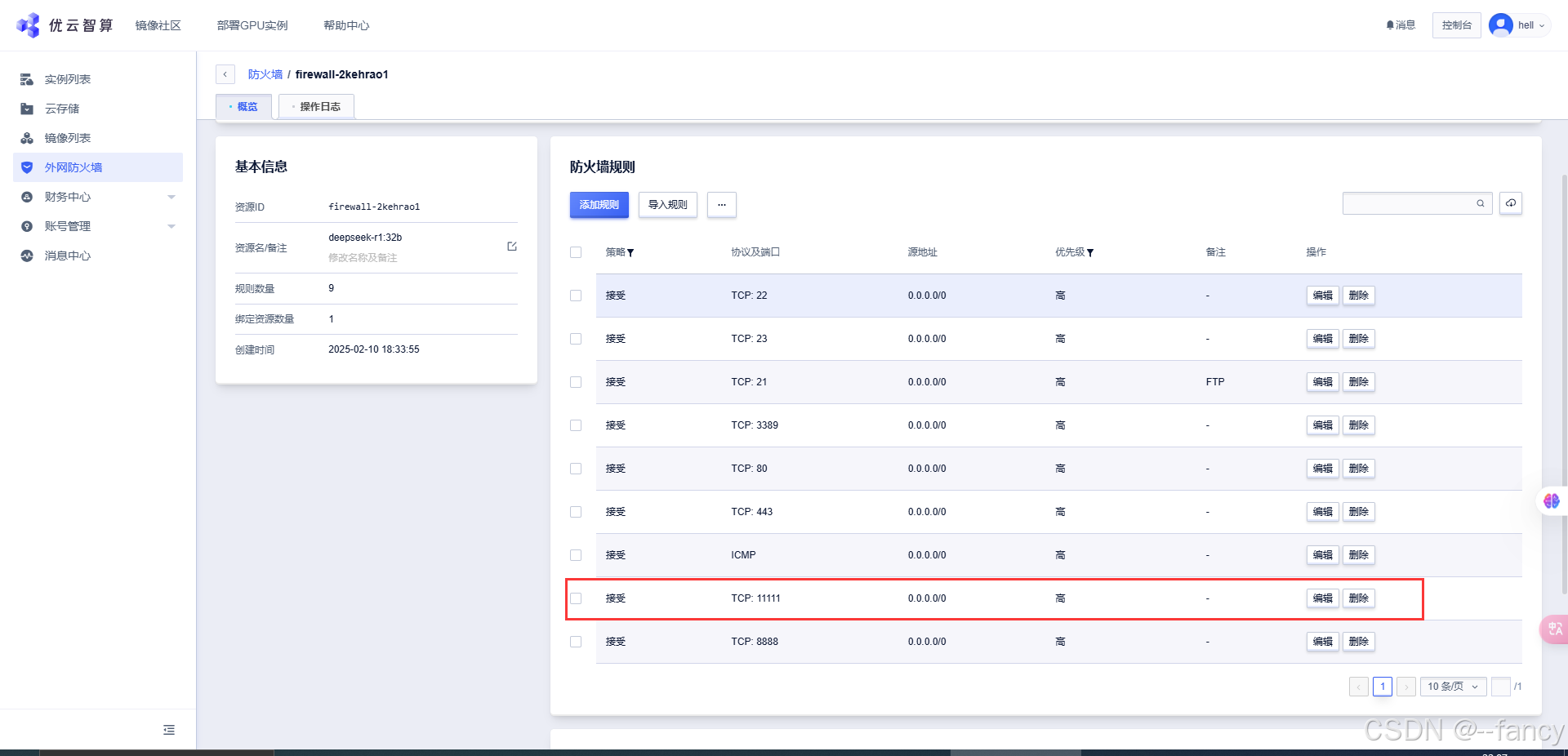

端口设置完记得开放防火墙

然后可以在公网中访问了,域名为实例外网ip地址+端口号!

进入open-webui之后的处理同上面镜像配置中的处理拉,这里省略.

完

欢迎大家留言,有什么想学习关注的关于deepseek的应用~,有问题可以私信留言,看到会第一时间回复❤️。