Graph Wavenet 学习笔记

Graph Wavenet 学习笔记

论文链接https://arxiv.org/pdf/1906.00121.pdf

当前研究的limitation

- 现有方法主要捕捉了固定的空间关系,这种空间关系是预先被决定的。但是这种图关系不一定反映了真正的依赖。

- RNN,CNN对long-range的时间关系不能进行正确的捕捉。

文章的主要贡献

- construct a self-adaptive adjacency matrix which

preserves hidden spatial dependencies 用自适应的矩阵描述了空间的依赖关系 - present an effective and efficient framework to capture spatial-temporal dependencies simultaneously 能够同时捕获时空关系

采用的方法

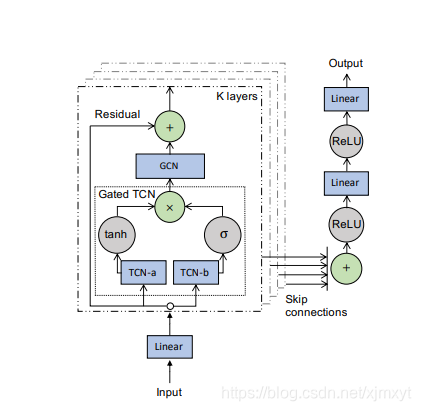

图卷积层

a diffusion convolution layer

用于捕捉predefined graph dependency

https://zhuanlan.zhihu.com/p/76669259

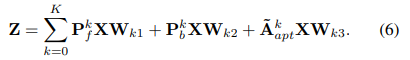

针对无向图,求和公式如下

∑

k

=

0

K

p

k

X

W

k

\sum_{k=0}^Kp^kXW_{k}

k=0∑KpkXWk

p

k

p^k

pk表示的其实就是一个转移的概率矩阵,

p

p

p是接邻矩阵

A

/

r

o

w

s

u

m

(

A

)

A/rowsum(A)

A/rowsum(A),

p

p

p中第

(

i

,

j

)

(i,j)

(i,j)个元素表示由

i

i

i向

j

j

j转移的概率,那么

p

k

p^k

pk就表示的是通过

k

k

k步转移的概率。那么这里求和就表示的是通过

0

0

0到

k

k

k步转移的能到达的点的特征由概率进行加权和。

self-adaptive adjacency matrix

用于捕捉hidden graph dependency

A

‾

a

p

t

=

S

o

f

t

M

a

x

(

R

e

L

U

(

E

1

E

2

T

)

)

\overline{A}_{apt}=SoftMax(ReLU(E_1E_2^T))

Aapt=SoftMax(ReLU(E1E2T))

E

1

E_1

E1表示source node embedding,

E

2

E_2

E2表示target node embedding。两者乘积表征的是spatial dependency weights,

R

e

L

U

ReLU

ReLU用于消除弱的关系,

S

o

f

t

M

a

x

SoftMax

SoftMax用于normalize。

时间上的卷积网络

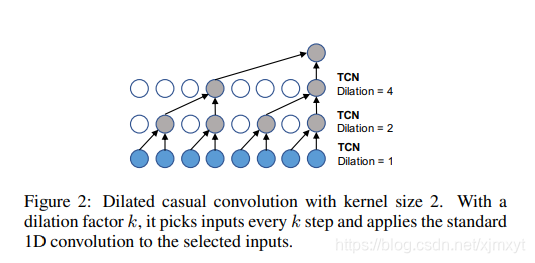

dilated casual convolution

这里推荐一篇很好的博文https://www.zhihu.com/question/54149221讲如何理解空洞卷积。为什么需要空洞卷积呢?空洞卷积主要针对需要感受野很大的数据,例如这儿的语音数据就是需要分析较长的sequence。

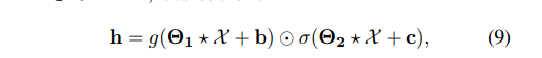

Gating mechanisms

g

g

g是激活函数,

σ

\sigma

σ是 sigmoid 函数,表示了控制传入下一层的特征。