文章目录

-

- 引言

- 机器学习与大模型的基本概念

-

- 机器学习概述

-

- 监督学习

- 无监督学习

- 强化学习

- 大模型概述

-

- GPT-3

- BERT

- ResNet

- Transformer

- 机器学习与大模型的融合应用

-

- 自然语言处理

-

- 文本生成

- 文本分类

- 机器翻译

- 图像识别

-

- 自动驾驶

- 医学影像分析

- 语音识别

-

- 智能助手

- 语音转文字

- 大模型性能优化的新探索

-

- 模型压缩

-

- 权重剪枝

- 量化

- 知识蒸馏

- 分布式训练

-

- 数据并行

- 模型并行

- 异步训练

- 高效推理

-

- 模型裁剪

- 缓存机制

- 专用硬件

- 未来展望

-

- 跨领域应用

- 智能化系统

- 人工智能伦理

- 技术创新

- 结论

引言

随着计算能力的不断提升和数据规模的爆炸性增长,机器学习和大模型在人工智能(AI)领域的应用变得越来越广泛和深入。尤其是大规模机器学习模型,如深度神经网络(如GPT-3、BERT等),在自然语言处理、图像识别、语音识别等方面展现了卓越的性能。然而,如何有效地融合机器学习与大模型,提升其应用性能,仍然是当前研究和应用中的重要课题。本文将探讨机器学习与大模型在人工智能领域的融合应用,并重点讨论性能优化的新方法和新探索。

机器学习与大模型的基本概念

机器学习概述

机器学习是一种通过数据训练模型,并利用模型对新数据进行预测和决策的技术。其基本思想是让计算机通过样本数据学习规律,而不是通过明确的编程指令。根据学习的类型,机器学习可以分为监督学习、无监督学习和强化学习。

监督学习

监督学习是通过带标签的数据集训练模型,使其能够对新数据进行分类或回归预测。常见的算法包括线性回归、逻辑回归、支持向量机、决策树和神经网络等。

无监督学习

无监督学习是在没有标签的数据集上进行训练,主要用于数据聚类和降维。常见的算法包括K-means聚类、层次聚类和主成分分析(PCA)等。

强化学习

强化学习是一种通过与环境交互学习最优行为策略的技术。智能体通过试错法在环境中学习,以最大化累积奖励。常见的算法包括Q-learning、深度Q网络(DQN)和策略梯度方法等。

大模型概述

大模型是指具有大量参数和层数的深度学习模型,通常通过大规模数据集进行训练。大模型在自然语言处理、图像识别和语音识别等任务中表现出色。其代表性模型包括GPT-3、BERT、ResNet和Transformer等。

GPT-3

GPT-3(Generative Pre-trained Transformer 3)是OpenAI开发的一种语言模型,具有1750亿个参数。它通过大量的文本数据进行预训练,能够生成高质量的自然语言文本,广泛应用于文本生成、翻译和对话系统等领域。

BERT

BERT(Bidirectional Encoder Representations from Transformers)是Google开发的一种语言模型,通过双向Transformer架构进行预训练。BERT在各种自然语言理解任务中表现优异,如问答系统和情感分析等。

ResNet

ResNet(Residual Network)是Microsoft提出的一种深度卷积神经网络,通过残差连接解决了深层神经网络训练中的梯度消失问题。ResNet在图像识别任务中取得了显著成果。

Transformer

Transformer是Google提出的一种基于注意力机制的神经网络架构,广泛应用于自然语言处理任务。与传统的卷积神经网络和循环神经网络不同,Transformer能够更高效地处理长距离依赖关系。

机器学习与大模型的融合应用

自然语言处理

自然语言处理(NLP)是机器学习与大模型应用最广泛的领域之一。大模型在文本生成、文本分类、情感分析、机器翻译等任务中表现出色。

文本生成

GPT-3等大模型在文本生成任务中展现了强大的能力。通过预训练,大模型能够理解上下文,生成连贯且有意义的文本,广泛应用于对话系统、内容创作和自动摘要等场景。

import openai

openai.api_key = 'YOUR_API_KEY'

def generate_text(prompt):

response = openai.Completion.create(

engine="davinci-codex",

prompt=prompt,

max_tokens=100

)

return response.choices[0].text.strip()

prompt = "Explain the significance of machine learning in modern technology."

generated_text = generate_text(prompt)

print(generated_text)

文本分类

BERT等大模型通过预训练和微调,在文本分类任务中取得了显著成果。通过对文本进行语义理解,大模型能够准确地对文本进行分类,广泛应用于垃圾邮件检测、情感分析和主题识别等领域。

from transformers import BertTokenizer, BertForSequenceClassification

from transformers import TextClassificationPipeline

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertForSequenceClassification.from_pretrained('bert-base-uncased')

pipeline = TextClassificationPipeline(model=model, tokenizer=tokenizer)

result = pipeline("I love this product, it's amazing!")

print(result)

机器翻译

Transformer架构在机器翻译任务中表现出色。通过大规模双语数据集的训练,Transformer能够实现高质量的文本翻译,广泛应用于跨语言信息交流和全球化业务拓展。

from transformers import MarianMTModel, MarianTokenizer

model_name = 'Helsinki-NLP/opus-mt-en-de'

tokenizer = MarianTokenizer.from_pretrained(model_name)

model = MarianMTModel.from_pretrained(model_name)

def translate(text):

inputs = tokenizer(text, return_tensors="pt", padding=True)

translated = model.generate(**inputs)

translated_text = tokenizer.batch_decode(translated, skip_special_tokens=True)

return translated_text[0]

text = "Machine learning is transforming the way we approach problems in various fields."

translated_text = translate(text)

print(translated_text)

图像识别

大模型在图像识别领域同样取得了显著成果。通过深度卷积神经网络(如ResNet),大模型能够准确地识别图像中的物体,广泛应用于自动驾驶、安防监控和医学影像分析等领域。

自动驾驶

在自动驾驶领域,图像识别技术用于检测道路上的行人、车辆和交通标志等。大模型通过大量的图像数据进行训练,能够实现高精度的目标检测和分类,提高自动驾驶系统的安全性和可靠性。

import torch

import torchvision.models as models

import torchvision.transforms as transforms

from PIL import Image

model = models.resnet50(pretrained=True)

model.eval()

def predict_image(image_path):

img = Image.open(image_path)

preprocess = transforms.Compose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]),

])

img_tensor = preprocess(img)

img_tensor = img_tensor.unsqueeze(0)

with torch.no_grad():

output = model(img_tensor)

_, predicted = torch.max(output, 1)

return predicted.item()

image_path = 'path/to/your/image.jpg'

predicted_class = predict_image(image_path)

print(predicted_class)

医学影像分析

在医学影像分析领域,图像识别技术用于检测和诊断疾病。大模型通过大量的医学影像数据进行训练,能够准确地识别病变区域,辅助医生进行诊断和治疗,提高医疗服务的质量和效率。

from fastai.vision.all import *

def load_learner():

learner = load_learner('path/to/your/exported/learner.pkl')

return learner

def predict_image(image_path):

learner = load_learner()

img = PILImage.create(image_path)

pred, pred_idx, probs = learner.predict(img)

return pred, probs[pred_idx]

image_path = 'path/to/your/image.jpg'

predicted_class, probability = predict_image(image_path)

print(f'Predicted class: {predicted_class}, Probability: {probability}')

语音识别

语音识别是大模型在人工智能领域的重要应用之一。通过深度神经网络和大规模语音数据集的训练,大模型能够实现高精度的语音识别,广泛应用于智能助手、语音控制和语音转文字等场景。

智能助手

智能助手如Siri、Alexa和Google Assistant等,广泛应用于家庭和办公场景。大模型通过语音识别技术,实现语音指令的理解和响应,提高用户的交互体验和工作效率。

import speech_recognition as sr

def recognize_speech():

recognizer = sr.Recognizer()

with sr.Microphone() as source:

print("Say something:")

audio = recognizer.listen(source)

try:

text = recognizer.recognize_google(audio)

print("You said: " + text)

except sr.UnknownValueError:

print("Google Speech Recognition could not understand audio")

except sr.RequestError as e:

print("Could not request results from Google Speech Recognition service; {0}".format(e))

recognize_speech()

语音转文字

语音转文字技术用于将语音信息转换为文本信息,广泛应用于会议记录、客户服务和语音搜索

等场景。大模型通过语音识别技术,实现高精度的语音转文字,提高信息处理的效率和准确性。

from transformers import Wav2Vec2ForCTC, Wav2Vec2Tokenizer

import torch

import librosa

tokenizer = Wav2Vec2Tokenizer.from_pretrained("facebook/wav2vec2-base-960h")

model = Wav2Vec2ForCTC.from_pretrained("facebook/wav2vec2-base-960h")

def speech_to_text(audio_path):

speech, _ = librosa.load(audio_path, sr=16000)

input_values = tokenizer(speech, return_tensors="pt").input_values

logits = model(input_values).logits

predicted_ids = torch.argmax(logits, dim=-1)

transcription = tokenizer.batch_decode(predicted_ids)[0]

return transcription

audio_path = 'path/to/your/audio.wav'

transcription = speech_to_text(audio_path)

print(transcription)

大模型性能优化的新探索

模型压缩

大模型虽然在性能上表现出色,但其巨大的参数量和计算复杂度带来了显著的存储和计算成本。为了在实际应用中更高效地部署大模型,模型压缩技术成为了重要的研究方向。

权重剪枝

权重剪枝是一种通过删除网络中不重要的权重,减少模型参数量和计算量的技术。通过剪枝后的模型在推理阶段能够大幅度提高计算效率,同时保持较高的准确度。

import torch

import torch.nn.utils.prune as prune

model = models.resnet50(pretrained=True)

parameters_to_prune = [(module, 'weight') for module in model.modules() if isinstance(module, torch.nn.Conv2d)]

for module, param in parameters_to_prune:

prune.l1_unstructured(module, name=param, amount=0.2)

# Remove pruning reparameterization to enable inference

for module, param in parameters_to_prune:

prune.remove(module, param)

量化

量化是将模型参数从高精度(如32位浮点数)转换为低精度(如8位整数)的技术。量化后的模型能够大幅度减少存储空间和计算复杂度,同时保持较高的性能。

model = models.resnet50(pretrained=True)

model.eval()

quantized_model = torch.quantization.quantize_dynamic(

model, {torch.nn.Linear}, dtype=torch.qint8

)

# Test the quantized model

input_tensor = torch.randn(1, 3, 224, 224)

output = quantized_model(input_tensor)

print(output)

知识蒸馏

知识蒸馏是一种通过训练一个较小的学生模型来模仿大模型的行为,从而达到模型压缩的技术。学生模型在推理阶段能够更高效地运行,同时保持接近大模型的性能。

import torch.nn.functional as F

# Define teacher and student models

teacher_model = models.resnet50(pretrained=True)

student_model = models.resnet18()

# Define a knowledge distillation loss function

def distillation_loss(student_outputs, teacher_outputs, labels, alpha=0.5, temperature=2.0):

loss_ce = F.cross_entropy(student_outputs, labels)

loss_kd = F.kl_div(

F.log_softmax(student_outputs / temperature, dim=1),

F.softmax(teacher_outputs / temperature, dim=1),

reduction='batchmean'

) * (temperature ** 2)

return alpha * loss_ce + (1 - alpha) * loss_kd

# Example training loop

optimizer = torch.optim.SGD(student_model.parameters(), lr=0.01, momentum=0.9)

for epoch in range(10):

for inputs, labels in dataloader:

optimizer.zero_grad()

student_outputs = student_model(inputs)

with torch.no_grad():

teacher_outputs = teacher_model(inputs)

loss = distillation_loss(student_outputs, teacher_outputs, labels)

loss.backward()

optimizer.step()

分布式训练

大模型的训练通常需要大量的计算资源和时间。为了加速训练过程,分布式训练技术成为了重要的研究方向。

数据并行

数据并行是一种将大规模数据集分割成多个小批次,并在多个计算节点上并行训练模型的技术。数据并行能够显著加速大模型的训练过程,同时提高计算资源的利用率。

import torch

import torch.distributed as dist

import torch.nn as nn

import torch.optim as optim

from torch.nn.parallel import DistributedDataParallel as DDP

dist.init_process_group(backend='nccl')

model = models.resnet50().cuda()

ddp_model = DDP(model)

optimizer = optim.SGD(ddp_model.parameters(), lr=0.01)

for epoch in range(10):

for inputs, labels in dataloader:

inputs, labels = inputs.cuda(), labels.cuda()

optimizer.zero_grad()

outputs = ddp_model(inputs)

loss = F.cross_entropy(outputs, labels)

loss.backward()

optimizer.step()

模型并行

模型并行是一种将大模型分割成多个子模型,并在多个计算节点上并行训练的技术。模型并行能够解决单个计算节点内存不足的问题,提高大模型的训练效率。

import torch

import torch.nn as nn

import torch.optim as optim

from torch.nn.parallel import DistributedDataParallel as DDP

class ModelParallelResNet50(nn.Module):

def __init__(self):

super(ModelParallelResNet50, self).__init__()

self.model = nn.Sequential(

models.resnet50().layer1.to('cuda:0'),

models.resnet50().layer2.to('cuda:1'),

models.resnet50().layer3.to('cuda:2'),

models.resnet50().layer4.to('cuda:3')

)

def forward(self, x):

for layer in self.model:

x = layer(x)

return x

model = ModelParallelResNet50()

optimizer = optim.SGD(model.parameters(), lr=0.01)

for epoch in range(10):

for inputs, labels in dataloader:

inputs, labels = inputs.to('cuda:0'), labels.to('cuda:3')

optimizer.zero_grad()

outputs = model(inputs)

loss = F.cross_entropy(outputs, labels)

loss.backward()

optimizer.step()

异步训练

异步训练是一种允许不同计算节点在不同步的情况下进行模型更新的技术。异步训练能够提高计算资源的利用效率,加速大模型的训练过程。

import torch

import torch.distributed as dist

import torch.nn as nn

import torch.optim as optim

from torch.multiprocessing import Process

def train(rank, world_size):

dist.init_process_group(backend='gloo', rank=rank, world_size=world_size)

model = models.resnet50().to(rank)

ddp_model = nn.parallel.DistributedDataParallel(model, device_ids=[rank])

optimizer = optim.SGD(ddp_model.parameters(), lr=0.01)

for epoch in range(10):

for inputs, labels in dataloader:

inputs, labels = inputs.to(rank), labels.to(rank)

optimizer.zero_grad()

outputs = ddp_model(inputs)

loss = F.cross_entropy(outputs, labels)

loss.backward()

optimizer.step()

def main():

world_size = 4

processes = []

for rank in range(world_size):

p = Process(target=train, args=(rank, world_size))

p.start()

processes.append(p)

for p in processes:

p.join()

if __name__ == "__main__":

main()

高效推理

大模型在推理阶段同样面临计算复杂度高的问题。为了在实际应用中更高效地进行推理,高效推理技术成为了重要的研究方向。

模型裁剪

模型裁剪是一种在推理阶段,根据输入数据的特性动态裁剪模型结构的技术。模型裁剪能够减少计算量,提高推理速度,同时保持较高的性能。

import torch

class DynamicPruningModel(nn.Module):

def __init__(self, model):

super(DynamicPruningModel, self).__init__()

self.model = model

def forward(self, x):

# Example of dynamic pruning logic

if x.size(0) > 1:

self.model.layer4[0].conv1 = nn.Identity()

return self.model(x)

model = models.resnet50(pretrained=True)

pruned_model = DynamicPruningModel(model)

input_tensor = torch.randn(1, 3, 224, 224)

output = pruned_model(input_tensor)

print(output)

缓存机制

缓存机制是一种通过缓存推理过程中的中间结果,减少重复计算的技术。缓存机制能够显著提高大模型的推理效率,特别是在实时应用场景中。

import torch

import torch.nn as nn

class CachedModel(nn.Module):

def __init__(self, model):

super(CachedModel, self).__init__()

self.model = model

self.cache = {}

def forward(self, x):

if x in self.cache:

return self.cache[x]

output = self.model(x)

self

.cache[x] = output

return output

model = models.resnet50(pretrained=True)

cached_model = CachedModel(model)

input_tensor = torch.randn(1, 3, 224, 224)

output = cached_model(input_tensor)

print(output)

专用硬件

专用硬件如GPU、TPU和FPGA等,能够为大模型的推理提供高效的计算支持。通过利用专用硬件的并行计算能力,大模型能够在推理阶段显著提高性能。

import torch

import torch.nn as nn

# Check if a GPU is available

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

model = models.resnet50(pretrained=True).to(device)

input_tensor = torch.randn(1, 3, 224, 224).to(device)

output = model(input_tensor)

print(output)

未来展望

跨领域应用

随着大模型的不断发展和优化,机器学习和大模型的融合应用将在更多领域得到拓展。未来,大模型将在医疗、金融、教育、能源等领域发挥更大的作用,为各行各业带来深远的影响和变革。

智能化系统

未来的智能化系统将更加依赖于大模型的支持。通过将大模型应用于智能制造、智能交通和智慧城市等领域,可以实现更加高效、智能和自动化的系统,提高生产效率和生活质量。

人工智能伦理

随着大模型的广泛应用,人工智能伦理问题将变得更加重要。如何确保大模型的公平性、透明性和可解释性,如何保护用户隐私,如何防止大模型被滥用,将是未来需要重点关注的问题。

技术创新

未来,机器学习和大模型领域将继续涌现出新的技术创新。新型神经网络架构、更加高效的训练算法、更智能的优化技术等,将推动大模型的性能进一步提升,开创更多的应用场景和可能性。

结论

机器学习与大模型的融合应用在人工智能领域展现了巨大的潜力和前景。通过对机器学习和大模型的深入理解和研究,结合实际应用中的需求,开发者可以构建出高性能、智能化的系统,实现智能预测和数据分析。在实际应用中,通过模型压缩、分布式训练和高效推理等性能优化技术,可以进一步提升大模型的应用效率和性能。未来,随着技术的不断创新和发展,机器学习与大模型的融合应用将为各行各业带来更多的机遇和挑战。希望本文能够为开发者提供有价值的参考和指导,推动机器学习与大模型在人工智能领域的持续发展和应用。

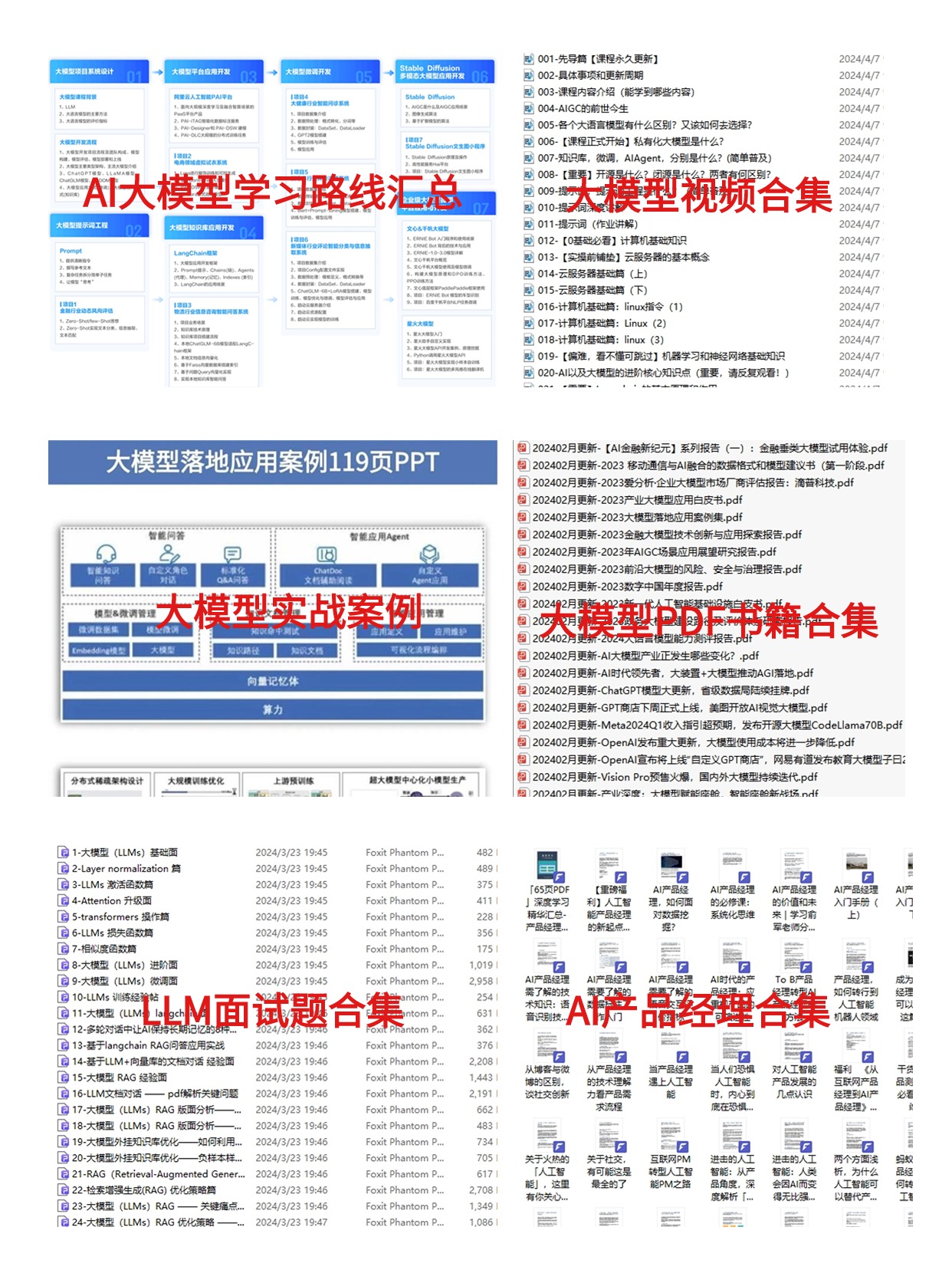

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓