痛点1:知识缺失

知识库缺乏必要的上下文信息,导致 RAG 系统在无法找到确切答案时,可能会提供模棱两可的错误信息,而不是直接表明其无知。这种情况下,用户可能会接收到误导性的信息,从而感到沮丧。针对这一问题,有以下两种解决方案:

解决方案一:优化数据质量

“垃圾输入,垃圾输出。” 若源数据质量不佳,比如:存在相互矛盾的信息,即便是再完美的 RAG 流程也无法从劣质数据中提炼出有价值的知识。以下提出的解决方案不仅能解决这一难题,还能应对本文中提到的其他问题。高质量的数据是确保 RAG 流程顺畅运行的关键。

以下是一些常见的数据优化策略:

1. 清除噪音和无关信息:包括移除特殊字符、停用词(比如:“the”和“a”等常见词汇)以及 HTML 标签。

2. 识别并修正错误:涉及拼写错误、打字错误和语法错误。拼写检查工具和语言模型等资源对此很有帮助。

3. 去除重复数据:消除可能干扰检索过程的重复或相似记录。

解决方案二:优化提示词设计

由于知识库信息不足,系统可能会提供看似合理却错误的答案。在这种情况下,优化提示词可以显著提升系统表现。通过使用“若你不确定答案,请表明你不知道”等提示词,可以引导大模型承认其局限,并更清晰地表达不确定性。虽然这不能确保答案的绝对正确性,但在数据优化之后,设计恰当的提示词是提高系统透明度的有效手段之一。

**—2**__—

痛点2:更相关的知识没有检索出来

在初步检索阶段知识未能被检索出来。关键的文档可能没有在检索组件给出的初步结果中,导致正确答案被遗漏,大模型因此无法提供精确的响应。研究指出:“问题的答案其实就藏在文档里,只是因为它排名不够高,所以没有被呈现给用户。”针对这一问题,有以下两种解决方案:

解决方案一:调整 chunk_size 和 similarity_top_k 超参数

在 RAG 模型中,chunk_size 和 similarity_top_k 是控制数据检索效率和准确性的两个关键参数。对这些参数的调整会影响到计算效率和信息检索质量之间的平衡。

解决方案二:Rerank 重排序

在将检索结果传递给大语言模型(LLM)之前对其进行重新排序,可以显著增强 RAG 系统的性能。LlamaIndex 的笔记揭示了有无重新排序的差别:

-

未经重新排序直接获取前两个节点的检索结果,导致结果不够精确。

-

相比之下,检索前 10 个节点并利用 CohereRerank 进行重排序,然后仅返回前两个节点,可以实现更精确的检索。

``import os` `from llama _ index.postprocessor.cohere _ rerank import CohereRerank` ` ``api _ key = os.environ [ "COHERE _ API _ KEY" ]` `cohere _ rerank = CohereRerank ( api _ key=api _ key , top _ n=2 ) # return top 2 nodes from reranker` ` ``query _ engine = index.as _ query _ engine (` `similarity _ top _ k=10 , # we can set a high top _ k here to ensure maximum relevant retrieval` `node _ postprocessors= [ cohere _ rerank ], # pass the reranker to node _ postprocessors ``)` ` ``response = query _ engine.query ( `` "What did Sam Altman do in this essay?" , `` )

**—3**__—

痛点3:格式错误

输出格式不正确。当大语言模型(LLM)未能遵循以特定格式(比如:表格或列表)提取信息的指令时,我们提出了以下四种解决方案:

解决方案一:优化提示词设计

为了改善提示词并解决这一问题,可以采取以下几种策略:

-

明确指出格式要求。

-

简化指令并突出关键术语。

-

提供具体示例。

-

对提示词进行迭代并追加相关问题。

解决方案二:输出解析方法

输出解析可以用于以下目的,以确保获得期望的输出格式:

-

为每个提示/查询提供格式化指南。

-

对LLM的输出进行“解析”处理。

以下是一个使用 LangChain 输出解析模块的示例代码片段,该模块可在LlamaIndex 中应用。

``from llama _ index.core import VectorStoreIndex , SimpleDirectoryReader` `from llama _ index.core.output _ parsers import LangchainOutputParser` `from llama _ index.llms.openai import OpenAI` `from langchain.output _ parsers import StructuredOutputParser , ResponseSchema` ` ` `# load documents , build index` `documents = SimpleDirectoryReader ( " .. /paul _ graham _ essay/data" ).load _ data ( )` `index = VectorStoreIndex.from _ documents ( documents )`` ` `# define output schema` `response _ schemas = [` `ResponseSchema (` `name= "Education" ,` `description= "Describes the author's educational experience/background." , ``) ,` `ResponseSchema (` `name= "Work" ,` `description= "Describes the author's work experience/background." , `` ) , ``]` ` ` `# define output parser` `lc _ output _ parser = StructuredOutputParser.from _ response _ schemas (` `response _ schemas ``)` `output _ parser = LangchainOutputParser ( lc _ output _ parser )`` ` `# Attach output parser to LLM` `llm = OpenAI ( output _ parser=output _ parser )`` ` `# obtain a structured response` `query _ engine = index.as _ query _ engine ( llm=llm )``response = query _ engine.query ( `` "What are a few things the author did growing up?" , ``)` `print ( str ( response ))

解决方案三:Pydantic 程序

Pydantic 程序是一个多功能的框架,它能够将输入的字符串转换成结构化的 Pydantic 对象。LlamaIndex 提供了几种不同类型的 Pydantic 程序:

LLM 文本补全 Pydantic 程序:这类程序负责处理输入的文本,并将其转换成用户自定义的结构化对象,这个过程结合了文本补全 API 和输出解析。

LLM 函数调用 Pydantic 程序:这些程序通过使用 LLM 函数调用 API 来处理输入文本,并将其转换成用户指定的结构化对象。

预制 Pydantic 程序:这些程序设计用于将输入文本转换成预定义的结构化对象。

以下是一个使用 OpenAI 的 Pydantic 程序的示例代码片段:

from pydantic import BaseModel` `from typing import List` ` ``from llama _ index.program.openai import OpenAIPydanticProgram` ` ` `# Define output schema ( without docstring )``class Song ( BaseModel ) :` `title : str` `length _ seconds : int` ` `` ``class Album ( BaseModel ) :` `name : str` `artist : str` `songs : List [ Song ]`` ` `# Define openai pydantic program` `prompt _ template _ str = """\` `Generate an example album , with an artist and a list of songs.\` `Using the movie { movie _ name } as inspiration.\ ``"""` `program = OpenAIPydanticProgram.from _ defaults (` `output _ cls=Album , prompt _ template _ str=prompt _ template _ str , verbose= True ``)` ` ` `# Run program to get structured output` `output = program (` `movie _ name= "The Shining" , description= "Data model for an album." `` )

**解决方案四:**OpenAI JSON 模式

通过OpenAI的 JSON 模式,我们可以将`response_format`设置为`{ “type”: “json_object” }`,从而激活响应的 JSON 模式。当启用 JSON 模式后,大模型将被限制仅生成可以解析为有效 JSON 对象的字符串。JSON 模式确保了输出格式的强制性,但它并不支持根据特定模式进行验证。

**—4**__—

痛点4:输出不完整

回答缺失完整性。虽然部分答复没有错误,但它们并未包含所有必要的细节,即便这些信息在上下文中是可获取的。比如:当有人提问:“文档A、B和C中讨论的主要议题是什么?”为了确保回答的完整性,单独对每份文档进行查询可能更为有效。

解决方案一:查询变换

在最初的 RAG 方法中,比较类型的问题表现尤为不佳。提升 RAG 推理能力的一个有效方法是引入查询理解层——在实际将查询向量存入存储之前进行查询变换。以下是四种不同的查询变换方法:

1. 路由:保留原始查询,并识别出与之相关的合适工具子集。随后,将这些工具指定为合适的选项。

2. 查询重写:保留选定的工具,但以不同方式重新构建查询,以便在同一工具集中应用。

3. 子问题分解:将查询拆分为几个更小的问题,每个问题针对不同的工具,由其元数据来决定。

4. ReAct Agent 工具选择:基于原始查询,确定使用的工具,并制定在该工具上运行的特定查询。

请参考以下示例代码片段,了解如何应用 HyDE(假设文档嵌入)这一查询重写技术。给定一个自然语言查询,首先生成一个假设文档/答案。接着,使用这个假设文档进行嵌入搜索,而不是使用原始查询。

`# load documents , build index` `documents = SimpleDirectoryReader ( " .. /paul _ graham _ essay/data" ).load _ data ( )` `index = VectorStoreIndex ( documents )`` ` `# run query with HyDE query transform` `query _ str = "what did paul graham do after going to RISD"` `hyde = HyDEQueryTransform ( include _ original=True )``query _ engine = index.as _ query _ engine ( )` `query _ engine = TransformQueryEngine ( query _ engine , query _ transform=hyde )`` ``response = query _ engine.query ( query _ str )``print ( response )`

为了帮助同学们彻底掌握大模型的应用开发、LangChain、RAG、Agent、Fine-tuning 微调、预训练、Prompt Engineering、向量数据库、部署、生产化,请同学们点击以下扫描

那么,如何系统的去学习大模型LLM?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

篇幅有限,部分资料如下:

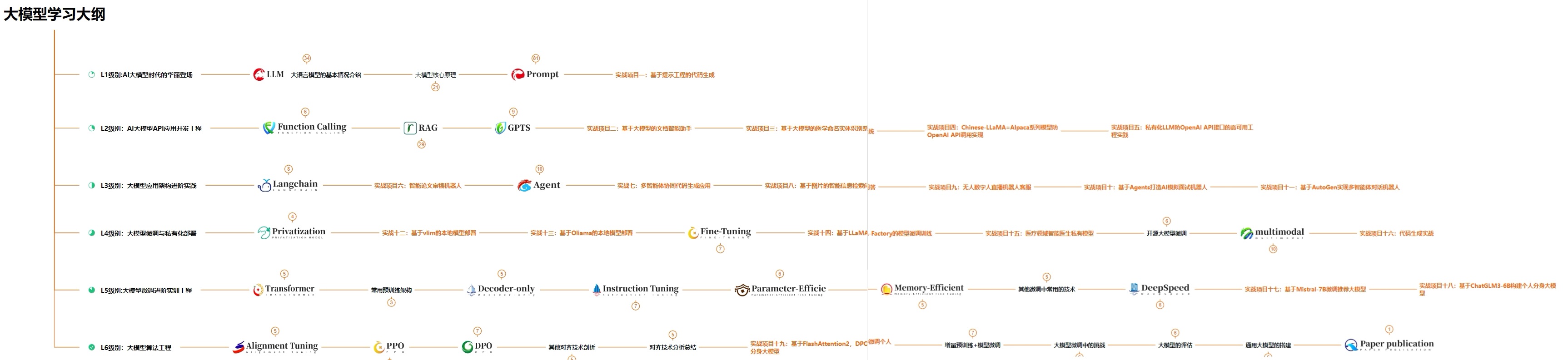

👉LLM大模型学习指南+路线汇总👈

💥大模型入门要点,扫盲必看!

💥既然要系统的学习大模型,那么学习路线是必不可少的,这份路线能帮助你快速梳理知识,形成自己的体系。

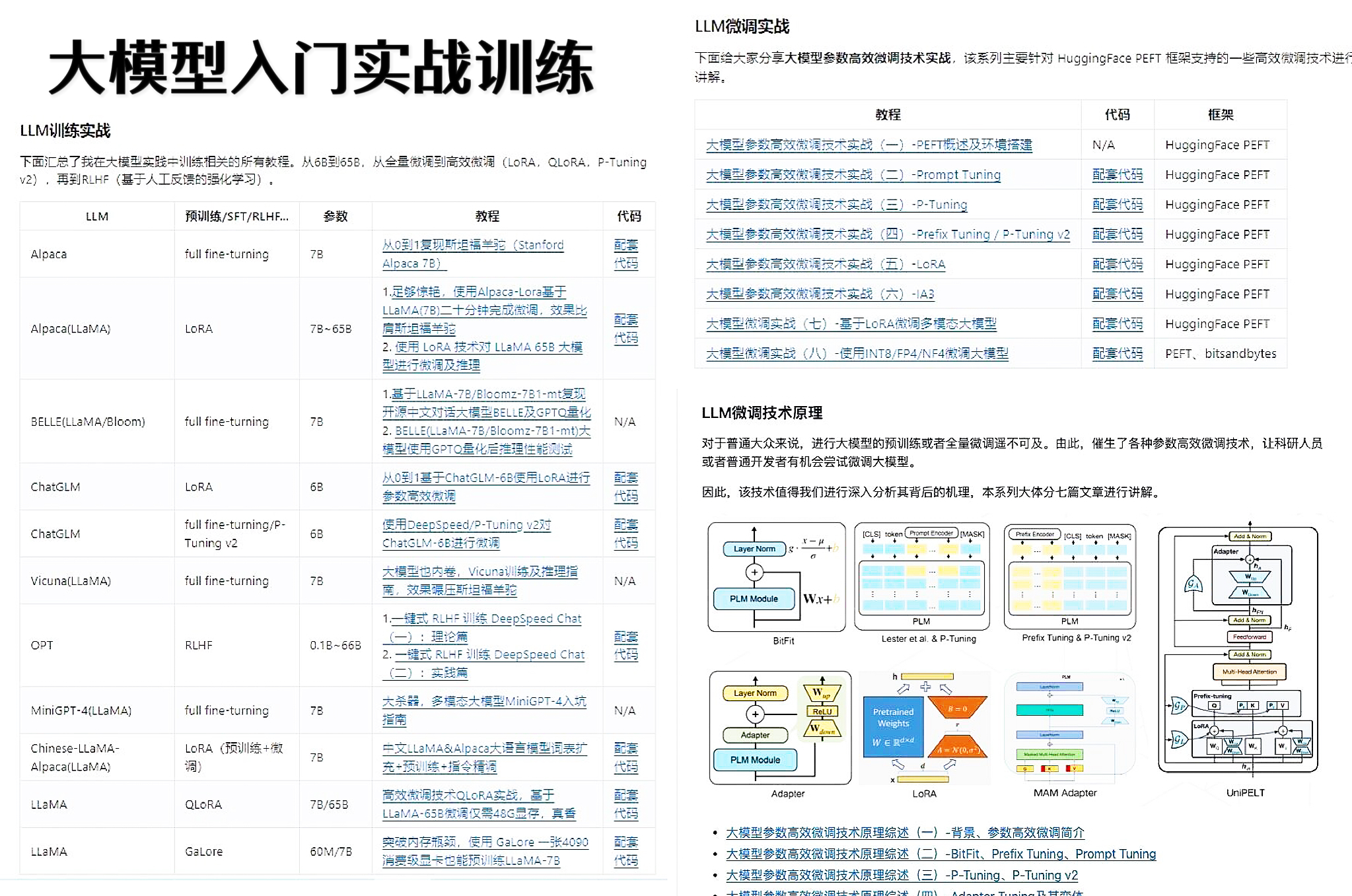

👉大模型入门实战训练👈

💥光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

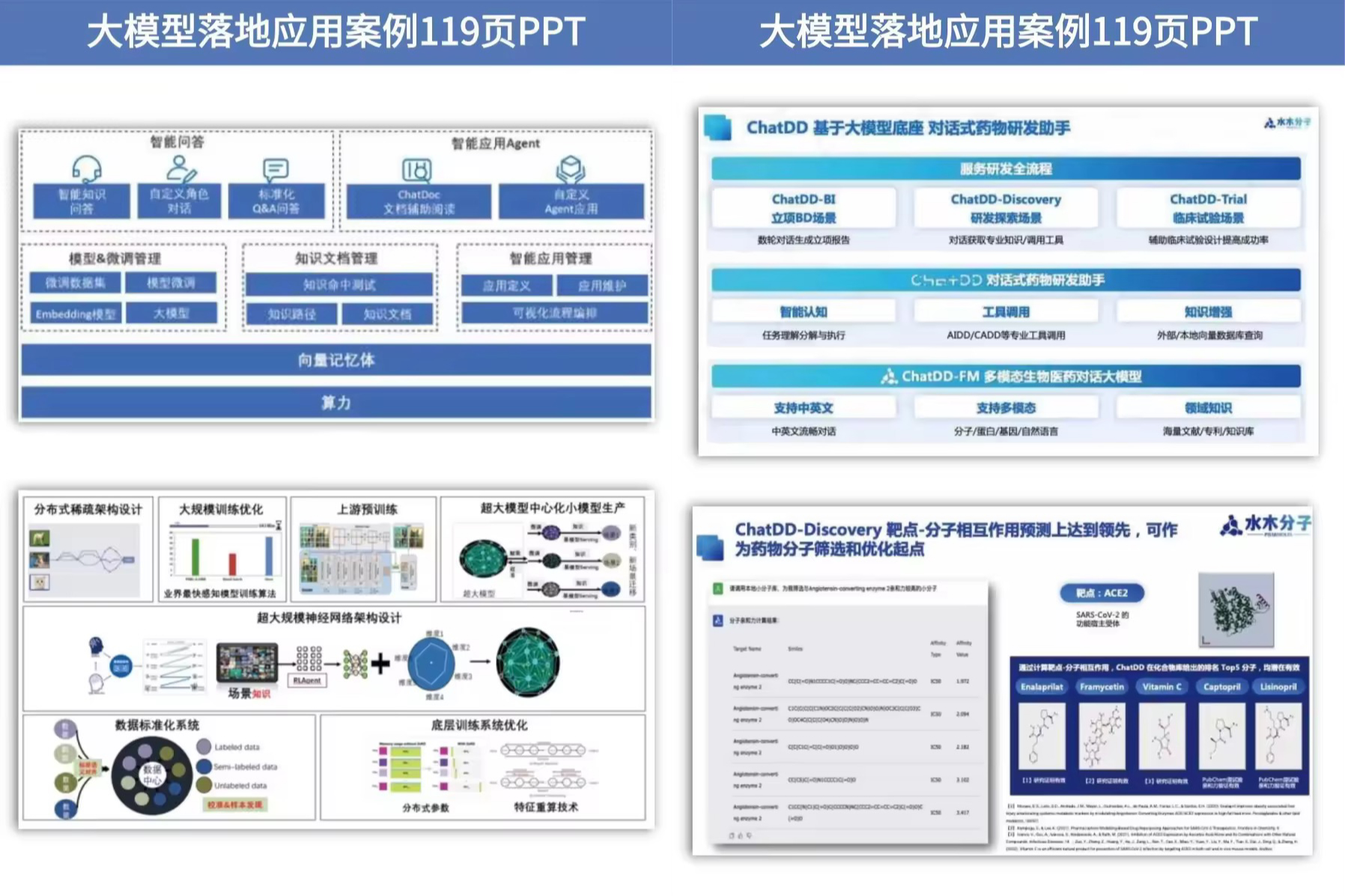

👉国内企业大模型落地应用案例👈

💥《中国大模型落地应用案例集》 收录了52个优秀的大模型落地应用案例,这些案例覆盖了金融、医疗、教育、交通、制造等众多领域,无论是对于大模型技术的研究者,还是对于希望了解大模型技术在实际业务中如何应用的业内人士,都具有很高的参考价值。 (文末领取)

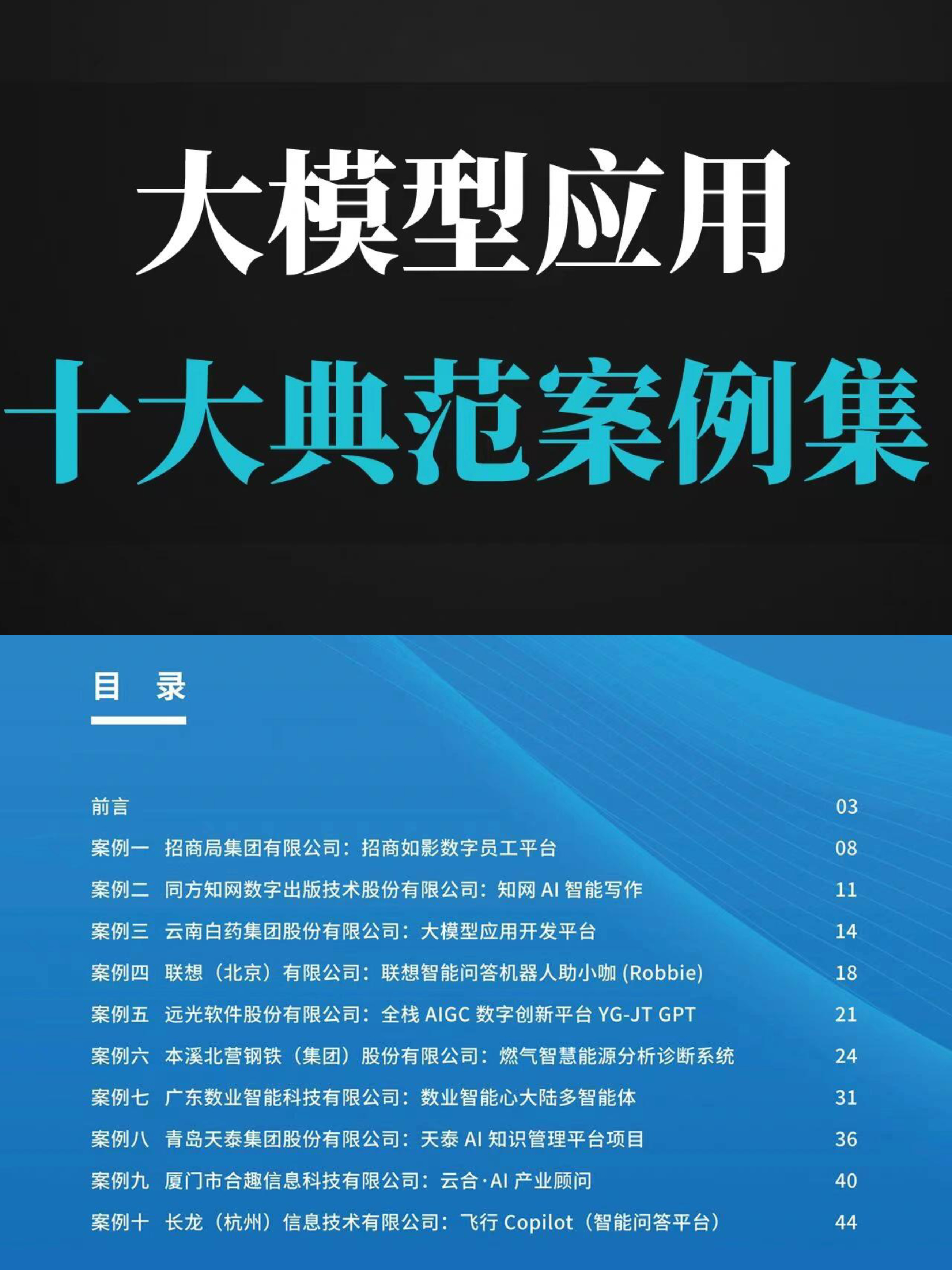

💥《2024大模型行业应用十大典范案例集》 汇集了文化、医药、IT、钢铁、航空、企业服务等行业在大模型应用领域的典范案例。

👉LLM大模型学习视频👈

💥观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。 (文末领取)

👉640份大模型行业报告👈

💥包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉获取方式:

这份完整版的大模型 LLM 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

😝有需要的小伙伴,可以Vx扫描下方二维码免费领取🆓