多模态融合(Multimodal Fusion)是指结合来自不同模态(如视觉、听觉、文本等)的数据,以提升信息处理和理解能力的技术方法。多模态数据通常具有不同的物理性质和信息特征,通过融合这些多模态信息,可以获得更全面和准确的理解。这种融合过程可以发生在数据层、特征层和决策层。

我还整理出了相关的论文+开源代码,以下是精选部分论文

更多论文料可以关注

论文1

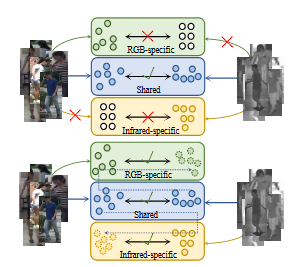

Cross-modality Person re-identification with Shared-Specific Feature Transfer

跨模态行人再识别中的共享-特定特征转移

方法:

-

两流特征提取器:输入图像首先通过两流特征提取器获取共享特征和特定特征。

-

共享-特定转移网络(SSTN):建模不同模态样本之间的亲和性,并在模态间传播共享和特定特征,以补偿缺乏的特定信息并增强共享特征。

-

互补特征学习策略:包括模态适应、项目对抗学习和重建增强,用于学习每个模态的判别性和互补的共享和特定特征。

-

端到端训练:整个cm-SSFT算法可以端到端地训练,通过分类损失和三元组损失来优化特征学习过程。

创新点:

-

性能提升:在SYSU-MM01和RegDB两个主流基准数据集上,分别显著优于现有技术22.5%和19.3%的mAP,以及19.2%和14.4%的Rank1准确率。

-

特征转移方法:通过建模模态间和模态内的亲和性来传播信息,有效利用每个样本的共享和特定信息,克服了传统共享特征学习方法的局限性。

-

互补学习方法:提出了一种新的互补学习方法,分别提取每个模态的判别性和互补的共享和特定特征,进一步增强了cm-SSFT的有效性。

论文2

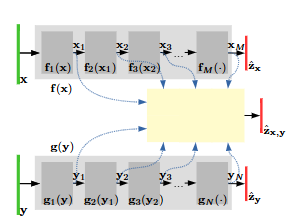

MFAS: Multimodal Fusion Architecture Search

MFAS:多模态融合架构搜索

方法:

-

多模态融合搜索空间:定义了一个新的通用搜索空间,涵盖了大量可能的融合架构,考虑了从所有隐藏层提取的特征。

-

顺序模型基础优化(SMBO):采用SMBO方案,通过逐步探索搜索空间,利用代理模型预测架构性能,减少需要训练和评估的神经网络数量。

-

融合层设计:每个融合层结合了前一个融合层的输出和每个模态的一个输出,通过可训练的权重矩阵和非线性激活函数进行融合。

-

温度控制采样:在搜索过程中使用温度控制的采样策略,随着搜索的推进逐渐降低温度,减少采样偏差。

创新点:

-

性能提升:在AV-MNIST、MM-IMDB和NTU RGB+D三个数据集上,发现的融合架构均达到了最先进的性能,例如在NTU RGB+D数据集上,平均准确率达到了90.04%,显著优于所有基线和竞争方法。

-

搜索空间设计:提出的搜索空间是现代融合方法的超集,允许更灵活的融合架构设计,同时保持了问题的复杂性在可管理的范围内。

-

采样效率:通过SMBO和温度控制采样,提高了采样效率,减少了搜索过程中需要训练的架构数量,降低了计算成本。

-

融合架构的自动发现:首次将多模态融合问题直接作为架构搜索问题来解决,通过自动搜索方法发现了多个针对不同多模态问题的先进融合架构。

论文3

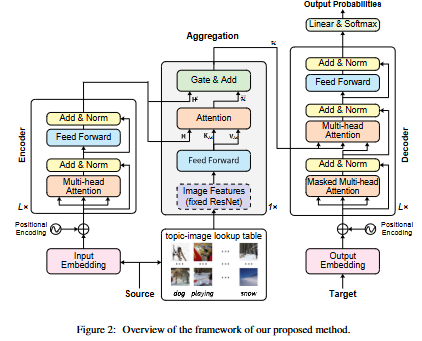

Neural Machine Translation with Universal Visual Representation

具有通用视觉表示的神经机器翻译

方法:

-

通用视觉表示(VR):提出了一种仅依赖单语图像注释的通用视觉表示方法,打破了现有方法依赖双语图像注释的限制。

-

主题-图像查找表:将现有的句子-图像对转换为主题-图像查找表,通过词频-逆文档频率(TF-IDF)技术从大规模单模态数据中学习,以便在训练和解码过程中检索与源句子主题相似的图像组。

-

预训练的ResNet编码:使用预训练的ResNet对检索到的图像进行编码,生成图像表示。

-

注意力层融合:设计了一个简单有效的注意力层,通过门控权重将视觉信息和文本信息融合,作为解码器的输入,用于预测目标翻译。

创新点:

-

性能提升:在WMT’16英译罗、WMT’14英译德、WMT’14英译法和Multi30K四个广泛使用的翻译数据集上,与强大的基线系统相比,所提出的方法取得了显著的改进。例如,在WMT’16英译罗任务中,与Transformer(base)相比,+VR方法的BLEU分数从32.66提升到33.78。

-

视觉信息整合:提出的方法使纯文本NMT能够利用视觉信息,而无需对大规模双语平行语料库进行注释,拓展了图像在NMT中的应用范围。

-

计算效率:与基线模型相比,引入的额外参数较少,训练时间基本相同,且获取图像数据和学习图像表示的额外计算成本相对较低。

论文4

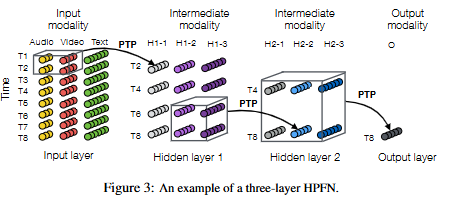

Deep Multimodal Multilinear Fusion with High-order Polynomial Pooling

具有高阶多项式池化的深度多模态多线性融合

方法:

-

多项式张量池化(PTP)块:提出了一种PTP块,通过考虑高阶矩来整合多模态特征,随后是一个张量化的全连接层。

-

层次多项式融合网络(HPFN):将PTP作为构建块,进一步建立HPFN,以递归方式将局部相关性传输到全局相关性。

-

张量积表示:利用张量积表示来模拟双线性/三线性跨模态交互,通过学习低秩张量因子来有效减少融合参数,同时保持表达三模态(三线性)交互的能力。

-

模型复杂度控制:通过采用低秩张量网络(TNs)来近似权重张量,有效避免了参数数量随多项式阶数指数增长的问题。

创新点:

-

性能提升:在两个多模态任务上的实验验证了HPFN的优越性能。例如,在CMU-MOSI数据集上,HPFN在‘Acc-7’指标上超过了之前的最佳模型MARN 2.2%。

-

高阶交互建模:PTP块能够显式地模拟高阶非线性模态内和模态间交互,对于多模态时间序列数据,可以直接在时间维度和模态维度的扫描接收‘窗口’内建模局部交互。

-

层次结构优势:通过堆叠多个PTP块,HPFN的表达能力随层数呈指数增长,这通过与非常深的卷积算术电路的等价性得到证明。

-

局部到全局相关性建模:HPFN能够以更细的粒度捕获局部交互,并将主要的局部相关性有效地传输到全局尺度,这对于处理多模态时间序列数据尤为重要。

更多论文料可以关注