深度强化学习实验室

官网:http://www.neurondance.com/

论坛:http://deeprl.neurondance.com/

近年来,强化学习(RL)在游戏界的成功在AI界可谓一石激起千层浪,不管是继围棋之后又攻克的通用棋类游戏,还是在Video Game里创造新高的AI,亦或是利用“左右互博”来自博弈的OpenAI,结合强化学习技术的 AI在多个游戏场景中的都已经超越了人类顶尖玩家。

然而,当前的强化学习算法依赖数万次、乃至数百万次对局的试错,游戏之类的虚拟场景尚可低成本试错,但是,在实际场景中试错代价高昂,无法进行大量采样,因而难以训练出有效的决策模型,导致落地困难。

目前国际上强化学习领域的主要研究机构,包括Google、DeepMind、OpenAI、UC Berkeley、Stanford等都在对强化学习落地技术积极开展研究,这个细分方向通常被称为“离线强化学习(Offline RL)”,但从相关公开报告中,都难以瞥见强化学习可以落地的技术。

近期,DeepMind、Google Brain等各自发布了 “离线强化学习”测试集,显示出目前主流技术均未表现出显著的有效性。强化学习落地技术呈现出潜能巨大、亟需突破、竞争激烈的态势。

7月23日,针对强化学习落地难题,ICML 2021将举办“Reinforcement Learning for Real Life(现实生活中的强化学习)”主题研讨会。此次研讨会主题设置为“RL for Real Life”,彰显了强化学习领域长期存在的困境:强化学习在现实世界中迟迟无法完成落地。而与此同时,强化学习背后隐藏着巨大商业价值已成为共识,一旦完成落地,商业前景极为广阔。强化学习如何落地?如何在Real Life(现实世界)中体现出商业价值?为此Workshop邀请了DeepMind,Google、Polixir(南栖仙策)、Facebook,Microsoft,MathWorks、Nvidia、Adobe、Didi(美国)等众多商业公司,共同探讨强化学习落地难题,寻找突破路径。

研讨会围绕Real Life(现实世界)主题设置讨论小组,议题包括“Foundation”(基础)、“Research-to-RealLife Gap”(研究与现实世界的差距)、“Recommender Systems”(推荐系统)、“Robotics”(机器人)、“Explainability & Interpretability”(可解释性)和“Operations Research”(运筹学)。

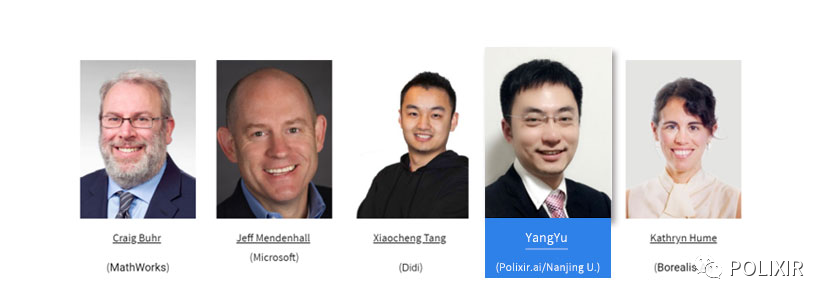

在以上主题中,“Research-to-RealLife Gap”(研究与现实世界的差距)专门关注强化学习当前的研究与现实应用之间的鸿沟、聚焦强化学习落地的关键问题,受邀参加主题讨论的有来自MathWorks(出品Matlab)的Craig Buhr、微软的Jeff Mendenhall、滴滴出行(美国)的Xiaocheng Tang、创业企业Borealis AI的Kathryn Hume,以及Polixir(南栖仙策)创始人、南京大学教授俞扬(Yang Yu)。俞扬教授也是本次Workshop中唯一来自大陆地区的讨论成员。

RL Research-to-RealLife Gap 小组

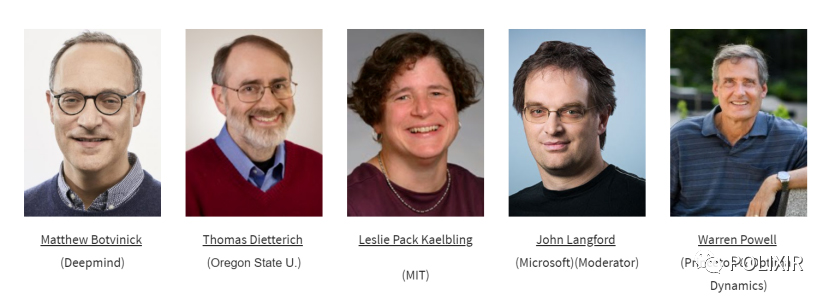

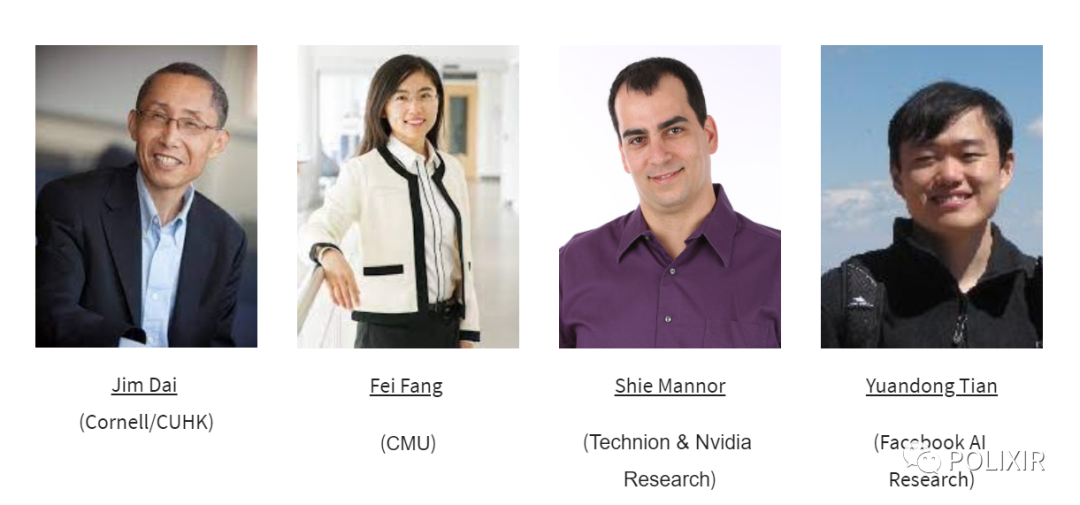

此次Workshop不乏来自MIT、CMU、Harvard等国际著名高校的学者。其中Thomas Dietterich 是国际机器学习创始主席、美国白宫《美国国家人工智能研究与发展策略规划》起草人;Fei Fang 获得IEEE国际人工智能十大新星(2020)、IJCAI 计算机与思维奖(2021),其他参会组员均为强化学习研究领域一流学者,共同激撞强化学习学术前沿的思想火花。

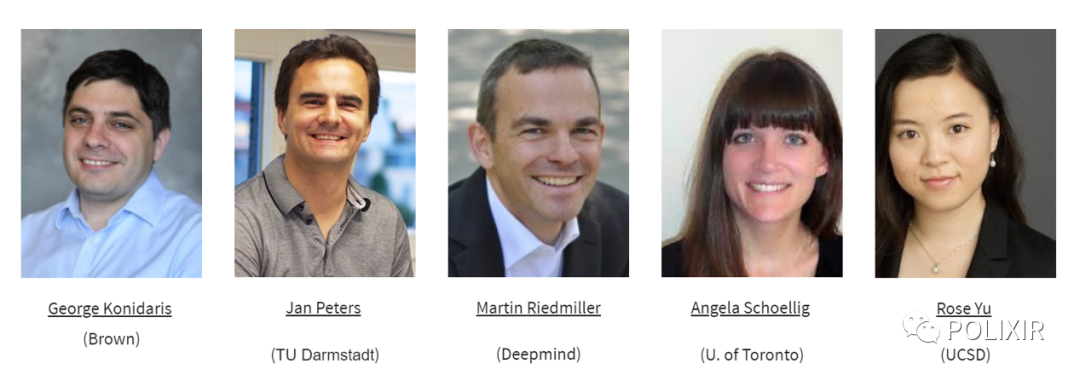

RL + Recommender Systems 小组

RL + Robotics Panel 小组

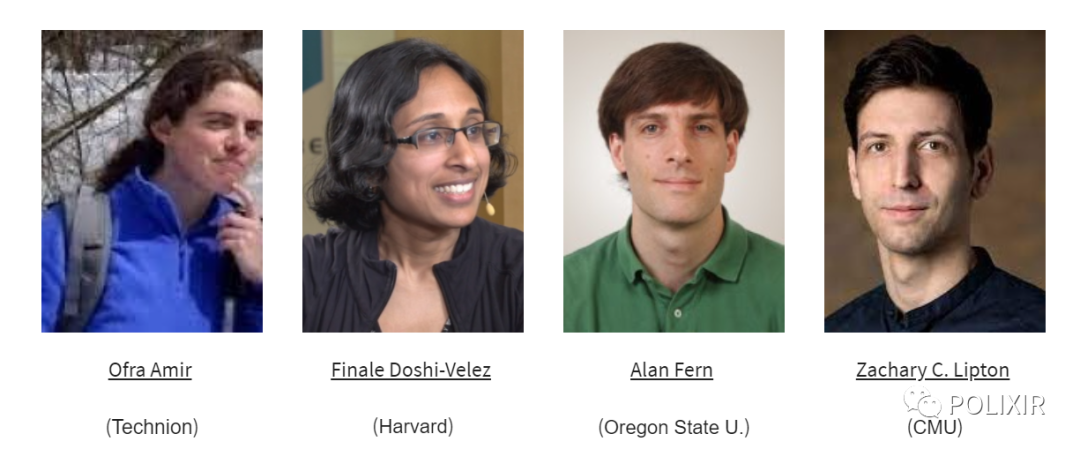

RL Explainability & Interpretability 小组

众多商业巨头公司聚焦此次研讨会,凸显出强化学习落地技术亟需突破的迫切性。作为全球率先实现强化学习落地的公司,Polixir(南栖仙策)也是大陆唯一受邀企业,并将在研讨会上分享强化学习落地过程,以及南栖仙策在现实世界中的落地案例。

ICML2021 RL4RealLife Workshop 更多活动详情,访问

https://sites.google.com/view/RL4RealLife

完

总结3: 《强化学习导论》代码/习题答案大全

总结6: 万字总结 || 强化学习之路

完

第112篇:基于Novelty-Pursuit的高效探索方法

第111篇:Reward is enough奖励机制实现各种目标。

第110篇:163篇ICML2021强化学习领域论文汇总

第109篇:【Easy-RL】200页强化学习总结笔记

第108篇:清华大学李升波老师《强化学习与控制》

第107篇:阿里巴巴2022届强化学习实习生招聘

第106篇:奖励机制不合理:内卷,如何解决?

第105篇:FinRL: 一个量化金融自动交易RL库

第104篇:RPG: 通过奖励发现多智能体多样性策略

第103篇:解决MAPPO(Multi-Agent PPO)技巧

第102篇:82篇AAAI2021强化学习论文接收列表

第101篇:OpenAI科学家提出全新强化学习算法

第100篇:Alchemy: 元强化学习(meta-RL)基准环境

第98篇:全面总结(值函数与优势函数)的估计方法

第97篇:MuZero算法过程详细解读

第96篇: 值分布强化学习(Distributional RL)总结

第95篇:如何提高"强化学习算法模型"的泛化能力?

第94篇:多智能体强化学习《星际争霸II》研究

第93篇:MuZero在Atari基准上取得了新SOTA效果

第91篇:详解用TD3算法通关BipedalWalker环境

第88篇:分层强化学习(HRL)全面总结

第85篇:279页总结"基于模型的强化学习方法"

第84篇:阿里强化学习领域研究助理/实习生招聘

第83篇:180篇NIPS2020顶会强化学习论文

第81篇:《综述》多智能体强化学习算法理论研究

第80篇:强化学习《奖励函数设计》详细解读

第79篇: 诺亚方舟开源高性能强化学习库“刑天”

第77篇:深度强化学习工程师/研究员面试指南

第75篇:Distributional Soft Actor-Critic算法

第74篇:【中文公益公开课】RLChina2020

第73篇:Tensorflow2.0实现29种深度强化学习算法

第72篇:【万字长文】解决强化学习"稀疏奖励"

第71篇:【公开课】高级强化学习专题

第70篇:DeepMind发布"离线强化学习基准“

第66篇:分布式强化学习框架Acme,并行性加强

第65篇:DQN系列(3): 优先级经验回放(PER)

第64篇:UC Berkeley开源RAD来改进强化学习算法

第61篇:David Sliver 亲自讲解AlphaGo、Zero

第59篇:Agent57在所有经典Atari 游戏中吊打人类

第58篇:清华开源「天授」强化学习平台

第57篇:Google发布"强化学习"框架"SEED RL"

第53篇:TRPO/PPO提出者John Schulman谈科研

第52篇:《强化学习》可复现性和稳健性,如何解决?

第51篇:强化学习和最优控制的《十个关键点》

第50篇:微软全球深度强化学习开源项目开放申请

第49篇:DeepMind发布强化学习库 RLax

第48篇:AlphaStar过程详解笔记

第47篇:Exploration-Exploitation难题解决方法

第45篇:DQN系列(1): Double Q-learning

第44篇:科研界最全工具汇总

第42篇:深度强化学习入门到精通资料综述

第41篇:顶会征稿 || ICAPS2020: DeepRL

第40篇:实习生招聘 || 华为诺亚方舟实验室

第39篇:滴滴实习生|| 深度强化学习方向

第37篇:Call For Papers# IJCNN2020-DeepRL

第36篇:复现"深度强化学习"论文的经验之谈

第35篇:α-Rank算法之DeepMind及Huawei改进

第34篇:从Paper到Coding, DRL挑战34类游戏

第31篇:强化学习,路在何方?

第30篇:强化学习的三种范例

第29篇:框架ES-MAML:进化策略的元学习方法

第28篇:138页“策略优化”PPT--Pieter Abbeel

第27篇:迁移学习在强化学习中的应用及最新进展

第26篇:深入理解Hindsight Experience Replay

第25篇:10项【深度强化学习】赛事汇总

第24篇:DRL实验中到底需要多少个随机种子?

第23篇:142页"ICML会议"强化学习笔记

第22篇:通过深度强化学习实现通用量子控制

第21篇:《深度强化学习》面试题汇总

第20篇:《深度强化学习》招聘汇总(13家企业)

第19篇:解决反馈稀疏问题之HER原理与代码实现

第17篇:AI Paper | 几个实用工具推荐

第16篇:AI领域:如何做优秀研究并写高水平论文?

第15篇:DeepMind开源三大新框架!

第13篇:OpenSpiel(28种DRL环境+24种DRL算法)

第11篇:DRL在Unity自行车环境中配置与实践

第8篇:ReinforceJS库(动态展示DP、TD、DQN)

第5篇:深度强化学习在阿里巴巴的技术演进

第4篇:深度强化学习十大原则

第2篇:深度强化学习的加速方法

第1篇:深入浅出解读"多巴胺(Dopamine)论文"、环境配置和实例分析