文章目录

前言

Python语言十分简洁,使用起来又非常简单、易学,通过Python 进行编写就像使用英语进行写作一样。

另外Python 在使用中十分方便,并不需要IDE,而仅仅通过sublime text 就能够对大部分的中小应用进行开发;除此之外Python 爬虫的框架功能十分强大,它的框架能够对网络数据进行爬取,还能对结构性的数据进行提取,经常用在数据的挖掘、历史数据的存储和信息的处理等程序内;Python网络的支持库和html的解析器功能十分强大,借助网络的支持库通过较少代码的编写,就能够进行网页的下载,且通过网页的解析库就能够对网页内各标签进行解析,和正则的表达式进行结合,

十分便于进行网页内容的抓取。所以Python在网络爬虫网面有很大的优势。

一、判断网站数据是否支持爬取

几乎每个网站都有一个名为 robots.txt 的文档,当然也有部分网站没有设定robots.txt。

如果网站没有设定 robots.txt 就可以通过网络爬虫获取没有口令加密的数据,也就是这个网站所有页面数据都可以爬取。

当然如果网站有 robots.txt 文档,就要判断是否有禁止访客获取的数据。

二、requests 库抓取网站数据

1.如何安装 requests 库

1.首先在 PyCharm 中安装 requests 库

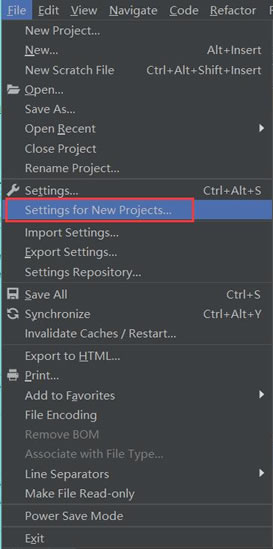

2.打开 PyCharm,单击“File”(文件)菜单

3.选择“Setting for New Projects…”命令

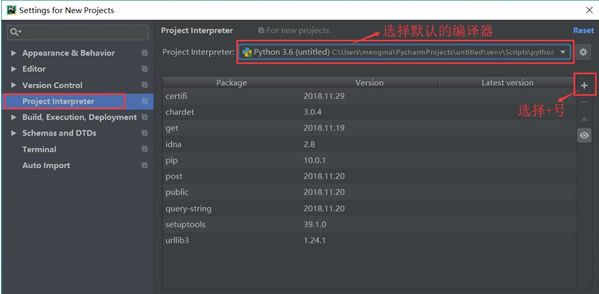

4.选择“Project Interpreter”(项目编译器)命令

5.确认当前选择的编译器,然后单击右上角的加号。

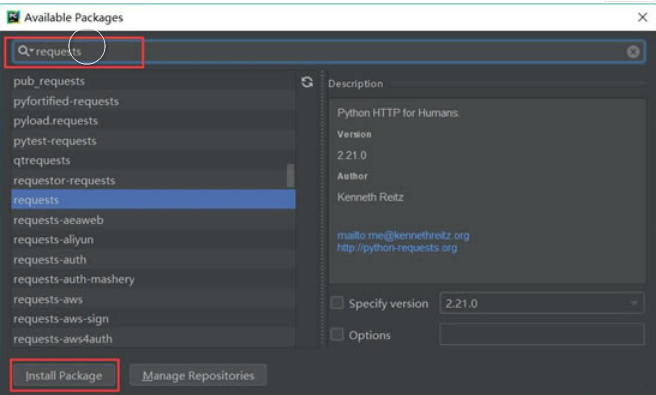

6.在搜索框输入:requests(注意,一定要输入完整,不然容易出错),然后单击左下角的“Install Package”(安装库)按钮。

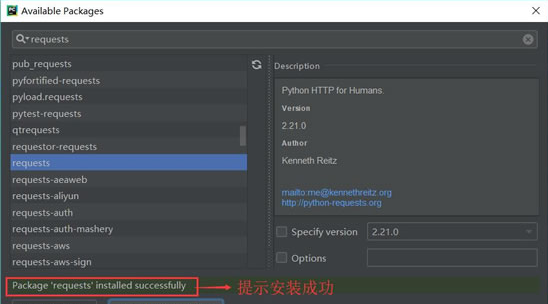

安装完成后,会在 Install Package 上显示“Package‘requests’ installed successfully”(库的请求已成功安装),如果安装不成功将会显示提示信息。

三、爬虫的基本原理

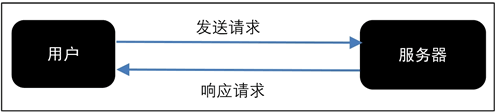

网页请求的过程分为两个环节:

1.Request (请求):每一个展示在用户面前的网页都必须经过这一步,也就是向服务器发送访问请求。

2.Response(响应):服务器在接收到用户的请求后,会验证请求的有效性,然后向用户(客户端)发送响应的内容,客户端接收服务器响应的内容,将内容展示出来,就是我们所熟悉的网页请求

网页请求的方式也分为两种:

1.GET:最常见的方式,一般用于获取或者查询资源信息,也是大多数网站使用的方式,响应速度快。

2.POST:相比 GET 方式,多了以表单形式上传参数的功能,因此除查询信息外,还可以修改信息。

所以,在写爬虫前要先确定向谁发送请求,用什么方式发送。

四、使用 GET 方式抓取数据

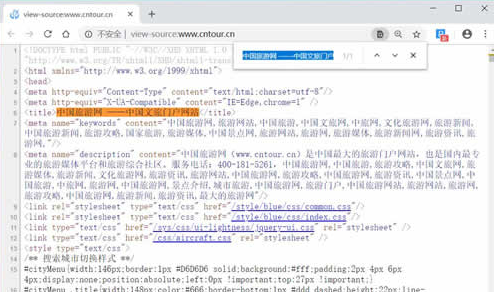

复制任意一条首页首条新闻的标题,在源码页面按【Ctrl+F】组合键调出搜索框,将标题粘贴在搜索框中,然后按【Enter】键。

标题可以在源码中搜索到,请求对象是www.cntour.cn,请求方式是GET(所有在源码中的数据请求方式都是GET),如图所示。

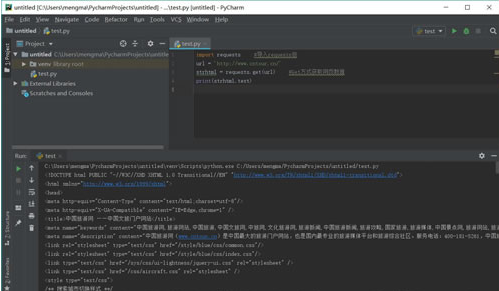

确定好请求对象和方式后,在 PyCharm 中输入以下代码:

import requests #导入requests包

url = 'http://www.cntour.cn/'

strhtml = requests.get(url) #Get方式获取网页数据

print(strhtml.text)

1234<br>

加载库使用的语句是 import+库的名字。在上述过程中,加载 requests 库的语句是:import requests。

用 GET 方式获取数据需要调用 requests 库中的 get 方法,使用方法是在 requests 后输入英文点号,如下所示:

requests.get

1<br>

将获取到的数据存到 strhtml 变量中,代码如下:

strhtml = request.get(url)

1<br>

这个时候 strhtml 是一个 URL 对象,它代表整个网页,但此时只需要网页中的源码,下面的语句表示网页源码:

strhtml.text

1

五、使用 POST 方式抓取数据

首先输入有道翻译的网址:http://fanyi.youdao.com/,进入有道翻译页面。

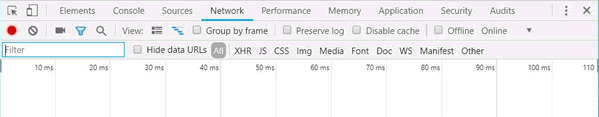

按快捷键 F12,进入开发者模式,单击 Network,此时内容为空,如图所示:

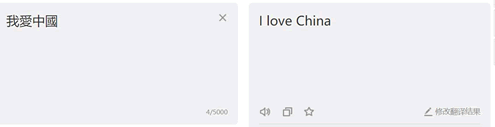

在有道翻译中输入“我爱中国”,单击“翻译”按钮

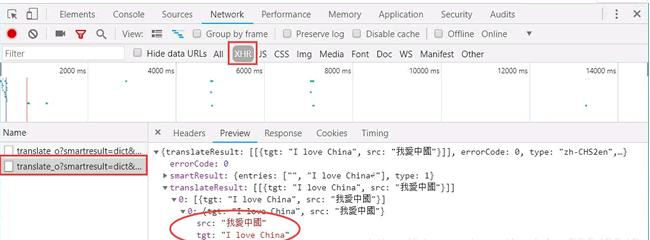

在开发者模式中,依次单击“Network”按钮和“XHR”按钮,找到翻译数据

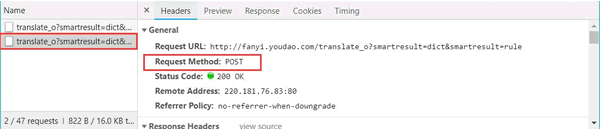

单击 Headers,发现请求数据的方式为 POST。

找到数据所在之处并且明确请求方式之后,接下来开始撰写爬虫。

首先,将 Headers 中的 URL 复制出来,并赋值给 url,代码如下:

url = 'http://fanyi.youdao.com/translate_o?smartresult=dict&smartresult=rule'

1<br