目录

神经网络的初步学习

1、二分分类

神经网络的计算过程:前向传播和反向传播

计算机通过三个独立矩阵保存一张图片,三通道:红、绿、蓝(RGB)

将像素值提取出来放入一个特征向量x中,将所有的红、绿、蓝像素值列出,若图片的尺寸为:64*64,则向量x的总维度为:64 * 64 * 3

x作为输入,预测结果标签y为0或1

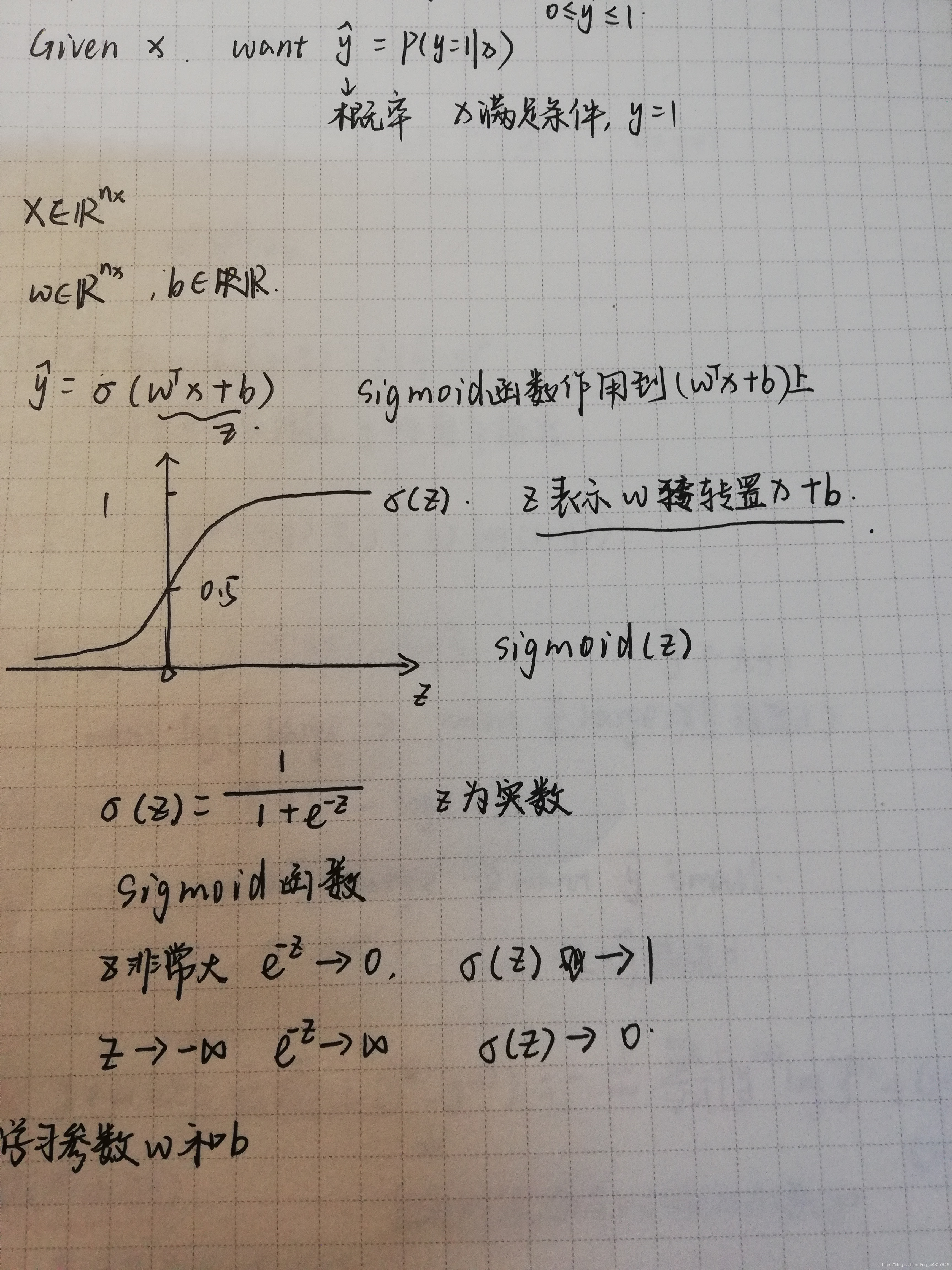

2、logistic回归(非常小的神经网络)

w和b为logistic回归模型的参数

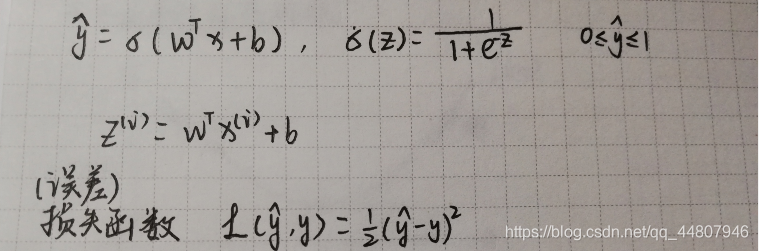

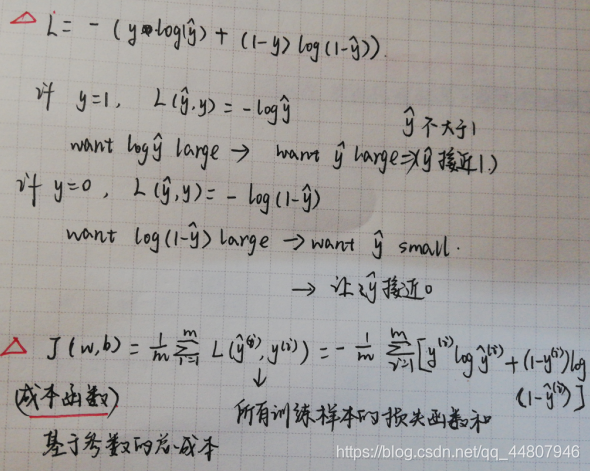

3、logistic回归损失

损失函数用来衡量y估 与实际值y的值有多接近

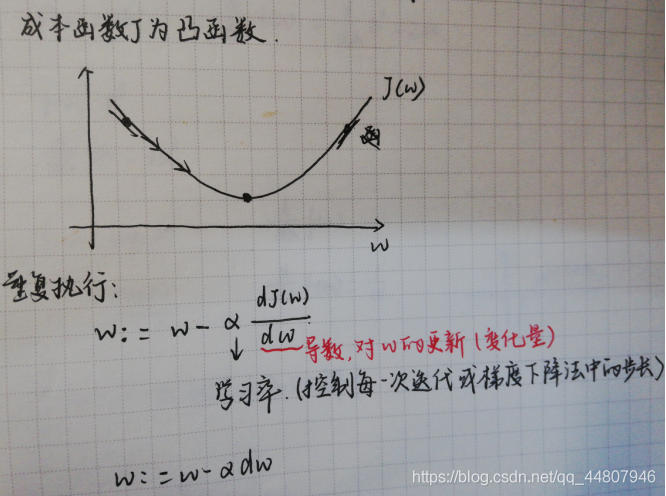

4、梯度下降法

找到w和b,使对应的成本函数 J 值最小

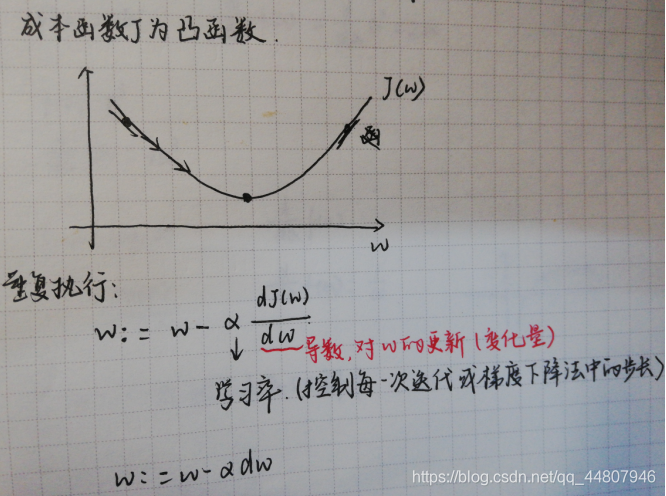

成本函数 J 为凸函数

通过迭代,不断接近最低点,即损失最小的地方

关于神经网络的名词

1、神经元

神经元是神经网络的基本单元,包含有限个输入和一个偏置值。当一信号值输入,乘以一个权重值。如果一个神经元有4个输入,则有4个可以调节的权重值。

2、 偏置(Offset)

偏置是神经元的额外输入,值总为1,且有自己的连接权重,当所有输入为0时,神经元中也存在一个激活函数。

3、激活函数

为神经元引入非线性特征,Sigmoid激活函数的值区间为[0,1]

4、输入层

输入层是神经网络的第一层,接受输入的值传递给下一层,但不执行运算。没有自己的权重值和偏置值

5、隐藏层

一个垂直堆栈的神经元集

6、输出层

神经网络的最后一层,最后一个隐藏层的数据传给输出层,能够得到合理范围内的理想数值,

7、前向传播

把输入值送至神经网络的过程,获得预测值。

8、反向传播

为计算误差,对比带有真实输出值的预测值,使用损失函数计算误差值。运用微积分中的链式法则,先计算最后一层误差值的导数,调用这些导数、梯度,并使用这些梯度值计算倒数第二层的梯度,并重复这一过程直到获得梯度以及每个权重。接着从权重值中减去这一梯度值以降低误差,从而不断接近局部最小值(最小损失)。

9、学习率

在每一次迭代中使用反向传播计算损失函数对每一个权重的导数,并从当前权重减去导数和学习率的乘积。

使用梯度下降优化权重。