在深度学习中,归一化 是提高训练效率和稳定性的关键技术。以下是几种常见的神经网络归一化方法的总结,包括其核心思想、适用场景及优缺点。

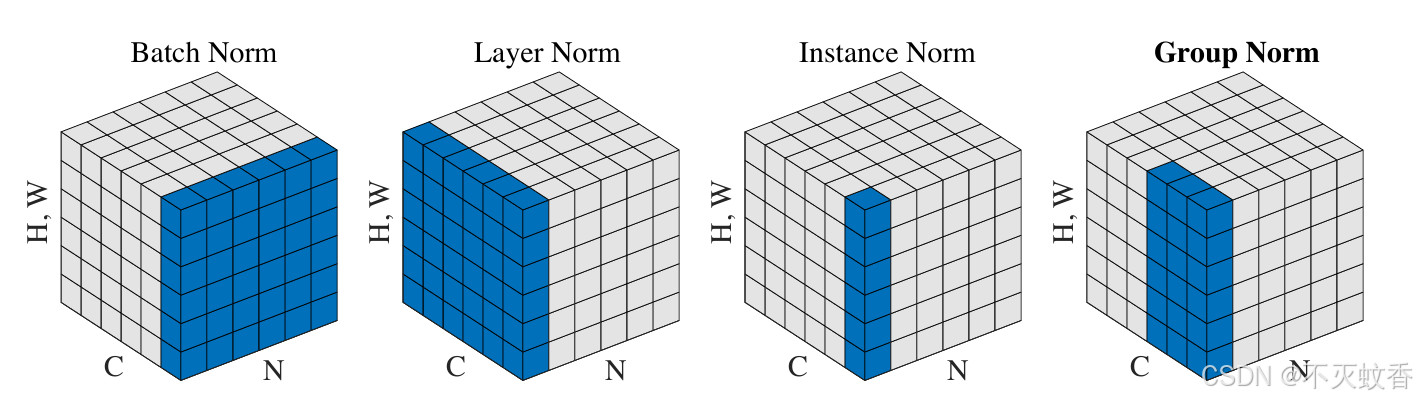

四种归一化

| 特性 | Batch Normalization | Group Normalization | Layer Normalization | Instance Normalization |

|---|---|---|---|---|

| 计算维度 | 批次内的所有通道 | 单样本分组内通道 | 单样本所有通道 | 单样本每通道 |

| 依赖批量大小 | 是 | 否 | 否 | 否 |

| 应用场景 | 大批量训练 | 小批量或单样本训练 | NLP 等序列任务 | 风格迁移等图像任务 |

1. Batch Normalization (BN)

核心思想:

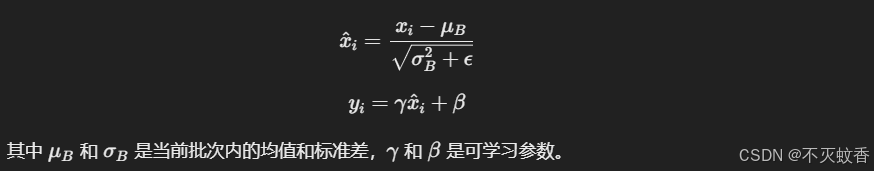

- 在每个批次内,对每一层的激活值按通道计算均值和标准差,将其归一化到零均值和单位方差,并通过可学习的参数恢复模型表达能力。

公式:

优点:

- 提高收敛速度,减少训练难度。

- 具有一定的正则化效果,缓解过拟合。

缺点:

- 对小批量训练效果较差,因为批内统计量不稳定。

- 对时间序列或变长输入不友好。

适用场景:

- 大批量训练任务(如图像分类、目标检测)。

2. Layer Normalization (LN)

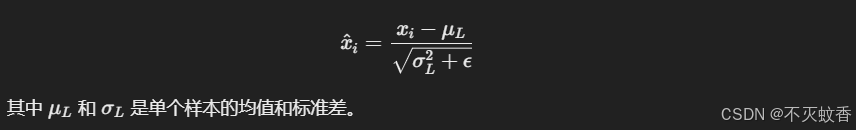

核心思想:

- 对每一个样本的所有通道(整个特征图)进行归一化。

公式:

优点:

- 不依赖批量大小,小批量训练和序列任务中表现良好。

- 适用于变长输入。

缺点:

- 在图像任务中不如 BN 效果好。

适用场景:

- 自然语言处理(如 Transformer)。

- 小批量或单样本任务。

3. Instance Normalization (IN)

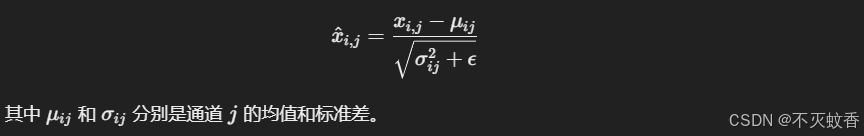

核心思想:

- 对每个样本的每个通道独立进行归一化,仅计算空间维度的均值和标准差。

公式:

优点:

- 消除样本间的风格差异。

- 在图像风格迁移中表现优异。

缺点:

- 对模型的分布学习能力有一定限制。

适用场景:

- 图像风格迁移等需要处理单张图像的任务。

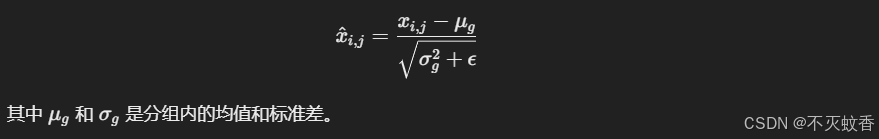

4. Group Normalization (GN)

核心思想:

- 将通道分为多个组,每组内部计算均值和标准差进行归一化。

公式:

优点:

- 不依赖批量大小,适合小批量或单样本训练。

- 在小数据集任务中表现良好。

缺点:

- 对大批量训练效率稍逊于 BN。

适用场景:

- 小批量训练任务(如目标检测、医疗图像)。

5. Weight Normalization (WN)

核心思想:

- 对每一层的权重进行归一化,分离权重的方向和尺度,以提升优化效率。

公式:

优点:

- 不引入额外的运行时计算。

- 可加速收敛。

缺点:

- 无法处理激活值的归一化。

适用场景:

- 提升优化效率的任务。

6. Layer-wise Adaptive Normalization (AdaLN)

核心思想:

- 自适应调整归一化过程,结合 IN 和 LN 的优点。

优点:

- 同时适应样本内和样本间的统计特性。

- 在生成式任务中效果良好。

缺点:

- 计算复杂度较高。

适用场景:

- GANs 和生成式模型。

归一化方法对比

| 方法 | 计算维度 | 依赖批量大小 | 优点 | 缺点 | 应用场景 |

|---|---|---|---|---|---|

| BN | 批内的每个通道 | 是 | 加速收敛,正则化 | 小批量性能下降 | 大批量图像任务 |

| LN | 样本内所有通道 | 否 | 小批量效果良好 | 图像任务效果略差 | NLP、序列任务 |

| IN | 样本内每个通道 | 否 | 风格迁移效果好 | 分布学习能力有限 | 图像风格迁移 |

| GN | 样本内分组的通道 | 否 | 适合小批量,小数据集 | 复杂度高于 BN | 小批量检测和分类任务 |

| WN | 权重 | 否 | 提升优化效率 | 不对激活值归一化 | 提高收敛速度的优化任务 |

| AdaLN | 样本内和样本间 | 否 | 自适应效果强 | 计算复杂 | 生成式任务 |

归一化方法的选择应根据任务需求、批量大小和计算资源等因素综合考虑。在大批量训练任务中,BN 仍然是主流方法;而在小批量或特殊任务中,如 NLP 和生成式模型,则可以选择更适合的归一化方法(如 GN 或 LN)。