我的第一篇文章和大家讲了怎么部署本地大模型和知识库,今天说一样怎么使用Python调用DeepSeek本地模型的API,大家可以试试别的语言,具体调用方法分享给大家。

1 部署本地大模型

参考链接:Ollama搭建DeepSeek本地大模型 + 聊天工具(ChatBox)+ 私有知识库(Cherry Studio)_chatbox deepseek 知识库-CSDN博客

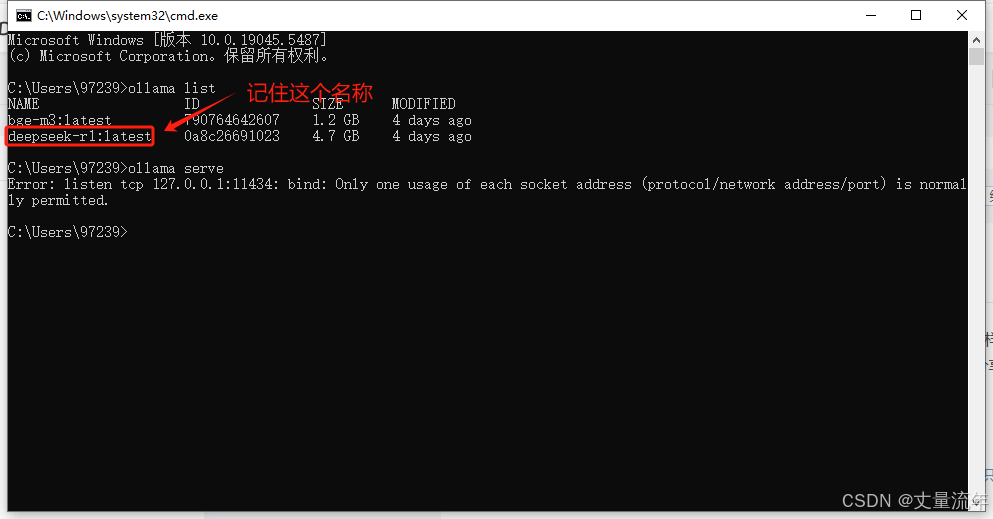

2 查看使用的模型和服务状态

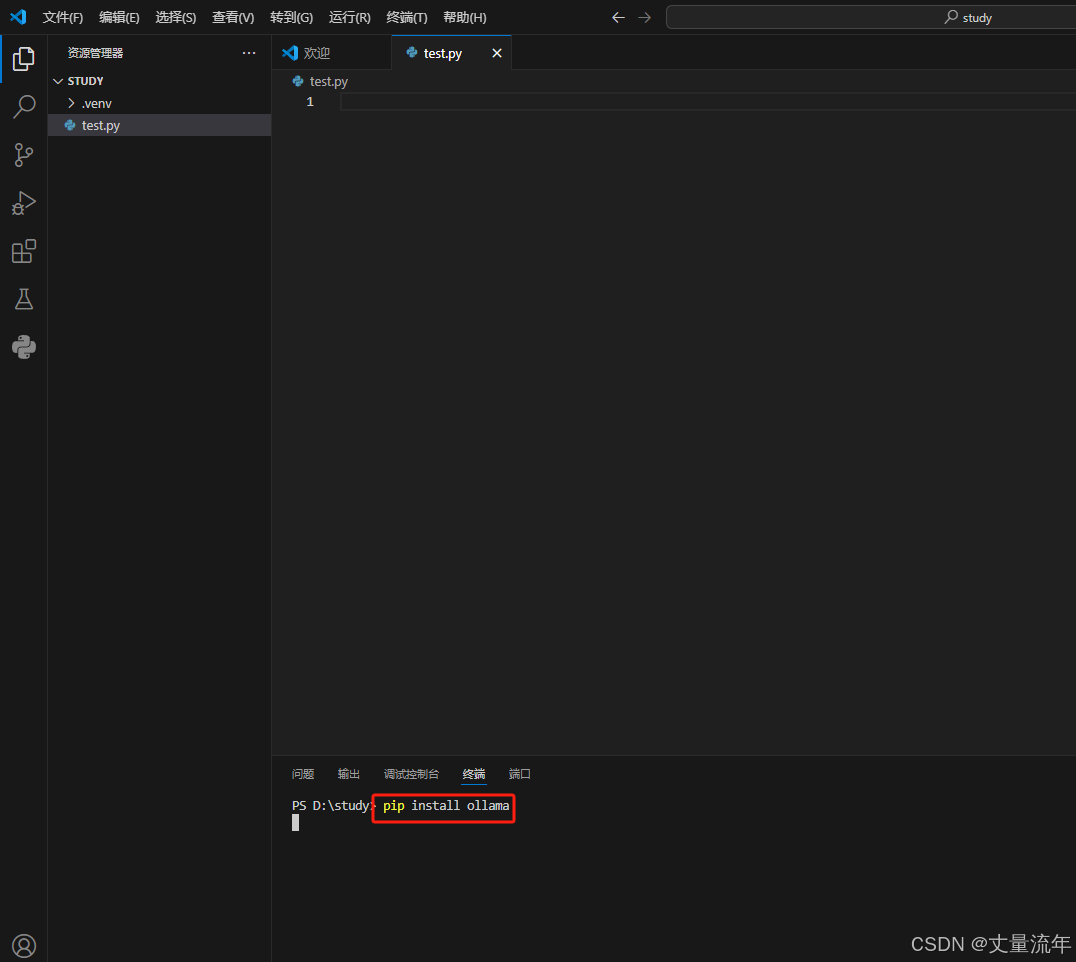

3 在Vs Code中安装ollama插件

插件下载地址:ollama · PyPI

4 调用本地api,官网有示例

from ollama import chat

from ollama import ChatResponse

def get_answer(content):

response: ChatResponse = chat(model='deepseek-r1:latest', messages=[

{

'role': 'user',

'content': content

},

])

# print(response['message']['content'])

# or access fields directly from the response object

return response.message.content

if __name__ == "__main__":

data = get_answer('你好?')

print(data)