许多朋友对如何搭建自己的微信机器人非常感兴趣。今天就来教大家如何操作。

一、 准备工作

- 一台电脑或者云服务器,对配置要求不高,一般的电脑就行

- 大模型API调用的Key,比如GPT-4o,Kimi,Deepseek(不知道怎么申请的给我留言)

- 准备一个微信号,自己的主号或是小号(建议小号)

准备工作完成,就可以开干了。

1.方案对比

有2种部署的方式供你选择:

点击图片可查看完整电子表格

下面分别介绍这两种方式的具体过程

2.程序部署

2.1 docker 部署

使用docker部署无需下载源码和安装依赖,只需要拉取镜像并根据 docker-compose.yml 配置文件启动容器即可。

前提是安装好 docker 及 docker-compose,安装成功的表现是执行 docker -v 和 docker compose version (或 docker-compose version) 可以查看到版本号,可前往 docker官网 进行下载。

(1) 配置 docker-compose.yml

执行以下命令下载 docker-compose.yml:

| Bash |

接着打开文件,修改或添加所需的配置,如 OPEN_AI_API_KEY 和 GROUP_NAME_WHITE_LIST 等必填配置。

version: '3'

services:

chatgpt-on-wechat:

image: zhayujie/chatgpt-on-wechat:latest

environment:

- OPEN_AI_API_KEY=XXXXXXXXX 替换为您的 OpenAI API Key

- MODEL=gpt-4o

- GROUP_NAME_WHITE_LIST=ALL_GROUP

ports:

- "8080:80"

(2) 启动容器

在 docker-compose.yml 所在目录下执行以下命令启动容器:

| Bash |

运行 sudo docker ps 能查看到 NAMES 为 chatgpt-on-wechat 的容器即表示运行成功。

提示

- 如果 docker-compose 是 1.X 版本 则需要执行 sudo docker-compose up -d 来启动容器

- 该命令会自动去 docker hub 拉取 latest 版本的镜像,latest 镜像会在每次项目 release 新的版本时生成

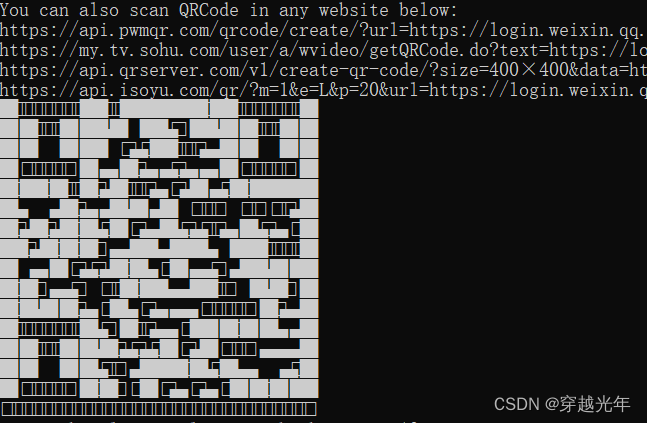

最后运行以下命令可查看容器运行日志,扫描日志中的二维码即可完成登录:

| Bash |

2.2 源码运行

本地开发环境支持 MacOS、Windows、Linux 系统,需要安装 python 环境,推荐的版本在 3.7.1 ~ 3.9.X 之间,可前往 官网 下载。

在命令行执行 python3 -V,如果能显示正确的版本则表示安装成功。需要注意的是,python3 只是一个指向python解释器的引用,有可能在你的系统里这个别名是 "python" 或者 "python3.8",那么在后面你就需要用 "python" 或 "python3.8" 来代替 python3 运行程序。同样的,执行 pip3 -V 来确认已经成功安装包管理软件 pip。

(1) 下载源码

在命令行使用 git 克隆项目并进入目录:

| Bash |

(2) 安装依赖

pip3 install -r requirements.txt 必选依赖

pip3 install -r requirements-optional.txt 可选依赖,语音、tool插件等功能需要

(3) 配置

复制项目中的模板文件 config-template.json,来生成最终起效果的配置文件config.json,你可以通过执行以下命令完成:

| Bash |

然后打开 config.json 文件,添加所需配置,具体配置含义参考:

config.json文件内容示例

{

"open_ai_api_key": "YOUR API KEY", 填入上面创建的 OpenAI API KEY

"model": "gpt-4o", 模型名称

"proxy": "", 代理客户端的ip和端口

"single_chat_prefix": ["bot", "@bot"], 私聊时触发机器人回复的前缀

"single_chat_reply_prefix": "[bot] ", 私聊时自动回复的前缀

"group_chat_prefix": ["@bot"], 群聊时触发机器人回复的前缀

"group_name_white_list": ["ChatGPT测试群", "ChatGPT测试群2"],开启自动回复的群名称列表

"group_chat_in_one_session": ["ChatGPT测试群"], 支持会话上下文共享的群名称

"image_create_prefix": ["画", "看", "找"], 开启图片回复的前缀

"conversation_max_tokens": 1000, 支持上下文记忆的最多字符数

"speech_recognition": false, 是否开启语音识别

"group_speech_recognition": false, 是否开启群组语音识别}(4) 运行

一切准备就绪,可以启动程序了,直接在项目目录下执行:

| Bash |

扫描输出的二维码即可完成登录。

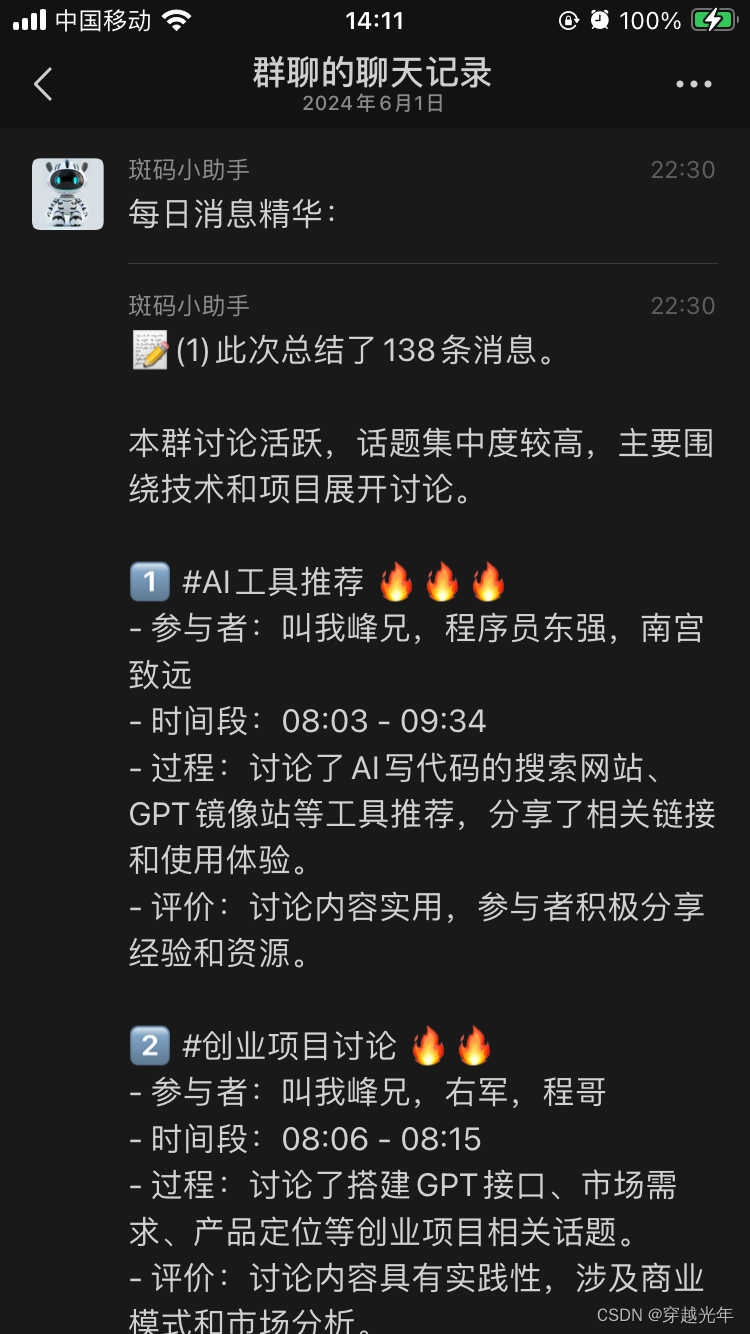

完成以上步骤,你的微信就已经接入大模型了,已经具备了AI智能问答功能,你可以直接基于你设定的触发词来向他提问,比如我定义的触发词是“斑码小助手”:

基于这个方案进行扩展,微信可以化身为社群运营助手,面向社群提供更多高阶服务,比如:

- 入群自动欢迎

- 关键词自动回复

- 基于社群知识库的社群知识智能问答

- 多维度群消息总结

- 群消息回顾

- 定时任务

- 多群消息转发

- 群邀请关系溯源

- 群早晚安及日报

想要了解如何将机器人对接Coze bot的朋友,请参考我另一篇文章:AI Agent学习系列:微信 + Agent = 微信特工?-CSDN博客

对于不熟悉或者没有资源搭建运行环境的朋友也没关系,可以给我留言,我拉你进我们的社群机器人体验群。

———————————————————————————————————————

关注微信公众号【数字众生】即刻获取干货满满的 “AI学习大礼包”