如何去求一副图像里面各个目标块的质心?对于不需要图像去噪,并且目标形态比较单一的目标而言,一般遵从如下的传统技术路线:

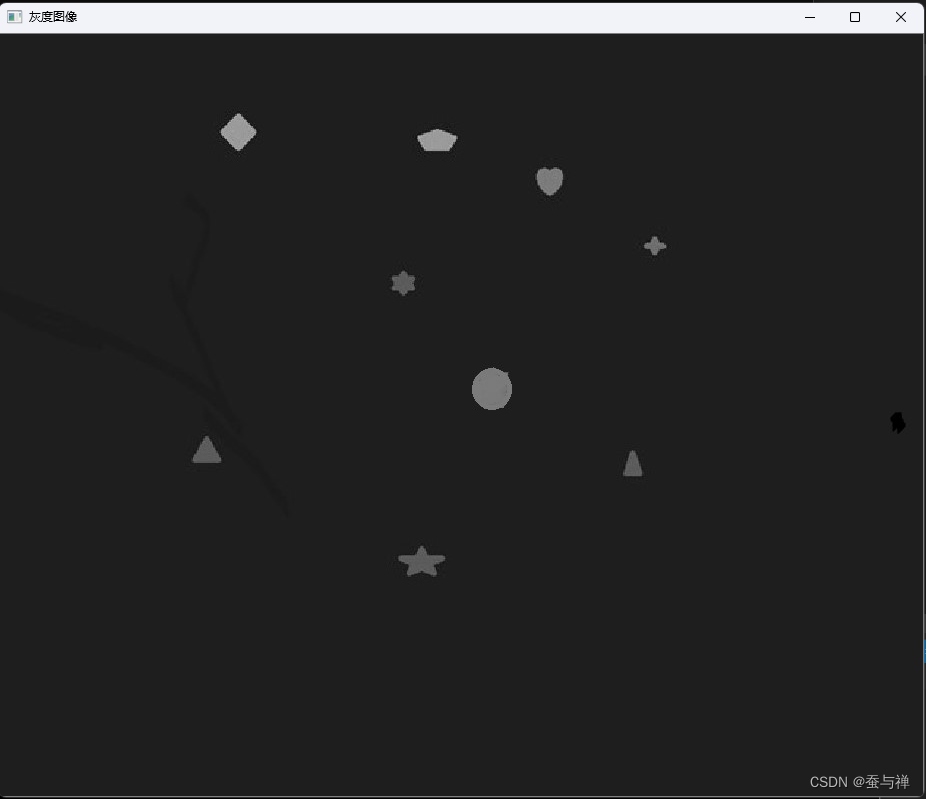

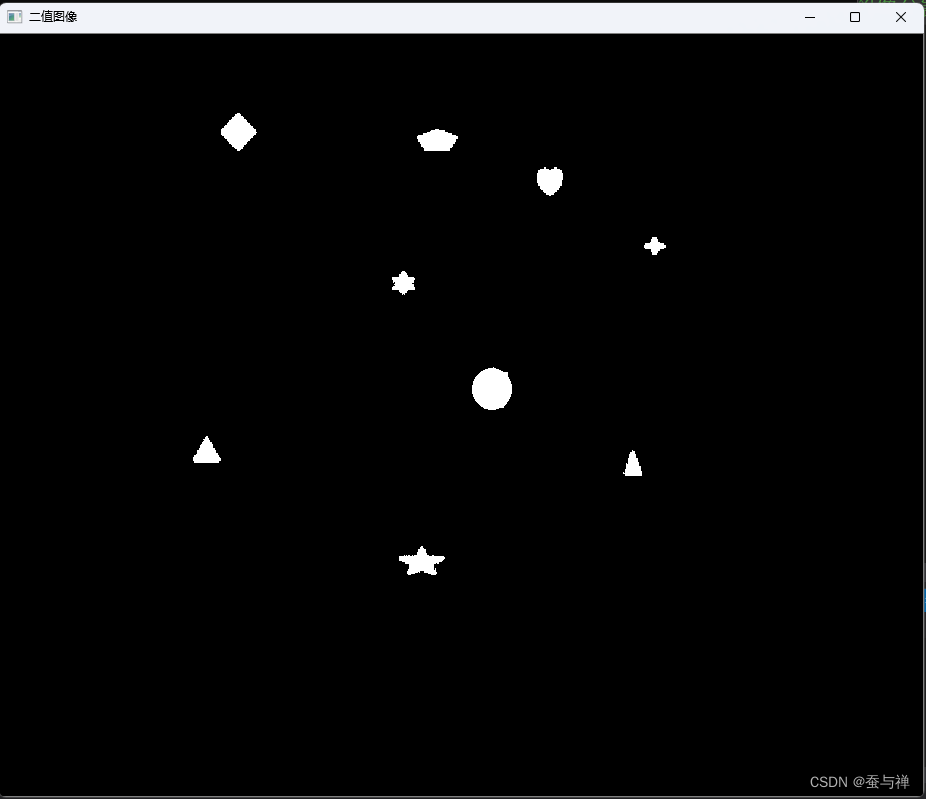

在OpenCV里灰度化可以调用cvtColor函数,也可以直接用imread把彩色图像读成灰度图像。灰度图像通过图像分割即可转变为二值图像,关键点是阈值的计算。不同目标获取阈值的方法差异较大,对于形态单一目标,可以采用传统的大津法(最大类间方差法)自动计算分割阈值。接下来就是连通域分析,matlab里用的是bwlabel函数,而OpenCV里用的是connectedComponentsWithStats函数。最后求连通域各像素的均值,即可得到目标的质心坐标。

下面给出基于C++的OpenCV代码,同时给出该算法的matlab代码,对比效果,就可以互相验证算法的准确性。

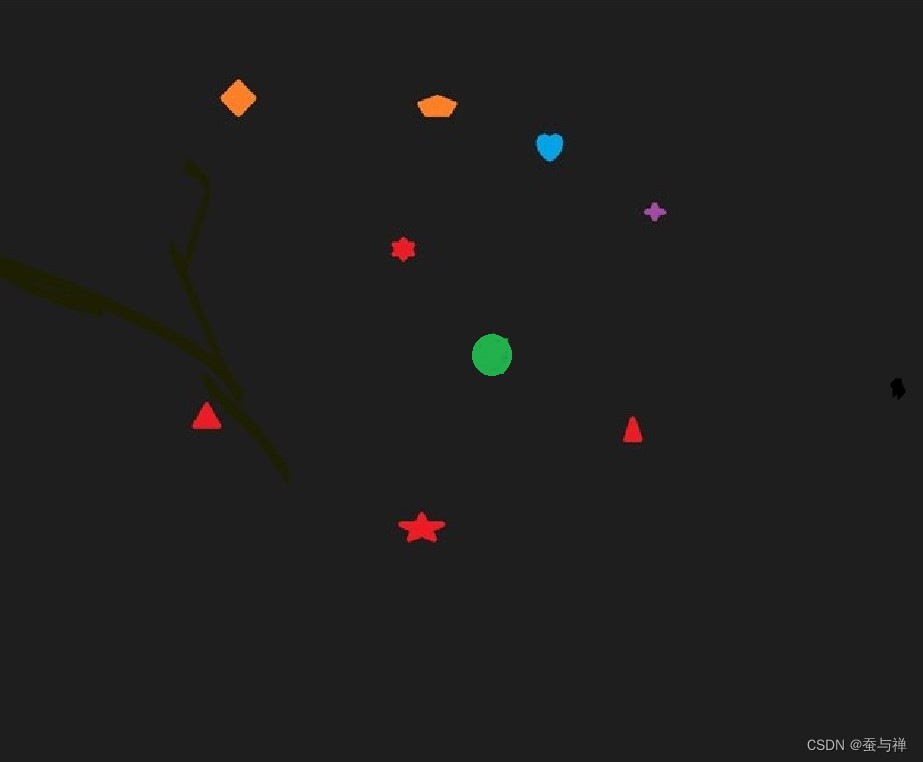

测试图像:

OpenCV代码:

#include <opencv2/core/core.hpp>

#include <opencv2/imgproc.hpp>

#include <opencv2/highgui/highgui.hpp>

#include <iostream>

#include <vector>

using namespace cv;

using namespace std;

int main()

{

Mat grayImg = imread("test.jpg", IMREAD_GRAYSCALE); //直接以灰度格式读取

imshow("灰度图像", grayImg);

Mat bw;

double thres_val = threshold(grayImg, bw, 0, 255, THRESH_BINARY | THRESH_OTSU); //返回图像分割的自动阈值

imshow("二值图像", bw);

Mat out_bw, stats, centroids;

int number = connectedComponentsWithStats(

bw, //二值图像

out_bw, //和原图一样大的标记图

stats, //nccomps×5的矩阵 表示每个连通区域的外接矩形和面积(pixel)

centroids //nccomps×2的矩阵 表示每个连通区域的质心

);

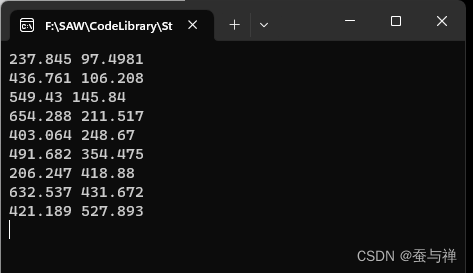

vector<Point2f> points; //用于储存每个连通区域的质心位置

for (int i = 1; i < number; ++i) //这里i一定要从1计数,为了跳过第一个无用的中心点

{

double tx = centroids.at<double>(i, 0);

double ty = centroids.at<double>(i, 1);

points.push_back(Point2f(tx, ty));

cout << tx << " " << ty << endl;

}

waitKey(0);

return(0);

}Matlab代码:

clc

clear all

close all

Ip = imread('test.jpg');

figure

imshow(Ip);

title('原始图像');

gI = im2gray(Ip);

figure

imshow(gI);

title('灰度图像');

th=graythresh(gI);

I_thresh2=im2bw(gI,th);

[L N]=bwlabel(I_thresh2,8);

for cc=1:N

[r ck]=find(L==cc);

y(cc)=mean(r);

x(cc)=mean(ck);

x=round(x);

y=round(y);

xy(1,cc)=x(cc);

xy(2,cc)=y(cc);

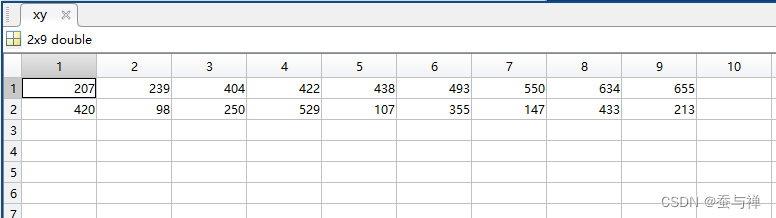

end%%%%%%%%%%%imge processing结果对比:

下面分别是用opencv和matlab计算的质心结果: