软件和操作系统版本:

- Hadoop框架是采用Java语言编写,需要java环境(jvm)

- JDK版本:JDK8版本

Hadoop搭建方式

- 单机模式:单节点模式,非集群,生产不会使用这种方式

- 单机伪分布式模式:单节点,多线程模拟集群的效果,生产不会使用这种方式

- 完全分布式模式:多台节点,真正的分布式Hadoop集群的搭建(生产环境建议使用这种方式)

本次介绍如何使用三台虚拟机,进行hadoop集群的搭建

1、虚拟机环境准备

(1)三台虚拟机(静态IP,关闭防火墙,修改主机名,配置免密登录,集群时间同步)

具体操作详见:

(2)在/opt目录下创建文件夹

mkdir -p /opt/lagou/software --软件安装包存放目录

mkdir -p /opt/lagou/servers --软件安装目录

(3)Hadoop下载地址:

Hadoop官网地址:

(4)上传hadoop安装文件到/opt/lagou/software

2、集群规划

| 框架 | linux121 | linux122 | linux123 |

| HDFS | NameNode、DataNode | DataNode | SecondaryNameNode、DataNode |

| YARN | NodeManager | NodeManager | NodeManager、ResourceManager |

linux121、linux122、linux123这些是主机名,尽量和我保持一致。

3、安装Hadoop

登录linux121节点;进入/opt/lagou/software,解压安装文件到/opt/lagou/servers

tar -zxvf hadoop-2.9.2.tar.gz -C /opt/lagou/servers

查看是否解压成功

ll /opt/lagou/servers/hadoop-2.9.2

添加Hadoop到环境变量 vim /etc/profile

##HADOOP_HOME

export HADOOP_HOME=/opt/lagou/servers/hadoop-2.9.2

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

使环境变量生效

source /etc/profile

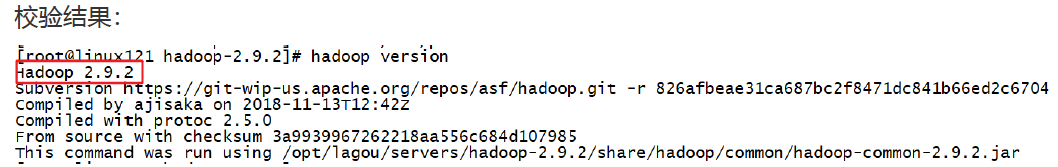

验证hadoop

hadoop目录

drwxr-xr-x. 2 root root 194 Nov 13 2018 bin

drwxr-xr-x. 3 root root 20 Nov 13 2018 etc

drwxr-xr-x. 2 root root 106 Nov 13 2018 includedrwxr-xr-x. 3 root root 20 Nov 13 2018 lib

drwxr-xr-x. 2 root root 239 Nov 13 2018 libexec

-rw-r--r--. 1 root root 106210 Nov 13 2018 LICENSE.txt

-rw-r--r--. 1 root root 15917 Nov 13 2018 NOTICE.txt

-rw-r--r--. 1 root root 1366 Nov 13 2018 README.txt

drwxr-xr-x. 3 root root 4096 Nov 13 2018 sbin

drwxr-xr-x. 4 root root 31 Nov 13 2018 share

- bin目录:对Hadoop进行操作的相关命令,如hadoop,hdfs等

- etc目录:Hadoop的配置文件目录,入hdfs-site.xml,core-site.xml等

- lib目录:Hadoop本地库(解压缩的依赖)

- sbin目录:存放的是Hadoop集群启动停止相关脚本,命令

- share目录:Hadoop的一些jar,官方案例jar,文档等

3.1、集群配置

Hadoop集群配置 = HDFS集群配置 + MapReduce集群配置 + Yarn集群配置

HDFS集群配置

- 将JDK路径明确配置给HDFS(修改hadoop-env.sh)

- 指定NameNode节点以及数据存储目录(修改core-site.xml)

- 指定SecondaryNameNode节点(修改hdfs-site.xml)

- 指定DataNode从节点(修改etc/hadoop/slaves文件,每个节点配置信息占一行)

MapReduce集群配置

- 将JDK路径明确配置给MapReduce(修改mapred-env.sh)

- 指定MapReduce计算框架运行Yarn资源调度框架(修改mapred-site.xml)

Yarn集群配置

- 将JDK路径明确配置给Yarn(修改yarn-env.sh)

- 指定ResourceManager老大节点所在计算机节点(修改yarn-site.xml)

- 指定NodeManager节点(会通过slaves文件内容确定)

集群配置具体步骤:

(1)HDFS集群配置

cd /opt/lagou/servers/hadoop-2.9.2/etc/hadoop

配置:hadoop-env.sh(将JDK路径明确配置给HDFS,结合自己jdk的安装路径)

vim hadoop-env.sh

添加下面内容

export JAVA_HOME=/opt/lagou/servers/jdk1.8.0_231

指定NameNode节点以及数据存储目录(修改core-site.xml)

vim core-site.xml

<!-- 指定HDFS中NameNode的地址 --> <property> <name>fs.defaultFS</name> <value>hdfs://linux121:9000</value> </property> <!-- 指定Hadoop运行时产生文件的存储目录 --> <property> <name>hadoop.tmp.dir</name> <value>/opt/lagou/servers/hadoop-2.9.2/data/tmp</value> </property>注意:在configuration标签中添加上述内容,后面不在赘述

core-site.xml的默认配置:

https://hadoop.apache.org/docs/r2.9.2/hadoop-project-dist/hadoop-common/coredefault.xml

指定secondarynamenode节点(修改hdfs-site.xml)

vim hdfs-site.xml

<!-- 指定Hadoop辅助名称节点主机配置 --> <property> <name>dfs.namenode.secondary.http-address</name> <value>linux123:50090</value> </property> <!--副本数量 --> <property> <name>dfs.replication</name> <value>3</value> </property>

官方默认配置

https://hadoop.apache.org/docs/r2.9.2/hadoop-project-dist/hadoop-hdfs/hdfsdefault.xml

指定datanode从节点(修改slaves文件,每个节点配置信息占一行)

vim slaves

linux121

linux122

linux123

注意:该文件中添加的内容结尾不允许有空格,文件中不允许有空行。

(2)MapReduce集群配置

指定MapReduce使用的jdk路径(修改mapred-env.sh)

vim mapred-env.sh

export JAVA_HOME=/opt/lagou/servers/jdk1.8.0_231

指定MapReduce计算框架运行Yarn资源调度框架(修改mapred-site.xml)

mv mapred-site.xml.template mapred-site.xml

vim mapred-site.xml<!-- 指定MR运行在Yarn上 --> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property>

mapred-site.xml默认配置

https://hadoop.apache.org/docs/r2.9.2/hadoop-mapreduce-client/hadoop-mapreduceclient-core/mapred-default.xml

(3)Yarn集群配置

指定JDK路径

vim yarn-env.sh

export JAVA_HOME=/opt/lagou/servers/jdk1.8.0_231

指定ResourceMnager的master节点信息(修改yarn-site.xml)

vim yarn-site.xml

<!-- 指定YARN的ResourceManager的地址 --> <property> <name>yarn.resourcemanager.hostname</name> <value>linux123</value> </property> <!-- Reducer获取数据的方式 --> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property>

yarn-site.xml的默认配置

https://hadoop.apache.org/docs/r2.9.2/hadoop-yarn/hadoop-yarn-common/yarndefault.xml

指定NodeManager节点(slaves文件已修改)

注意:

Hadoop安装目录所属用户和所属用户组信息,默认是501 dialout,而我们操作Hadoop集群的用户使用的是虚拟机的root用户,所以为了避免出现信息混乱,修改Hadoop安装目录所属用户和用户组!!

chown -R root:root /opt/lagou/servers/hadoop-2.9.2

3.2、分发配置

编写集群分发脚本rsync-script

rsync 远程同步工具

- rsync主要用于备份和镜像。具有速度快、避免复制相同内容和支持符号链接的优点。

- rsync和scp区别:用rsync做文件的复制要比scp的速度快,rsync只对差异文件做更新。scp是把所有文件都复制过去。

基本语法

rsync -rvl $pdir/$fname $user@$host:$pdir/$fname

命令 选项参数 要拷贝的文件路径/名称 目的用户@主机:目的路径/名称

选项参数说明

| 选项 | 功能 |

| -r | 递归 |

| -v | 显示复制过程 |

| -l | 拷贝符号连接 |

rsync案例

- 三台虚拟机安装rsync (执行安装需要保证机器联网)

yum install -y rsync

- 把linux121机器上的/opt/lagou/software目录同步到linux122服务器的root用户下的/opt/目录

rsync -rvl /opt/lagou/software/

这个时候我们进入发现linux122,已经拥有了linux121的这个文件,说明拷贝完成

集群分发脚本编写

- 需求:循环复制文件到集群所有节点的相同目录下

- rsync命令原始拷贝:rsync -rvl /opt/module root@linux123:/opt/

- 期望脚本:脚本+要同步的文件名称

说明:

在/usr/local/bin这个目录下存放的脚本,root用户可以在系统任何地方直接执行。

脚本实现

(1)在/usr/local/bin目录下创建文件rsync-script,文件内容如下:

[root@linux121 bin]$ touch rsync-script

[root@linux121 bin]$ vim rsync-script

(2)在文件中编写shell代码

#!/bin/bash

#1 获取命令输入参数的个数,如果个数为0,直接退出命令

paramnum=$#

if((paramnum==0)); then

echo no params;

exit;

fi

#2 根据传入参数获取文件名称

p1=$1

file_name=`basename $p1`

echo fname=$file_name

#3 获取输入参数的绝对路径

pdir=`cd -P $(dirname $p1); pwd`

echo pdir=$pdir

#4 获取用户名称

user=`whoami`

#5 循环执行rsync

for((host=121; host<124; host++)); do

echo ------------------- linux$host --------------

rsync -rvl $pdir/$file_name $user@linux$host:$pdir

done(3)修改脚本 rsync-script 具有执行权限

[root@linux121 bin]$ chmod 777 rsync-script

(4)调用脚本形式:rsync-script 文件名称

[root@linux121 bin]$ rsync-script /home/root/bin

(5)调用脚本分发Hadoop安装目录到其它节点

[root@linux121 bin]$ rsync-script /opt/lagou/servers/hadoop-2.9.2

4、启动集群

注意:如果集群是第一次启动,需要在Namenode所在节点格式化NameNode,非第一次不用执行格式化Namenode操作!!

4.1、单节点启动

[root@linux121 hadoop-2.9.2]$ hadoop namenode -format

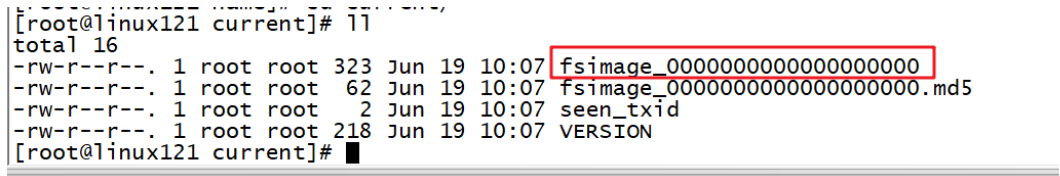

格式化命令执行效果:

格式化后创建的文件:/opt/lagou/servers/hadoop-2.9.2/data/tmp/dfs/name/current

在linux121上启动NameNode

[root@linux121 hadoop-2.9.2]$ hadoop-daemon.sh start namenode

[root@linux121 hadoop-2.9.2]$ jps

注意:主机名不能带有'_',否则会启动失败。

在linux121、linux122以及linux123上分别启动DataNode

[root@linux121 hadoop-2.9.2]$ hadoop-daemon.sh start datanode

[root@linux121 hadoop-2.9.2]$ jps

3461 NameNode

3608 Jps

3561 DataNode

[root@linux122 hadoop-2.9.2]$ hadoop-daemon.sh start datanode

[root@linux122 hadoop-2.9.2]$ jps

3190 DataNode

3279 Jps

[root@linux123 hadoop-2.9.2]$ hadoop-daemon.sh start datanode

[root@linux123 hadoop-2.9.2]$ jps

3237 Jps

3163 DataNode

jps命令是用来查看Java进程的

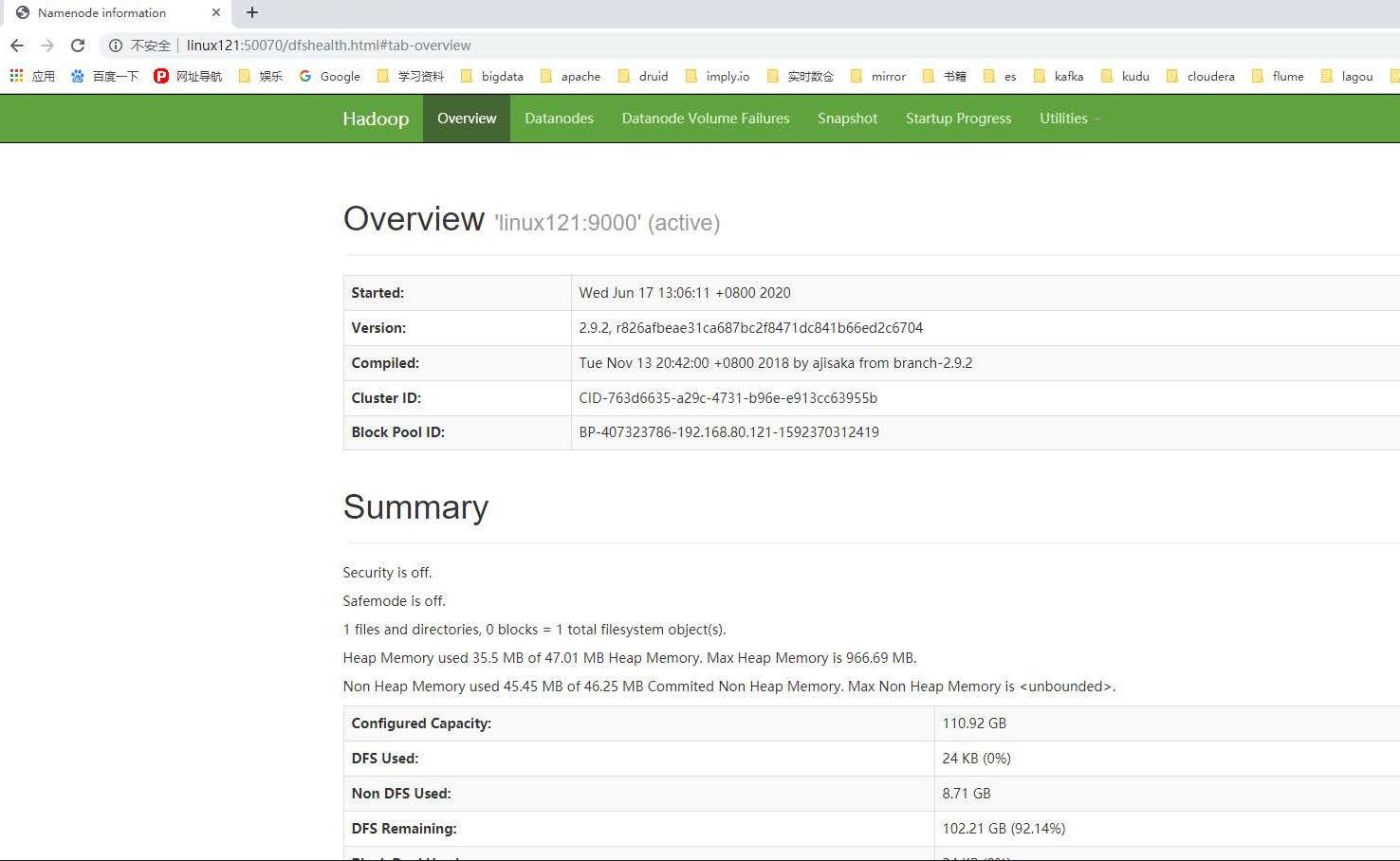

web端查看Hdfs界面

如果使用主机名访问失败,则可以修改本地电脑的hosts文件

C:\Windows\System32\drivers\etc

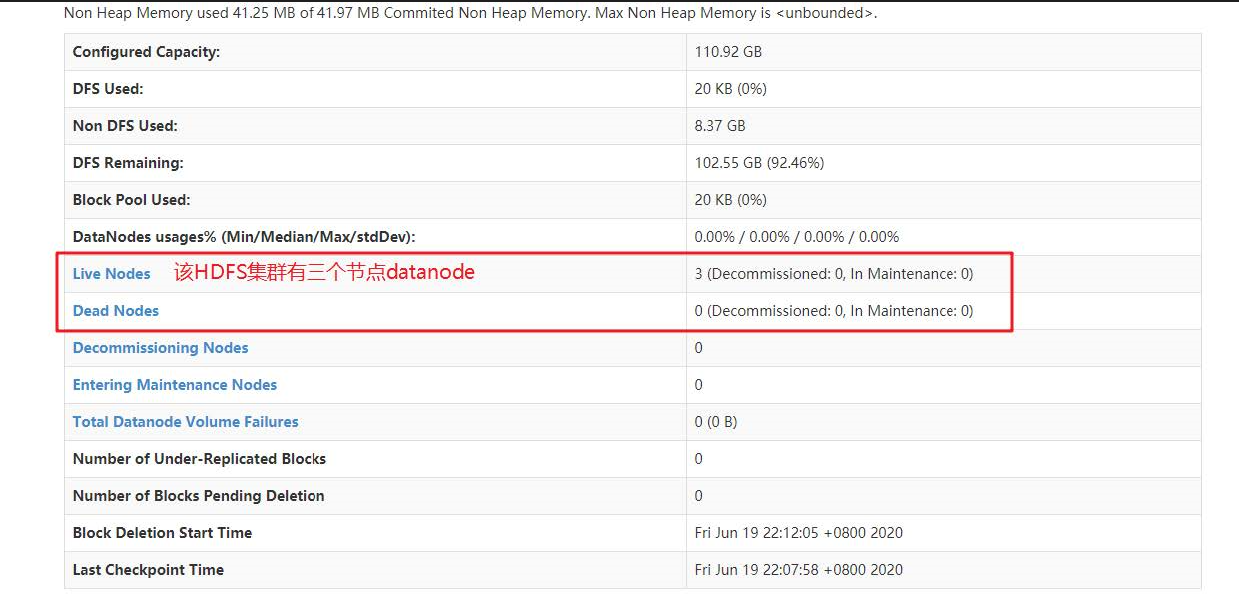

查看HDFS集群正常节点:

Yarn集群单节点启动

[root@linux123 servers]# yarn-daemon.sh start resourcemanager

[root@linux123 servers]# jps

7881 ResourceManager

8094 Jps

[root@linux122 servers]# yarn-daemon.sh start nodemanager

[root@linux122 servers]# jps

8166 NodeManager

8223 Jps

[root@linux121 servers]# yarn-daemon.sh start nodemanager

[root@linux121 servers]# jps

8166 NodeManager

8223 Jps

思考:Hadoop集群每次需要一个一个节点的启动,如果节点数增加到成千上万个怎么办?

4.2、集群群起

(1)如果已经单节点方式启动了Hadoop,可以先停止之前的启动的Namenode与Datanode进程,如果之前Namenode没有执行格式化,这里需要执行格式化!!!!

hadoop namenode -format

只能执行一次,否则造成版本号不一致,引发一系列问题

(2)启动HDFS

[root@linux121 hadoop-2.9.2]$ sbin/start-dfs.sh

[root@linux121 hadoop-2.9.2]$ jps

4166 NameNode

4482 Jps

4263 DataNode

[root@linux122 hadoop-2.9.2]$ jps

3218 DataNode

3288 Jps

[root@linux123 hadoop-2.9.2]$ jps

3221 DataNode

3283 SecondaryNameNode

3364 Jps

(3)启动YARN

[root@linux123 hadoop-2.9.2]$ sbin/start-yarn.sh

注意:NameNode和ResourceManger不是在同一台机器,不能在NameNode上启动 YARN,应该在ResouceManager所在的机器上启动YARN。

4.3、Hadoop集群启动停止命令汇总

各个服务组件逐一启动/停止

(1)分别启动/停止HDFS组件

hadoop-daemon.sh start / stop namenode / datanode / secondarynamenode

(2)启动/停止YARN

yarn-daemon.sh start / stop resourcemanager / nodemanager

各个模块分开启动/停止(配置ssh是前提)常用

(1)整体启动/停止HDFS

start-dfs.sh / stop-dfs.sh

(2)整体启动/停止YARN

start-yarn.sh / stop-yarn.sh

5、集群测试

5.1、HDFS 分布式存储初体验

从linux本地文件系统上传下载文件验证HDFS集群工作正常

hdfs dfs -mkdir -p /test/input

#本地hoome目录创建一个文件

cd /root

vim test.txt

hello hdfs(添加的内容)

#上传linxu文件到Hdfs

hdfs dfs -put /root/test.txt /test/input

#从Hdfs下载文件到linux本地

hdfs dfs -get /test/input/test.txt

5.2、MapReduce 分布式计算初体验

在HDFS文件系统根目录下面创建一个wcinput文件夹

[root@linux121 hadoop-2.9.2]$ hdfs dfs -mkdir /wcinput

在/root/目录下创建一个wc.txt文件(本地文件系统)

[root@linux121 hadoop-2.9.2]$ cd /root/

[root@linux121 wcinput]$ touch wc.txt

编辑wc.txt文件

[root@linux121 wcinput]$ vi wc.txt

在文件中输入如下内容

hadoop mapreduce yarn

hdfs hadoop mapreduce

mapreduce yarn lagou

lagou

lagou

保存退出

: wq!

上传wc.txt到Hdfs目录/wcinput下

hdfs dfs -put wc.txt /wcinput

- 回到Hadoop目录/opt/lagou/servers/hadoop-2.9.2

- 执行程序

[root@linux121 hadoop-2.9.2]$ hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.9.2.jar wordcount / wcinput /wcoutput (wcoutput文件夹在hdfs中不能存在,必须通过其自动生成)

查看结果

[root@linux121 hadoop-2.9.2]$ hdfs dfs -cat /wcoutput/part-r-00000

hadoop 2

hdfs 1

lagou 3

mapreduce 3

yarn 2

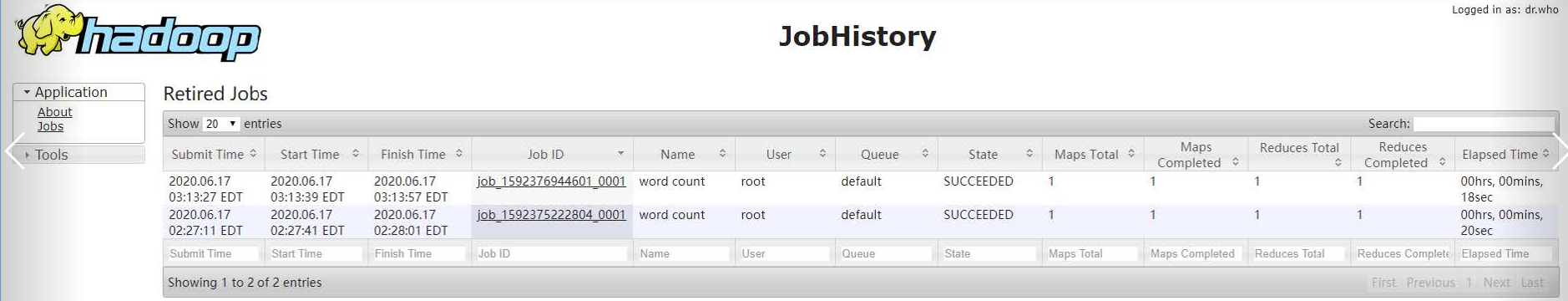

yarn界面访问地址:ip:8088

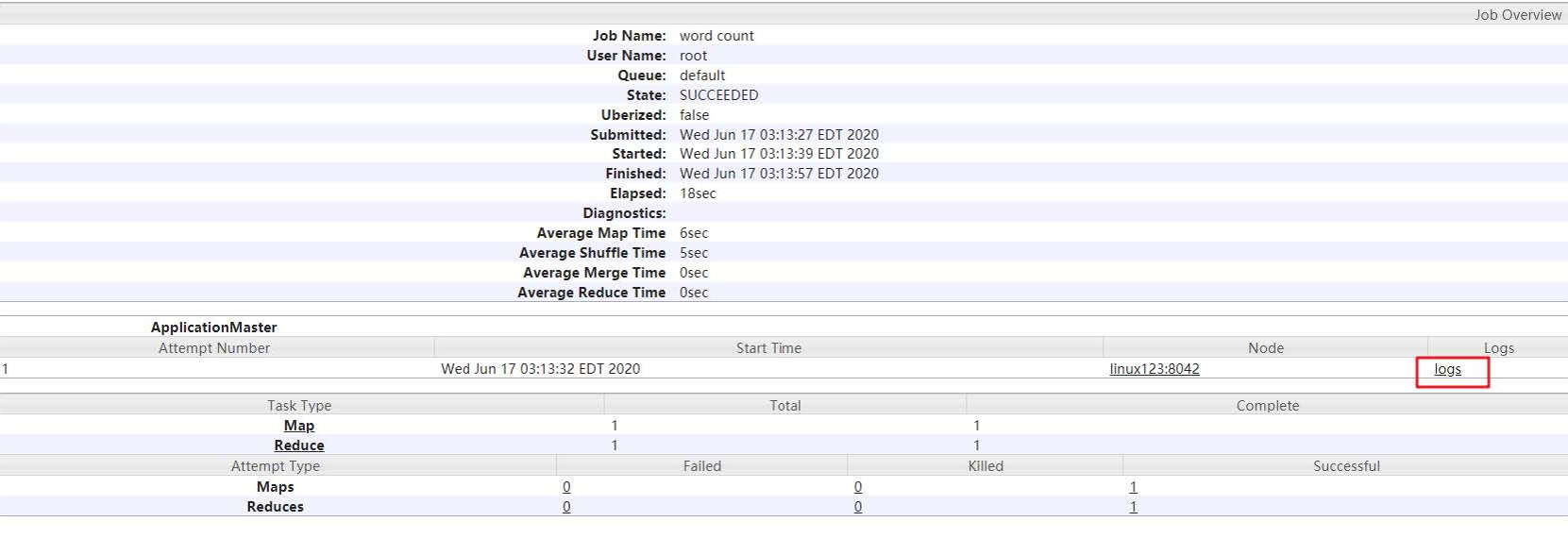

6、配置历史服务器

在Yarn中运行的任务产生的日志数据不能查看,为了查看程序的历史运行情况,需要配置一下历史日志服务器。具体配置步骤如下:cd /opt/lagou/servers/hadoop-2.9.2/etc/hadoop/

6.1、配置mapred-site.xml

[root@linux121 hadoop]$ vi mapred-site.xml

在该文件里面增加如下配置。

<!-- 历史服务器端地址 -->

<property>

<name>mapreduce.jobhistory.address</name>

<value>linux121:10020</value>

</property>

<!-- 历史服务器web端地址 -->

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>linux121:19888</value>

</property>6.2、分发mapred-site.xml到其它节点

rsync-script mapred-site.xml

6.3、启动历史服务器

[root@linux121 hadoop-2.9.2]$ sbin/mr-jobhistory-daemon.sh start historyserver

6.4、查看历史服务器是否启动

[root@linux121 hadoop-2.9.2]$ jps

6.5、查看JobHistory

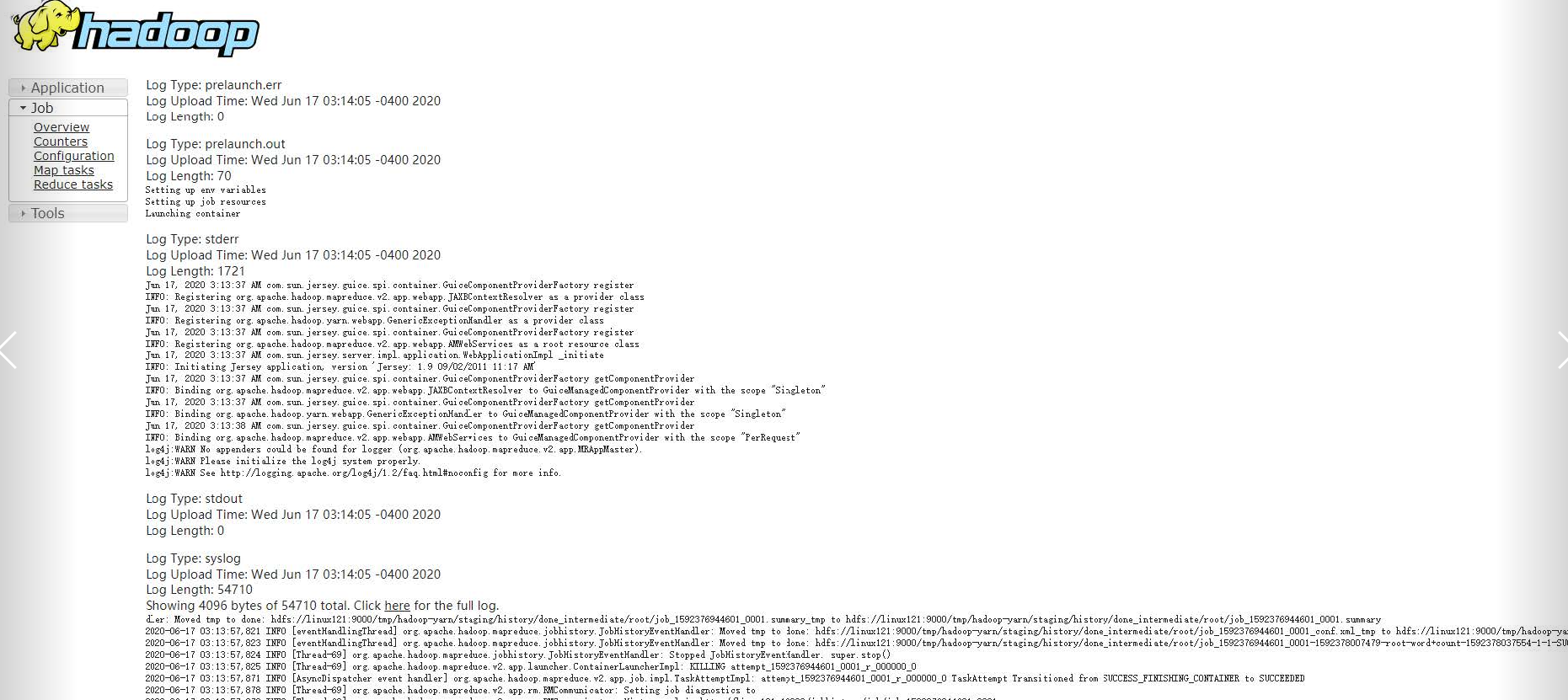

7、配置日志的聚集

- 日志聚集:应用(Job)运行完成以后,将应用运行日志信息从各个task汇总上传到HDFS系统上。

- 日志聚集功能好处:可以方便的查看到程序运行详情,方便开发调试。

注意:开启日志聚集功能,需要重新启动NodeManager 、ResourceManager和HistoryManager。

开启日志聚集功能具体步骤如下:

7.1、配置yarn-site.xml

[root@linux121 hadoop]$ vi yarn-site.xml

在该文件里面增加如下配置。

<!-- 日志聚集功能使能 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 日志保留时间设置7天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

<property>

<name>yarn.log.server.url</name>

<value>http://linux121:19888/jobhistory/logs</value>

</property>7.2、分发yarn-site.xml到集群其它节点

rsync-script yarn-site.xml

7.3、关闭NodeManager 、ResourceManager和HistoryManager

[root@linux121 hadoop-2.9.2]$ sbin/yarn-daemon.sh stop resourcemanager

[root@linux121 hadoop-2.9.2]$ sbin/yarn-daemon.sh stop nodemanager

[root@linux121 hadoop-2.9.2]$ sbin/mr-jobhistory-daemon.sh stop historyserver

7.4、启动NodeManager 、ResourceManager和HistoryManager

[root@linux121 hadoop-2.9.2]$ sbin/yarn-daemon.sh start resourcemanager

[root@linux121 hadoop-2.9.2]$ sbin/yarn-daemon.sh start nodemanager

[root@linux121 hadoop-2.9.2]$ sbin/mr-jobhistory-daemon.sh start historyserver

7.5、删除HDFS上已经存在的输出文件

[root@linux121 hadoop-2.9.2]$ bin/hdfs dfs -rm -R /wcoutput

7.6、 执行WordCount程序

[root@linux121 hadoop-2.9.2]$ hadoop jar share/hadoop/mapreduce/hadoopmapreduce-examples-2.9.2.jar wordcount /wcinput /wcoutput

7.7、查看日志,如图所示

http://linux121:19888/jobhistory