你好,我是cos大壮~

有人说svm算法很神奇,其实svm本身有些神奇的特性和优势。

包括非线性可分问题的处理能力、泛化能力强、对特征空间的依赖较小、对于小样本数据集有效、核技巧的运用

SVM(支持向量机)算法在机器学习中具有一些神奇的特性和优势,包括:

-

非线性可分问题的处理能力: SVM 算法通过使用核函数将数据映射到高维特征空间,使得原本在低维空间中不可分的数据变得可分。这种能力使得 SVM 在解决非线性分类和回归问题时非常强大。

-

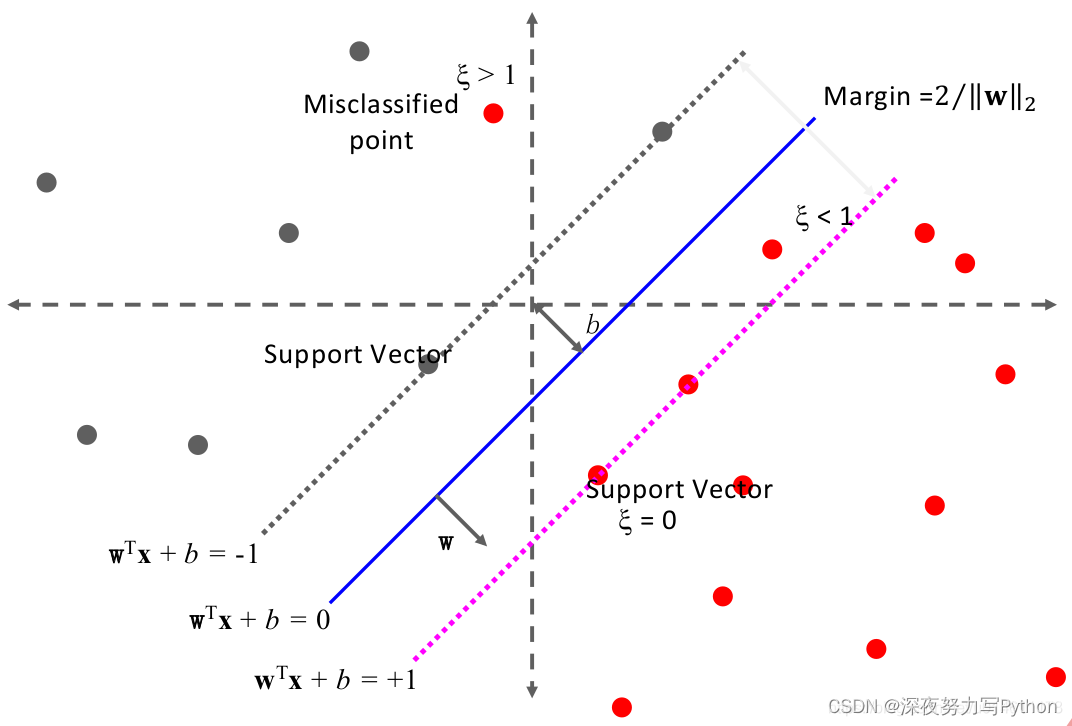

泛化能力强: SVM 的目标是找到一个最优超平面,即能够准确分类训练样本并且能够最大程度地推广到未见过的测试样本。SVM 通过最大化分类边界的距离(间隔)来实现这一点,从而提高了模型的泛化能力。

-

对特征空间的依赖较小: SVM 主要关注支持向量(位于最优超平面上的样本点),而不是整个特征空间。这使得 SVM 对于特征空间中的噪声和冗余数据相对较为鲁棒。

-

对于小样本数据集有效: SVM 在小样本数据集上表现良好,在样本数量较少的情况下仍然能够进行准确的分类。

-

核技巧的运用: SVM 使用核函数可以将数据映射到高维特征空间,从而使得原本在低维