目录

(4)合并训练数据和测试数据,进行一些数据预处理操作,然后重新切分出训练集和测试集

1.赛题任务

使用进阶的机器学习模型lightgbm预测房屋电力需求

2.baseline代码

(话不多说,我们直接上代码)

(1)第一步:导入所需模块

其中lightgbm需要先在终端导入,否则会出现报错!

import numpy as np

import pandas as pd

import lightgbm as lgb

from sklearn.metrics import mean_squared_log_error, mean_absolute_error, mean_squared_error

import tqdm

import sys

import os

import gc

import argparse

import warnings

warnings.filterwarnings('ignore')补充:(为了方便小白能更加明白各类模块的作用,下面给出了以上各模块的大致解释)

- numpy用于多维数组快速运算

- pandas用于数据分析,特别是表格数据

- lightgbm是一个基于梯度提升框架的的机器学习库

- 三个评估指标函数:mean_squared_log_error(均方对数误差)、mean_absolute_error(平均绝对误差)和 mean_squared_error(均方误差),以上指标用于评估回归模型的性能

- tqdm 是一个进度条库,可以在循环或迭代过程中显示进度条

- sys模块提供了对 Python 解释器进行访问和操作的函数和变量

- os模块提供了与操作系统交互的函数,如文件和目录操作

- gc模块提供了对垃圾回收机制的直接访问,可以手动触发垃圾回收

- argparse是一个用于解析命令行参数和选项的库

- warnings模块用于处理警告信息(以上的ignore代表忽略所有告警信息)

(2)探索性数据分析(EDA)

在数据准备阶段,主要读取训练数据和测试数据,并进行基本的数据展示

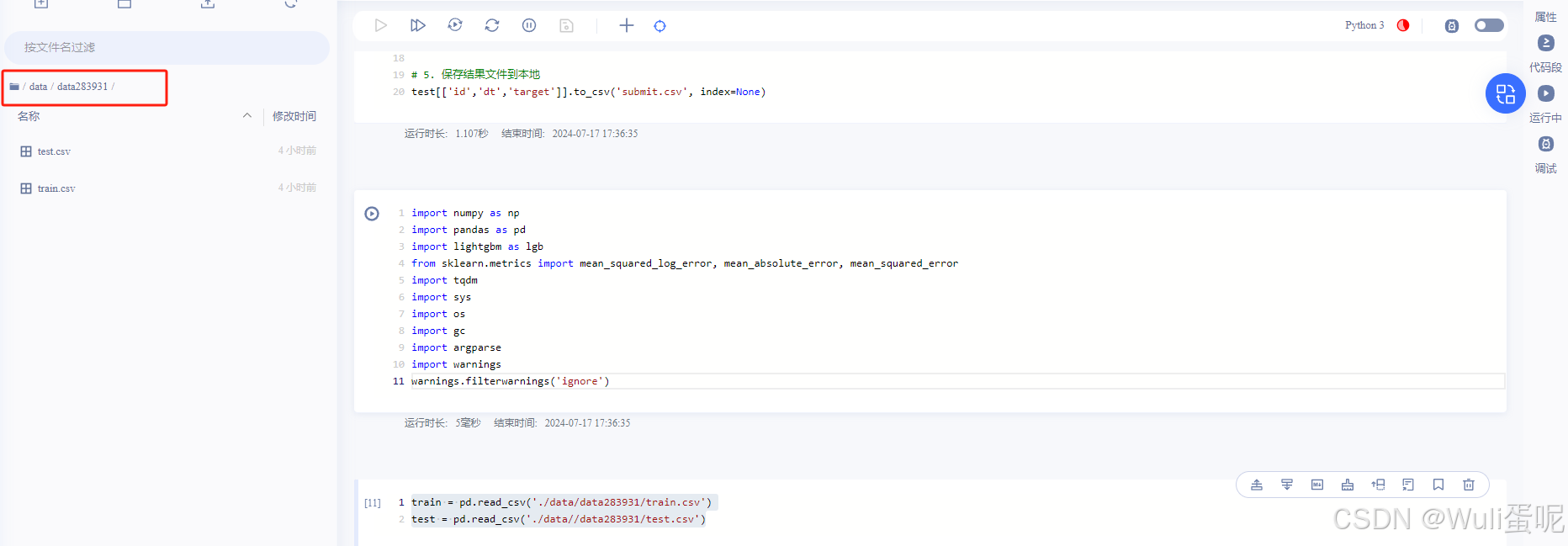

官方源代码:(读取数据集和训练集)

train = pd.read_csv('./data/train.csv')

test = pd.read_csv('./data/test.csv')根据数据包的存储位置需要对以上文件的路径进行修改:

train = pd.read_csv('./data/data283931/train.csv')

test = pd.read_csv('./data//data283931/test.csv')赛题数据集内容简单介绍:

-

其中id为房屋id,

-

dt为日标识,训练数据dt最小为11,不同id对应序列长度不同;

-

type为房屋类型,通常而言不同类型的房屋整体消耗存在比较大的差异;

-

target为实际电力消耗,也是我们的本次比赛的预测目标。

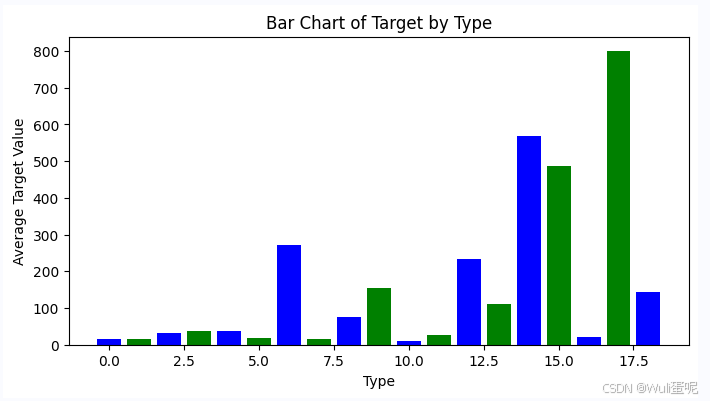

(3)数据可视化

import matplotlib.pyplot as plt

# 不同type类型对应target的柱状图

type_target_df = train.groupby('type')['target'].mean().reset_index()

plt.figure(figsize=(8, 4))

plt.bar(type_target_df['type'], type_target_df['target'], color=['blue', 'green'])

plt.xlabel('Type')

plt.ylabel('Average Target Value')

plt.title('Bar Chart of Target by Type')

plt.show()-

不同type类型对应target的柱状图

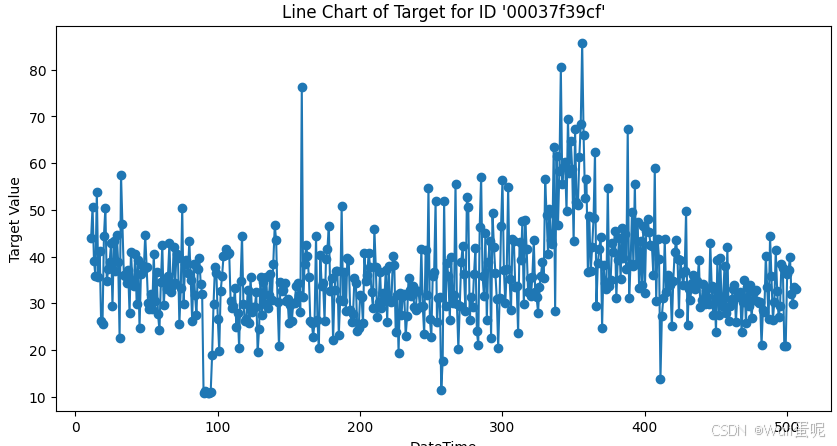

specific_id_df = train[train['id'] == '00037f39cf']

plt.figure(figsize=(10, 5))

plt.plot(specific_id_df['dt'], specific_id_df['target'], marker='o', linestyle='-')

plt.xlabel('DateTime')

plt.ylabel('Target Value')

plt.title("Line Chart of Target for ID '00037f39cf'")

plt.show()-

id为00037f39cf的按dt为序列关于target的折线图

(4)合并训练数据和测试数据,进行一些数据预处理操作,然后重新切分出训练集和测试集

# 合并训练数据和测试数据,并进行排序

data = pd.concat([test, train], axis=0, ignore_index=True)

data = data.sort_values(['id','dt'], ascending=False).reset_index(drop=True)

# 历史平移

for i in range(10,30):

data[f'last{i}_target'] = data.groupby(['id'])['target'].shift(i)

# 窗口统计

data[f'win3_mean_target'] = (data['last10_target'] + data['last11_target'] + data['last12_target']) / 3

# 进行数据切分

train = data[data.target.notnull()].reset_index(drop=True)

test = data[data.target.isnull()].reset_index(drop=True)

# 确定输入特征

train_cols = [f for f in data.columns if f not in ['id','target']](5)模型训练与测试集预测

另外需要注意的训练集和验证集的构建:因为数据存在时序关系,所以需要严格按照时序进行切分,

-

这里选择原始给出训练数据集中dt为30之后的数据作为训练数据,之前的数据作为验证数据,

-

这样保证了数据不存在穿越问题(不使用未来数据预测历史数据)。

def time_model(lgb, train_df, test_df, cols):

# 训练集和验证集切分

trn_x, trn_y = train_df[train_df.dt>=31][cols], train_df[train_df.dt>=31]['target']

val_x, val_y = train_df[train_df.dt<=30][cols], train_df[train_df.dt<=30]['target']

# 构建模型输入数据

train_matrix = lgb.Dataset(trn_x, label=trn_y)

valid_matrix = lgb.Dataset(val_x, label=val_y)

# lightgbm参数

lgb_params = {

'boosting_type': 'gbdt',

'objective': 'regression',

'metric': 'mse',

'min_child_weight': 5,

'num_leaves': 2 ** 5,

'lambda_l2': 10,

'feature_fraction': 0.8,

'bagging_fraction': 0.8,

'bagging_freq': 4,

'learning_rate': 0.05,

'seed': 2024,

'nthread' : 16,

'verbose' : -1,

}

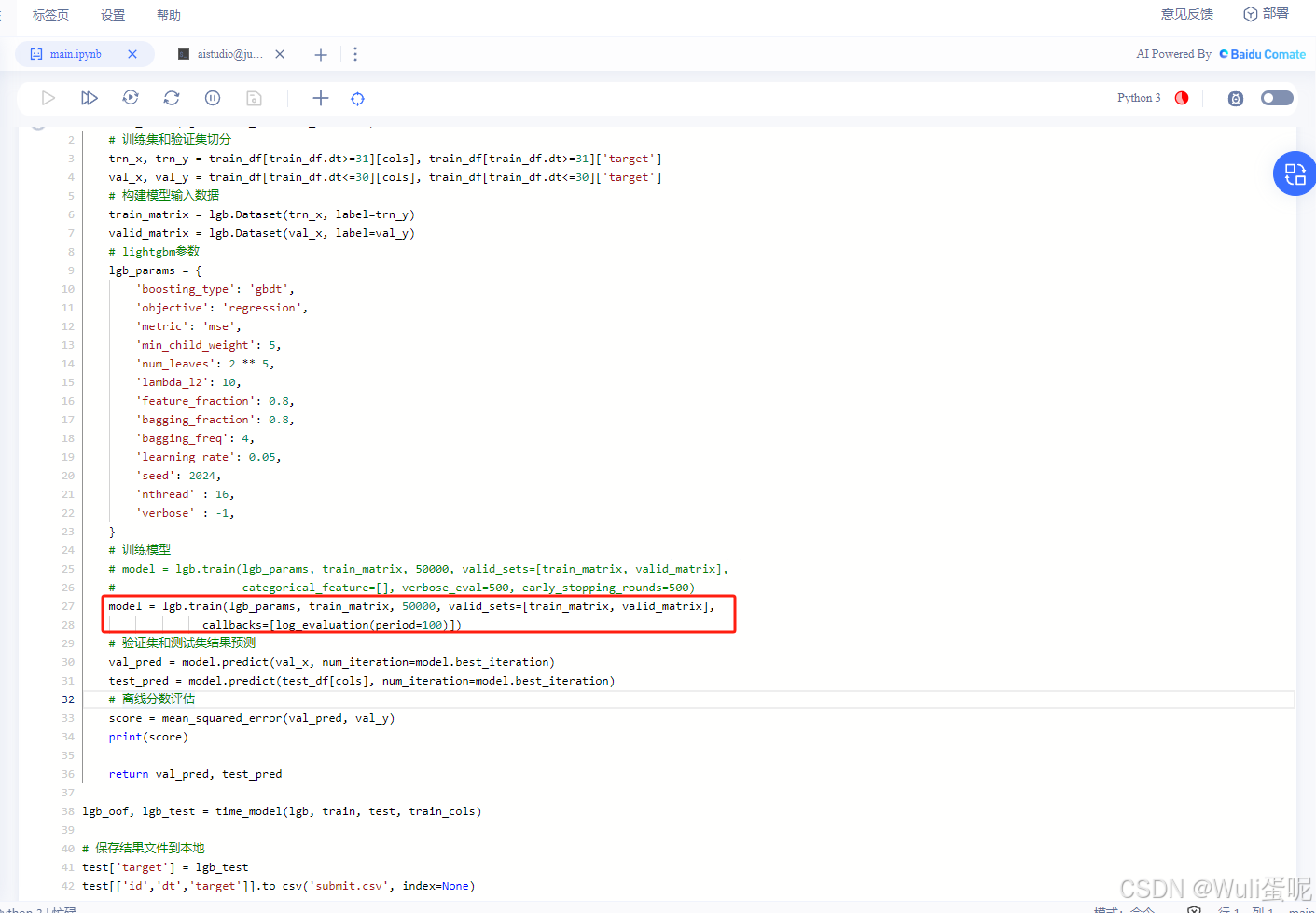

# 训练模型

model = lgb.train(lgb_params, train_matrix, 50000, valid_sets=[train_matrix, valid_matrix],

categorical_feature=[], verbose_eval=500, early_stopping_rounds=500)

# 验证集和测试集结果预测

val_pred = model.predict(val_x, num_iteration=model.best_iteration)

test_pred = model.predict(test_df[cols], num_iteration=model.best_iteration)

# 离线分数评估

score = mean_squared_error(val_pred, val_y)

print(score)

return val_pred, test_pred

lgb_oof, lgb_test = time_model(lgb, train, test, train_cols)

# 保存结果文件到本地

test['target'] = lgb_test

test[['id','dt','target']].to_csv('submit.csv', index=None)3.运行结果

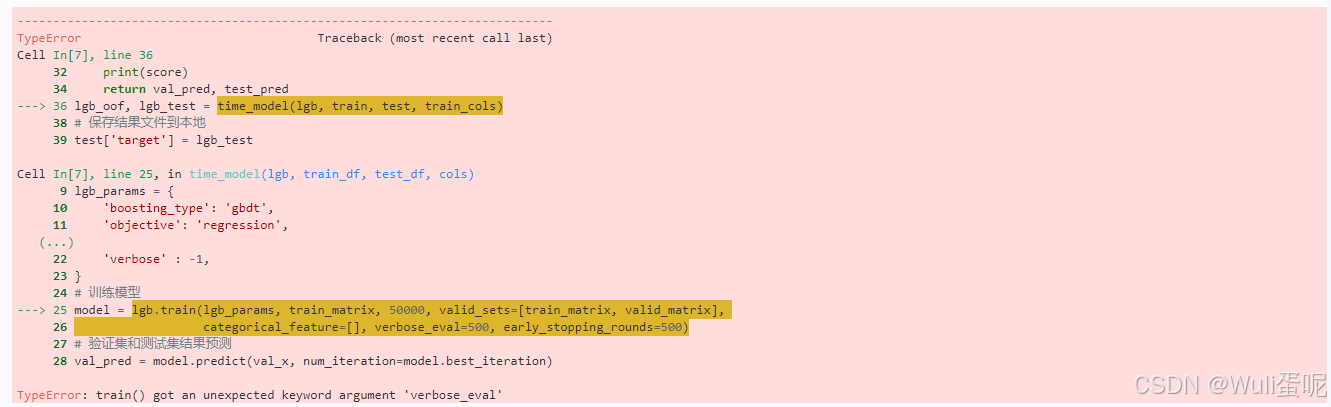

拿到官方的代码后我直接点了运行,出现了以下的报错:

我检查了报错原因:大致是说verbose_eval并不是train函数直接接受的参数

通过查阅资料发现原因是 verbose_eval 参数应该通过回调函数log_evaluation来设置,而不是直接作为lgb.train()的参数。因此,对此部分代码进行修改:

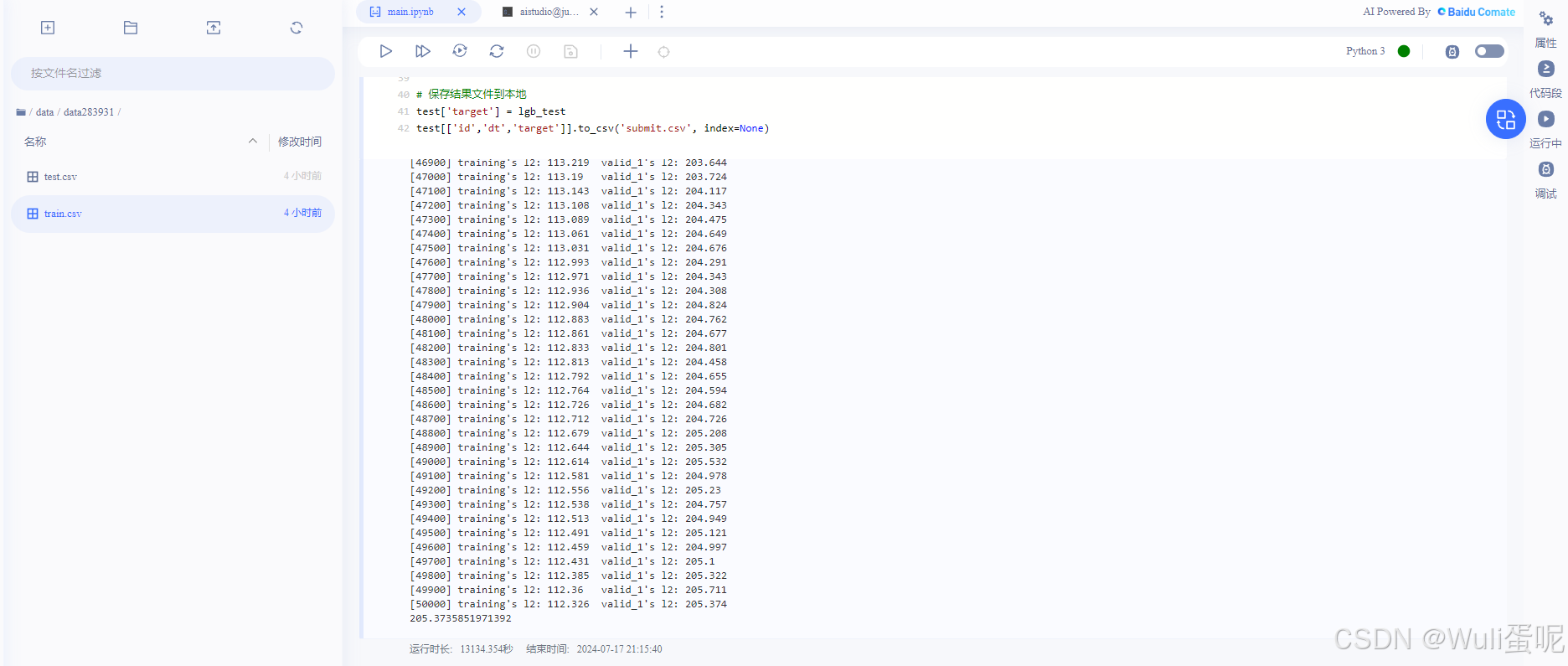

修改后可以运行啦,在没修改参数的前提下需要运行50000次,大概需要三小时,运行结果如下:

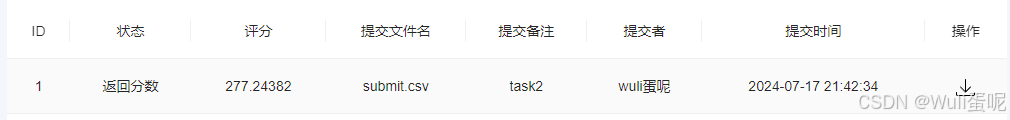

提交了结果,发现分数在277+(这个分数越低越好),说明还有待优化空间。

优化方向

- 目前的验证集和训练集的划分依据

dt列进行,可以尝试更多的数据划分方法,如时间序列交叉验证。 - 目前使用的超参数是手动设置的,可以使用

GridSearchCV或RandomizedSearchCV等方法来自动调整超参数,寻找最佳参数组合。 - LightGBM自带特征重要性评估功能,可以根据重要性得分来选择或删除特征

- 使用

early_stopping_rounds参数,可以让模型在指定轮数内没有改进时停止训练,从而防止过拟合。 - 目前只评估了均方误差,可以增加更多评估指标,如R²、MAE等,以更全面地评估模型性能。

优化代码

下面我从以下几方面更新了代码:

-

早停机制: 在训练模型时,添加了

lgb.early_stopping(stopping_rounds=100)回调函数,让模型在验证集上连续100轮没有提升时会提前停止训练,从而防止过拟合。 -

评估指标: 除了计算均方误差(MSE)之外,还增加了平均绝对误差(MAE)和决定系数(R²)的计算,这样可以更全面地评估模型的性能。

-

日志记录: 使用

lgb.log_evaluation(period=100)回调函数,每100轮训练记录一次评估结果,有助于监控训练过程。 -

代码结构: 代码结构我也做了调整,将模型的训练和评估逻辑封装在

time_model函数中。 -

输出信息: 在评估模型时,我打印了多个评估指标,可以更直观地了解模型的性能。

import lightgbm as lgb

from sklearn.metrics import mean_squared_error, mean_absolute_error, r2_score

from sklearn.model_selection import GridSearchCV

def time_model(lgb, train_df, test_df, cols):

# 数据切分

trn_x, trn_y = train_df[train_df.dt >= 31][cols], train_df[train_df.dt >= 31]['target']

val_x, val_y = train_df[train_df.dt <= 30][cols], train_df[train_df.dt <= 30]['target']

# 构建模型输入数据

train_matrix = lgb.Dataset(trn_x, label=trn_y)

valid_matrix = lgb.Dataset(val_x, label=val_y)

# LightGBM参数

lgb_params = {

'boosting_type': 'gbdt',

'objective': 'regression',

'metric': 'mse',

'min_child_weight': 5,

'num_leaves': 2 ** 5,

'lambda_l2': 10,

'feature_fraction': 0.8,

'bagging_fraction': 0.8,

'bagging_freq': 4,

'learning_rate': 0.05,

'seed': 2024,

'nthread': 16,

'verbose': -1,

}

# 训练模型

model = lgb.train(

lgb_params,

train_matrix,

num_boost_round=800,

valid_sets=[train_matrix, valid_matrix],

callbacks=[lgb.log_evaluation(period=100), lgb.early_stopping(stopping_rounds=100)]

)

# 验证集和测试集结果预测

val_pred = model.predict(val_x, num_iteration=model.best_iteration)

test_pred = model.predict(test_df[cols], num_iteration=model.best_iteration)

# 离线分数评估

mse_score = mean_squared_error(val_pred, val_y)

mae_score = mean_absolute_error(val_pred, val_y)

r2 = r2_score(val_pred, val_y)

print(f'MSE: {mse_score}, MAE: {mae_score}, R²: {r2}')

return val_pred, test_pred

lgb_oof, lgb_test = time_model(lgb, train, test, train_cols)

# 保存结果文件到本地

test['target'] = lgb_test

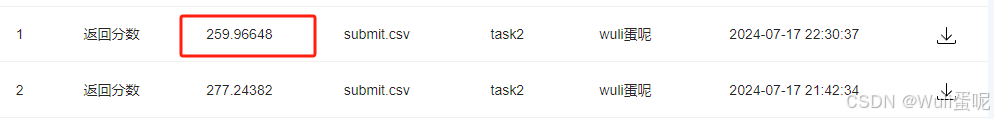

test[['id', 'dt', 'target']].to_csv('submit.csv', index=None)最后的结果相比于不改参数有所提升,且运行的时间也缩短了:

优化总结

优化要点总结

- 数据切分:依据

dt列切分数据集,确保时间序列的前后关系。- 超参数调优:手动设置初始参数,可以通过网格搜索等方法进一步优化。

- 特征选择:可通过LightGBM的特征重要性功能选择特征。

- 使用早停:防止模型过拟合,提高泛化能力。

- 详细评估:增加更多评估指标,全面评估模型性能