loss图解析

- train loss ↘ \searrow ↘ 不断下降,test loss ↗ \nearrow ↗ 不断上升:原因很多,我是把workers=1,batchSize=8192

- train loss ↘ \searrow ↘ 不断下降,test loss ⇝ \leadsto ⇝ 趋于不变:说明网络过拟合;

- train loss ↘ \searrow ↘ 不断下降,test loss ↘ \searrow ↘ 不断下降: 说明网络仍在学习;

- train loss ↘ \searrow ↘ 不断下降,test loss ↘ ↗ \searrow \; \nearrow ↘↗ 先下降后升高:

- train loss ⇝ \leadsto ⇝ 趋于不变,test loss ↗ \nearrow ↗ 不断上升,

- train loss ⇝ \leadsto ⇝ 趋于不变,test loss ⇝ \leadsto ⇝ 趋于不变: 说明学习遇到瓶颈,需要减小学习率或批量数目;

- train loss ⇝ \leadsto ⇝ 趋于不变,test loss ↘ \searrow ↘ 不断下降: 说明数据集100%有问题;

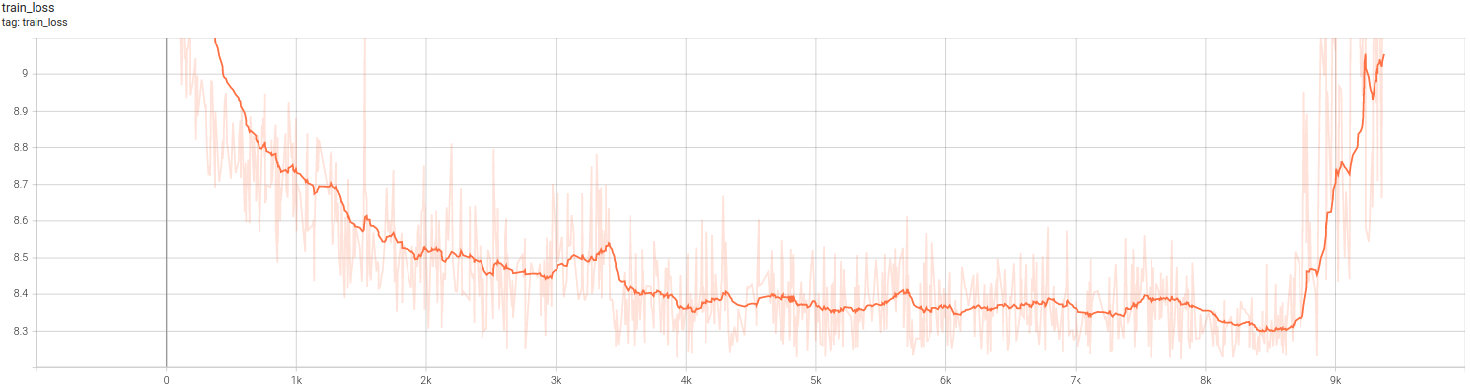

- train loss ↗ \nearrow ↗ 不断上升,test loss ↗ \nearrow ↗ 不断上升:说明网络结构设计不当,训练超参数设置不当,数据集经过清洗等问题。

- train loss ↗ \nearrow ↗ 不断上升,test loss ⇝ \leadsto ⇝ 趋于不变,

- train loss ↗ \nearrow ↗ 不断上升,test loss ↘ \searrow ↘ 不断下降,

train loss ↘ \searrow ↘ ↗ \nearrow ↗ 先降后升

这种情况可能是由于loss函数存在比较奇怪的地方,导致梯度爆炸。参考网址