代码在最后

本次设计了一个LSTM+基于差分多头注意力机制的改进的iTransformer时间序列预测模型结合了LSTM(长短期记忆网络)和改进版的iTransformer(差分多头注意力机制),具备以下优势:

-

时序特征建模能力:

- LSTM的优势:LSTM擅长捕捉时间序列中的长期依赖关系,对于周期性、趋势性变化的建模非常有效,能够处理复杂的时间序列模式,尤其是在非线性和动态变化的序列中。

- 多头注意力机制的优势:通过多头注意力机制,可以从不同的子空间并行地关注序列中的不同部分,有助于捕捉输入序列中的多尺度和多层次的依赖关系。差分注意力机制则能够进一步增强模型对序列中不同时间点间变化的敏感性。

-

增强模型的灵活性与适应性:

- 传统的iTransformer模型通过自注意力机制建模序列中的全局依赖,而引入差分多头注意力机制后,能够更加灵活地处理不同时间步之间的依赖关系,并通过差分操作提高模型对短期波动和突变的响应能力。

- 对于具有周期性波动或突发性变化的时间序列,差分操作能够有效减少长期趋势的干扰,使得模型能够专注于更加细粒度的变化。

-

减少噪声干扰:

- 传统的iTransformer模型在处理含有噪声的时间序列时,可能会因为自注意力机制对全局依赖关系的过度关注而被噪声干扰。差分多头注意力机制能够通过差分的方式抑制噪声的影响,从而提高预测的准确性。

-

多尺度学习:

- 多头注意力机制在不同的头部学习不同尺度的信息,这对于时间序列预测尤其重要,因为时间序列数据通常存在不同的时间尺度(例如日、周、月的周期性波动)。差分多头注意力能够根据数据的不同特征动态调整各个头部的关注点,从而获得多层次、多尺度的预测能力。

-

增强的预测性能:

- 结合LSTM的长短期记忆能力和差分多头注意力机制的灵活性,LSTM+差分多头注意力机制改进版的iTransformer能够更好地捕捉复杂时间序列数据中的非线性关系、周期性特征以及局部趋势变化,因此相比传统的时间序列预测模型(如LSTM或iTransformer单独使用)具有更好的预测精度和泛化能力。

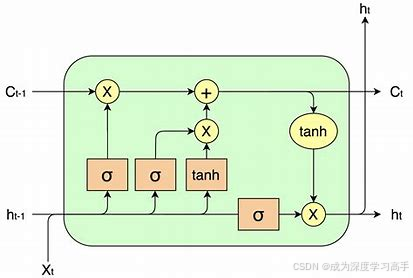

1.LSTM

LSTM(Long Short-Term Memory,长短期记忆网络)是一种特殊的递归神经网络(RNN),设计用于解决标准RNN在处理长序列时的梯度消失和梯度爆炸问题。LSTM通过引入记忆单元和门控机制,可以在长时间跨度内保持和更新关键信息,从而在许多序列数据任务中表现出色。

LSTM的结构

LSTM的基本单元包括以下三个主要组件:

-

细胞状态(Cell State):

- 细胞状态是LSTM的核心部分,贯穿整个序列的数据流。它相当于一个直通通道,允许信息以最少的修改通过时间步长传播。细胞状态通过加法和乘法操作来控制信息的传递和遗忘,避免了梯度消失问题。

-

门控机制(Gates): LSTM通过三个门控来调节信息的流动:

- 遗忘门(Forget Gate):决定细胞状态中哪些信息需要被遗忘。它接受前一时间步长的隐藏状态和当前输入,通过一个Sigmoid激活函数输出一个0到1之间的值,控制信息是否被丢弃。

- 输入门(Input Gate):决定当前时间步长的新信息对细胞状态的更新程度。输入门与当前输入和前一隐藏状态结合,通过Sigmoid激活函数输出控制信号。

- 输出门(Output Gate):决定细胞状态中的哪些部分将作为隐藏状态输出,并传递到下一时间步长。输出门通过Sigmoid激活函数,结合当前输入和前一隐藏状态,生成下一步的隐藏状态。

-

隐藏状态(Hidden State):

- 隐藏状态是LSTM输出的主要内容,也是传递到下一个时间步长的信息。它包含了LSTM单元对当前时间步长输入和细胞状态的理解。

本文尝试使用傅里叶卷积改进itransformer,相结合进行时间序列的预测,作为一个创新性模型。

2.itransformer

基于Transformer模型的时序预测架构通常将同一时间步的不同变量编码成一个统一的多维temporal token,并通过注意力机制来建模不同时间步之间的时序相关性。然而,近年来线性时序预测模型重新崛起,展现出比Transformer模型更优的效果,促使人们反思当前基于Transformer的时序预测架构的一些局限性:

-

对于同一时间步的数据点,变量之间可能具有不同的物理意义,采集时间可能不一致,且尺度差异显著。将这些变量强行编码为统一的temporal token,不再区分不同的通道(channels),可能会导致多变量间的相关性被削弱,从而无法有效学习基于变量的高效表征,不适用于多变量时序预测任务。在某些数据集中,保持变量通道的独立性并考虑变量之间的互相关性是非常必要的。此外,由于变量之间存在时滞性,一个时间点的temporal token所包含的信息量有限,从这些token出发,可能不利于建模全局的时序相关性。

-

在建模时间方向上的长期依赖性时,随着历史窗口长度的增加,Transformer面临性能下降和计算量爆炸的问题。

基于这些思考,提出了一种全新的基于Transformer的时序预测架构,该架构并未改变Transformer的网络结构,而是重新定义了注意力机制和前馈网络的作用。iTransformer将不同的变量独立编码为各自的token,通过注意力机制来建模变量之间的相关性,同时通过前馈网络建模变量的时序相关性,从而获取更优的时序表征。

2.工作原理

图上部分是传统Transformer的运行机制,传统的Transformer是将同一时间戳下的各个变量赋予相同的Token值,会影响各个变量之间相关性的提取;同时当遇到时间不对齐事件时,这种方式也会引入噪声。传统的Transformer的self-attention和Embedding也会将时序信息打乱,这样也会对预测产生影响。基于此,本文提出iTransformer“倒置Transformer”,简而言之就是对时间序列采取一种“倒置视角”,将每个变量的整个时间序列独立地Embedding为一个token,并用注意力机制进行多元关联,同时利用FNN进行序列表示。

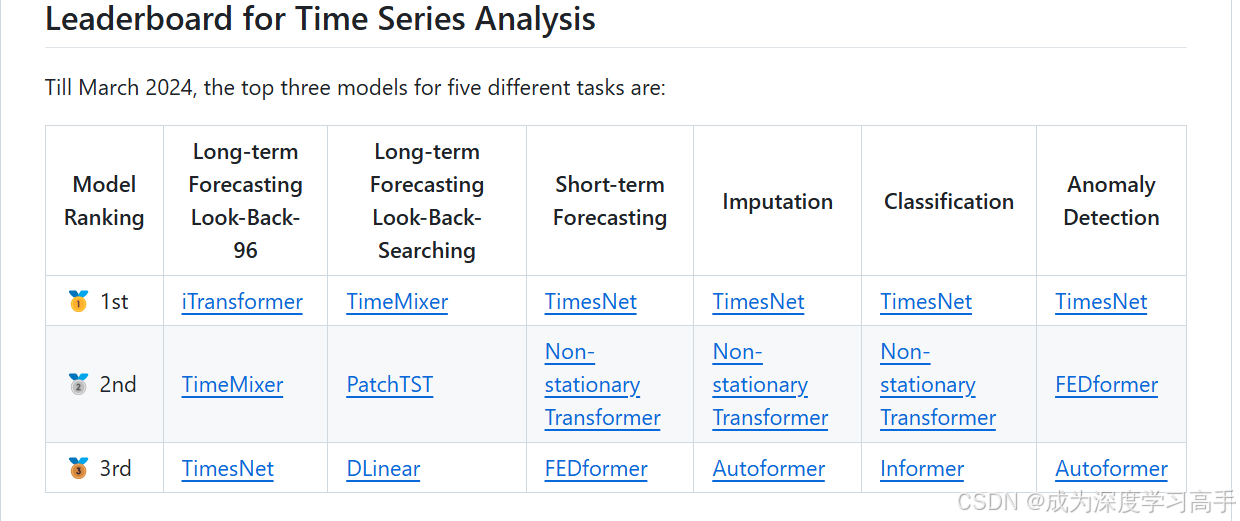

具体介绍可以看源码论文:https://arxiv.org/pdf/2310.06625

目前清华大学排列的不同任务预测效果,itransformer也排在前列,是一个相对优秀的模型。

3.差分注意力机制

原论文:https://arxiv.org/pdf/2410.05258

需要的同学可以看原论文,这里就不在详细介绍,很好理解。

Transformer 模型倾向于将注意力过多分配到与任务无关的上下文,导致注意力噪声问题。

在此工作中,作者提出了一种名为 DIFF Transformer 的新架构,使用差分注意力机制来强化对关键信息的关注,同时抑制噪声。具体而言,该机制通过计算两组独立的 Softmax 注意力分布之间的差值来实现降噪,从而促进稀疏注意力模式的形成。

实验表明,DIFF Transformer 在扩展模型规模和训练数据时的表现优于传统 Transformer,

并在长上下文建模、关键信息检索、减少幻觉(如问答和文本摘要任务中的错误生成)以及上下文学习等实际应用中表现出显著优势。

此外,该方法还能减轻模型激活值的离群问题,为量化和训练稳定性提供新的可能性。

通过更专注于相关上下文,DIFF Transformer 提高了模型的准确性和鲁棒性,

尤其是在处理长序列和复杂任务时。

核心创新:

引入了差分注意力机制,通过计算两个独立的 Softmax 注意力分布的差异来消除噪声,增强对关键信息的关注。

它确保模型将注意力集中在与任务相关的关键信息上,而不是被无关上下文干扰。

类似于降噪耳机中的差分放大器,该机制通过相减操作过滤掉公共噪声。

4.实验部分

部分实验代码

class Model(nn.Module):

"""

Vanilla Transformer

with O(L^2) complexity

Paper link: https://proceedings.neurips.cc/paper/2017/file/3f5ee243547dee91fbd053c1c4a845aa-Paper.pdf

"""

def __init__(self, configs):

super(Model, self).__init__()

self.pred_len = configs.pred_len

self.output_attention = configs.output_attention

self.lstm = LSTM(input_size=configs.enc_in, hidden_size=configs.d_model, num_layers=3,

batch_size=configs.batch_size)

# Embedding

self.enc_embedding = DataEmbedding(configs.enc_in, configs.d_model, configs.embed, configs.freq,

configs.dropout)

# Encoder

self.encoder = Encoder(

[

EncoderLayer(

AttentionLayer(

FullAttention(False, configs.factor, attention_dropout=configs.dropout,

output_attention=configs.output_attention), configs.d_model, configs.n_heads),

configs.d_model,

configs.d_ff,

dropout=configs.dropout,

activation=configs.activation

) for l in range(configs.e_layers)

],

norm_layer=torch.nn.LayerNorm(configs.d_model)

)

# Decoder

self.dec_embedding = DataEmbedding(configs.dec_in, configs.d_model, configs.embed, configs.freq,

configs.dropout)

self.decoder = Decoder(

[

DecoderLayer(

AttentionLayer(

FullAttention(True, configs.factor, attention_dropout=configs.dropout,

output_attention=False),

configs.d_model, configs.n_heads),

AttentionLayer(

FullAttention(False, configs.factor, attention_dropout=configs.dropout,

output_attention=False),

configs.d_model, configs.n_heads),

configs.d_model,

configs.d_ff,

dropout=configs.dropout,

activation=configs.activation,

)

for l in range(configs.d_layers)

],

norm_layer=torch.nn.LayerNorm(configs.d_model),

projection=nn.Linear(configs.d_model, configs.c_out, bias=True)

)

数据集

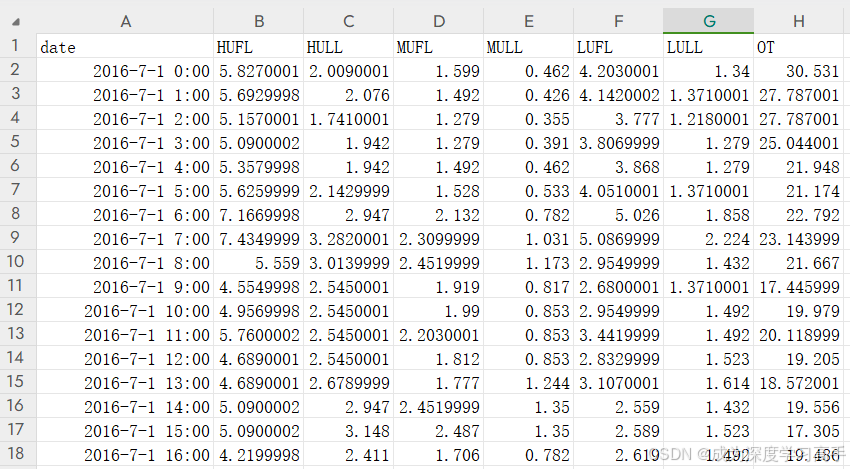

数据集都可以,只要是时间序列格式,不限领域,类似功率预测,风电光伏预测,负荷预测,流量预测,浓度预测,机械领域预测等等各种时间序列直接预测。可以做验证模型,对比模型。格式类似顶刊ETTH的时间序列格式即可。

这里是时间列+7列影响特征+1列预测特征(也可以没有时间)

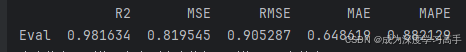

实验结果

这里我按照训练集80%测试集20%进行训练。

第一个是改进前的,第二个是改进后的,可以看出,效果有非常明显的提升,也证实了设计的可行性。

功能如下

1.多变量输入,单变量输出/可改多输出

2.多时间步预测,单时间步预测

3.评价指标:R方 RMSE MAE MAPE 对比图

4.数据从excel/csv文件中读取,直接替换即可。

5.结果保存到文本中,可以后续处理。

6.对比模型消融实验也准备好了,一步到位

代码带数据,注释清晰,直接一键运行即可,适合新手小白。

接运行,主页还有其他优质模型,或者需要在此基础缝合模型或者其他模型要求,直接发要求给博主就行。

6.补充

创新性非常高,保底3区以上完全够用,效果也不错。代码里也有pdf理论知识和注释方便理解,代码是在顶会源码的基础上解决了大量报错,删除多余部分并且添加功能,适合小白,注释清楚,没学过都能看懂。

继续改进:LSTM也可以改为其他创新卷积或者提取特征模块,例如可将LSTM改为TCN,CNN或者其他提取特征的方式,itransformer也可以替换为其他主预测模型,另外也可以改其他优化算法,继续提升创新。比如SSA,多元宇宙,VMd等等其他优化算法。如果需要也可以发要求私信博主。

模型预测效果优秀。结合其他模型或者其他效果都很不错。