基于MindSpore实现BERT对话情绪识别学习心得

摘要

本文通过实现基于MindSpore框架的BERT模型,探讨了对话情绪识别技术。通过环境配置、数据准备、模型构建、训练、验证到推理的全流程,深入理解了BERT模型在情绪识别任务上的应用,并体验了使用MindSpore框架进行深度学习模型开发的过程。

文章大纲

- 环境配置:介绍了如何配置MindSpore和相关依赖,确保实验环境的稳定性和兼容性。

- 模型简介:解释了BERT模型的基本概念及其在自然语言处理中的重要性。

- 对话情绪识别:概述了情绪识别的应用场景和重要性。

- 数据集准备:描述了数据集的下载、加载和预处理流程。

- 模型构建与训练:详细阐述了如何构建BERT模型、配置训练参数以及执行训练过程。

- 模型验证:展示了如何使用验证集评估模型性能。

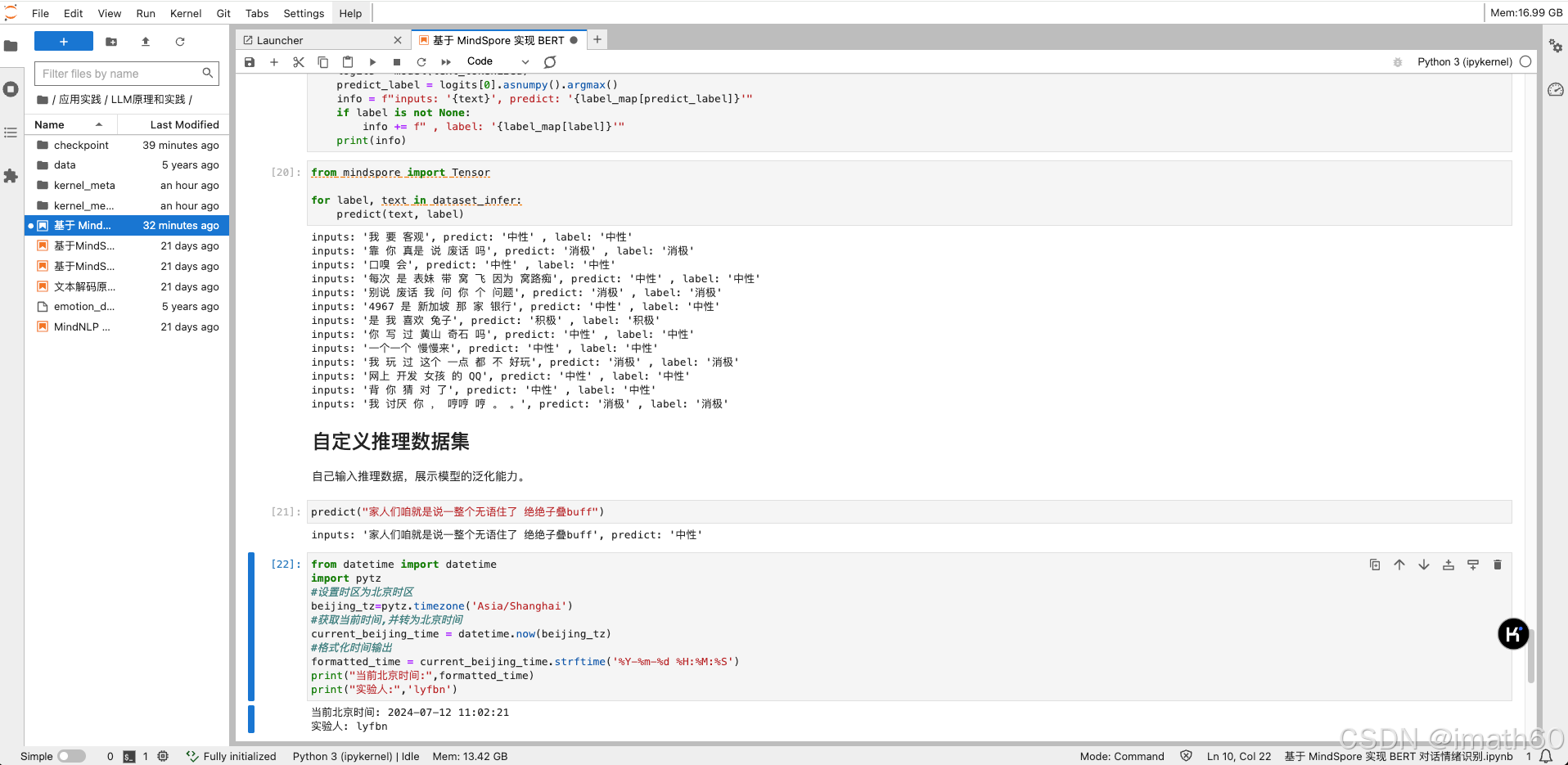

- 模型推理:讨论了模型在实际数据上的推理过程和结果展示。

总结

通过本文档的学习,我深刻体会到了BERT模型在理解和处理自然语言方面的先进性。MindSpore框架的使用体验也相当不错,它提供了简洁的API和高效的执行性能。整个实验流程从数据准备到模型部署,每个步骤都非常重要,缺一不可。特别是在模型训练和验证阶段,对超参数的调整和模型性能的监控尤为关键。最终,模型在测试集上的表现也验证了我们训练的有效性。整个学习过程不仅加深了我对BERT模型的理解,也提高了我使用MindSpore解决实际问题的能力。

心得体会

通过本次学习,我认识到了预训练语言模型的强大能力,尤其是在处理复杂的NLP任务时。BERT模型通过其独特的预训练方法,能够捕捉到深层次的语言特征,这对于情绪识别等任务至关重要。同时,我也学习到了如何利用MindSpore框架进行模型的训练和推理,这为我在深度学习领域的进一步探索打下了坚实的基础。