LSTM(Long Short-Term Memory)神经网络模型是一种特殊的循环神经网络(RNN),它在处理长期依赖关系方面表现出色,尤其适用于时间序列预测、自然语言处理(NLP)和语音识别等领域。以下是对LSTM神经网络模型的详细介绍,包括其每一部分的功能和原理。

一、LSTM网络模型概述

LSTM网络通过引入门控单元(Gate Control)来解决传统RNN在处理长序列时容易出现的梯度消失或梯度爆炸问题。它通过控制信息的流动,有效地保留了序列中的长期依赖信息。

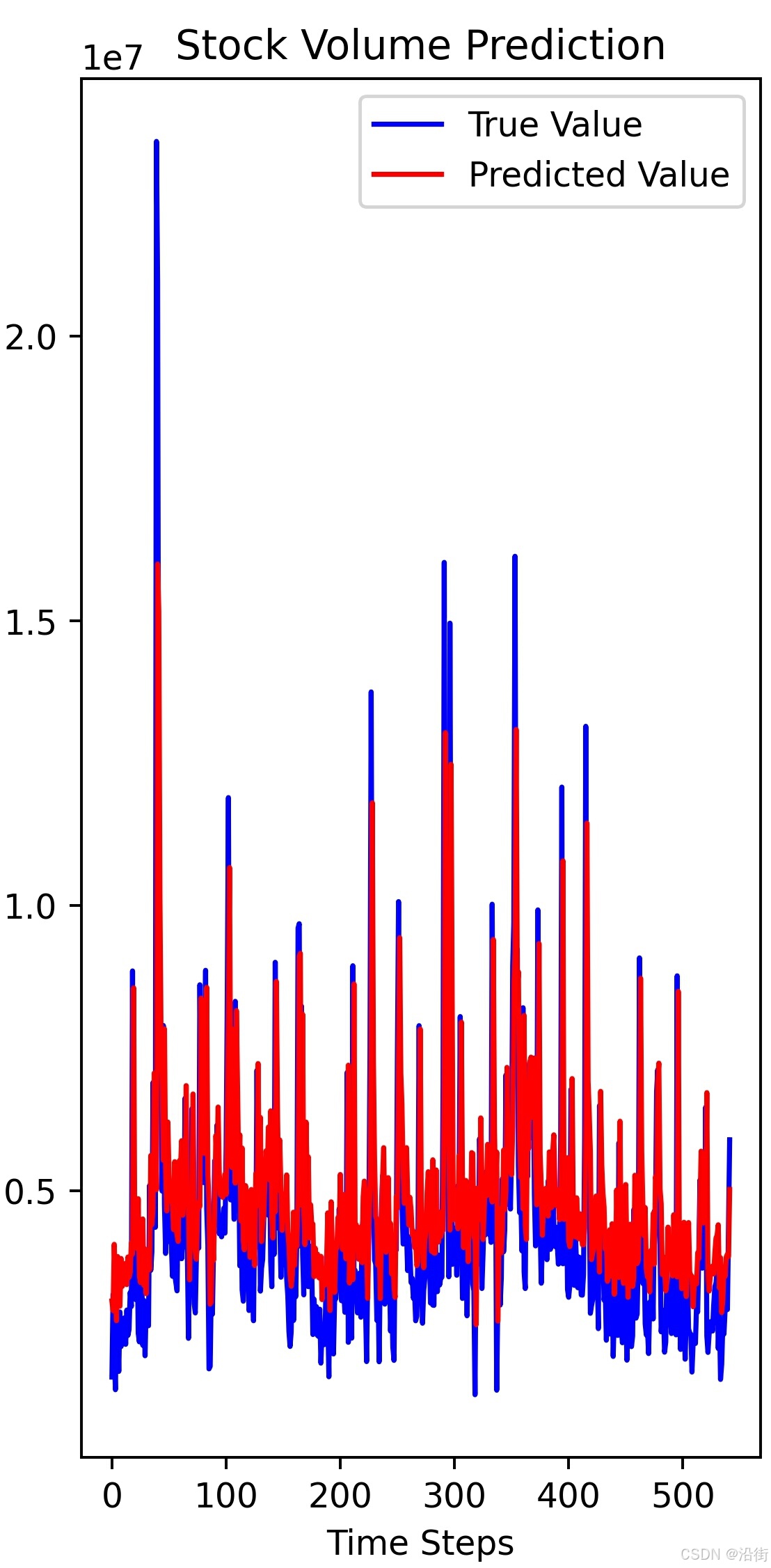

1.1 LSTM网络结构

LSTM网络的基本单元是LSTM细胞(Cell),每个细胞包含三个门控单元:遗忘门(Forget Gate)、输入门(Input Gate)和输出门(Output Gate),以及一个记忆细胞状态(Cell State)。

图1-1 LSTM结构

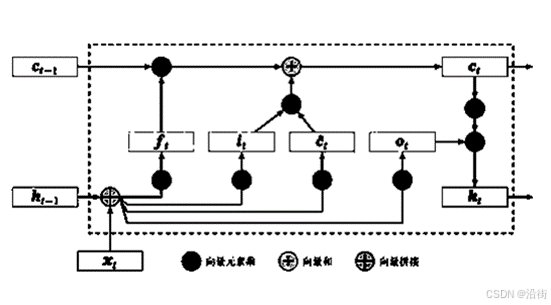

1. 遗忘门(Forget Gate)

遗忘门的作用是决定从细胞状态中丢弃哪些信息。它接收上一时间步的隐藏状态

图1-2 遗忘门

- 输入:

和

- 输出:遗忘门的输出 ft,其计算公式为

,其中 σ 是sigmoid函数,

和

是遗忘门的权重和偏置

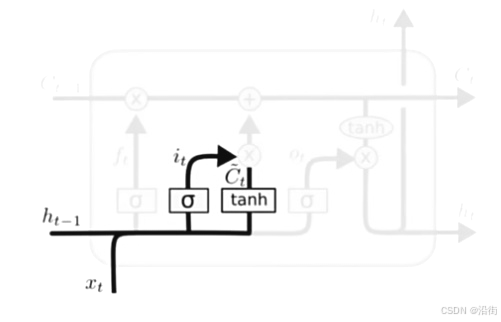

2. 输入门(Input Gate)

输入门决定了哪些新信息将被存储在细胞状态中。它包含两个部分:一部分是sigmoid层,决定哪些信息需要更新;另一部分是tanh层,生成一个新的候选值向量。

图1-3 输入门

- sigmoid层:输出

,表示哪些信息需要更新,其计算公式为

- tanh层:输出

,表示新的候选值向量,其计算公式为

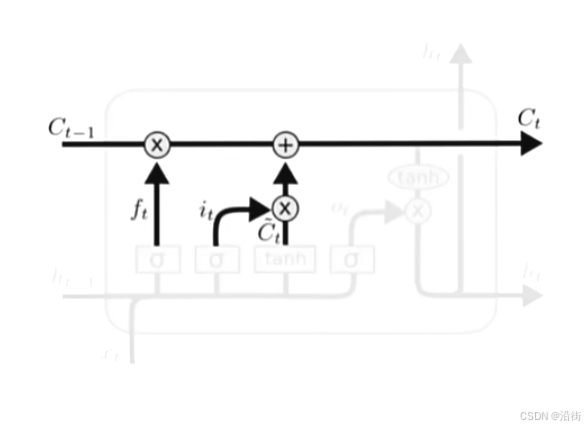

3. 细胞状态(Cell State)

细胞状态是LSTM的核心,它负责存储和传递长期信息。新的细胞状态

图1-4 细胞状态

- 更新公式:

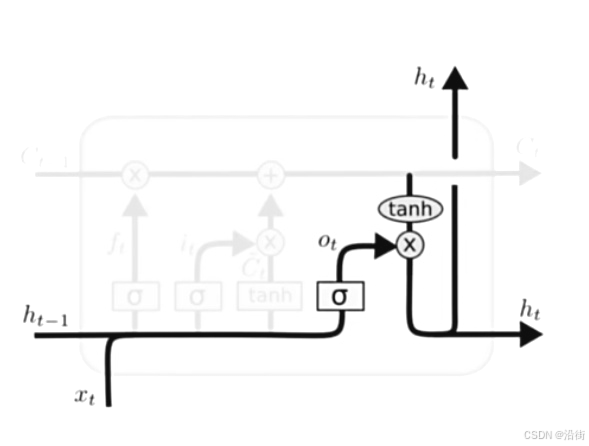

4. 输出门(Output Gate)

输出门决定了当前时间步的隐藏状态 ht 应该携带哪些信息。它接收上一时间步的隐藏状态 ht−1 和当前时间步的输入

图1-5 输出门

- 输入:

和

- 输出:输出门的输出

,其计算公式为

- 隐藏状态:

1.2 LSTM的工作流程

- 遗忘门决定从细胞状态中丢弃哪些信息。

- 输入门决定哪些新信息需要被存储在细胞状态中,并生成新的候选值向量。

- 细胞状态更新,结合遗忘门和输入门的结果。

- 输出门决定当前时间步的隐藏状态应该携带哪些信息。

1.3 LSTM的优点

- 长期依赖:LSTM通过门控单元和细胞状态,有效解决了传统RNN在处理长序列时容易出现的梯度消失或梯度爆炸问题,能够捕捉长距离依赖。

- 广泛应用:LSTM被广泛应用于自然语言处理、时间序列预测、语音识别等领域,并取得了显著成效。

1.4 LSTM的缺点

- 计算复杂:由于LSTM结构复杂,相比传统RNN和其他模型,其训练过程更为耗时。

- 并行性差:LSTM在训练时难以并行化,这在一定程度上限制了其处理大规模数据的能力。

1.5 LSTM的变体

虽然标准的LSTM网络在许多任务中都取得了很好的效果,但研究人员也在不断探索其变体,以进一步提高性能和效率。以下是一些常见的LSTM变体:

-

GRU(门控循环单元):

GRU是LSTM的一个简化版本,它将遗忘门和输入门合并为一个更新门,从而减少了模型的参数数量和计算复杂度。GRU在某些任务上能够取得与LSTM相当的性能,同时训练速度更快。 -

双向LSTM(Bi-LSTM):

双向LSTM由两个LSTM网络组成,它们分别按照正序和逆序处理输入序列。然后,将两个LSTM网络的隐藏状态进行合并,以捕捉序列中的前后文信息。Bi-LSTM在自然语言处理任务中特别有用,因为它能够同时考虑单词的左侧和右侧上下文。 -

堆叠LSTM(Stacked LSTM):

堆叠LSTM是指将多个LSTM层堆叠在一起,每一层的输出作为下一层的输入。这种结构能够捕捉更复杂的序列特征,并在多个抽象级别上表示数据。然而,随着层数的增加,模型的复杂度和训练难度也会增加。

1.6 LSTM的应用

LSTM由于其能够处理长期依赖的特性,在许多领域都有广泛的应用,包括但不限于:

-

时间序列预测:

如股票价格预测、天气预测、交通流量预测等。LSTM能够捕捉时间序列数据中的长期趋势和周期性变化,从而做出更准确的预测。 -

自然语言处理(NLP):

在机器翻译、文本生成、情感分析、命名实体识别等任务中,LSTM被用于捕捉句子或文档中的上下文信息。通过与词嵌入、注意力机制等技术结合,LSTM在NLP领域取得了显著的成果。 -

语音识别:

LSTM能够将音频信号转换为文本序列,是语音识别系统中的重要组成部分。通过捕捉音频信号中的时序特征,LSTM能够识别出语音中的单词和短语。 -

异常检测:

在时间序列数据中检测异常值,如网络流量分析、工业生产线监控等。LSTM能够学习正常行为的模式,并在发现异常模式时发出警报。

LSTM的训练与优化

训练LSTM网络时,通常需要解决一些挑战,如梯度消失/爆炸、过拟合和计算复杂度等。以下是一些常用的优化策略:

-

梯度裁剪:

梯度裁剪是一种防止梯度爆炸的技术。它会在更新网络参数之前,将梯度的值裁剪到一个预定的范围内。 -

正则化:

如L1/L2正则化、Dropout等,用于防止过拟合。Dropout在LSTM中通常应用于非递归连接(如输入到门的连接),以减少过拟合的风险。 -

学习率调度:

使用学习率调度器(如Adam优化器)来自动调整学习率,以加快训练速度并提高收敛性。 -

批量归一化:

批量归一化可以加速训练过程,并减少模型对初始化参数的敏感性。然而,在LSTM中直接应用批量归一化可能会破坏其内部状态,因此需要采用特殊的方法(如Layer Normalization)。

总结

LSTM是一种强大的循环神经网络模型,它通过引入门控单元和细胞状态,有效解决了传统RNN在处理长序列时容易出现的梯度消失或梯度爆炸问题。LSTM在时间序列预测、自然语言处理、语音识别等领域都有广泛的应用,并通过不断的变体和优化,不断提升其性能和效率。然而,LSTM也存在一些挑战,如计算复杂度高、并行性差等,需要在实际应用中根据具体任务进行选择和调整。

二、代码

import pandas as pd

import numpy as np

from keras.models import Sequential

from keras.layers import Dense, LSTM

from sklearn.preprocessing import MinMaxScaler

from sklearn.metrics import mean_squared_error

import matplotlib.pyplot as plt

# 加载数据

data = pd.read_csv('train_data.csv') # 请替换为你的股票数据文件路径

data = data['Volume'].values.reshape(-1, 1)

# 数据预处理

scaler = MinMaxScaler(feature_range=(0, 1))

data = scaler.fit_transform(data)

# 划分训练集和测试集

train_size = int(len(data) * 0.8)

train, test = data[:train_size], data[train_size:]

# 转换数据格式以适应LSTM输入

def create_dataset(dataset, look_back=1):

X, Y = [], []

for i in range(len(dataset) - look_back - 1):

X.append(dataset[i:(i + look_back), 0])

Y.append(dataset[i + look_back, 0])

return np.array(X), np.array(Y)

look_back = 1

X_train, y_train = create_dataset(train, look_back)

X_test, y_test = create_dataset(test, look_back)

# 重塑输入数据的维度以适应LSTM模型

X_train = np.reshape(X_train, (X_train.shape[0], 1, X_train.shape[1]))

X_test = np.reshape(X_test, (X_test.shape[0], 1, X_test.shape[1]))

# 构建LSTM模型

model = Sequential()

model.add(LSTM(4, input_shape=(1, look_back)))

model.add(Dense(1))

model.compile(loss='mean_squared_error', optimizer='adam')

# 训练模型并记录历史损失

history = model.fit(X_train, y_train, epochs=100, batch_size=1, verbose=2, validation_data=(X_test, y_test))

# 预测

train_predict = model.predict(X_train)

test_predict = model.predict(X_test)

# 反归一化预测结果

train_predict = scaler.inverse_transform(train_predict)

y_train = scaler.inverse_transform([y_train])

test_predict = scaler.inverse_transform(test_predict)

y_test = scaler.inverse_transform([y_test])

# 计算预测误差

train_score = np.sqrt(mean_squared_error(y_train[0], train_predict[:, 0]))

print('Train Score: %.2f RMSE' % train_score)

test_score = np.sqrt(mean_squared_error(y_test[0], test_predict[:, 0]))

print('Test Score: %.2f RMSE' % test_score)

# 绘制损失曲线图

plt.figure(figsize=(12, 6))

plt.plot(history.history['loss'], label='Train Loss')

plt.plot(history.history['val_loss'], label='Test Loss')

plt.title('Model Loss')

plt.xlabel('Epochs')

plt.ylabel('Loss')

plt.legend()

plt.show()

# 绘制预测结果图

plt.figure(figsize=(12, 6))

plt.plot(y_test[0], label='True Value')

plt.plot(test_predict[:, 0], label='Predicted Value')

plt.title('Stock Volume Prediction')

plt.xlabel('Time Steps')

plt.ylabel('Volume')

plt.legend()

plt.show()

三、运行结果

3.1 训练损失

图3-1 训练损失

由图3-1可以看出LSTM模型在股票Volume预测任务中展现出良好的学习性能,训练损失在前10个迭代周期内显著下降后趋于稳定,同时测试损失保持在一个相对较低的水平,表明模型不仅有效拟合了训练数据,还具备良好的泛化能力。

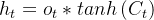

3.2 预测结果

图3-2 真实值与预测值对比

根据图3-2的反馈,可以看出:LSTM模型在股票成交量预测任务中的表现展现出了一定的趋势捕捉能力,但预测结果与实际值(True Value)之间仍存在较为明显的偏差。从图中可以看出,特别是在时间序列的初期和后期,预测值(Predicted Value)与真实值之间的差异较为显著。这可能是由于模型在训练过程中未能充分学习到股票成交量数据的所有复杂性,包括可能的非线性关系和季节性变化。

分析模型训练效果不够好的原因,包括数据集的大小和质量问题,即训练样本数值非常大且差距大,这就导致了数据归一化与反归一化的过程中出现偏差;此外,模型的架构和参数设置也需要进一步优化,以提高其泛化能力和预测精度。另外,股票数据的波动性也对模型的预测性能造成一定影响。综上所述,为了提高LSTM模型在股票成交量预测任务中的表现,需要进一步优化模型结构和参数设置,并考虑引入更多的数据预处理和特征工程步骤。

![i_{t}=\sigma \left ( W_{i}\cdot \left [ h_{t-1} ,x_{t}\right ] +b_{i}\right )](/image/aHR0cHM6Ly9sYXRleC5jc2RuLm5ldC9lcT9pXyU3QnQlN0Q%3D%3D%5Csigma%20%5Cleft%20%28%20W_%7Bi%7D%5Ccdot%20%5Cleft%20%5B%20h_%7Bt-1%7D%20%2Cx_%7Bt%7D%5Cright%20%5D%20+b_%7Bi%7D%5Cright%20%29)

![\tilde{C_{t}}=tanh\left ( W_{C}\cdot \left [ h_{t-1} ,x_{t}\right ] +b_{C}\right )](/image/aHR0cHM6Ly9sYXRleC5jc2RuLm5ldC9lcT8lNUN0aWxkZSU3QkNfJTdCdCU3RCU3RA%3D%3D%3Dtanh%5Cleft%20%28%20W_%7BC%7D%5Ccdot%20%5Cleft%20%5B%20h_%7Bt-1%7D%20%2Cx_%7Bt%7D%5Cright%20%5D%20+b_%7BC%7D%5Cright%20%29)

![o_{t}=\sigma \left ( W_{o}\cdot \left [ h_{t-1} ,x_{t}\right ] +b_{o}\right )](/image/aHR0cHM6Ly9sYXRleC5jc2RuLm5ldC9lcT9vXyU3QnQlN0Q%3D%3D%5Csigma%20%5Cleft%20%28%20W_%7Bo%7D%5Ccdot%20%5Cleft%20%5B%20h_%7Bt-1%7D%20%2Cx_%7Bt%7D%5Cright%20%5D%20+b_%7Bo%7D%5Cright%20%29)