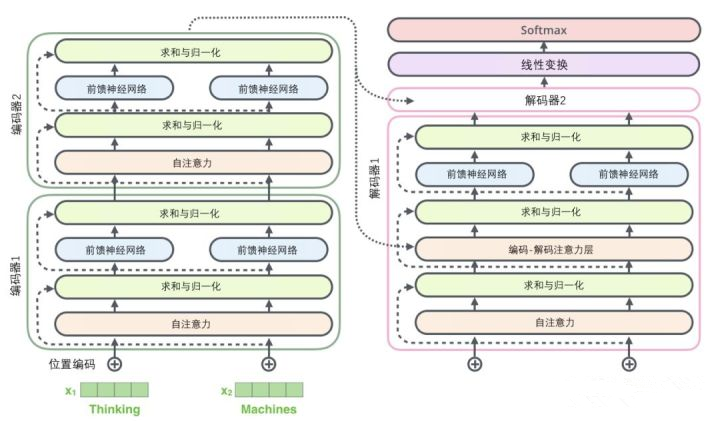

Transformer用自注意力机制来处理时序数据,不同于RNN的串行,Transfomer因为每个时间步可以同时计算,可以实现并行。

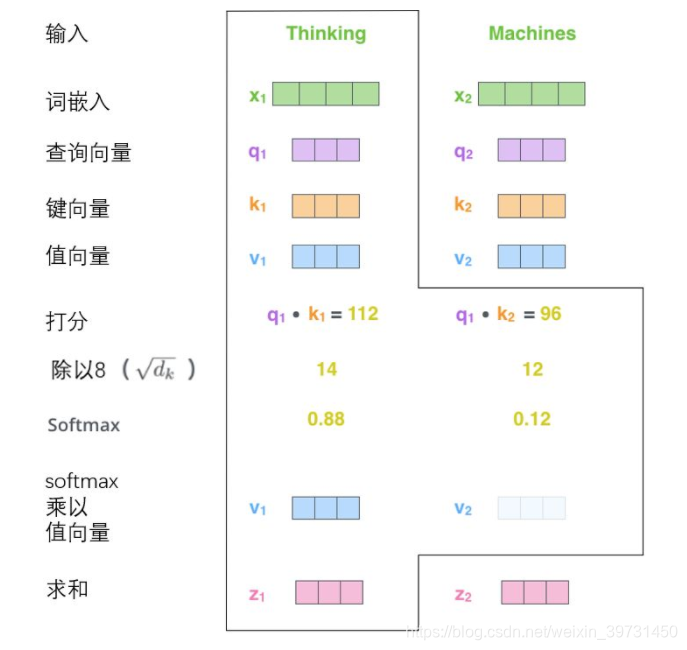

自注意力机制:

利用三个权重矩阵,即WQ,WK,WV(如果是多个WQ,WK,WV则为多头注意力),与输入x相乘得到向量q,k,v。不同的x对应不同的q,k,v。计算当前x的值时,将当前x的q分别与其他x的k相乘再分别除以k维度的开方。得到的值进行softmax。这样当前的x对每一个x(包含自己)都有一个得分。再将得分与每个x对应的v相乘,再将左右所有乘的结果相加得到当前x的z。

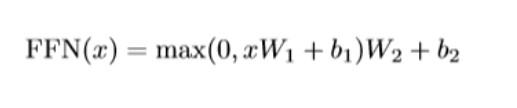

前馈神经网络:

使用全连接网络,其中含有两个ReLU激活函数

解码器:

相比编码器多了编码-解码注意力机制,不同的是其使用的是encoder输出的q。