前言

「作者主页」:雪碧有白泡泡

「个人网站」:雪碧的个人网站

「推荐专栏」:

★java一站式服务 ★

★ React从入门到精通★

★前端炫酷代码分享 ★

★ 从0到英雄,vue成神之路★

★ uniapp-从构建到提升★

★ 从0到英雄,vue成神之路★

★ 解决算法,一个专栏就够了★

★ 架构咱们从0说★

★ 数据流通的精妙之道★

★后端进阶之路★

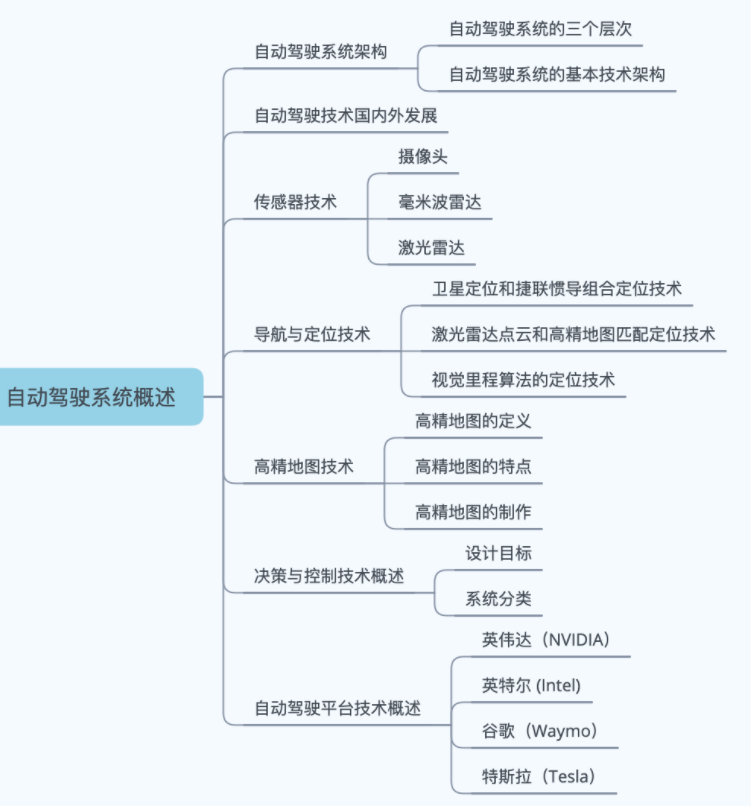

思维导图概述

导航与定位技术

卫星定位和捷联惯导的组合定位技术

自动驾驶导航与定位技术是指通过传感器、地图、算法等技术手段,实现车辆在道路上自主导航和精确定位的技术。其主要目标是提高车辆行驶的安全性、效率性和舒适性。

卫星定位(Satellite Positioning)技术是利用全球定位系统(GPS)或其他卫星导航系统的信号来获取位置和速度信息的一种技术。而惯性导航系统(Inertial Navigation System,简称INS)是利用陀螺仪和加速度计等惯性传感器来测量和跟踪车辆的运动状态和姿态的技术。在自动驾驶中,卫星定位和捷联惯导可以结合使用,以提高定位的准确性和可靠性。

以下是一个简单的示例代码片段,展示了如何使用Python语言实现基于卫星定位和捷联惯导的组合定位技术:

import numpy as np

def satellite_positioning():

# 卫星定位逻辑

# ...

return [latitude, longitude]

def inertial_navigation():

# 惯性导航逻辑

# ...

return [x, y, z]

def combined_localization():

# 组合定位逻辑

satellite_pos = satellite_positioning()

inertial_pos = inertial_navigation()

# 对卫星定位和捷联惯导结果进行融合

combined_pos = [satellite_pos[0] + inertial_pos[0],

satellite_pos[1] + inertial_pos[1],

satellite_pos[2] + inertial_pos[2]]

return combined_pos

# 使用组合定位技术获取当前位置

current_position = combined_localization()

print("Current Position:", current_position)

在上述代码中,

satellite_positioning()函数模拟了卫星定位的逻辑,返回当前的纬度和经度。inertial_navigation()函数模拟了惯性导航的逻辑,返回车辆当前的x、y和z坐标。combined_localization()函数将卫星定位和惯性导航的结果进行融合,得到最终的组合定位结果。最后,通过调用combined_localization()函数,可以获取当前位置,并将其打印出来。

激光雷达点云和高精地图匹配定位技术

激光雷达点云和高精地图匹配定位技术是自动驾驶系统中常用的定位方法之一。它通过将激光雷达采集到的点云数据与预先建立的高精度地图进行匹配,确定车辆在地图坐标系中的位置和姿态信息。以下是一个简单的激光雷达点云和高精地图匹配定位的代码片段示例:

首先,导入所需的库:

import numpy as np

import open3d as o3d

from scipy.spatial import KDTree

接下来,加载激光雷达点云数据:

scan = np.loadtxt('scan.txt') # 根据实际情况读取点云数据,这里假设数据保存在scan.txt文件中

加载高精地图数据:

map_points = np.loadtxt('map.txt') # 根据实际情况读取地图数据,这里假设数据保存在map.txt文件中

map_tree = KDTree(map_points) # 构建地图的KD树方便后续快速最近邻搜索

进行点云和地图的匹配定位:

transformation = None # 初始化变换矩阵

iterations = 100 # 迭代次数

threshold = 0.01 # 阈值,用于剪枝

for i in range(iterations):

source = scan # 当前点云数据

target = map_points # 地图数据

distances, indices = map_tree.query(source) # 寻找source中每个点在地图中的最近邻点

source = source[distances < threshold] # 剪枝,将距离过大的点排除

target = target[indices[distances < threshold]] # 对应的地图点

transformation = o3d.registration.registration_icp(o3d.geometry.PointCloud(),

o3d.geometry.PointCloud(),

np.eye(4),

source,

target,

threshold,

o3d.registration.TransformationEstimationPointToPoint(),

o3d.registration.ICPConvergenceCriteria(max_iteration = 1)).transformation # 进行ICP匹配,得到变换矩阵

最后,得到定位结果:

print(transformation) # 打印定位结果

视觉里程算法的定位技术

视觉里程(Visual Odometry)算法是一种基于摄像头输入的定位技术,它可以通过分析连续帧之间的视觉特征来估计相机的运动和位姿。在自动驾驶中,视觉里程技术被广泛应用于定位和导航系统中。

以下是一个简单的视觉里程算法的代码示例,其中使用了ORB特征提取和特征匹配方法:

import cv2

import numpy as np

# 初始化ORB特征提取器

orb = cv2.ORB_create()

# 初始化图像和相机内参

image1 = cv2.imread('image1.jpg', 0)

image2 = cv2.imread('image2.jpg', 0)

K = np.array([[focal_length, 0, principal_point_x],

[0, focal_length, principal_point_y],

[0, 0, 1]])

# 提取特征点和描述子

keypoints1, descriptors1 = orb.detectAndCompute(image1, None)

keypoints2, descriptors2 = orb.detectAndCompute(image2, None)

# 特征匹配

bf = cv2.BFMatcher(cv2.NORM_HAMMING, crossCheck=True)

matches = bf.match(descriptors1, descriptors2)

# 筛选最好的匹配特征点

matches = sorted(matches, key=lambda x: x.distance)

good_matches = matches[:30]

# 从匹配特征中获取对应的三维点和二维点

points3d = []

points2d = []

for match in good_matches:

points3d.append(keypoints1[match.queryIdx].pt)

points2d.append(keypoints2[match.trainIdx].pt)

# 求解本质矩阵和相机姿态

points3d = np.array(points3d)

points2d = np.array(points2d)

essential_matrix, _ = cv2.findEssentialMat(points2d, points3d, K)

_, rotation, translation, _ = cv2.recoverPose(essential_matrix, points2d, points3d, K)

print("相机位姿:")

print("旋转:", rotation)

print("平移:", translation)

上述代码的主要步骤如下:

- 初始化ORB特征提取器和图像数据。

- 使用ORB特征提取器提取两个连续图像的特征点和描述子。

- 使用特征匹配方法(如Brute-Force匹配器)对特征进行匹配。

- 筛选出最佳的特征匹配点对。

- 通过最佳匹配点对求解本质矩阵和相机姿态。

- 输出相机的旋转和平移矩阵。